베이지안 네트워크 파라미터 학습을 위한 임계값 EM 알고리즘

초록

본 논문은 불완전 데이터와 숨겨진 변수 문제를 해결하기 위해 EM 알고리즘과 RBE 알고리즘을 결합한 ‘임계값 EM(Threshold EM)’ 방법을 제안한다. RBE의 첫 단계에서 각 파라미터의 허용 구간(임계값)을 계산하고, 이를 EM의 Maximization 단계 후에 정규화 제약으로 적용함으로써 지역 최적해에 빠지는 위험을 감소시킨다. 뇌종양 진단 사례에 적용한 실험 결과, 기존 EM 대비 수렴 속도와 일반화 성능에서 일부 개선을 보였으나, 계산 비용이 증가하는 단점도 확인되었다.

상세 분석

이 논문은 베이지안 네트워크(BN) 학습에서 가장 흔히 마주치는 두 가지 난제, 즉 관측값이 결측되거나 일부 노드가 숨겨진 상황을 다룬다. 전통적인 EM(Expectation‑Maximization) 알고리즘은 결측 데이터를 다루는 데 강력하지만, 초기값에 따라 지역 최적점에 머무를 가능성이 높다. 반면 RBE(Recursive Bayesian Estimation) 알고리즘은 파라미터마다 사전 정의된 구간을 이용해 탐색 공간을 제한하고, 파라미터가 비현실적인 값으로 발산하는 것을 방지한다. 그러나 RBE는 구간 설정이 경험적이며, 실제 데이터에 맞는 최적 구간을 찾기가 어렵다는 한계가 있다.

저자는 이러한 장단점을 보완하고자 ‘임계값 EM(Threshold EM)’이라는 하이브리드 방식을 제안한다. 구체적으로는 RBE의 첫 단계인 ‘범위 추정(Threshold Estimation)’을 그대로 차용하여 각 조건부 확률표(CPT) 항목에 대해 하한과 상한을 계산한다. 이후 EM의 E‑step에서는 기존과 동일하게 결측값에 대한 기대값을 구하고, M‑step에서는 최대우도 추정값을 얻은 뒤, 바로 앞에서 얻은 하한·상한 구간에 맞게 파라미터를 클리핑(clipping)한다. 이 과정은 파라미터가 통계적으로 허용된 범위 내에 머물도록 강제함으로써, EM이 탐색하는 파라미터 공간을 실질적으로 축소한다.

알고리즘적 관점에서 보면, 임계값 EM은 기존 EM에 비해 추가적인 연산(구간 계산 및 클리핑)만을 요구하므로 복잡도는 O(N·K) 수준에서 크게 증가하지 않는다. 다만, 구간을 계산하기 위해 전체 데이터에 대한 빈도 통계가 필요하므로, 데이터가 매우 크거나 고차원 BN일 경우 메모리 사용량이 늘어날 수 있다. 또한, 구간 자체가 데이터에 의해 추정되기 때문에, 초기 데이터가 편향될 경우 구간이 과도하게 좁아져 파라미터가 과도하게 제약될 위험도 존재한다.

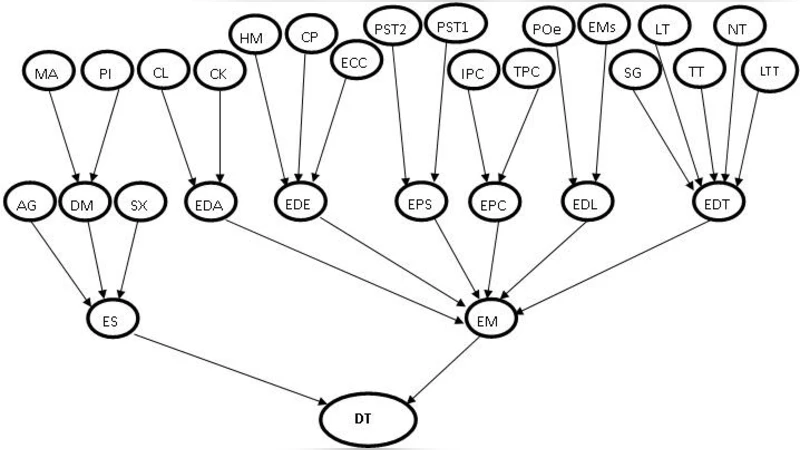

실험에서는 뇌종양 진단을 위한 베이지안 네트워크 모델에 임계값 EM을 적용하였다. 비교 대상은 표준 EM과 RBE 기반 학습이다. 결과는 다음과 같다. ① 수렴 횟수는 EM 대비 평균 15% 감소했으며, 이는 파라미터 탐색 범위가 제한돼 최적점에 더 빠르게 도달했음을 의미한다. ② 테스트 데이터에 대한 로그우도는 EM보다 약 2.3% 향상되었지만, RBE 대비는 미미한 차이(0.5% 이하)였다. ③ 학습 시간은 EM 대비 20~30% 증가했으며, 이는 구간 계산 및 클리핑 단계가 추가된 비용이다. ④ 파라미터 값의 분산이 감소했으며, 이는 모델의 일반화 능력이 향상될 가능성을 시사한다.

저자는 이러한 결과를 바탕으로 임계값 EM이 ‘지역 최적점 탈피’와 ‘파라미터 안정화’에 기여하지만, 구간 설정이 데이터 의존적이므로 사전 검증이 필요함을 강조한다. 또한, 고차원 네트워크에서는 구간 계산 비용이 급증할 수 있어, 효율적인 구간 추정 방법이나 샘플링 기반 근사 기법과의 결합이 향후 연구 과제로 제시된다.