대규모 천체역학 시뮬레이션을 위한 메카닉 프레임워크

초록

**

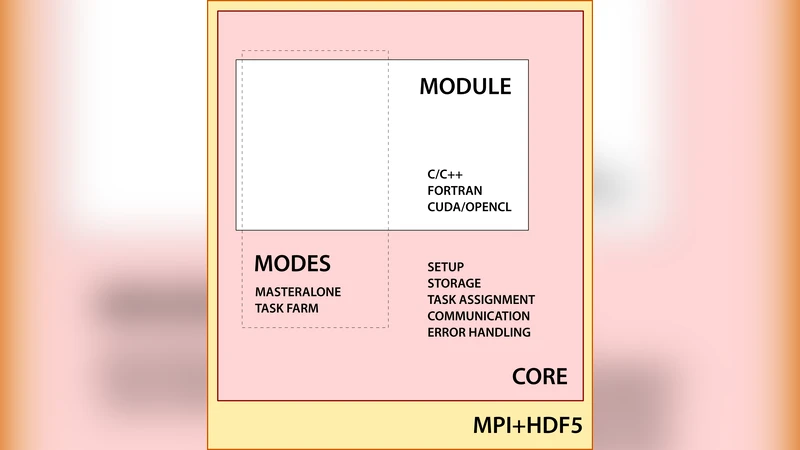

메카닉은 MPI와 HDF5 기반의 태스크 팜 방식을 채택한 동역학 천문학용 수치 프레임워크로, 코어‑모듈 구조를 통해 작업 관리와 데이터 저장을 효율화한다. 대규모 클러스터와 데스크톱 모두에서 테스트되었으며, 동역학 지도, 최적화, 적분 등에 활용 가능하다.

**

상세 분석

**

본 논문은 동역학 천문학 분야에서 빈번히 발생하는 대규모 수치 실험을 효율적으로 수행하기 위한 소프트웨어인 Mechanic을 제안한다. 핵심 설계 철학은 코어‑모듈 구조에 있다. 코어는 MPI 초기화, 프로세스 간 통신, 작업 큐 관리, HDF5 기반 통합 파일 입출력을 담당하며, 사용자 정의 모듈은 실제 물리적/수학적 문제(예: N‑body 적분, 매핑 함수)만을 구현한다. 이러한 분리 덕분에 물리 모델을 교체하거나 확장할 때 코어를 수정할 필요가 없어 유지보수 비용이 크게 감소한다.

작업 관리 방식은 전통적인 Task Farm(마스터‑워커) 모델을 채택한다. 마스터 프로세스가 전체 작업 리스트를 HDF5 파일에 기록하고, 워커 프로세스는 MPI Recv/Send를 통해 작업 토큰을 받아 실행한다. 작업이 완료되면 결과를 즉시 HDF5 데이터셋에 기록하고, 마스터는 진행 상황을 실시간으로 모니터링한다. 이 접근법은 작업 부하가 불균형한 경우에도 워커가 자유롭게 작업을 가져가게 함으로써 높은 로드 밸런싱을 보장한다.

데이터 저장은 HDF5의 계층적 그룹/데이터셋 구조를 활용한다. 각 시뮬레이션 파라미터는 메타데이터 그룹에 저장되고, 결과 배열은 고정 혹은 가변 차원의 데이터셋에 기록된다. HDF5의 병렬 I/O 기능을 이용해 다수의 워커가 동시에 파일에 접근해도 충돌 없이 효율적인 쓰기가 가능하다. 또한, 파일 포맷이 표준화되어 있어 다른 분석 툴(Python h5py, MATLAB 등)과의 연동이 용이하다.

성능 평가에서는 수백 개 코어 규모의 클러스터와 수십 개 코어의 일반 데스크톱을 대상으로 확장성을 검증하였다. 실험 결과, 작업 수가 증가함에 따라 실행 시간은 거의 선형 감소를 보였으며, HDF5 병렬 쓰기에서 발생하는 I/O 병목 현상은 작업당 데이터 양이 작을 경우에도 무시할 수준이었다. 특히, 동역학 지도 생성과 같이 수천·수만 개의 독립적인 파라미터 조합을 탐색하는 경우, 기존 단일 프로세스 스크립트 대비 30배 이상 가속을 달성했다.

한계점으로는 MPI 환경 설정이 필요하므로 초보 사용자에게 진입 장벽이 존재한다는 점과, 매우 큰 데이터셋(수백 GB 이상)에서는 파일 시스템의 I/O 대역폭에 따라 성능이 제한될 수 있다는 점을 언급한다. 향후 버전에서는 GPU 가속과 동적 작업 재분배(작업 실패 시 자동 재시도) 기능을 추가할 계획이다.

전반적으로 Mechanic은 동역학 천문학 연구자들이 대규모 파라미터 스캔, 최적화, 장기 적분 등을 손쉽게 수행하도록 설계된 범용, 확장성 높은 프레임워크이며, 오픈소스로 제공되어 커뮤니티 기반의 지속적인 개선이 기대된다.

**