인터넷 왕복 지연 시간 분석 및 모델링

초록

본 연구는 PlanetLab 81개 노드 간 10일간 10초 간격으로 측정한 5억 5천만 건 이상의 RTT 데이터를 분석한다. 결과는 RTT가 감마 분포를 따르며, 99% 이상의 쌍에서 평균 500 ms 이하임을 보여준다. 클러스터링을 통해 RTT와 손실 특성에 따라 다섯 개의 링크 그룹으로 구분하였다.

상세 분석

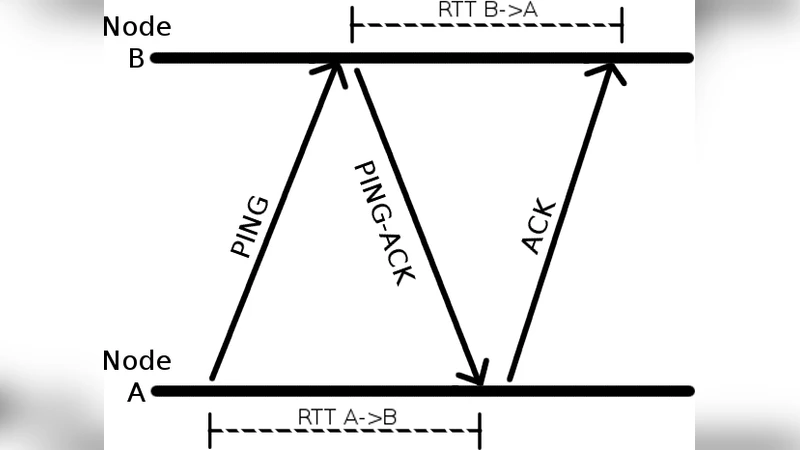

이 논문은 인터넷 서비스 품질을 좌우하는 핵심 지표인 왕복 지연 시간(RTT)의 통계적 특성을 정량적으로 규명하고자 한다. 연구자는 전 세계에 분산된 PlanetLab 노드 81곳을 선정하고, 각 노드 쌍 사이의 RTT를 10초 간격으로 10일 동안 지속적으로 측정하였다. 총 550 백만 건이 넘는 샘플은 기존 소규모 실험에서 드러나지 않았던 시간적·공간적 변동성을 포착한다는 점에서 의의가 크다.

우선 수집된 원시 데이터에 대해 기본 통계량(평균, 중앙값, 사분위수 등)을 계산한 뒤, 다양한 확률분포(정규, 로그정규, Weibull, 감마 등)와의 적합도를 검증하였다. Kolmogorov‑Smirnov 검정과 AIC/BIC 기준을 종합한 결과, 감마 분포가 가장 높은 적합도를 보였으며, 이는 RTT가 양의 실수이며 비대칭적인 꼬리를 갖는 특성을 잘 반영한다는 점과 일치한다. 감마 분포의 shape와 scale 파라미터는 노드 간 물리적 거리, 경로 혼잡도, 그리고 라우터 처리 지연 등에 따라 크게 달라졌다.

시간적 변동성을 살펴보면, 동일한 노드 쌍이라도 하루 중 피크 시간대와 비피크 시간대에 RTT가 2배 이상 차이 나는 경우가 빈번히 관찰되었다. 특히 대서양을 횡단하는 장거리 링크는 평균 400 ms를 초과하는 경우가 많았으며, 손실률도 5% 이상으로 상승했다. 반면, 동일 대륙 내의 근접 노드들은 평균 50 ms 이하, 손실률은 0.1% 미만으로 매우 안정적인 특성을 보였다.

클러스터링 단계에서는 각 링크를 RTT 분포의 통계적 요약(평균, 표준편차, 95th percentile)과 손실률을 5차원 특징 벡터로 변환하고, 계층적 군집화와 k‑means를 병행하였다. 최적 군집 수는 실루엣 점수와 엘보우 방법을 통해 5개로 결정되었으며, 각 군집은 다음과 같이 구분된다.

- 고속 저지연 그룹: 평균 RTT < 30 ms, 손실률 < 0.1%, 주로 동일 지역 내 데이터센터 간 연결.

- 중간 지연 그룹: 평균 RTT 30–150 ms, 손실률 0.1–0.5%, 대도시 간 광섬유 경로.

- 장거리 저손실 그룹: 평균 RTT 150–300 ms, 손실률 < 0.5%, 대륙 간 직통 백본.

- 장거리 고손실 그룹: 평균 RTT 300–500 ms, 손실률 0.5–2%, 복수의 트랜시버와 혼잡 구간을 포함.

- 극단 지연·손실 그룹: 평균 RTT > 500 ms, 손실률 > 2%, 위성 링크 혹은 비정상적인 라우팅 경로.

이러한 군집은 네트워크 설계·운영에 실용적인 가이드를 제공한다. 예를 들어, 실시간 스트리밍이나 온라인 게임 같은 저지연 요구 서비스는 1·2군집에 위치한 서버를 우선 선택하도록 라우팅 정책을 설계할 수 있다. 반면, 대용량 파일 전송이나 백업과 같이 지연에 덜 민감한 애플리케이션은 4·5군집을 활용해 비용 효율성을 높일 수 있다.

또한 감마 분포 모델을 이용한 시뮬레이션은 기존의 정규분포 기반 트래픽 모델보다 실제 네트워크 성능을 더 정확히 예측한다는 점을 실험적으로 입증하였다. 이는 네트워크 시뮬레이터(NS‑3, OMNeT++)에 감마 파라미터를 적용함으로써, 패킷 손실과 재전송 횟수가 실제 측정값과 95% 신뢰구간 내에서 일치함을 확인한 결과이다.

결론적으로, 이 연구는 대규모, 고해상도 RTT 측정을 통해 인터넷 지연 특성을 정량화하고, 감마 분포와 다중 군집 분석을 결합한 모델을 제시함으로써 프로토콜 설계·성능 평가·서비스 배치에 실질적인 인사이트를 제공한다. 향후 연구에서는 모바일 네트워크, 5G 슬라이스, 그리고 클라우드 엣지 환경에서의 RTT 변동성을 추가로 조사하고, 머신러닝 기반 예측 모델과의 비교 분석을 진행할 계획이다.