오픈 데이터와 역공학·유지보수의 새로운 연계

초록

오픈 데이터는 정부·기관이 제공하는 방대한 데이터셋을 자유롭게 활용하도록 하는 흐름이지만, 비정형·다양한 형식, 빈번한 업데이트 등으로 관리와 유지가 어렵다. 본 논문은 역공학과 소프트웨어 유지보수 연구가 오픈 데이터의 수집·전처리·품질 관리에 기여할 수 있는 기회를 제시한다. 역공학 관점에서는 문서 스크래핑, 이미지 처리, 스키마 인식이 핵심 과제이며, 유지보수 관점에서는 데이터 공급자의 변경 추적, 변환 파이프라인의 추적성, 품질 보증이 주요 과제로 제시된다. 이를 통해 새로운 연구 흐름이 형성될 가능성을 논의한다.

상세 분석

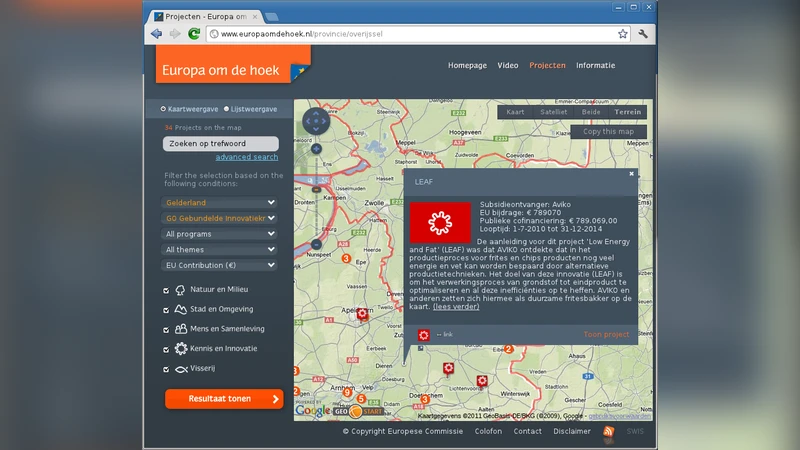

오픈 데이터는 규모와 형식이 매우 이질적이며, 종종 비정형 텍스트, PDF, 이미지, GIS 파일 등으로 제공된다. 이러한 특성은 전통적인 데이터베이스 관리 기법으로는 충분히 다루기 어렵고, 역공학 기술이 필요한 상황을 만든다. 첫 번째 과제는 문서 스크래핑이다. 웹 페이지나 포털에서 자동으로 데이터를 추출하려면 HTML 구조 분석, 동적 로딩 처리, 캡차 회피 등 복합적인 역공학 기법이 필요하다. 특히, 데이터 제공자가 HTML 템플릿을 변경할 경우 기존 스크래퍼가 고장나므로, 변화 감지와 자동 재구성이 필수적이다.

두 번째 과제는 이미지 처리이다. 많은 공공 데이터가 스캔본 PDF나 위성 사진 형태로 제공되는데, 이 경우 OCR(광학 문자 인식)과 이미지 전처리 파이프라인이 필요하다. OCR 정확도는 폰트, 해상도, 언어 등에 따라 크게 달라지므로, 역공학적 접근으로 최적의 전처리 파라미터를 자동 탐색하고, 오류 패턴을 학습해 보정하는 방법이 요구된다.

세 번째 과제는 구조·스키마 인식이다. 데이터셋이 CSV, JSON, XML 등 다양한 포맷으로 제공될 때, 컬럼 이름의 의미 해석, 데이터 타입 추론, 관계 모델링 등을 자동화해야 한다. 여기에는 통계적 프로파일링, 명명 규칙 분석, 외부 메타데이터와의 매핑 등이 포함된다. 역공학 연구는 이러한 과정을 모델 기반 혹은 머신러닝 기반으로 일반화하는 프레임워크를 제공할 수 있다.

유지보수 관점에서는 제3자 제공자의 변경 관리가 핵심이다. 데이터 공급자는 정책, 포맷, 접근 방식 등을 수시로 바꾸며, 이는 downstream 애플리케이션에 직접적인 영향을 미친다. 따라서 버전 관리와 변경 감지 메커니즘을 데이터 파이프라인에 삽입해, 변화가 발생했을 때 자동으로 알림을 주고, 필요한 경우 변환 스크립트를 재생성하거나 수정하도록 지원해야 한다.

또한 변환 파이프라인의 추적성이 요구된다. 원시 데이터 → 정제 데이터 → 분석용 데이터셋까지의 모든 단계에서 입력·출력 관계를 메타데이터로 기록하고, 각 단계의 스크립트와 설정을 버전 관리 시스템에 보관한다면, 문제가 발생했을 때 원인 분석이 용이해진다. 이는 전통적인 소프트웨어 유지보수에서 사용되는 추적 매트릭스와 유사한 형태로 구현될 수 있다.

마지막으로 품질 보증이다. 데이터 품질은 정확성, 완전성, 일관성, 최신성 등 여러 차원을 가진다. 자동화된 테스트 프레임워크를 도입해 스키마 검증, 값 범위 검사, 중복 탐지, 시계열 연속성 검증 등을 정기적으로 수행하면, 데이터 품질 저하를 사전에 방지할 수 있다. 이러한 테스트는 CI/CD 파이프라인에 통합되어, 데이터가 업데이트될 때마다 자동으로 실행된다.

결과적으로, 역공학과 유지보수 기술이 결합된 통합 프레임워크는 오픈 데이터의 수집·전처리·품질 관리 전 과정을 자동화·표준화하고, 변화에 강인한 파이프라인을 구축함으로써 데이터 활용 가치를 극대화한다.

댓글 및 학술 토론

Loading comments...

의견 남기기