GPU를 활용한 분류 트리 병렬 평가의 새로운 접근

초록

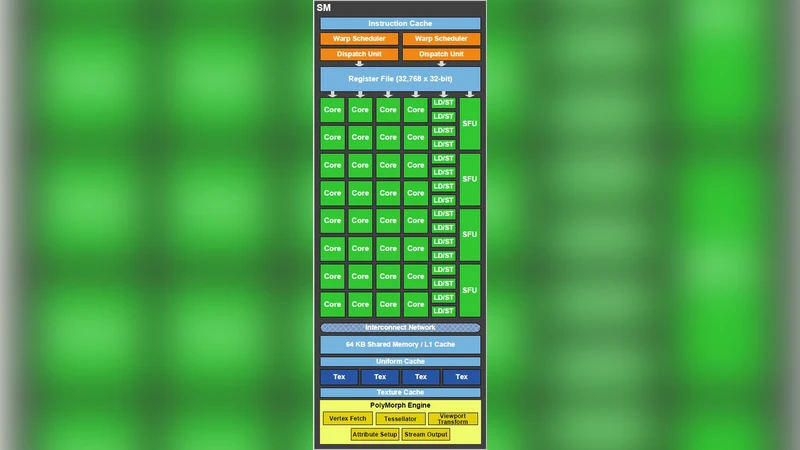

본 논문은 연속 속성을 갖는 분류 트리를 실시간 이미지 세그멘테이션에 적용하기 위해 GPU 기반의 두 가지 병렬 평가 방식을 제안한다. 기존 데이터 분해 방식과 달리, 스펙큘러(예측) 병렬 방식을 설계하여 하나의 샘플에 대해 트리의 모든 노드를 동시에 평가하고, SIMD 환경에서 경로 축소를 수행한다. CUDA 2.0 구현과 CPU 직렬 구현을 비교한 결과, 스펙큘러 방식이 데이터 분해 방식보다 약 25% 빠른 성능을 보였으며, 메모리 대역폭과 워프 발산이 성능에 미치는 영향을 상세히 분석한다.

상세 분석

이 논문은 분류 트리 평가를 GPU의 SIMD 특성에 맞게 최적화하는 두 가지 접근법을 체계적으로 비교한다. 첫 번째는 전통적인 데이터 분해(data decomposition) 방식으로, 각 레코드를 독립적인 작업 단위로 할당해 여러 스레드가 동시에 서로 다른 샘플을 트리의 루트부터 리프까지 순차적으로 탐색한다. 이 방식은 구현이 간단하고 메모리 접근 패턴이 연속적이어서 전역 메모리 코얼레싱을 활용할 수 있지만, 워프 내에서 조건부 분기(branch)로 인한 발산(divergence) 문제가 발생한다. 특히 트리 깊이가 깊어질수록 워프 내 스레드가 서로 다른 경로를 따라가게 되어, 동일한 명령을 순차적으로 실행해야 하는 SIMD 구조의 효율이 급격히 떨어진다.

두 번째는 스펙큘러 병렬(s speculative parallel) 방식이다. 이 방법은 하나의 샘플에 대해 트리의 모든 노드를 동시에 평가하도록 설계되었다. 각 노드는 입력 특성값과 노드의 임계값을 비교해 Boolean 결과를 산출하고, 그 결과를 이용해 다음 단계에서 선택될 자식 노드의 인덱스를 미리 계산한다. 이후 병렬 축소(reduction) 과정을 통해 실제 경로를 결정한다. 이 접근법은 워프 내 모든 스레드가 동일한 명령 흐름을 유지하므로 분기 발산을 최소화한다. 또한, 트리 구조를 배열 형태로 저장하고 인덱스 연산만으로 자식 노드에 접근함으로써 메모리 접근을 규칙적으로 만들고, 전역 메모리 코얼레싱을 극대화한다.

이론적 분석에서는 독립 프로세서 가정 하에 두 방식의 시간 복잡도를 비교한다. 데이터 분해는 O(M·D) (M: 샘플 수, D: 트리 깊이) 형태이며, 스펙큘러 방식은 O(D·log N) (N: 노드 수) 로, 트리 깊이가 작을 경우 유리하지만 노드 수가 많아질수록 축소 단계에서 추가 비용이 발생한다. 실험에서는 CUDA 2.0 기반 GTX 1080 GPU와 Intel i7 CPU를 사용해 다양한 트리 크기와 데이터 셋을 평가하였다. 결과는 스펙큘러 방식이 평균 25% 더 빠르며, 특히 트리 깊이가 10~15 수준인 이미지 세그멘테이션 작업에서 큰 이점을 보였다. 그러나 메모리 대역폭이 제한적인 환경에서는 데이터 분해가 오히려 유리할 수 있음을 지적한다. 또한, 워프 발산을 완전히 없앨 수는 없으며, 트리 구조에 따라 일부 노드에서 조건부 연산이 남아 성능 변동을 일으킨다.

이 논문은 GPU 기반 머신러닝에서 트리 평가 단계가 병목이 될 수 있음을 강조하고, SIMD 친화적인 스펙큘러 설계가 실시간 응용에 적합함을 실험적으로 입증한다. 향후 연구에서는 트리 프루닝, 배치 처리, 그리고 다중 GPU 확장 등을 통해 더욱 높은 스케일러빌리티를 추구할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기