비모수적 가이드가 적용된 자동인코더로 학습된 표현의 혁신

초록

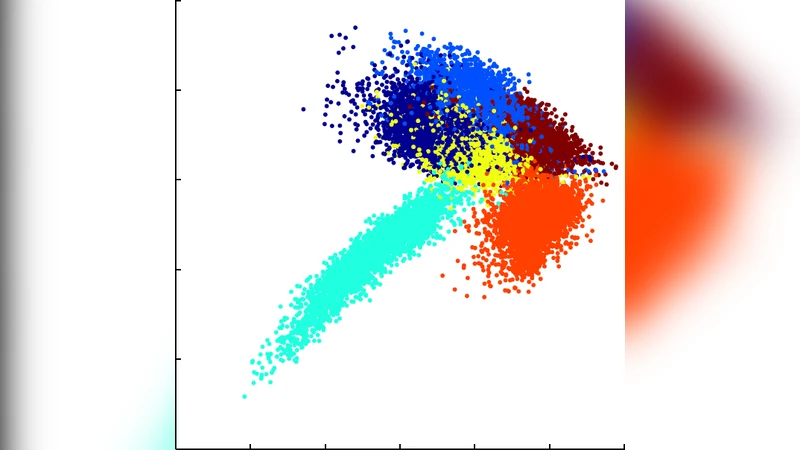

본 논문은 자동인코더에 라벨 정보를 직접 연결하는 파라미터화된 방법 대신, 라벨을 예측할 수 있는 함수가 존재한다는 조건만을 비모수적으로 가정하는 새로운 지도학습 메커니즘을 제안한다. 가우시안 프로세스 잠재변수 모델(GPLVM)과 백컨스트레인(back‑constrained) 기법을 결합해 자동인코더의 잠재공간을 동시에 재구성 손실과 라벨‑GP 손실을 최소화하도록 학습한다. 실험은 Small‑NORB와 또 다른 데이터셋에서 기존 파라메트릭 지도법을 능가하는 성능을 보이며, 불필요한 변환에 대한 불변성을 자연스럽게 학습한다.

상세 분석

이 연구는 자동인코더(AE)의 잠재공간을 두 가지 목적—입력 재구성 및 라벨 예측—에 동시에 최적화하는 새로운 프레임워크인 비모수적 가이드 자동인코더(NPGA)를 제시한다. 기존 방법은 라벨 예측을 위해 잠재공간에서 로지스틱 회귀와 같은 파라메트릭 매핑을 추가했지만, 이는 학습 과정에서 해당 매핑의 파라미터 Λ를 동시에 최적화해야 하는 부담을 만든다. 저자는 라벨 매핑을 파라메트릭하게 명시하지 않고, “라벨을 예측할 수 있는 함수가 존재한다”는 비모수적 가정을 도입한다. 이를 구현하기 위해 Gaussian Process Latent Variable Model(GPLVM)을 활용한다. GPLVM은 잠재공간 X와 관측공간 Y 사이의 매핑을 무한 차원의 함수 집합 위에 가우시안 프로세스(GP) 사전으로 정의하고, 매핑 파라미터를 적분해버림으로써 데이터에 대한 마진 가능도를 얻는다.

NPGA는 자동인코더의 인코더 g(y; φ)를 GPLVM의 백컨스트레인으로 사용한다. 즉, 인코더가 출력하는 잠재벡터를 GP 커널에 입력해 라벨 Z와의 공분산 행렬 Σ_{θ, φ, Γ}을 만든다. 여기서 Γ는 잠재공간 X를 H‑차원으로 선형 투영하는 행렬이며, H < J(잠재 차원)로 차원을 축소해 과적합을 방지한다. 라벨 손실 L_GP는 Σ에 대한 로그‑행렬식과 라벨 벡터 z에 대한 2차형식으로 구성되며, 이는 GP가 라벨을 예측할 수 있는 함수 집합을 비모수적으로 평균화한 결과와 동일하다. 전체 목표는

φ*, ψ*, Γ* = arg min_{φ,ψ,Γ} (1 − α) L_auto(φ,ψ) + α L_GP(φ,Γ)

이며, α∈

댓글 및 학술 토론

Loading comments...

의견 남기기