시간적 동역학만으로 위키피디아 편집 수 예측

초록

본 논문은 위키피디아 편집자들의 향후 5개월간 편집 횟수를, 과거 편집 기록의 시간적 변동만을 이용해 예측하는 방법을 제시한다. 셀프‑슈퍼바이즈드 학습 프레임워크 안에서 편집 횟수, 편집된 문서 수, 첫·마지막 편집 간 시간 간격 등을 다양한 지수적 시간 구간(1/16개월부터 108개월까지)으로 특징화하고, 이를 Gradient Boosted Trees(GBT) 회귀 모델에 학습시켰다. 검증·추가 데이터셋에서 GBT가 다른 회귀 기법을 능가했으며, 최종 제출에서는 RMSLE 0.8625를 기록해 WMF 베이스라인 대비 41.7% 향상, 96팀 중 3위에 올랐다.

상세 분석

이 연구는 “시간적 동역학(feature)만을 사용한다”는 점에서 기존의 콘텐츠‑기반, 사회적 네트워크 기반, 혹은 텍스트‑분석 기반 접근법과 차별화된다. 저자는 편집자의 과거 행동을 연속적인 시간 구간으로 나누어 각 구간의 편집 횟수와 편집된 문서 수를 집계하고, 첫 편집과 마지막 편집 사이의 기간을 로그 스케일로 변환하는 세 가지 기본 특성을 만든다. 구간 선택은 1/16, 1/8, 1/4, 1/2, 1, 2, 4, 12, 36, 108개월로, 초기에는 두 배씩, 이후에는 세 배씩 확대되는 지수적 스케일을 채택했다. 이는 최근 행동이 미래 행동에 미치는 영향이 시간에 따라 지수적으로 감소한다는 가정에 기반한다.

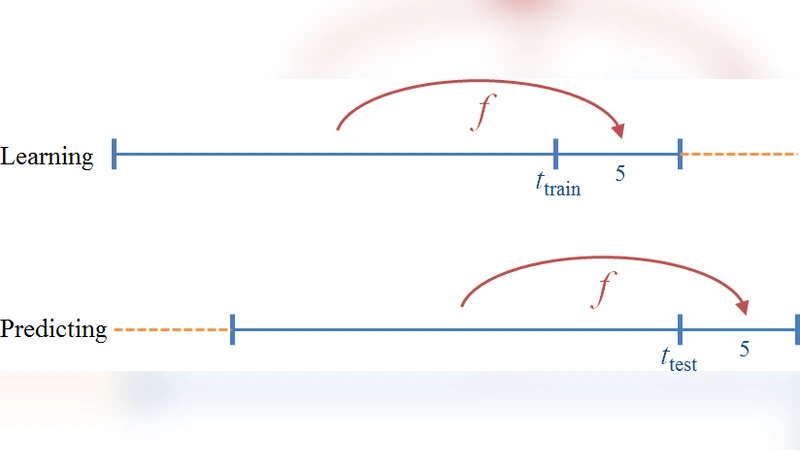

셀프‑슈퍼바이즈드 학습은 “t_test” 시점에서 예측하고자 하는 5개월을 목표로 삼고, 이를 5개월 앞당긴 “t_train” 시점에서 실제 편집 수를 레이블로 사용한다. 레이블은 RMSLE와 직접 연결되는 로그 변환값 y = log(1 + a) 로 정의되어, 회귀 손실 L = (f(x) – y)²가 RMSLE²와 동일하게 된다. 이렇게 하면 모델 학습 단계와 평가 단계가 일관성을 유지한다.

모델 선택에서는 scikit‑learn과 OpenCV에서 제공하는 다섯 가지 회귀 알고리즘(OLS, SVM, KNN, ANN, GBT)을 기본 파라미터로 비교하였다. 결과는 GBT가 모든 데이터셋에서 가장 낮은 RMSLE를 기록했으며, 특히 ‘moredata’(큰 규모)에서는 0.6358, ‘validation’(소규모)에서는 0.8208을 달성했다. GBT의 강점은 비선형 관계를 포착하고, 특성 스케일 차이나 이상치에 강인하며, 부스팅 과정에서 샤링과 학습률(축소)로 과적합을 억제한다는 점이다.

하이퍼파라미터 실험에서는 약 1000개의 약한 트리(weak count)를 사용했을 때 가장 안정적인 성능을 보였으며, 트리 수가 늘어날수록 큰 데이터셋에서는 성능이 개선되지만 작은 데이터셋에서는 과적합 위험이 증가한다는 트레이드오프가 관찰되었다. 또한, 사용되는 시간 구간 수를 늘릴수록 RMSLE가 점진적으로 감소했지만, 8~10개의 구간을 초과하면 개선 폭이 미미해 비용 대비 효율이 떨어진다.

제출 단계에서는 ‘moredata’와 가장 유사한 ‘training’ 데이터에 최적화된 GBT(weak count=1000)를 적용했으며, RMSLE 0.862582를 기록해 WMF 베이스라인 대비 41.7% 향상, 최종 순위 3위를 차지했다.

이 접근법의 핵심 인사이트는 (1) 편집자의 미래 행동이 과거 행동의 시간적 패턴에 크게 의존한다는 점, (2) 복잡한 도메인 지식 없이도 지수적 시간 구간과 강력한 부스팅 회귀만으로 높은 예측 정확도를 달성할 수 있다는 점이다. 따라서 동일한 프레임워크를 쇼핑몰 구매 예측, 환자 입원 예측 등 다른 시계열 행동 예측 문제에 그대로 적용할 수 있다. 다만, 모델이 블랙박스 형태이므로 왜 편집자가 이탈하는지에 대한 인과 해석은 제공하지 못한다는 한계도 명시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기