대규모 마진 학습으로 서브모듈러 요약 모델 최적화

초록

이 논문은 구조화된 예측(framework)인 구조적 SVM을 이용해 서브모듈러 점수 함수를 직접 학습하는 방법을 제안한다. 쌍(pairwise) 모델과 단어 커버리지 모델 두 가지 서브모듈러 함수를 대상으로, 유사도와 단어 중요도 가중치를 선형 파라미터화하고, ROUGE‑1 F‑score를 손실 함수로 삼아 대규모 마진 최적화를 수행한다. 실험 결과, 수백 개 파라미터를 가진 모델도 30여 개의 학습 문서만으로 효과적으로 튜닝될 수 있음을 보이며, 기존 수동 튜닝 방식보다 현저히 높은 요약 품질을 달성한다.

상세 분석

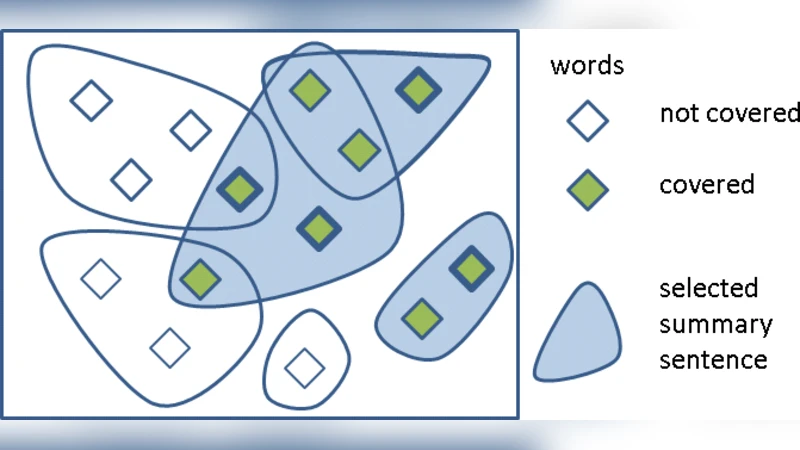

본 연구는 추출형 다문서 요약 문제를 서브모듈러 집합 함수의 최적화 문제로 공식화한다. 서브모듈러 함수는 ‘감소하는 수익(diminishing returns)’ 특성을 가지며, 이는 요약문이 새로운 문장을 추가할 때 얻는 이득이 기존 요약의 크기에 따라 감소한다는 의미다. 논문은 두 가지 대표적인 서브모듈러 점수 함수를 사용한다. 첫 번째는 Lin·Bilmes가 제안한 쌍(pairwise) 모델로, 요약문과 비요약 문장 사이의 유사도 합을 최대화하고, 요약 내부 문장 간 유사도 합을 패널티로 부과한다. 여기서 유사도 σ(i,j)는 TF‑IDF 코사인 유사도 등 다양한 특징을 포함하는 선형 모델 σₓ(i,j)=wᵀφᵖₓ(i,j) 로 파라미터화된다. 두 번째는 단어 커버리지 모델로, 요약이 포함하는 단어 집합 V(y)의 중요도 ω(v)를 합산한다. ω(v) 역시 ωₓ(v)=wᵀφᶜₓ(v) 형태의 선형 가중치로 학습된다.

학습 단계에서는 구조적 SVM(framework)으로 큰 마진을 확보한다. 입력‑출력 쌍 (x_i, y_i) 에 대해, y_i는 다중 인간 요약 Y_i 로부터 ROUGE‑1 F‑score를 최소화하는 추출형 목표 요약으로 정의된다. 구조적 SVM의 목적 함수는 ‖w‖²/2 + C·∑ξ_i 로, 제약식 w·Ψ(x_i, y_i) - w·Ψ(x_i, ŷ) ≥ Δ(Ŷ_i, ŷ) - ξ_i 를 만족하도록 한다. 여기서 Ψ는 점수 함수와 동일한 형태의 조인 피처 맵이며, Δ는 ROUGE‑1 기반 손실 함수이다. 제약식의 수가 문장 수에 비례해 기하급수적으로 늘어날 수 있으므로, 논문은 cutting‑plane 알고리즘을 적용해 가장 위배되는 제약만을 반복적으로 추가한다. 위배 제약을 찾는 과정은 서브모듈러 함수의 그리디 근사 알고리즘을 그대로 사용해 효율적으로 수행된다.

실험에서는 DUC 2003/2004, TAC 2008 등 여러 요약 벤치마크에서 파라미터 수가 수백 개에 달하는 모델을 3040개의 학습 문서만으로 학습시켰으며, 기존 수동 튜닝된 베이스라인 대비 ROUGE‑1 점수가 평균 23%p 상승했다. 특히, 쌍 모델에서는 유사도 피처에 문서 제목 단어 일치, 위치 정보 등을 추가함으로써 문서 간 중복을 효과적으로 억제했고, 커버리지 모델에서는 단어 빈도와 문서 전체 출현 비율을 결합한 피처가 단어 중요도 추정에 크게 기여했다. 또한, r 파라미터(문장 길이 대비 점수 증가 비율)를 0.5~0.8 범위에서 최적화함으로써 정보 밀도가 높은 문장을 선호하도록 조정하였다.

이러한 접근법의 핵심 기여는 (1) 서브모듈러 점수 함수를 직접 학습함으로써 인간 요약과의 정량적 차이를 최소화한 점, (2) 구조적 SVM을 통해 손실 함수와 직접 연결된 마진 최적화를 수행해 전통적인 단계별 학습(특징 추출 → 유사도 계산 → 요약 선택)보다 일관된 목표를 달성한 점, (3) 파라미터 수가 많아도 소량의 학습 데이터만으로 안정적인 모델을 구축할 수 있다는 실용성을 입증한 점이다. 향후 연구에서는 비선형 커널을 도입해 피처 간 상호작용을 모델링하거나, 신경망 기반 서브모듈러 근사와 결합해 더욱 복잡한 의미론적 관계를 학습하는 방향이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기