손글씨 이미지 인증을 위한 역전파 신경망 활용

초록

본 논문은 손글씨 이미지(또는 그래픽 비밀번호)를 RGB 값으로 변환하고 정규화한 뒤, 다층 퍼셉트론(Back‑Propagation Neural Network, BPNN)에 입력하여 사용자의 신원을 인증하는 방법을 제안한다. 이미지‑텍스트 변환, 네트워크 구조 설정, 학습 과정 및 간단한 실험 결과를 제시하지만, 데이터셋 규모와 성능 평가가 부족하다.

상세 분석

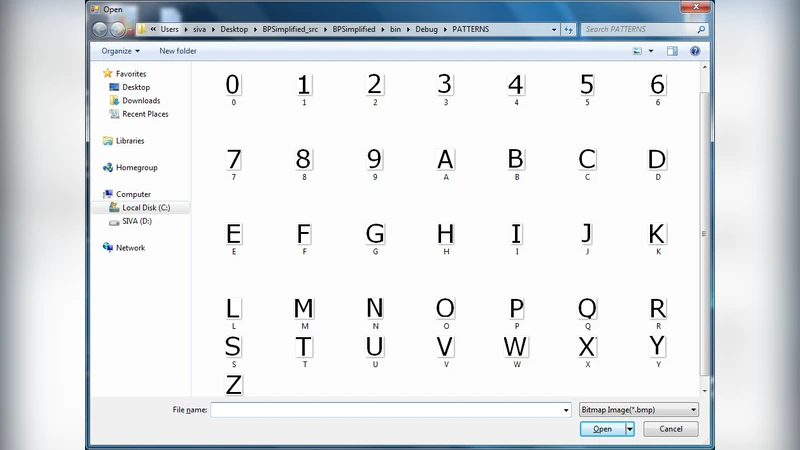

논문은 손글씨 이미지 인증을 위해 먼저 입력 이미지를 픽셀 단위 RGB 값으로 읽어 0~255 범위의 정규화(값/255) 과정을 거쳐 0‑1 실수 행렬로 변환한다. 이후 이 행렬을 1‑차원 벡터 형태로 펼쳐 BPNN의 입력층에 공급하고, 사용자의 아이디와 연계된 목표 출력(예: 0/1 혹은 다중 클래스)으로 학습한다. 네트워크 구조는 사용자가 GUI를 통해 층 수, 은닉 유닛 수, 학습률, 최대 허용 오차 등을 자유롭게 설정할 수 있도록 설계되었으며, 학습 종료 기준은 지정된 오차 이하가 되거나 반복 횟수가 소진될 때이다. 실험에서는 “오류 1.09, 학습 시간 5초”라는 결과만 제시되었으며, 실제 인증 정확도, ROC 곡선, 혼동 행렬 등 정량적 평가는 전혀 제공되지 않는다.

핵심적인 기술적 문제점은 다음과 같다. 첫째, 이미지‑텍스트 변환 과정이 단순히 RGB 정규화에 머물러 있어, 손글씨의 구조적 특징(스트로크, 곡선, 연결성 등)을 반영하지 못한다. 이는 기존 OCR이나 필기 인식에서 사용되는 특징 추출(히스토그램, 방향 히스토그램, 컨투어 등)과 비교했을 때 정보 손실이 크다. 둘째, BPNN은 입력 차원이 매우 높아(예: 100×100 이미지 → 30,000 차원) 과적합 위험이 크며, 차원 축소나 사전 학습된 컨볼루션 레이어가 전혀 도입되지 않았다. 셋째, 논문은 인증 시 “패턴 매칭”을 수행한다고 주장하지만, 실제 매칭 기준이 단순히 출력값과 목표값의 유클리드 거리이며, 임계값 설정이나 보안 강도 분석이 부재하다.

또한, 실험 설계가 매우 제한적이다. 사용된 이미지 수, 사용자 수, 변형(노이즈, 회전, 스케일) 등에 대한 설명이 없으며, 비교 대상(전통적인 이미지‑이미지 매칭, SIFT, SURF 등)도 제시되지 않는다. 따라서 제안 방법이 기존 기술 대비 어느 정도의 이점을 제공하는지 판단하기 어렵다.

문헌 리뷰 부분에서도 손글씨 인식(오프라인·온라인), 특징 추출, 기존 신경망 기반 인증 시스템 등에 대한 전반적인 정리가 부족하고, 많은 참고문헌이 실제 논문 내용과 연관성이 낮다. 전반적으로 논문은 아이디어 수준에서는 흥미롭지만, 구현 세부사항, 실험 검증, 보안 분석이 미흡하여 학술적 기여도가 낮다.

댓글 및 학술 토론

Loading comments...

의견 남기기