초고성능 우주 시뮬레이션, 유럽 슈퍼컴퓨터 그리드에서 0.93 효율 달성

초록

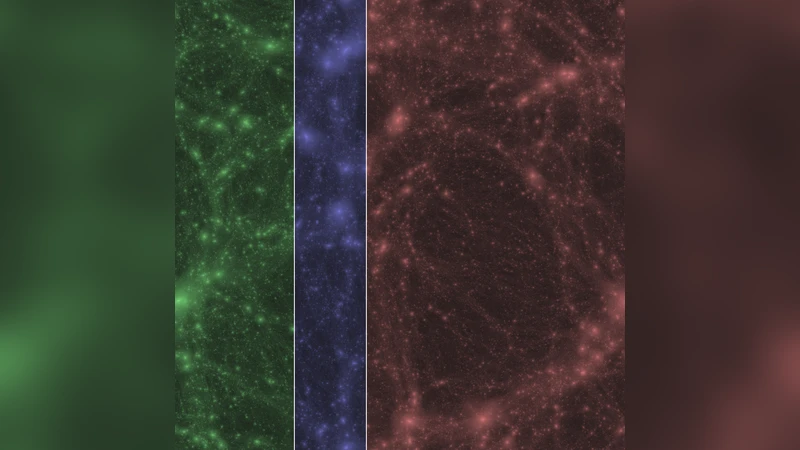

본 논문은 2048³ 입자를 이용한 대규모 우주 N‑body 시뮬레이션을 유럽 3대 슈퍼컴퓨터에 분산 실행하여, 2048 코어 기준 단일 슈퍼컴퓨터 대비 0.93의 효율을 달성한 사례를 제시한다. SUSHI 코드의 파티클‑메시 병렬화, 향상된 로드밸런싱, MPWide 기반 광역 통신 최적화를 통해 계산‑통신 비율을 5~15 % 수준으로 유지했으며, 실험 결과와 운영상의 교훈을 상세히 보고한다.

상세 분석

이 연구는 현대 우주론에서 필수적인 대규모 N‑body 시뮬레이션을 실제 운영 환경에서 어떻게 확장할 수 있는지를 실증한다. 핵심 기술은 기존 SUSHI 통합기능을 크게 개선한 데 있다. 첫째, 파티클‑메시(Particle‑Mesh) 단계에서 FFTW2 라이브러리를 이용해 1차원 슬랩 분할 방식으로 완전 병렬화를 구현함으로써, 이전 버전에서 비병렬화된 부분이 차지하던 계산 시간을 크게 감소시켰다. 둘째, 메쉬 셀 전송 시 실제 입자가 존재하는 셀만을 선택적으로 브로드캐스트하는 압축 전송 방식을 도입해, 사이트 간 데이터 양을 사용한 사이트 수에 비례해 감소시켰다. 셋째, 로드밸런싱 알고리즘을 단순히 포스 계산 시간만 고려하던 기존 방식에서, 각 노드에 할당된 입자 수와 메모리 사용량까지 고려하도록 확장함으로써, 서로 다른 아키텍처(IBM Power6 vs Cray XT4) 간의 부하 불균형을 최소화했다.

통신 측면에서는 MPWide 라이브러리의 최신 버전을 적용해 64개의 TCP 스트림을 병렬로 운영하고, 버퍼 크기와 패킷 페이싱을 최적화함으로써 고지연 광역 네트워크에서도 안정적인 전송을 확보했다. 실제 실험에서는 1 Gbps(HECTOR)와 10 Gbps(Huygens, Louhi) 연결을 사용했음에도 불구하고, 전체 통신 오버헤드가 5 %에서 15 % 사이에 머물렀다. 특히 2048 코어 전체에서 단계당 평균 15 초 정도의 통신 시간이 발생했으며, 이는 전체 실행 시간의 10 % 미만에 해당한다.

성능 측정 결과는 두드러진데, 단일 사이트(Huygens)에서 2048 코어로 실행한 경우와 비교했을 때, 3사이트 분산 실행 시 단계당 평균 9 % 정도만 추가 지연이 발생했다. 이는 메쉬 크기를 512³에서 256³로 축소했음에도 불구하고, 트리 연산 범위가 늘어나면서 계산 시간이 약간 증가했음에도 불구하고 통신 최적화가 이를 상쇄했기 때문이다. 또한, 512³ 입자 규모 실험에서는 통신 오버헤드가 20 % 이하, 1024³ 입자 실험에서는 6.5 % 이하로 감소했으며, 이는 파티클‑메시 병렬화와 로드밸런싱 개선이 큰 효과를 발휘했음을 보여준다.

운영 경험 측면에서 저자들은 네트워크 경로 예약, 동시 자원 할당, 소프트웨어 환경 이질성 등 조직적·기술적 장애물을 상세히 기술한다. 특히, 자동화된 예약 시스템과 표준화된 소프트웨어 스택이 부재할 경우, 프로젝트 초기 단계에서 수 주에 걸친 협상이 필요함을 강조한다. 이러한 교훈은 향후 다중 슈퍼컴퓨터 협업 프로젝트에서 사전 계획과 인프라 표준화의 중요성을 부각시킨다.

전반적으로 이 논문은 대규모 과학 시뮬레이션을 지리적으로 분산된 슈퍼컴퓨팅 자원에 효율적으로 매핑하는 방법론을 제시하고, 실제 측정치를 통해 그 실현 가능성을 입증한다.

댓글 및 학술 토론

Loading comments...

의견 남기기