보편 지능 테스트의 첫 시도: AI 알고리즘과 인간 비교 분석

** ANYNT 프로젝트가 제안한 보편 지능 테스트 프로토타입을 구현·평가하여, Q‑learning 기반 AI와 인간 피험자를 동일한 척도에서 비교하였다. 실험 결과는 현재 구현이 인간과 AI를 구분하는 데 한계가 있음을 보여주며, 테스트 설계와 난이도 조정, 환경 다양성 확보가 필요함을 제시한다. **

저자: Javier Insa-Cabrera, Jose Hern, ez-Orallo

**

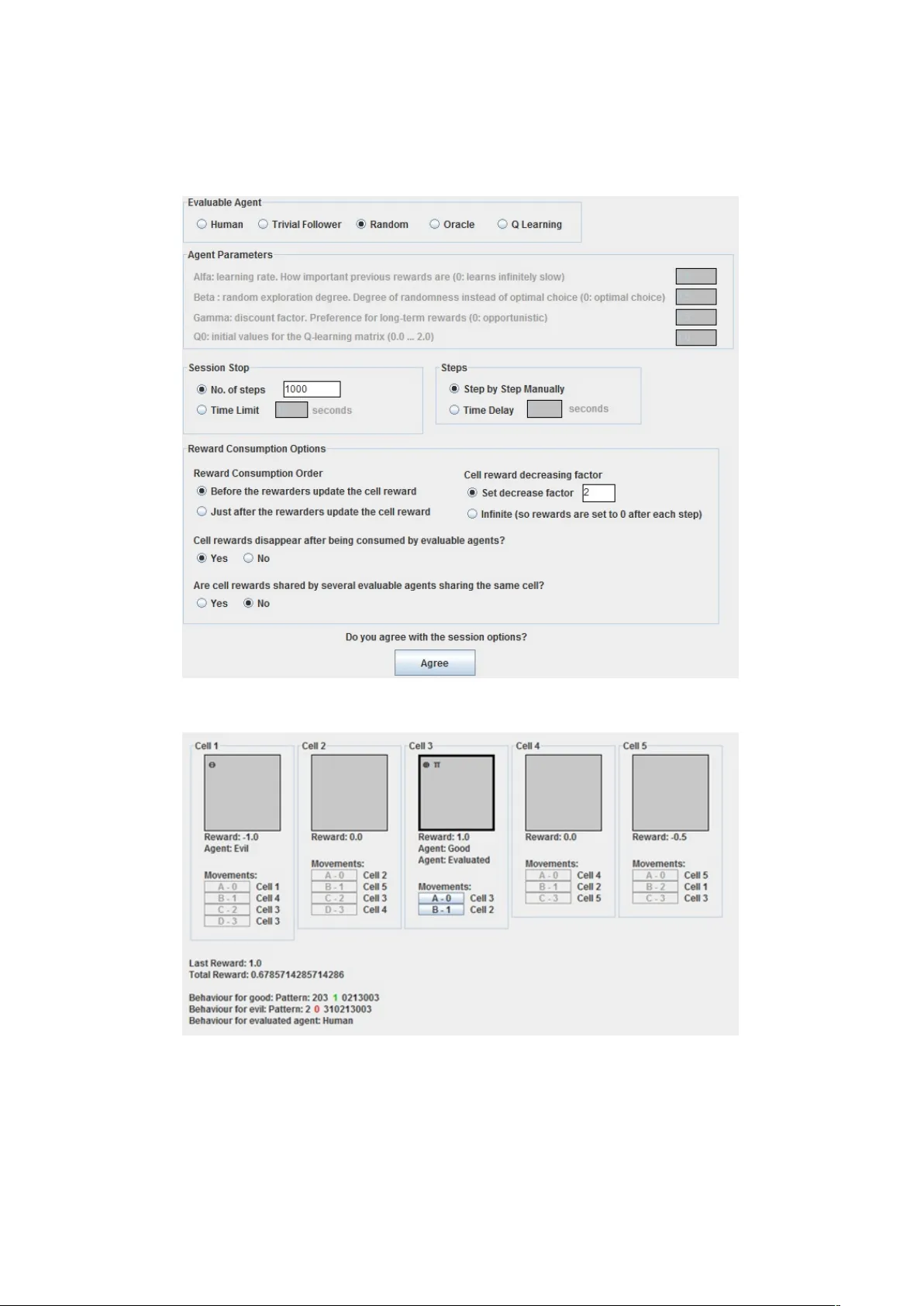

이 논문은 인공지능(AI)과 인간을 포함한 모든 지능형 존재를 동일한 수치 체계로 평가하기 위한 ‘보편 지능 테스트(Universal Intelligence Test, UIT)’의 초기 프로토타입을 설계·구현하고, 이를 통해 얻은 데이터를 분석한다. 기존 AI 평가 방법은 체스, 미로 탐색, 헬리콥터 착륙 등 특정 과업에 초점을 맞추어 일반 지능을 측정하기에 부적합하다는 점을 지적한다. 따라서 ANYNT 프로젝트는 ‘문제 일반성’과 ‘복잡도’를 수학적으로 정의하고, 이를 기반으로 환경 Λ(Lambda) 클래스를 설계한다. Λ는 관찰, 행동, 보상이 명시된 마코프 결정 과정(MDP) 형태이며, Kolmogorov 복잡도와 보상 구조를 변형해 다양한 난이도 레벨을 생성한다.

프레임워크는 두 종류의 피험자를 대상으로 한다. 첫 번째는 Q‑learning 알고리즘을 구현한 AI 에이전트이며, 두 번째는 웹 기반 GUI를 통해 행동을 선택하는 인간 피험자이다. 실험은 동일한 환경 시퀀스를 순차적으로 제시하고, 각 라운드에서 누적 보상을 기록한다. 결과는 다음과 같다. Q‑learning 에이전트는 상태 전이가 단순하고 보상이 선형적인 환경에서는 인간보다 높은 보상을 얻었지만, 상태 공간이 확대되고 보상이 비선형적일수록 급격히 성능이 저하된다. 반면 인간은 전략적 추론과 탐색을 통해 복잡한 환경에서도 일정 수준 이상의 보상을 유지했으며, 학습 곡선이 완만하게 상승한다. 두 집단의 성능 분포는 일부 겹치지만, 현재 테스트 설계는 보상 스케일이 환경마다 다르기 때문에 점수 정규화가 필요하고, 동일한 ‘지능 점수’를 부여하기에 불안정성을 보인다.

논문은 또한 현재 프로토타입의 한계를 상세히 논의한다. 첫째, Λ 환경이 제한된 상태·행동 수와 단순한 보상 구조에 머물러 일반성을 충분히 검증하지 못한다. 둘째, 적응형 난이도 조정을 위한 IRT(항목 반응 이론) 기반 알고리즘이 구현되지 않아 피험자별 맞춤 테스트가 불가능했다. 셋째, 평가 메트릭이 누적 보상에만 국한돼 학습 속도, 정책 복잡도, 탐색 효율성 등 다차원적인 지능 지표가 부족하다. 넷째, ‘사회적 환경’ 실험은 제시했지만 협력·경쟁 메커니즘이 충분히 모델링되지 않아 사회적 지능을 평가하기엔 미흡하다.

결론적으로, 이 연구는 보편 지능 테스트라는 개념을 실제 시스템에 적용해 본 최초 사례이며, 인간과 AI를 동일한 척도에 배치하려는 시도가 아직 초기 단계임을 보여준다. 향후 연구는 (1) 보다 복잡하고 다양한 Λ 환경을 자동 생성하는 알고리즘 개발, (2) IRT 기반 적응형 난이도 조정 구현, (3) 다중 메트릭(학습 효율, 정책 압축도 등) 도입, (4) 다중 에이전트·사회적 상호작용을 포함한 테스트 시나리오 확장 등을 통해 보다 신뢰성 있고 일반화 가능한 보편 지능 점수를 도출하는 방향으로 진행될 필요가 있다.

**

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기