가우시안 커널 명시적 근사와 테일러 피처

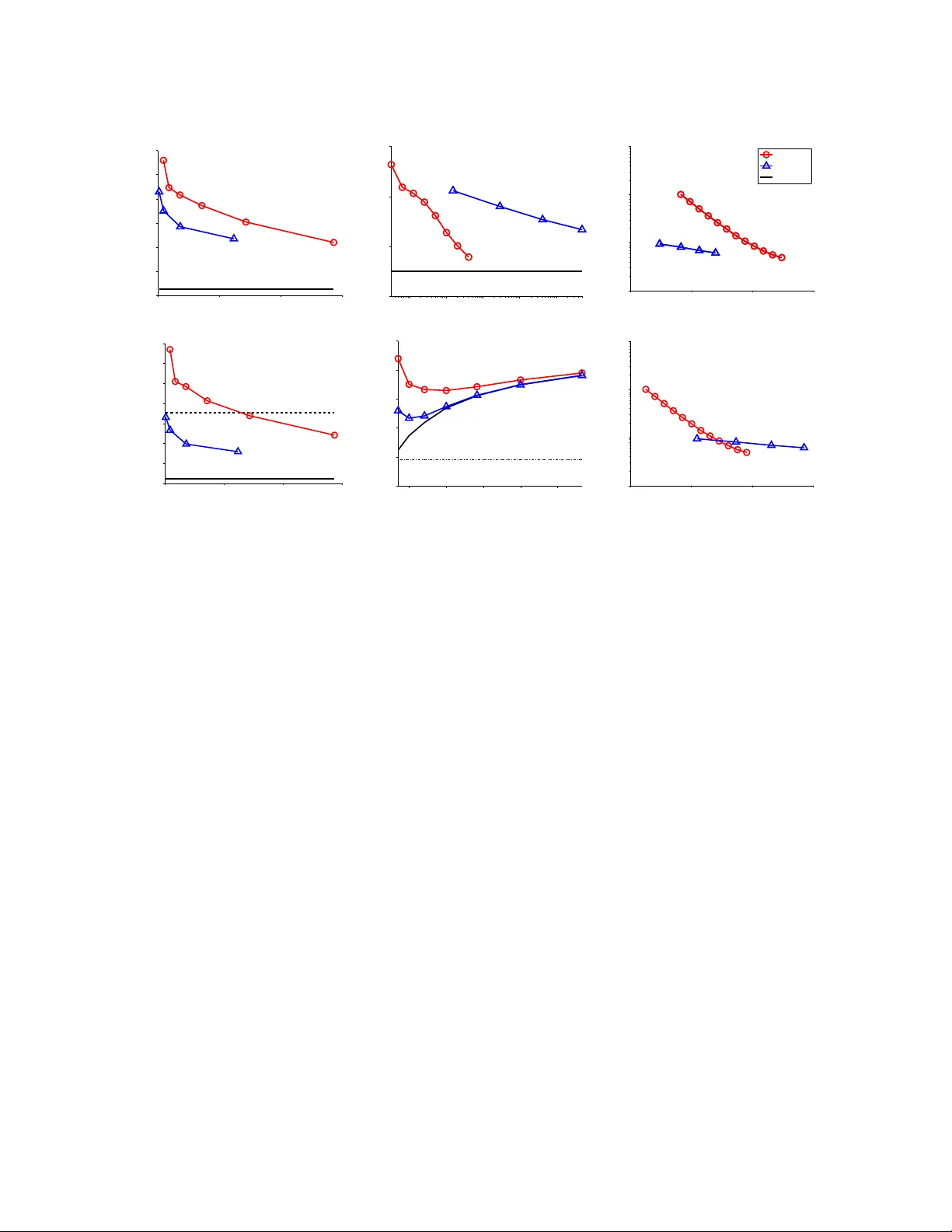

본 논문은 가우시안 커널 SVM을 고차원 다항 특징 공간으로 근사하는 테일러 전개 방식을 제안한다. 랜덤 푸리에 피처와 비교해 차원은 더 많이 필요하지만, 희소 데이터에서 계산 비용이 훨씬 낮아 대규모 온라인 학습에 유리함을 실험과 이론으로 입증한다.

저자: Andrew Cotter, Joseph Keshet, Nathan Srebro

본 논문은 대규모 데이터셋에 적용 가능한 가우시안 커널 서포트 벡터 머신(SVM)의 효율적인 학습 방법을 제시한다. 전통적인 커널 SVM은 커널 트릭을 이용해 고차원 힐버트 공간에서 선형 모델을 학습하지만, 예측 단계에서 전체 훈련 샘플과의 내적을 계산해야 하므로 O(m·d) 연산이 필요하고, 데이터가 수백만 개에 달하면 실용적이지 않다. 최근에는 온라인·확률적 선형 SVM이 등장했지만, 이를 커널에 직접 적용하면 매 반복마다 전체 커널 행을 계산해야 하므로 동일한 병목이 발생한다.

이에 저자들은 커널 함수를 명시적 피처 매핑 ˜φ:ℝ^d→ℝ^D 로 근사함으로써, 선형 SVM 솔버와 결합해 O(D) 연산만으로 예측이 가능하도록 한다. 핵심 아이디어는 가우시안 커널 K(x,x′)=exp(−‖x−x′‖²/2σ²)를 세 부분으로 분해하고, 내부 내적 ⟨x,x′⟩에 대한 테일러 전개를 이용하는 것이다. 구체적으로

K(x,x′)=e^{−‖x‖²/2σ²}·e^{−‖x′‖²/2σ²}·e^{⟨x,x′⟩/σ²}

이며, 마지막 항을 z=⟨x,x′⟩/σ²에 대해 ∑_{k=0}^{∞} z^k/k! 로 전개한다. z^k는 (∑_{i=1}^d x_i x′_i)^k 로 전개될 수 있으며, 이는 차원 d의 좌표에 대한 k차 모노미얼들의 곱으로 표현된다. 따라서 각 (k,j) 조합에 대해 피처

φ_{k,j}(x)=e^{−‖x‖²/2σ²}·(1/σ^k√k!)·∏_{t=1}^k x_{j_t}

를 정의한다. 차수 r까지 절단한 ˜φ는 모든 k≤r에 대한 피처를 포함한다.

이 근사의 오류는 테일러 잔여항에 의해 제어된다. 정리(11)에 따르면

|K(x,x′)−˜K(x,x′)| ≤ (‖x‖·‖x′‖/σ²)^{r+1}/(r+1)! .

따라서 차수 r이 커질수록 오류는 급격히 감소한다. 그러나 피처 수 D는 조합적으로 증가한다. 중복을 제거한 뒤 D= C(d+r,r) 로 계산된다.

특히 입력 벡터가 s개의 비제로 원소만을 갖는 희소 상황을 고려하면, 비제로 피처 수는 O(s^r) 로 제한된다. 각 피처는 입력 원소들의 곱으로 구성되므로, 비제로 원소만을 곱하면 된다. 따라서 전체 계산 비용은 O(s^r) 로, 랜덤 푸리에 피처가 요구하는 O(D·s) 보다 훨씬 효율적이다.

랜덤 푸리에 피처는 Bochner 정리를 이용해 K(x,x′)=E_ω

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기