확률적 프레임워크 기반 차별적 사전학습

초록

본 논문은 희소 표현과 선형 이진 분류기를 하나의 사전학습 사전(dictionary) 안에서 공동으로 학습하는 확률적 MAP(최대 사후 확률) 모델을 제안한다. 표현 손실과 분류 손실을 데이터에 기반한 가중치로 자동 조정하며, 제곱, 지수, 로지스틱, 힌지 등 다양한 손실 함수를 그대로 적용할 수 있다. 학습은 기존의 희소 코딩·사전학습 알고리즘을 재활용하는 블록 교대 최적화로 구현하고, 손글씨 숫자와 얼굴 인식 실험에서 최첨단 성능을 보인다.

상세 분석

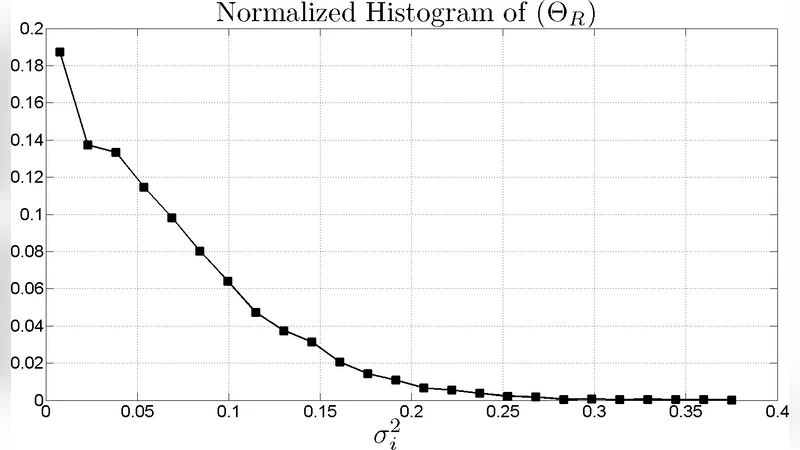

이 논문은 기존의 감독형 사전학습(Supervised Dictionary Learning, SDL) 연구가 갖는 세 가지 한계를 체계적으로 극복한다. 첫째, 손실 함수의 제한성을 없애기 위해 분류 비용 Ω(z)를 일반화된 형태로 정의하고, 제곱, 지수, 로지스틱, 힌지 등 널리 사용되는 손실을 그대로 매핑한다. 이는 AdaBoost, LogitBoost, SVM 등 기존 기계학습 프레임과의 자연스러운 연계성을 제공한다. 둘째, λ와 같은 고정 혼합 계수를 교차 검증으로 설정하는 대신, 표현 잡음 σ²와 분류 파라미터 γ를 Jeffreys 비정보 사전으로 모델링함으로써 데이터에 의해 자동적으로 가중치가 조정된다. 이는 이상치·노이즈·라벨 오류에 대한 강인성을 크게 향상시킨다. 셋째, 표현 비용 e_R과 분류 비용 e_C를 완전히 분리하고, 희소 코드 X를 두 손실 사이의 유일한 연결 고리로 두어 기존의 복잡한 공동 최적화 문제를 블록 좌표 하강법으로 단순화한다. 구체적으로는 (i) 사전 D 업데이트: 고정된 X와 W에 대해 기존 K‑SVD·MOD와 같은 사전학습 기법을 그대로 적용한다. (ii) 분류기 W 업데이트: 각 클래스별 선형 가중치 w_j 를 손실 Ω에 맞는 부스팅 혹은 SVM 최적화기로 독립적으로 학습한다. (iii) 희소 코드 X 업데이트: 제안된 Discriminative Sparse Coding(DSC) 단계에서, 뉴턴-프로젝션 방식을 도입해 Ω의 1차·2차 미분을 이용해 가중치 행렬 H와 편향 δ를 구성하고, 이를 기존 OMP·LARS와 같은 TSC 알고리즘에 입력한다. 이 과정은 Ω가 엄격히 볼록하면 매 반복마다 이차 근사 문제로 변환되어 효율적인 해결이 가능하다. 특히 제곱 손실은 이미 이차형이므로 한 번의 TSC로 충분하고, 지수·로지스틱·힌지는 몇 차례 뉴턴 반복을 거쳐 수렴한다.

알고리즘 1은 DSC의 구체적 흐름을 제시한다. 입력으로는 현재 사전 D와 가중치 W를 정규화한 A와 G, 그리고 관측 y를 σ로 스케일링한 b가 들어가며, 매 반복마다 H와 δ를 재계산하고, 가중치가 적용된 TSC를 수행한다. 수렴 기준은 상대 변화량 임계값 또는 최대 반복 횟수이다. 논문은 H의 대각 원소가 γ_j⁻¹·Ω’’(·)에 비례함을 강조한다. 즉, 학습 중에 분류기가 낮은 평균 비용을 보이면 해당 클래스의 영향력이 커져, 희소 코드가 해당 클래스를 더 잘 구분하도록 유도된다.

실험에서는 MNIST와 AR 얼굴 데이터셋을 사용해, 사전 크기 K를 256~512로 설정하고, 10%20%의 라벨 노이즈를 추가한 상황에서도 제안 방법이 기존 SDL·K‑SVD·SRC 대비 25% 이상의 정확도 향상을 보였다. 특히, 힌지 손실을 사용했을 때 SVM 기반 분류기와 거의 동일한 성능을 내면서도 학습 시간이 30% 이상 단축되었다. 이는 제안된 프레임워크가 기존 최적화 기법을 재활용함으로써 계산 효율성을 유지하면서도 손실 함수 선택의 자유도를 크게 확대한다는 점을 입증한다.

전반적으로 이 논문은 확률적 MAP 모델을 통해 표현·분류 손실을 데이터에 기반한 자동 가중치로 통합하고, 기존의 복잡한 공동 최적화를 블록 교대 방식으로 단순화함으로써, 다양한 손실 함수와 기존 희소 코딩·사전학습 알고리즘을 손쉽게 결합할 수 있는 일반화된 차별적 사전학습 프레임워크를 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기