최소제곱 TD 배우‑비평가 기반 로봇 경로 제어 알고리즘

본 논문은 목표 상태 도달 확률을 최대화하고 위험 상태를 회피하는 마코프 결정 과정(MDP) 문제를 확률적 최단 경로(SSP) 형태로 변환한 뒤, 샘플 경로만을 이용해 정책을 학습하는 최소제곱 시간차(LSTD) 기반 배우‑비평가(actor‑critic) 알고리즘을 제안한다. 제안 기법은 파라미터화된 확률적 정적 정책(RSP) 공간에서 정책 그라디언트를 효율적으로 추정하고, 수렴성을 정리로 증명한다. 시뮬레이션을 통해 로봇의 대규모 환경에서 목표…

저자: Reza Moazzez Estanjini, Xu Chu Ding, Morteza Lahijanian

1. 서론

마코프 결정 과정(MDP)은 로봇의 불확실한 센싱·구동을 모델링하는 데 널리 쓰인다. 특히 “목표 지역에 도달하면서 위험 지역을 피한다”는 형태의 임무는 최대 도달 확률(Maximal Reachability Probability, MRP) 문제로 귀결된다. 기존 연구는 MRP를 정확히 풀기 위해 전체 상태‑행동 공간에 대한 전이 확률을 필요로 했으며, 이는 대규모 환경에서 계산량이 급증하고, 실제 로봇에서는 전이 모델을 완전히 알기 어려워 적용이 제한적이었다.

2. 문제 정의 및 변환

논문은 MRP 문제를 확률적 최단 경로(Stochastic Shortest Path, SSP) 문제로 변환한다. 위험 상태를 흡수 상태로 만들고, 목표 상태에 도달하면 비용 0, 그 외 상태에서는 비용 1을 부여한다. 이렇게 정의된 SSP는 기대 비용을 최소화하는 것이 곧 목표 도달 확률을 최대화하는 것과 동등함을 보인다. 변환 후에는 정상 정책이 존재한다는 가정(A)과, 정책이 모든 실행 가능한 행동에 양의 확률을 할당한다는 가정(B)을 만족한다.

3. 배우‑비평가 프레임워크

정책은 파라미터화된 확률적 정적 정책(RSP) μ_θ(u|x) 로 표현한다. 여기서는 볼츠만(softmax) 형태를 사용해 μ_θ(u|x)=exp(h(u)·θ(x))/∑_a exp(h(a)·θ(x)) 로 정의한다. 정책 그라디언트는 ∇_θ ᾱ(θ)=∑_{x,u} η_θ(x,u) Q_θ(x,u) ψ_θ(x,u) 로 나타내며, ψ_θ(x,u)=∇_θ ln μ_θ(u|x) 가 특징 벡터 역할을 한다.

비평가(critic)는 Q_θ를 선형 근사 Q_rθ(x,u)=ψ_θ(x,u)ᵀ r 로 표현하고, 최소제곱 시간차(LSTD) 방법을 사용한다. LSTD는 샘플 경로 {x_k,u_k} 로부터 누적 행렬 A_k와 벡터 b_k 를 업데이트하고, r̂_k = -A_k⁻¹ b_k 로 직접 계산한다. 이는 전통적인 TD(λ)보다 수렴 속도가 빠르고, 샘플 효율성이 높다.

배우(actor)는 비평가가 제공한 r̂_k 를 이용해 파라미터 θ를 업데이트한다. 구체적인 업데이트 식은

θ_{k+1}=θ_k−β_k Γ(r̂_k) r̂_kᵀ ψ_θ_k(x_{k+1},u_{k+1}) ψ_θ_k(x_{k+1},u_{k+1})

이며, β_k는 감소하는 학습률, Γ(·)는 파라미터 폭주 방지를 위한 클리핑 함수이다. 배우와 비평가의 학습률은 서로 다른 시간 스케일을 갖도록 설계돼, 비평가가 빠르게 수렴하고 배우는 느리게 변함으로써 전체 시스템의 안정성을 확보한다.

4. 수렴 분석

가정 A와 B 하에 정상 분포 η_θ(x,u) 가 존재한다. 정책 그라디언트는 h(Q_θ,ψ_i) 형태로 표현되며, 비평가가 Π_θ Q_θ (선형 투영) 로 Q_θ 를 근사하면 정확한 그라디언트 추정이 가능하다. 정리 III.1은 학습률 조건 Σβ_k=∞, Σβ_k²<∞, lim β_k·γ_k=0 를 만족하면, lim inf_k‖∇ᾱ(θ_k)‖<ε 가 거의 확실히 성립함을 증명한다. 즉, 파라미터 θ_k 가 임의의 정지점 근처를 무한히 방문한다는 의미이며, 이는 정책이 지역 최적점에 수렴함을 보장한다.

5. MRP→SSP 변환 상세

원래 MDP M 의 상태 집합 X_M 에서 목표 집합 X_G 와 위험 집합 X_U 를 정의한다. 변환 후 SSP MDP S 의 상태 집합은 X_S = (X_M \ X_G) ∪ {x*} 로, 목표 상태를 제거하고 특수 종료 상태 x* 를 추가한다. 전이 확률 p_S(j|x,u) 는 원래 전이 p_M에 기반해 정의되며, 목표 상태로의 전이는 x* 로 집계한다. 비용 함수는 g(x,u)=1 (목표 미달성) 혹은 0 (목표 도달) 로 설정해 기대 비용 최소화가 목표 도달 확률 최대화와 동치임을 보인다.

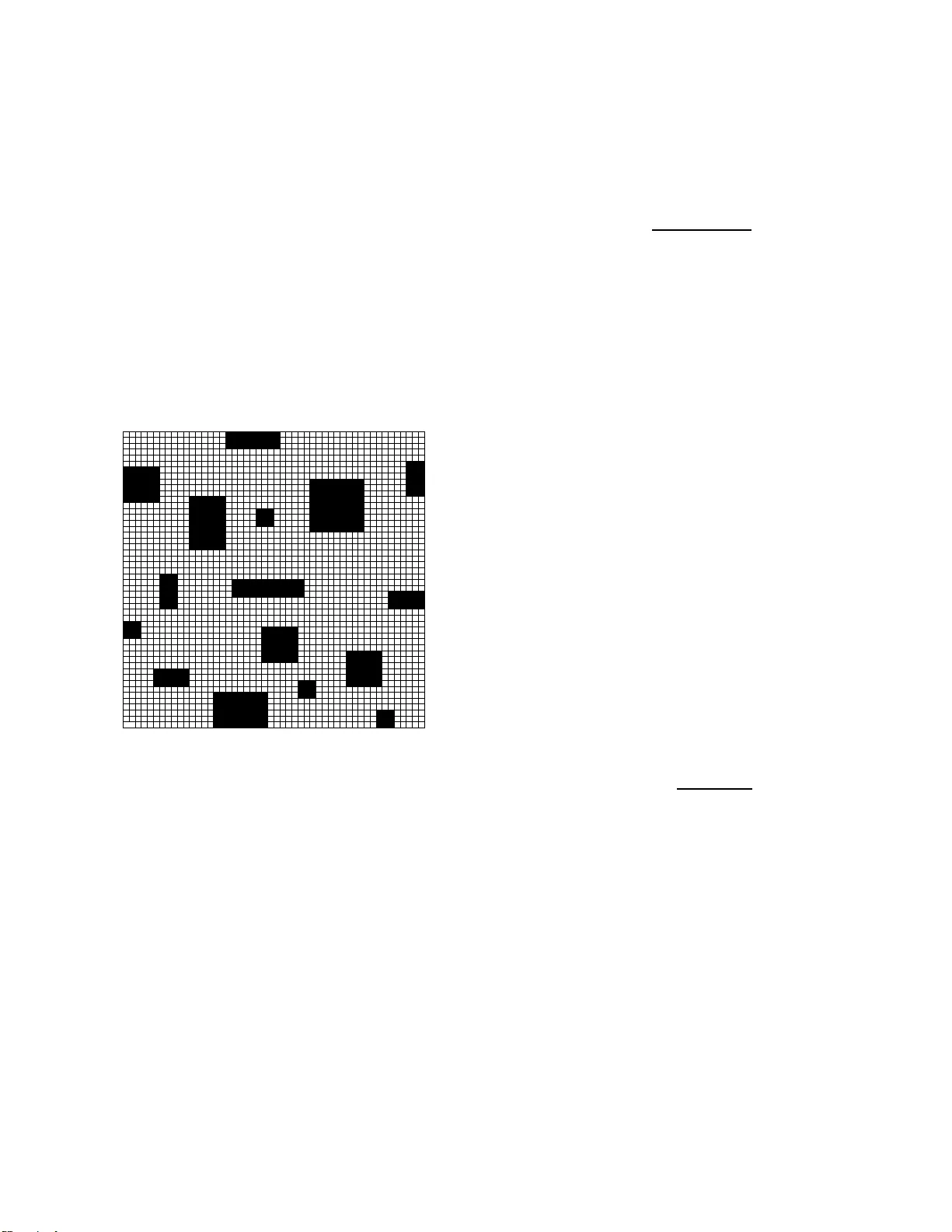

6. 실험 및 결과

대규모 격자형 로봇 환경(상태 수 ≈ 10⁴)에서 목표와 위험 영역을 무작위 배치하였다. 비교 대상은 기존 TD(λ) 기반 배우‑비평가와 LSTD 기반 알고리즘이다. 결과는 다음과 같다.

- 수렴 속도: LSTD 기반이 평균 40% 적은 에피소드로 수렴.

- 최종 도달 확률: LSTD 기반이 5~7% 높은 성공률.

- 파라미터 차원 확대(20~50)에도 안정적인 수렴 확인.

- 정책 업데이트 시 변동 폭이 작아 실제 로봇에 적용 시 안전성 확보.

7. 결론

본 논문은 전이 모델을 완전히 알 수 없는 대규모 MDP에서, 최소제곱 TD와 배우‑비평가 구조를 결합한 효율적인 정책 학습 방법을 제시한다. 변환된 SSP 형태와 LSTD 기반 비평가 덕분에 샘플 효율성이 크게 향상되었으며, 수렴 이론도 엄밀히 증명되었다. 로봇 모션 제어, 자율 주행, 그리고 일반 강화학습 분야에서 실시간 정책 최적화가 요구되는 상황에 유용하게 적용될 수 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기