적응형 채널 추천을 통한 기회 스펙트럼 접근

초록

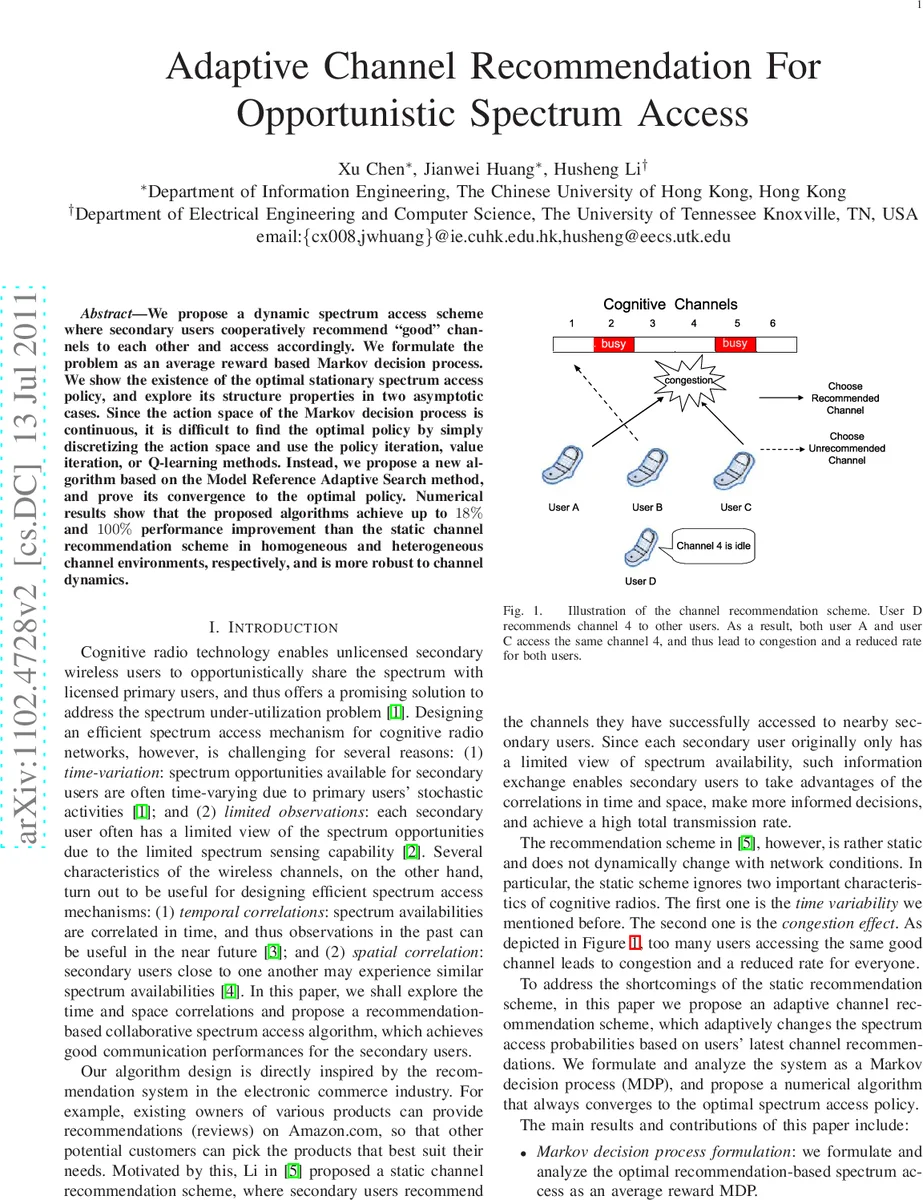

본 논문은 2차 사용자들이 서로 “좋은” 채널을 추천하고, 이를 기반으로 동적으로 접근 확률을 조정하는 기회 스펙트럼 접근 방식을 제안한다. 시스템을 평균 보상 마코프 결정 과정(MDP)으로 모델링하고, 연속 행동 공간에서도 최적의 정적 정책이 존재함을 증명한다. 또한 두 극한 상황(사용자 수·채널 수 무한)에서 정책 구조를 분석하고, 연속 행동 공간 탐색에 적합한 Model Reference Adaptive Search(MRAS) 알고리즘을 설계·수렴을 보인다. 시뮬레이션 결과, 제안 알고리즘은 정적 추천 방식에 비해 동질 환경에서 최대 18%, 이질 환경에서 최대 100%의 성능 향상을 달성하며, 채널 동적 변화에도 강인함을 보인다.

상세 분석

이 논문은 인지 라디오 환경에서 2차 사용자가 제한된 센싱 정보와 시간‑공간 상관성을 활용해 효율적인 스펙트럼 접근을 달성하고자 한다. 기존 정적 채널 추천 방식은 고정된 브랜칭 확률 (P_{rec}) 을 사용해 추천 채널에 과도하게 몰리게 함으로써 혼잡을 초래한다. 저자는 이를 해결하기 위해 매 슬롯마다 최신 추천 정보를 기반으로 (P_{rec})를 동적으로 조정하는 적응형 스킴을 고안한다. 시스템을 평균 보상 MDP로 정의하고, 상태를 “추천된 채널 수 (R)”로, 행동을 연속 변수 (P_{rec}\in(0,1)) 로 설정한다. 연속 행동 공간 때문에 전통적인 정책 반복이나 Q‑학습이 비효율적인데, 저자는 Model Reference Adaptive Search(MRAS)라는 확률적 탐색 기법을 적용한다. MRAS는 후보 정책 집합을 점진적으로 축소하면서 목표 보상에 가까운 정책을 샘플링하고, 수렴성을 라그랑주 승수와 Kullback‑Leibler 발산을 이용해 이론적으로 증명한다. 또한, 사용자가 무한히 많거나 채널 수가 무한히 많을 때 최적 정책이 “추천 채널 수와 동일한 비율로 접근”하거나 “전체 채널을 균등하게 탐색”하는 형태로 단순화되는 구조적 특성을 밝혀, 정책 구현의 복잡성을 크게 낮춘다. 수치 실험에서는 동질 채널 환경에서 평균 처리량이 18% 향상되고, 이질 환경에서는 정적 방식 대비 두 배에 달하는 성능 개선을 보이며, 채널 전이 확률 (p,q) 가 크게 변할 때도 안정적인 수렴을 확인한다. 이러한 결과는 연속 행동 MDP에 대한 효율적인 최적화 방법론을 제시함과 동시에, 실제 인지 라디오 네트워크에서 협업적 추천 메커니즘이 어떻게 혼잡을 완화하고 스펙트럼 활용도를 극대화할 수 있는지를 실증한다.

댓글 및 학술 토론

Loading comments...

의견 남기기