이중 강인 정책 평가와 학습

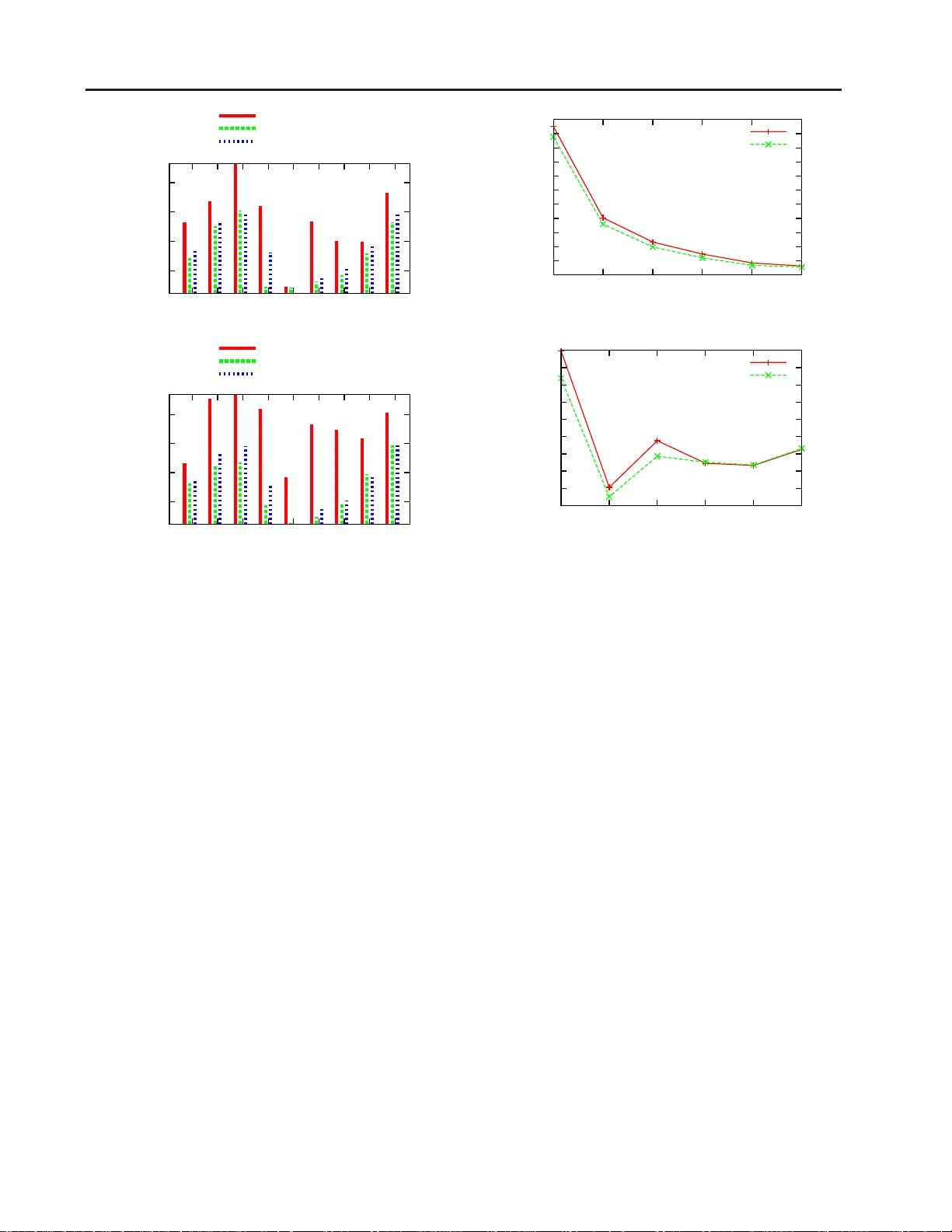

본 논문은 컨텍스트 밴딧 환경에서 과거 로그 데이터를 이용해 새로운 정책의 가치를 평가하고 최적화하는 방법으로, 보상 모델과 행동 로그 모델 중 하나만이라도 충분히 정확하면 편향을 최소화하고 분산을 억제하는 ‘이중 강인(doubly robust)’ 추정기를 제안한다. 이 방법은 기존의 직접 모델링(보상 예측)과 중요도 가중치(행동 로그) 방식의 장점을 결합해, 이론적 보증과 실험을 통해 전반적인 성능 향상을 입증한다.

저자: Miroslav Dudik, John Langford, Lihong Li

컨텍스트 밴딧(contextual bandit) 문제는 각 라운드마다 관찰 가능한 컨텍스트 x 와 선택 가능한 행동 집합 A 가 주어지고, 선택된 행동 a 에 대해서만 보상 r 이 관측되는 상황을 말한다. 이러한 설정은 온라인 광고, 의료 처방, 추천 시스템 등 실제 서비스에서 흔히 나타난다. 핵심 과제는 과거 로그 데이터 \(\{(x_i,a_i,r_i)\}_{i=1}^n\) 를 이용해 새로운 정책 π (예: 광고 노출 전략)의 기대 보상 \(V(π)=\mathbb{E}

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기