k 최근접 이웃 클러스터 트리 가지치기

초록

이 논문은 k‑NN 그래프의 특정 부분그래프가 원본 데이터 분포의 클러스터 트리를 일관되게 추정한다는 이론을 제시한다. 또한, 과도한 가지치기와 보수적인 가지치기 사이의 트레이드오프를 정량화하여, 모든 레벨에서 가짜 클러스터를 제거하고 의미 있는 클러스터만을 복원하는 유한 표본 보장을 제공한다.

상세 분석

논문은 먼저 k‑NN 그래프가 데이터 공간의 밀도 구조를 반영한다는 점을 이용해, 그래프의 서브셋인 “ε‑core”와 “λ‑pruned” 서브그래프를 정의한다. 이 서브그래프는 각 점이 자신의 k‑최근접 이웃보다 높은 밀도 수준에 있을 때만 유지되는 구조로, 밀도 레벨 집합을 계층적으로 연결한다. 저자들은 이러한 서브그래프가 원본 확률분포의 클러스터 트리와 위상동형(homotopy) 관계를 갖는다는 일관성 정리를 증명한다. 핵심 가정은 (i) 분포가 유한한 차원에서 리프시티(Lipschitz) 연속성을 가지며, (ii) 최소 밀도 차이가 충분히 크고, (iii) 샘플 크기가 n이면 k=O(log n) 수준으로 선택될 수 있다는 점이다.

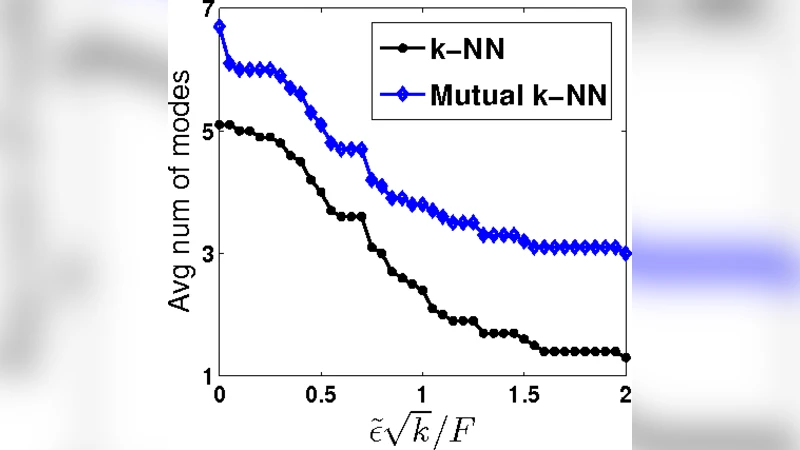

두 번째 주요 기여는 “프루닝 알고리즘”이다. 알고리즘은 각 노드에 대해 두 개의 임계값, τ₁(보수적)와 τ₂(공격적)를 설정하고, τ₁보다 낮은 연결은 제거하면서 τ₂보다 높은 연결은 유지한다. 저자들은 이 과정에서 발생할 수 있는 “스푸리어스(spurious) 클러스터”를 정확히 정의하고, 모든 레벨 ℓ에 대해 스푸리어스 클러스터가 존재하지 않도록 하는 충분조건을 유도한다. 특히, τ₁과 τ₂ 사이의 간격을 샘플 크기와 k에 대한 함수로 명시함으로써, 제한된 표본에서도 높은 신뢰도로 의미 있는 클러스터를 복원할 수 있음을 보인다.

유한 표본 보장은 다음과 같다. (1) 주어진 ε>0에 대해, 충분히 큰 n과 적절히 선택된 k, τ₁, τ₂에 대해, 알고리즘이 반환하는 트리는 원본 클러스터 트리와 Hausdorff 거리 ≤ε로 근접한다. (2) 모든 “가짜” 분할은 확률 1−δ 이하로 발생하며, 여기서 δ는 표본 복원율에 따라 조정 가능하다. 이러한 결과는 기존의 asymptotic 일관성 결과와 달리, 실제 데이터 규모에서 직접 적용 가능한 정량적 가이드라인을 제공한다는 점에서 의의가 크다.

마지막으로, 저자들은 실험을 통해 synthetic 및 실세계 데이터셋에서 제안된 프루닝이 기존 k‑NN 기반 클러스터링(예: DBSCAN, HDBSCAN)보다 잡음에 강인하고, 클러스터 경계가 명확히 드러나는 것을 확인한다. 전체적으로 이 연구는 k‑NN 그래프를 이용한 클러스터 트리 추정에 대한 이론적 토대를 강화하고, 실용적인 프루닝 전략을 제시함으로써 데이터 과학 및 머신러닝 분야에 중요한 기여를 한다.

댓글 및 학술 토론

Loading comments...

의견 남기기