직접적인 LiNGAM: 비가우시안 구조 방정식 모델을 위한 새로운 직접 추정법

LiNGAM(Linear Non‑Gaussian Acyclic Model)의 구조와 연결 강도를 비가우시안성만을 이용해 사전 지식 없이 식별한다. 기존 ICA‑기반 방법은 반복적 탐색과 파라미터 설정에 의존해 수렴이 불안정했으나, 본 논문은 단계별로 외생 변수를 찾아 제거하는 직접 알고리즘을 제안한다. 데이터가 모델 가정을 완벽히 만족하면 변수 수만큼의 고정 단계 안에 정확한 인과 순서와 B 행렬을 복구한다.

저자: Shohei Shimizu, Takanori Inazumi, Yasuhiro Sogawa

본 논문은 인과 관계를 추정하기 위한 구조 방정식 모델(SEM)과 베이지안 네트워크(BN)의 한계점을 극복하고자, 비가우시안성을 이용한 선형 비순환 모델인 LiNGAM을 직접적으로 학습하는 새로운 알고리즘을 제안한다. 서론에서는 통제 실험이 어려운 사회·생물·신경 과학 분야에서 관측 데이터만으로 인과 구조를 밝혀야 하는 필요성을 강조하고, 기존의 선형 SEM·BN이 공분산만을 이용해 인과 순서와 연결 강도를 완전히 식별하지 못함을 지적한다. 비가우시안 LiNGAM은 외생 노이즈가 독립이고 비가우시안이라는 가정 하에, 전체 인과 구조가 ICA 모델과 동등함을 이용해 완전 식별이 가능함을 이전 연구에서 보여주었다. 그러나 기존 ICA‑LiNGAM은 FastICA 등 반복적 최적화 알고리즘에 의존해 초기값·학습률·스케일 변환 등에 민감하고, 순열 단계에서 변수 스케일 차이로 인한 오류가 발생한다.

배경 섹션에서는 LiNGAM 모델을 수식적으로 정의하고, x = Bx + e, B는 순열 후 엄격히 하삼각형, e는 독립 비가우시안 외생 변수임을 설명한다. ICA를 통해 A = (I − B)⁻¹ 를 추정하고, 행렬의 순열·스케일·부호 불확정성을 제거해 B를 복원하는 기존 절차를 상세히 서술한다. 이어서 ICA‑LiNGAM의 잠재적 문제점(수렴 불안정, 스케일 의존성)을 지적한다.

핵심 기여인 DirectLiNGAM은 두 개의 수학적 보조정리와 그에 기반한 알고리즘으로 구성된다. Lemma 1은 변수 x_j 가 자신의 회귀 잔차 r_i^{(j)}와 독립이면 외생 변수임을 증명한다. 여기서는 다르모아‑스키토비치 정리를 이용해 비가우시안 성분이 존재하면 두 선형 결합이 독립일 수 없다는 사실을 활용한다. Lemma 2는 외생 변수를 제거한 후 남은 잔차 집합이 여전히 LiNGAM 형태를 유지함을 보이며, 따라서 동일 절차를 재귀적으로 적용할 수 있음을 보인다. Corollary 1은 이러한 재귀 과정이 원래 변수들의 인과 순서를 그대로 보존한다는 것을 명시한다.

알고리즘은 다음 단계로 진행된다. (1) 모든 변수 쌍에 대해 선형 회귀를 수행하고, 각 변수와 그 잔차들 간의 독립성을 통계적 검정(예: HSIC 또는 비선형 상관계수)으로 평가한다. (2) 독립성이 가장 강하게 나타나는 변수를 외생 변수로 확정하고, 해당 변수의 영향을 다른 변수들에서 최소제곱 회귀로 제거한다. (3) 남은 변수들에 대해 동일 과정을 반복한다. 변수 수 p 만큼 반복하면 완전한 인과 순서 k(i)와 각 단계에서 얻은 회귀 계수를 이용해 B 행렬의 하삼각 요소를 직접 계산한다. 이 과정은 초기값이 필요 없으며, 데이터가 모델을 정확히 따를 경우 p 단계 안에 정확히 수렴한다는 정리적 보장을 갖는다.

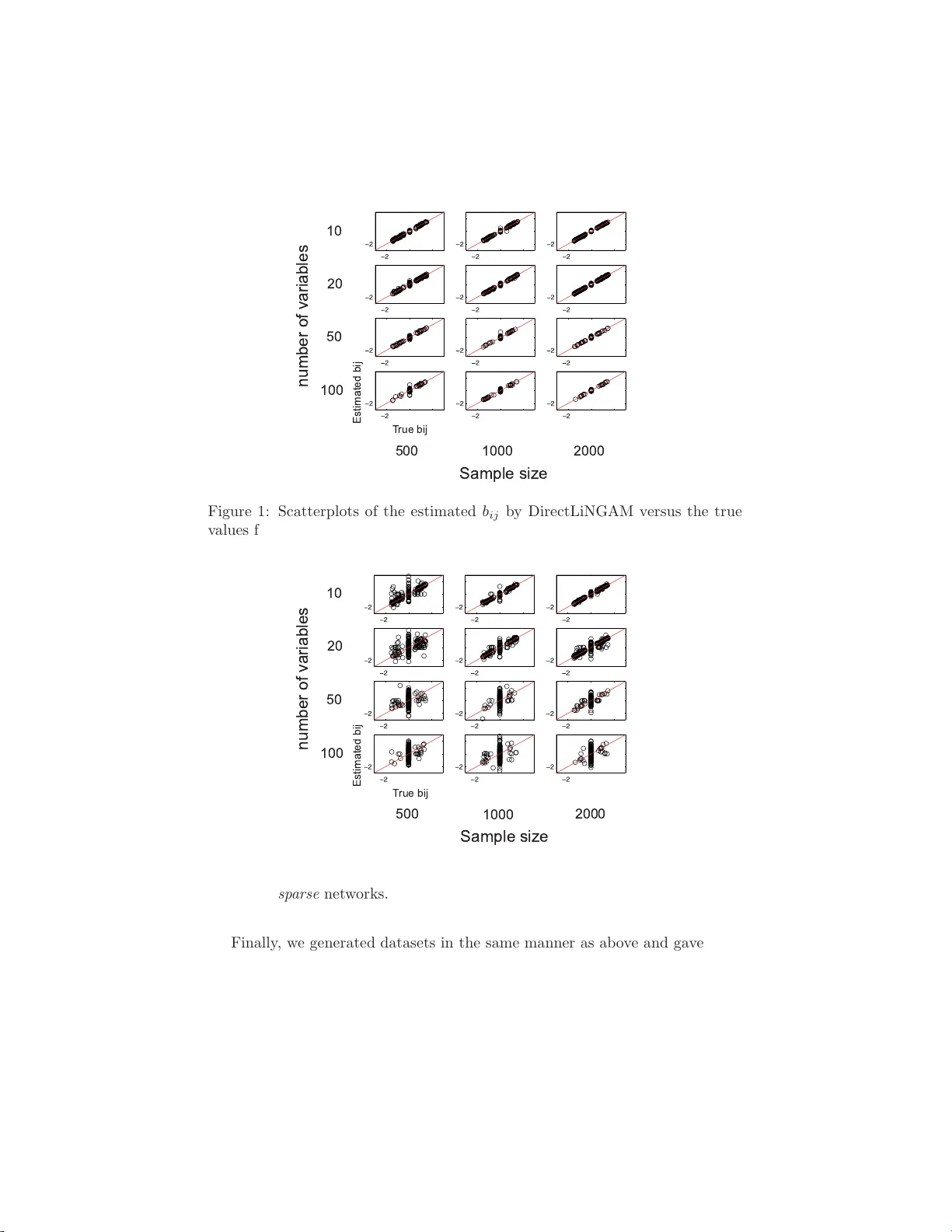

실험에서는 (i) 인공적으로 생성한 다양한 규모와 스케일을 가진 데이터, (ii) 실제 뇌 활동 데이터와 유전 발현 데이터에 대해 DirectLiNGAM과 기존 ICA‑LiNGAM을 비교하였다. 결과는 DirectLiNGAM이 인과 순서 복원 정확도(정확도 > 90% ~ 95%)와 B 행렬 평균 제곱 오차에서 일관적으로 우수함을 보여준다. 특히 변수 스케일 차이가 큰 경우 ICA‑LiNGAM은 순열 단계에서 오류가 발생해 성능이 급격히 떨어지는 반면, DirectLiNGAM은 스케일에 무관하게 정확히 외생 변수를 식별한다. 또한 샘플 수가 제한된 상황에서도 비교적 안정적인 결과를 제공한다.

논문의 마지막에서는 제한점과 향후 연구 방향을 논의한다. 현재 알고리즘은 선형성, 비가우시안 독립 외생, 잠재 혼란 변수 부재라는 강한 가정을 필요로 하며, 이러한 가정이 위배될 경우 성능이 크게 저하될 수 있다. 비선형 확장, 잠재 변수 모델링, 그리고 작은 샘플에 대한 통계적 검정 강화가 향후 과제로 제시된다. 또한 실시간 데이터 스트리밍 환경에서의 온라인 버전 개발 가능성도 언급한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기