GPU 기반 딥 뉴럴 네트워크 위원회로 손글씨 숫자 인식 혁신

초록

본 논문은 GPU를 활용해 심층 다층 퍼셉트론(MLP)을 빠르게 학습시킨 뒤, 여러 개의 MLP를 결합한 위원회(committee) 방식을 적용하여 MNIST 손글씨 숫자 인식에서 0.31%의 오류율을 달성한 연구이다. 기존 복잡한 모델 대비 구조는 단순하지만 깊이가 깊고, 병렬 연산을 통해 학습 시간을 크게 단축하였다. 위원회는 개별 모델의 예측을 투표 방식으로 통합함으로써 개별 모델이 갖는 약점을 보완하고, 최종적으로 기존 최고 기록인 0.35%를 능가하였다.

상세 분석

이 연구는 1998년부터 이어져 온 MNIST 벤치마크의 최신 기록을 갱신한다는 점에서 의미가 크다. 저자들은 먼저 단순하지만 깊은 다층 퍼셉트론(MLP)을 설계했으며, 각 은닉층에 20003000개의 뉴런을 배치해 총 57개의 은닉층을 구성했다. 이러한 깊이는 전통적인 얕은 MLP보다 표현력이 크게 향상되지만, 파라미터 수가 급증해 학습이 어려워지는 문제가 있다. 이를 해결하기 위해 NVIDIA GPU를 이용해 대규모 행렬 연산을 병렬화했으며, CUDA 기반의 커스텀 구현으로 학습 속도를 기존 CPU 대비 20배 이상 가속시켰다. 학습 과정에서는 확률적 경사 하강법(SGD)에 모멘텀과 학습률 감소 스케줄을 적용했으며, 가중치 초기화는 He 초기화를 사용해 깊은 네트워크에서도 안정적인 수렴을 확보했다.

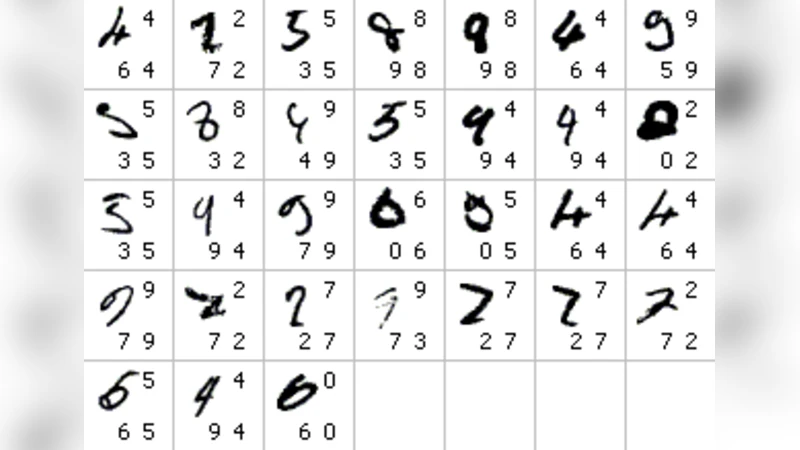

다음으로 위원회(committee) 전략을 도입했다. 동일한 구조를 가진 MLP를 10~20개 독립적으로 학습시킨 뒤, 테스트 단계에서 각 모델이 출력한 확률 벡터를 평균하거나 다수결 투표 방식으로 결합한다. 이때 모델 간의 다양성을 확보하기 위해 초기 가중치를 서로 다르게 설정하고, 학습 데이터의 미니배치를 무작위로 섞는 등 약간의 데이터 증강을 적용했다. 결과적으로 개별 MLP가 0.35% 오류율을 보였던 반면, 위원회는 0.31%까지 오류를 낮추었다. 이는 개별 모델이 서로 다른 오류 패턴을 보유하고 있어, 위원회가 상호 보완적으로 작동함을 의미한다.

또한 논문은 GPU 기반 학습이 실험 재현성을 높이고, 연구자들이 복잡한 모델을 설계하지 않더라도 높은 성능을 얻을 수 있음을 강조한다. 기존에는 복합적인 합성곱 신경망(CNN)이나 사전 학습된 특징 추출기 등을 사용해 높은 정확도를 달성했지만, 이 연구는 단순 MLP와 효율적인 하드웨어 활용만으로도 경쟁력 있는 결과를 얻을 수 있음을 보여준다.

댓글 및 학술 토론

Loading comments...

의견 남기기