다중 커널 학습의 Lp‑노름 로컬 라데마허 복잡도 분석

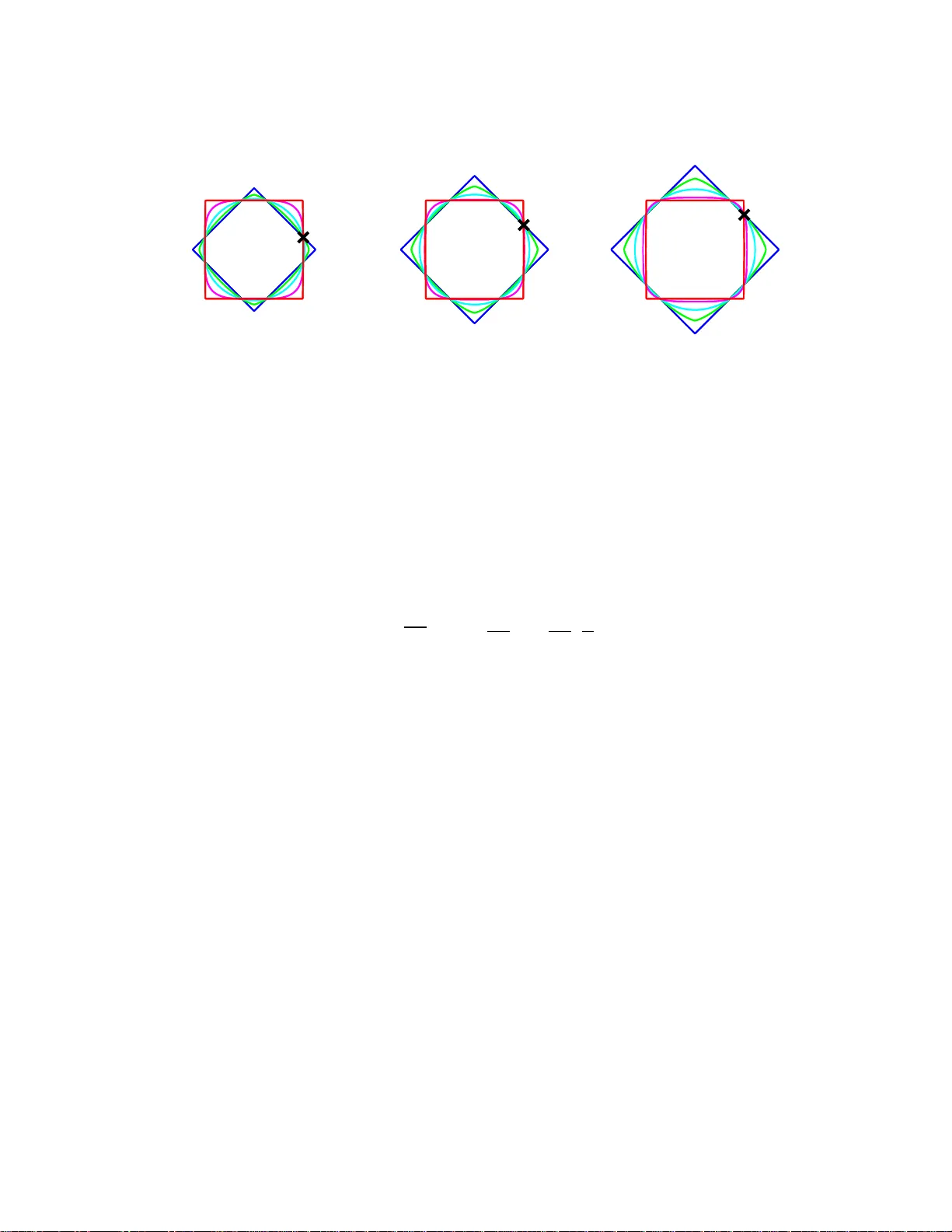

본 논문은 ℓₚ‑노름을 적용한 다중 커널 학습(MKL)의 로컬 라데마허 복잡도에 대한 상한을 제시한다. 기존 연구가 p=1 경우에만 다루던 것과 달리, 1 ≤ p ≤ ∞ 전 범위에 대해 비상관(feature) 가정 하에 일반화하였다. 또한 하한을 통해 제시된 상한이 최적임을 증명하고, 최소 고유값 감쇠율 α에 기반한 빠른 수렴률 O(n^{‑α/(1+α)})을 얻는다.

저자: Marius Kloft, Gilles Blanchard

본 논문은 다중 커널 학습(Multiple Kernel Learning, MKL) 분야에서 ℓₚ‑노름 정규화를 적용한 모델의 일반화 성능을 보다 정밀하게 평가하기 위해, 로컬 라데마허 복잡도(local Rademacher complexity)를 이용한 새로운 이론적 프레임워크를 제시한다. 연구의 동기는 기존의 전역 복잡도 기반 위험 경계가 지나치게 보수적이며, 특히 ℓ₁‑정규화(스파스) 상황에만 적용 가능한 로컬 분석이 한계가 있다는 점에 있다. 저자들은 이러한 한계를 극복하고, p가 1부터 ∞까지 모든 값에 대해 일관된 분석을 제공함으로써, MKL 모델 설계 시 ℓₚ‑노름 선택에 대한 이론적 근거를 마련하고자 한다.

### 1. 문제 설정 및 가정

- **다중 커널 모델**: M개의 커널 K₁,…,K_M 각각에 대응하는 특징 매핑 φ_m: X → ℋ_m (Hilbert space) 를 고려한다. 최종 예측 함수는 f(x)=∑_{m=1}^M ⟨β_m, φ_m(x)⟩ 로 표현되며, β_m∈ℋ_m 이다.

- **ℓₚ‑노름 제약**: 가중치 벡터 β=(β₁,…,β_M)에 대해 ‖β‖ₚ ≤ 1 (또는 λ·‖β‖ₚ) 로 정규화한다. p∈

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기