분산 클라우드 기반 데이터 집약형 고에너지 물리 분석

본 논문은 캐나다와 미국에 구축된 IaaS형 클라우드 인프라를 활용해, 대용량 고에너지 물리 실험 데이터(총 4 TB 이상)를 원격에서 스트리밍하며 분석하는 시스템을 설계·구현하고, 100여 개의 동시 작업을 안정적으로 수행함을 실증한다. 사용자 VM을 사전 준비하고 중앙 스케줄러에 작업을 제출하면, Cloud Scheduler가 필요 VM을 자동으로 부팅·배치하고 작업이 끝나면 VM을 회수한다. 데이터는 중앙 Lustre 파일시스템에 저장되고…

저자: R.J. Sobie, A.Agarwal, M.Anderson

본 논문은 고에너지 물리학 실험 데이터 분석에 클라우드 기반 고성능 컴퓨팅을 적용한 사례 연구이다. 연구팀은 캐나다 국립연구소(NRC)와 빅토리아 대학교(UVIC) 두 곳의 과학 클라우드, 그리고 미국 아마존 EC2 인스턴스를 포함한 총 110개의 VM 슬롯을 보유한 IaaS 환경을 구축하였다. 데이터는 UVIC에 위치한 8.7 TB 규모의 Lustre 파일시스템에 저장되어 있으며, Xrootd 서비스를 통해 원격 노드가 바이트 단위로 접근한다. 사용자 애플리케이션은 BaBar 실험용 C++/FORTRAN 코드와 분석 스크립트를 포함한 16 GB VM 이미지에 탑재된다.

사용자는 먼저 표준 VM 이미지를 복제하고, 자신의 분석 코드를 추가·컴파일한 뒤 이미지 레포지토리에 저장한다. 작업 스크립트는 Condor 스케줄러에 제출되며, 여기에는 필요한 VM 이미지의 URL과 자원 요구 사항이 명시된다. Cloud Scheduler는 작업 큐를 모니터링하면서 아직 부팅되지 않은 VM이 필요하면 Nimbus 혹은 EC2 API를 호출해 해당 클라우드에 VM을 시작한다. VM이 가동되면 Condor가 작업을 할당하고, 작업이 완료되면 출력 파일을 지정된 저장소로 전송한다. 필요 없는 VM은 자동으로 종료된다.

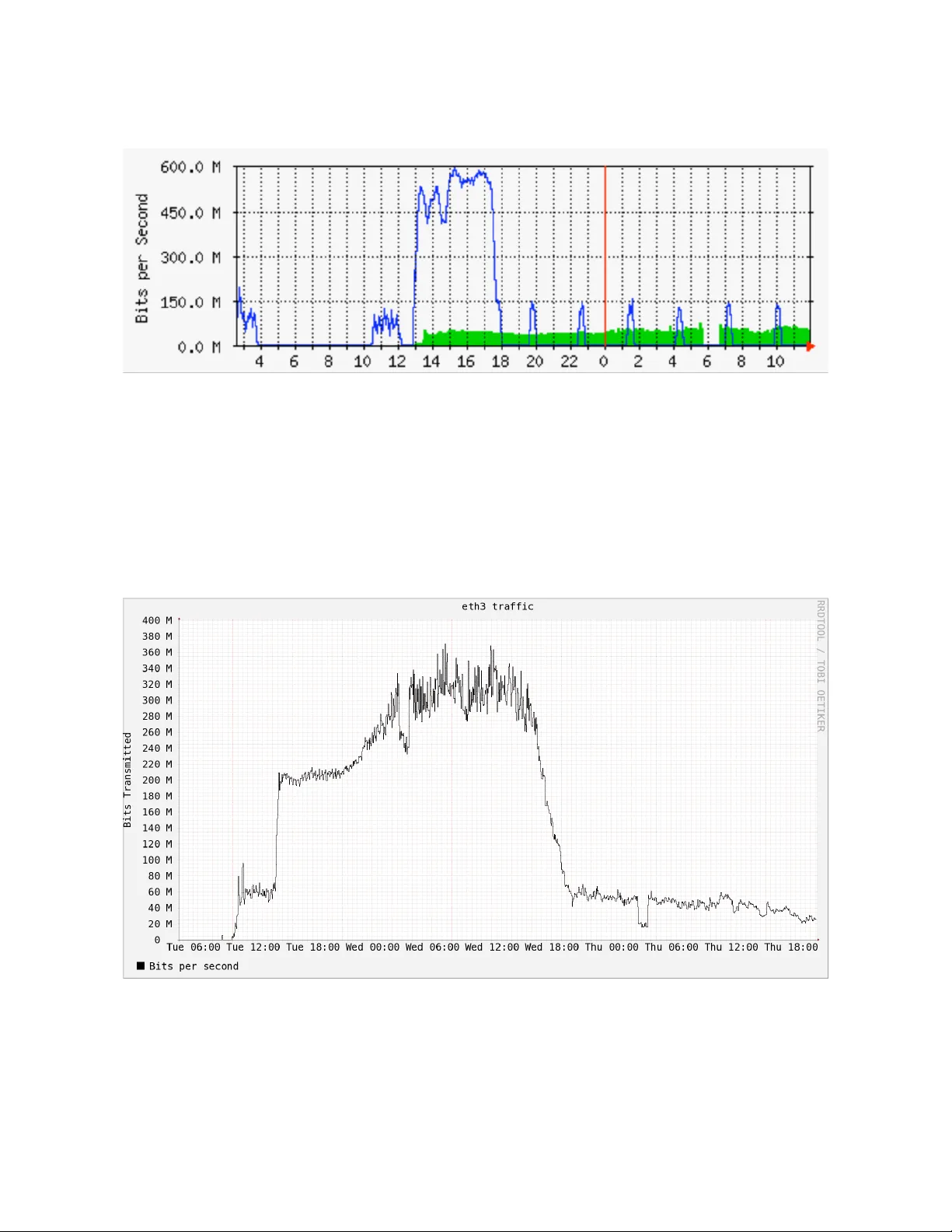

실험에서는 BaBar 데이터 중 2 TB 규모의 시뮬레이션 데이터와 1.2 TB 규모의 실제 데이터를 사용하였다. 세 가지 데이터셋(Tau1N‑data, Tau1N‑MC, Tau11‑MC)을 각각 77, 64, 114개의 작업으로 나누어 12시간 가량 실행했으며, 이벤트당 처리 속도는 110 ev/s, 55 ev/s, 430 ev/s에 달했다. 이는 각각 440 KB/s, 220 KB/s, 1.3 MB/s의 I/O 요구량을 의미한다. 전체 110개의 작업이 동시에 실행될 때 UVIC 데이터 서버에서 발생한 네트워크 부하는 평균 330 Mbit/s 수준이었으며, 이는 CANARIE 연구망을 통한 고속 전송임을 확인했다.

VM 이미지 전송은 초기 부팅 단계에서 가장 큰 오버헤드였다. UVIC 클라우드에 배치된 60개의 VM는 NRC 레포지토리에서 1 TB를 전송하는 데 약 5시간이 소요되었으며, 이 과정에서 NRC 측 네트워크는 500 Mbit/s 수준의 지속적인 트래픽을 발생시켰다. 이후 VM이 모두 가동되면 데이터 스트리밍 외의 네트워크 사용량은 거의 사라졌다.

시스템 안정성 측면에서, Nimbus 구버전 버그로 인한 VM 오류, Xen 하이퍼바이저의 비정상 종료, Condor‑EC2 연동 오류 등 여러 장애가 보고되었지만, Cloud Scheduler의 자동 복구 메커니즘이 작동해 전체 작업 성공률을 99 % 이상으로 유지했다. 향후 계획으로는 데이터 스토리지 네트워크를 10 Gbit/s로 업그레이드하고, VM 이미지를 한 번만 전송해 여러 클라우드에서 재사용하는 방식을 도입해 시작 시간을 크게 단축할 예정이다.

결론적으로, 본 연구는 대규모 과학 데이터셋을 중앙 저장소에 두고, 전 세계에 분산된 IaaS 클라우드에서 동시다발적으로 분석 작업을 수행할 수 있음을 실증하였다. 네트워크 대역폭과 VM 관리 효율성만 개선한다면 수천 개의 동시 작업까지 확장 가능하며, 이는 고에너지 물리학뿐 아니라 다른 데이터 집약형 과학 분야에도 적용 가능한 범용적인 클라우드 기반 분석 플랫폼으로 평가된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기