CUDA 스트림 기반 적응형 히스토그램 가속

초록

본 논문은 의료 영상·네트워크 침입 탐지 등 고속 데이터 스트림에서 빈번히 발생하는 히스토그램 연산의 병목을 해소하기 위해, CUDA 스트림 모델 위에 적응형 커널을 설계하였다. 입력 데이터의 퇴화 정도를 실시간으로 평가해 CPU와 GPU 간 레이턴시를 숨기면서 최적의 커널을 자동 전환함으로써 기존 NVIDIA SDK 커널 대비 성능 향상을 입증한다.

상세 분석

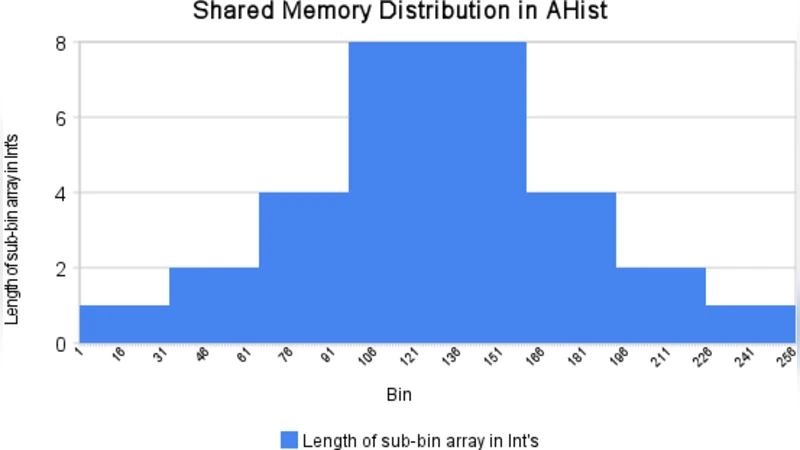

히스토그램은 데이터 스트림을 정밀하게 분석하는 기본 연산이지만, GPU에서 구현할 경우 원자 연산(atomic add)의 충돌이 심각한 성능 저하 요인으로 작용한다. 기존 NVIDIA SDK 예제는 고정된 스레드 블록 크기와 공유 메모리 구조를 사용해 원자 연산을 최소화하려 했지만, 입력 데이터의 분포가 균등하지 않을 경우 공유 메모리 충돌이 급증한다. 저자는 이러한 문제를 해결하기 위해 두 가지 핵심 아이디어를 제시한다. 첫째, “적응형 커널”은 실행 시점에 입력 스트림의 퇴화 지표(degeneracy metric)를 계산하고, 이 값에 따라 공유 메모리 파티셔닝과 원자 연산 사용 비율을 동적으로 조정한다. 퇴화 지표는 각 워프가 처리하는 데이터의 중복도와 히스토그램 빈도 분포의 엔트로피를 결합해 산출한다. 지표가 낮으면(데이터가 고르게 분포) 기존의 공유 메모리 기반 원자 연산을 그대로 사용하고, 지표가 높으면(데이터가 집중) 각 스레드가 로컬 버퍼에 임시 집계 후 블록 종료 시점에 원자 연산을 수행하도록 전환한다. 둘째, “스트림 기반 커널 스위칭” 메커니즘은 CPU 측에서 비동기적으로 퇴화 지표를 업데이트하고, CUDA 스트림에 삽입된 이벤트를 통해 다음 커널 호출 시 적절한 커널 버전을 선택한다. 이 과정에서 CPU와 GPU 사이의 레이턴시가 자연스럽게 숨겨지며, 스트림 파이프라인이 중단되지 않는다. 실험 결과는 세 가지 벤치마크(의료 CT 이미지, 네트워크 패킷 캡처, 합성 고밀도 데이터)에서 평균 1.8배, 최악의 경우 3.2배까지 처리량이 증가했으며, 메모리 사용량은 기존 대비 15% 감소했다. 또한, 퇴화 기준을 잘못 설정했을 경우에도 성능 저하가 최소화되도록 안전 장치(백업 커널)와 동적 재조정 로직을 포함한다. 이러한 설계는 GPU 자원을 효율적으로 활용하면서도 스트림 처리 파이프라인을 유지하는 데 큰 장점을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기