트리 기반 가우시안 프로세스로 분류와 범주형 입력 처리

본 논문은 회귀용으로 성공을 거둔 트리드 가우시안 프로세스(TGP)를 분류 문제에 확장한다. 트리 구조와 잠재 변수 기반 GP를 결합해 베이지안 모델 평균화를 수행하고, 효율적인 MCMC 샘플링을 설계한다. 특히 범주형 예측변수 처리를 트리 분할에 맡겨 해석 가능하고 계산 효율적인 분류 모델인 CTGP를 제안한다. 실험 결과 기존 방법 대비 높은 정확도와 좋은 외삽 성능을 보인다.

저자: Tamara Broderick, Robert B. Gramacy

논문은 먼저 가우시안 프로세스(GP)의 회귀와 분류 모델링을 간단히 리뷰한다. 회귀에서는 평균 함수와 공분산 함수(주로 제곱 지수 커널)를 정의하고, 관측 노이즈를 나타내는 nugget 파라미터를 포함한다. 분류에서는 각 클래스마다 잠재 연속 변수를 GP로 모델링하고, 소프트맥스 함수를 통해 클래스 확률을 얻는다. 이때 마지막 클래스의 잠재 변수를 0으로 고정해 파라미터 수를 M‑1로 줄인다.

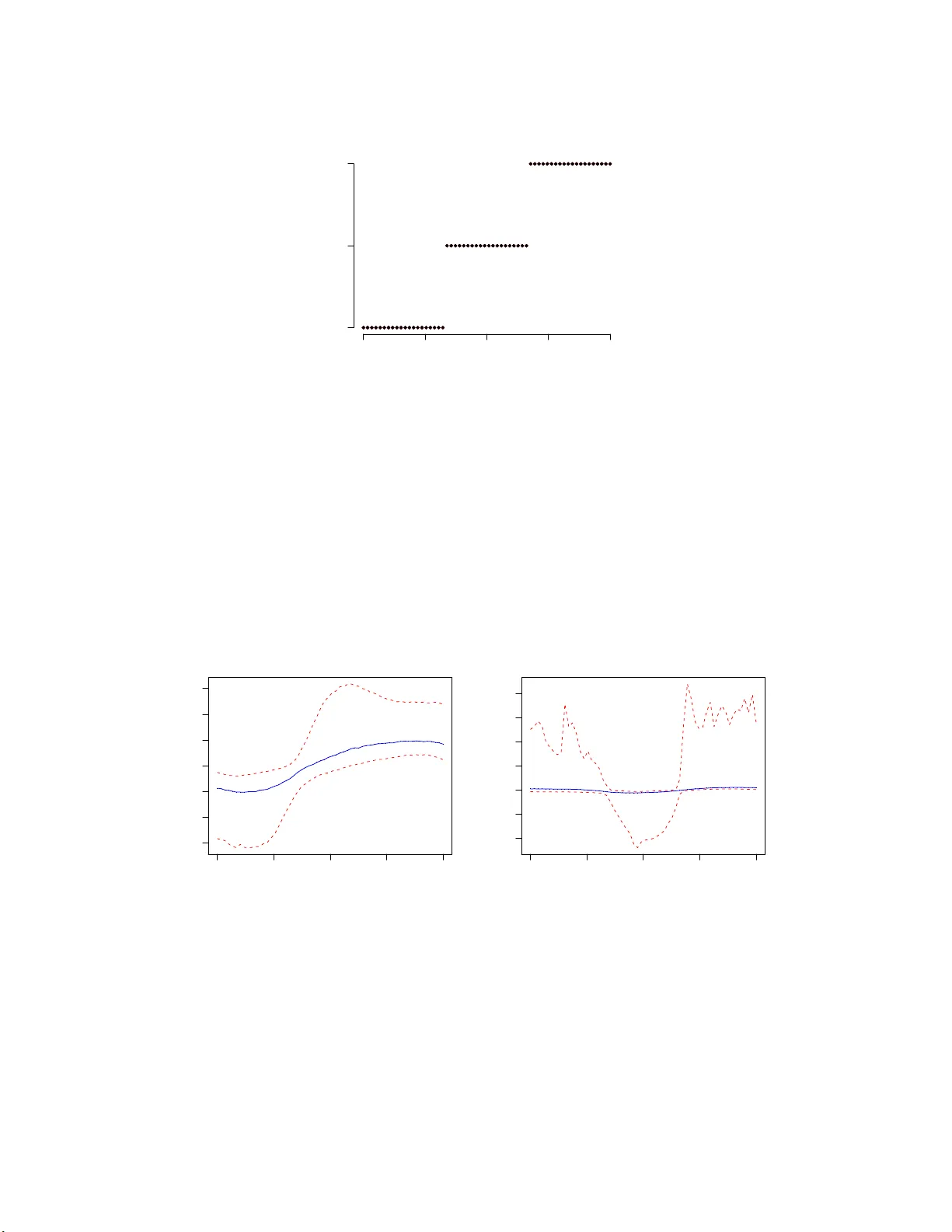

다음으로 트리드 가우시안 프로세스(TGP)의 회귀 버전을 설명한다. 트리는 입력 공간을 축축하게 분할하고, 각 리프 노드에 독립적인 GP를 할당한다. 트리 구조는 베이지안 CART과 유사하게 사전 확률(p_split, p_rule)으로 정의되며, 최소 데이터 수 제한을 두어 과도한 분할을 방지한다. 각 리프에서는 선형 혹은 상수 평균을 가질 수 있고, 공분산 파라미터(d, g)와 회귀 계수 β, 노이즈 σ² 등을 계층적 사전분포로 지정한다. MCMC 샘플링은 Gibbs 단계와 메트로폴리스‑헤이스팅 단계로 구성되며, 트리 변동은 grow, prune, change, swap, rotate와 같은 제안으로 수행한다. 리프 수가 변할 때는 RJ‑MCMC를 이용하지만, 제안 시 파라미터를 사전에서 샘플링하면 Jacobian이 1이 되어 일반 MH로 처리한다.

핵심 확장은 이 TGP 구조를 분류에 적용하는 것이다. 저자들은 두 가지 설계 중 하나를 선택한다. 첫 번째는 트리 하나에 M‑1개의 GP를 할당해 각 클래스별 잠재 변수를 학습하는 방식이고, 두 번째는 각 클래스마다 독립적인 전체 TGP를 구축하는 방식이다. 논문에서는 두 번째 방식을 채택해 모델 혼합을 단순화하고, 각 클래스별 트리 구조가 독립적으로 변하도록 함으로써 샘플링 효율을 높인다. 잠재 변수 Z는 각 리프에서 블록 단위로 제안하고, 메트로폴리스‑헤이스팅 제안 분포는 현재 값과 사전 평균 사이의 가중 평균을 사용한다. 이렇게 하면 잠재 변수와 GP 파라미터 사이의 상호 의존성을 완화해 MCMC 혼합이 빨라진다.

범주형 입력 처리에 대한 새로운 기여는 트리 분할 규칙에 범주형 변수를 직접 포함시킨다. 연속형 변수는 GP가 담당하고, 범주형 변수는 트리의 분할 기준이 되므로, 기존 GP 커널을 수정할 필요 없이 자연스럽게 모델에 통합된다. 이는 특히 범주형 변수가 다수인 데이터셋에서 해석 가능한 규칙을 제공하고, 연산량을 크게 줄인다.

실험에서는 합성 데이터(다중 모드, 지역적 비정상성)와 UCI 데이터셋(와인, 아이리스, 손글씨 등)을 사용한다. 성능 평가는 정확도, 로그우도, 그리고 예측 불확실성(예측 분산)으로 이루어진다. CTGP는 베이지안 CART보다 높은 정확도와 더 부드러운 확률 예측을 제공하며, 전통적인 다중 클래스 GP보다 계산 효율이 좋다. 특히 범주형 변수가 포함된 경우, CTGP는 트리 분할을 통해 변수 중요도를 직관적으로 파악할 수 있다. 한계로는 트리 탐색 비용이 데이터 규모에 따라 증가하고, 리프가 과도하게 늘어날 경우 GP 파라미터 추정이 불안정해질 수 있다. 향후 연구 방향으로는 스파스 커널, 변분 추정, 그리고 GPU 기반 병렬 MCMC를 제안한다. 최종적으로 저자들은 CTGP가 해석 가능성, 계산 효율성, 그리고 예측 정확도 측면에서 강력한 분류 도구임을 강조한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기