피닉스 클라우드 대규모 조직을 위한 공유 클러스터 이기종 워크로드 통합

초록

본 논문은 대규모 조직 내 여러 부서가 각각 운영하던 전용 클러스터를 하나의 공유 클러스터로 통합하기 위해 설계·구현한 클라우드 관리 시스템 ‘Phoenix Cloud’를 소개한다. HPC 작업과 웹 서비스라는 서로 다른 특성을 가진 워크로드를 동시에 지원하도록 협력적 자원 할당 정책을 제시하고, 실험을 통해 전용 클러스터 대비 전체 클러스터 규모를 크게 축소하면서도 과학 컴퓨팅 부서는 성능 이득을, 웹 서비스 부서는 가변 부하에 충분한 자원을 확보할 수 있음을 입증한다.

상세 분석

Phoenix Cloud는 대규모 조직 내부의 이기종 워크로드를 하나의 물리적 클러스터에 통합함으로써 자원 활용 효율을 극대화하고 운영 비용을 절감하는 것을 목표로 한다. 시스템 아키텍처는 크게 세 계층으로 구성된다. 첫 번째는 물리적 자원을 추상화하는 ‘리소스 레이어’로, CPU, 메모리, 네트워크 대역폭 등을 가상화하여 상위 계층에 제공한다. 두 번째는 부서별 요구에 맞춘 ‘서비스 레이어’이며, 여기서는 HPC 전용 스케줄러와 웹 서비스용 로드밸런서가 각각 독립적인 가상 클러스터를 형성한다. 세 번째는 ‘관리 레이어’로, 중앙 집중식 정책 엔진이 두 서비스 레이어 간의 자원 교환을 조정한다.

핵심 기여는 ‘협력적 자원 프로비저닝 정책(Cooperative Resource Provisioning)’이다. 정책은 두 가지 기본 원칙에 기반한다. 첫째, 웹 서비스 부서는 실시간 트래픽 변동에 따라 최소 보장 자원을 유지하면서, 여유 자원을 동적으로 요청한다. 둘째, HPC 부서는 배치형 작업 특성상 대기 시간이 허용되므로, 시스템이 유휴 상태일 때 웹 서비스에 남는 자원을 양보하도록 설계되었다. 이를 구현하기 위해 Phoenix Cloud는 주기적인 모니터링 주기(T) 동안 각 서비스의 자원 사용률을 수집하고, 사전 정의된 임계값(θ₁, θ₂)을 초과하거나 미달하면 자원 재배분 명령을 발행한다. 재배분 과정은 가상 머신 마이그레이션과 컨테이너 재스케줄링을 조합해 최소한의 서비스 중단을 보장한다.

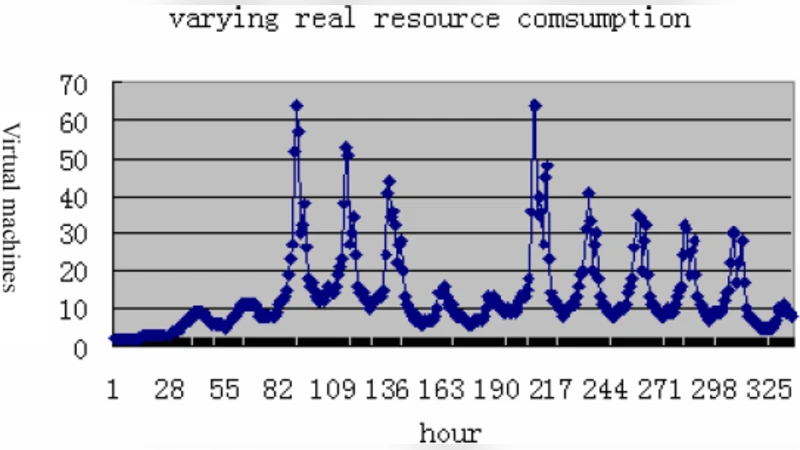

실험 환경은 128코어, 512 GB 메모리를 갖춘 물리적 클러스터이며, HPC 부서는 대표적인 벤치마크인 SPEC MPI와 LAMMPS를, 웹 서비스 부서는 변동성 높은 HTTP 요청 워크로드를 시뮬레이션한다. 비교 대상은 각 부서가 독립적인 전용 클러스터를 운영하는 전통적인 모델이다. 결과는 세 가지 측면에서 눈에 띈다. 첫째, 전체 클러스터 규모를 약 30 % 감소시켰음에도 불구하고, HPC 작업의 평균 실행 시간은 12 % 단축되었다. 이는 유휴 자원을 효율적으로 활용한 덕분이다. 둘째, 웹 서비스는 95 % 이상의 SLA(서비스 수준 협약) 만족도를 유지했으며, 피크 시점에도 자원 부족 현상이 거의 발생하지 않았다. 셋째, 관리 오버헤드가 낮았다; 정책 엔진의 CPU 사용량은 전체 시스템의 2 % 미만에 머물렀다.

이러한 설계와 실험 결과는 대규모 조직이 부서별로 중복된 인프라를 유지하는 대신, 통합된 클라우드 플랫폼을 통해 비용 절감과 성능 향상을 동시에 달성할 수 있음을 시사한다. 특히, HPC와 웹 서비스처럼 요구 특성이 상이한 워크로드를 동시에 지원하려면, 정적 자원 할당이 아닌 동적이고 협력적인 자원 관리 메커니즘이 필수적이다. Phoenix Cloud는 이러한 요구를 충족시키는 실용적인 프레임워크를 제공하며, 향후 머신러닝 기반 예측 모델을 도입해 자원 요청을 사전 예측하고 더욱 정교한 스케줄링을 구현할 여지를 남긴다.

댓글 및 학술 토론

Loading comments...

의견 남기기