희소 그래디언트 학습을 통한 변수 선택과 차원 축소

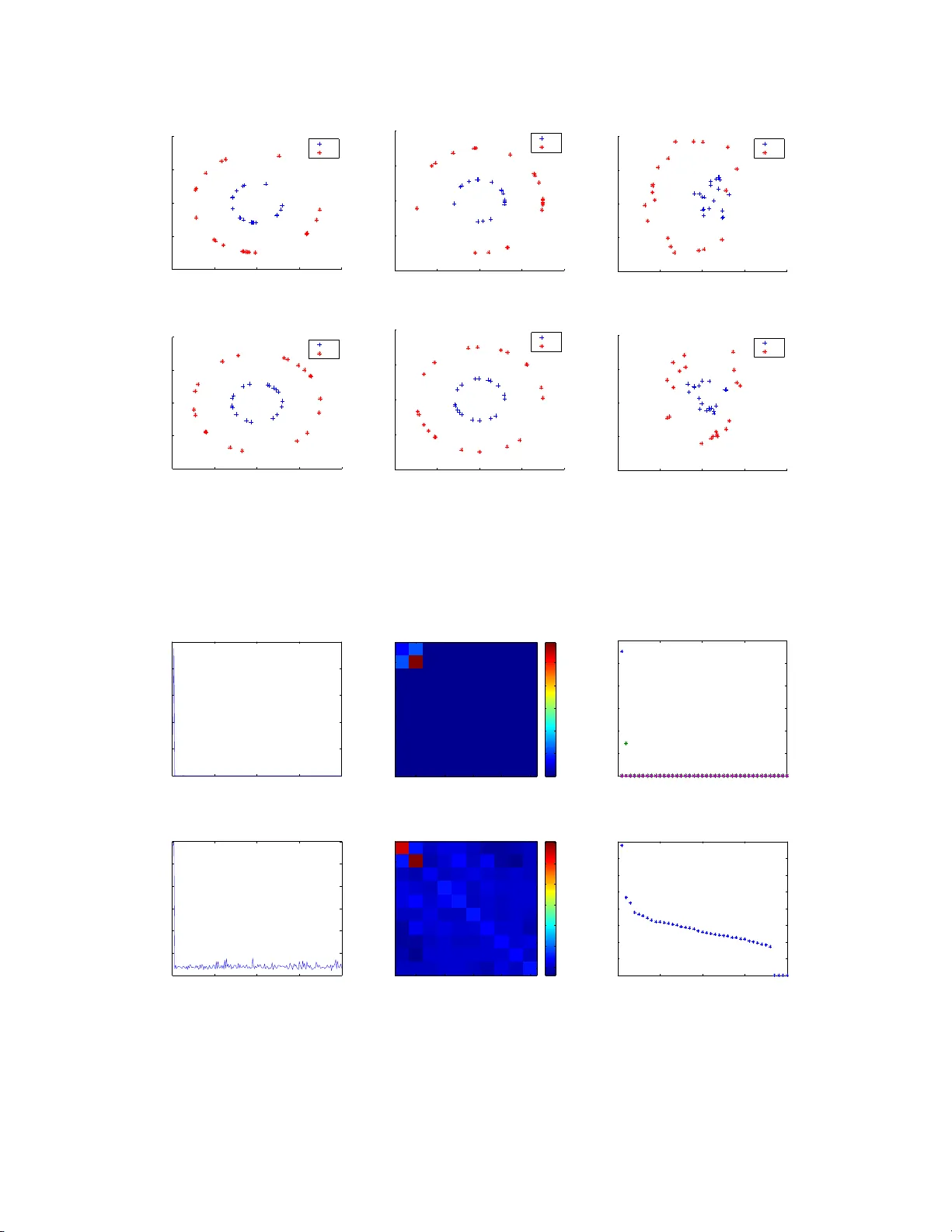

본 논문은 고차원 데이터에서 변수 선택과 차원 축소를 동시에 수행하는 새로운 프레임워크인 희소 그래디언트 학습(SGL)을 제안한다. 샘플로부터 예측 함수의 그래디언트를 직접 추정하고, 그래디언트에 ℓ₁-스파스성 제약을 부여함으로써 비제로 편미분을 가진 변수만을 선택한다. 추정된 희소 그래디언트 공분산 행렬의 고유벡터를 이용해 효과적인 저차원 서브스페이스를 얻으며, 유클리드와 매니폴드 두 경우 모두에 대한 수렴 이론을 제공한다. 또한 전방‑후방 …

저자: Gui-Bo Ye, Xiaohui Xie

**1. 서론 및 연구 동기**

고차원 데이터 분석에서 변수 선택과 차원 축소는 각각 과적합 방지와 계산 효율성 확보를 위해 필수적인 절차이다. 전통적으로 Lasso, Elastic Net 등은 변수 선택에, PCA, SIR, PLS 등은 차원 축소에 사용돼 왔으며, 두 절차를 순차적으로 적용하는 것이 일반적이었다. 그러나 이러한 분리된 접근법은 (i) 변수 선택이 차원 축소에 반영되지 않아 정보 손실 위험이 존재하고, (ii) 비선형 관계를 포착하기 어렵다는 한계가 있다. 본 논문은 이러한 문제를 해결하기 위해 “그래디언트 자체를 학습하고, 그 그래디언트에 스파스성을 부여한다”는 새로운 관점을 제시한다.

**2. 문제 정의 및 모델 설계**

주어진 데이터 집합 D={(x_i, y_i)}_{i=1}^n, x_i∈ℝ^p, y_i∈ℝ (또는 카테고리) 에 대해 예측 함수 f:ℝ^p→ℝ를 가정한다. 목표는 다음 최적화 문제를 푸는 것이다.

\

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기