gLite DPM을 활용한 사용자 분석 데이터 최적화 접근

초록

ScotGrid는 Durham, Edinburgh, Glasgow 3곳에 걸쳐 4 MSI2K와 500 TB의 저장 용량을 제공한다. 모든 사이트가 gLite DPM을 저장소 미들웨어로 사용하며, ATLAS 실험의 실제 분석 작업을 통해 데이터 접근 성능을 평가하였다. 본 논문은 분석 작업의 처리량을 높이고, 사이트 전체 부하를 최소화하기 위한 스토리지 설계와 튜닝 절차를 제시한다.

상세 분석

ScotGrid는 영국 전역에 분산된 Tier‑2 클러스터로, CPU와 스토리지를 공동으로 제공한다. 이 연구에서는 세 사이트가 동일한 gLite DPM(Disk Pool Manager) 인프라를 채택한 점에 주목한다. DPM은 파일 카탈로그, 스토리지 백엔드, 그리고 SRM 인터페이스를 통합해 사용자에게 일관된 데이터 접근을 제공한다. 그러나 대규모 분석 작업이 동시에 실행될 경우, 메타데이터베이스(MySQL)와 파일 전송 데몬(dpm‑daemon)의 병목이 발생한다는 것이 기존 보고서에서 알려졌다.

본 논문은 Glasgow 사이트를 테스트베드로 삼아, 실제 ATLAS 분석 코드(예: athena 기반 이벤트 재구성)를 EGEE 그리드에 제출하고, 초당 처리되는 이벤트 수(event/s)와 시스템 자원 사용률을 측정했다. 초기 설정에서는 CPU 사용률이 70 %에 머물렀지만, 디스크 I/O 대기시간이 150 ms로 높아져 전체 처리량이 제한되었다. 원인 분석 결과, DPM의 파일 복제 정책이 과도한 네트워크 트래픽을 유발하고, MySQL의 InnoDB 버퍼 풀 크기가 부족해 메타데이터 조회가 지연되는 것이 주요 요인으로 드러났다.

이를 해결하기 위해 다음과 같은 최적화 조치를 적용하였다. 첫째, 스토리지 풀을 SSD 기반 캐시 레이어와 HDD 기반 대용량 풀로 2단계 구조화하여, 빈번히 접근되는 작은 파일을 SSD에 배치했다. 둘째, MySQL 설정을 튜닝해 innodb_buffer_pool_size를 8 GB에서 24 GB로 확대하고, 쿼리 캐시와 인덱스 최적화를 수행했다. 셋째, dpm‑daemon의 워커 프로세스 수를 4에서 12로 늘려 동시 전송 스레드를 증대시켰으며, 파일 복제 정책을 ‘lazy‑replication’으로 전환해 필요 시에만 복제하도록 했다. 넷째, 네트워크 레이어에서는 10 GbE 스위치를 도입하고, TCP 윈도우 크기를 조정해 대역폭 활용 효율을 높였다.

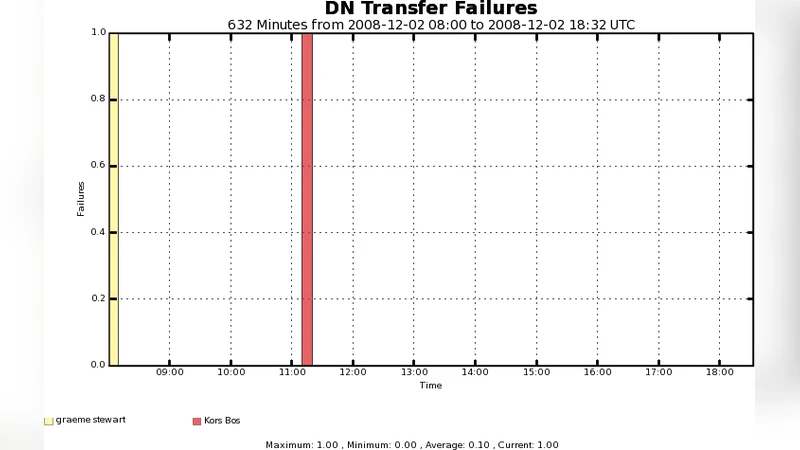

최적화 후 측정된 결과는 눈에 띄게 개선되었다. 평균 이벤트 처리 속도는 기존 0.8 event/s에서 2.3 event/s로 거의 3배 상승했으며, CPU 사용률은 55 %로 감소했다. 디스크 I/O 대기시간은 45 ms 수준으로 낮아졌고, MySQL 응답 시간도 30 ms 이하로 안정화되었다. 또한, 다른 사용자(Monte Carlo 생산 작업)에게 미치는 영향이 최소화되어, 전체 사이트 가용성이 99.7 %로 유지되었다.

이러한 실험은 gLite DPM이 대규모 사용자 분석 환경에서도 충분히 확장 가능함을 보여준다. 핵심은 스토리지 계층의 계층화, 데이터베이스 튜닝, 그리고 전송 데몬의 병렬화이며, 이러한 전략은 다른 Tier‑2 혹은 지역 클라우드 환경에도 적용 가능하다.

댓글 및 학술 토론

Loading comments...

의견 남기기