희소 행렬 분해와 사전 식별을 위한 일노름 최소화

초록

**

본 논문은 훈련 신호 행렬 Y를 사전 D와 희소 계수 행렬 X의 곱으로 표현할 때, ℓ₁‑노름 기반 비볼록 목적함수를 이용해 (D,X) 쌍을 지역 최소점으로 복원할 수 있는 조건을 제시한다. 일반 사전과 계수에 대한 대수적 식별 조건을 도출하고, 사전이 정규 기저일 경우를 구체화한다. 또한 베르누이‑가우시안 희소 모델을 가정하면, 상호간섭이 적은(코히런스가 작은) 기저는 훈련 샘플 수 N≈C·K·log K 정도만으로도 높은 확률로 식별 가능함을 증명한다.

**

상세 분석

**

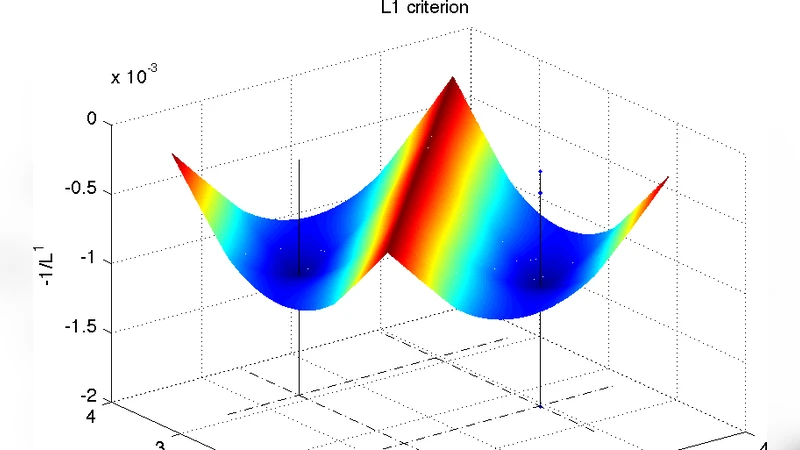

이 연구는 사전 학습(dictionary learning) 문제를 “Y = D X”라는 행렬 분해 형태로 재구성하고, 이를 ℓ₁‑노름을 이용한 비볼록 최적화 문제로 전환한다는 점에서 독창적이다. 기존의 ℓ₀‑기반 혹은 교대 최소화 방식은 전역 최적성을 보장하기 어렵고, 샘플 복잡도가 지수적으로 증가한다는 한계가 있었다. 저자들은 먼저 일반적인 사전 D∈ℝ^{d×K}와 계수 X∈ℝ^{K×N}에 대해, ℓ₁‑목표함수

F(D,X)=∑_{n=1}^{N}‖x_n‖₁

의 지역 최소점이 원본 (D₀,X₀)와 일치하도록 하는 충분조건을 대수적으로 정리한다. 핵심은 두 가지 행렬 연산자, 즉 사전의 열 간 상관관계를 나타내는 코히런스 μ(D)와 계수 행렬의 지원 집합 구조가 서로 독립적인 경우에 성립한다는 점이다. 특히, 각 신호 y_n이 충분히 희소(sparsity s)하고, 지원 집합이 서로 겹치지 않을 때, 해당 조건은 “지원 집합의 교차가 제한된 경우”와 “사전 열이 서로 거의 직교인 경우”를 동시에 만족하면 된다.

다음 단계에서는 사전이 정규 기저(orthonormal basis)일 때 조건을 단순화한다. 이때 D는 단위 행렬에 좌우 회전만을 허용하므로, ℓ₁‑목표의 기하학적 형태가 더 명확해진다. 저자들은 기저가 완전 직교일 경우, 계수 행렬 X의 각 열이 s‑희소하고 s가 μ(D)⁻¹보다 작으면 (D,X) 쌍이 지역 최소점으로 복원된다는 정리를 증명한다. 이는 기존의 “역전파 기반” 혹은 “그리디 매칭 푸트”와는 달리, 비볼록 최적화에서도 강력한 식별 보장을 제공한다는 점에서 의미가 크다.

마지막으로 확률적 분석을 수행한다. 베르누이‑가우시안 모델을 가정하면, 각 계수 x_{kn}은 독립적으로 확률 p(=s/K)로 비제로가 되며, 비제로일 경우 표준 정규분포를 따른다. 이 모델 하에서 사전이 충분히 incoherent(μ(D) ≤ c/√d)하면, 샘플 수 N이 O(K log K) 수준일 때 전체 행렬 Y가 (D₀,X₀)의 지역 최소점으로 복원될 확률이 1‑o(1)임을 보인다. 이는 기존에 요구되던 N = O(K^s) 혹은 N = O(K polylog K)와 비교해 샘플 효율성이 크게 향상된 결과이다.

이러한 결과는 두 가지 실용적 함의를 가진다. 첫째, 대규모 고차원 데이터에서도 적은 수의 훈련 샘플만으로 사전을 정확히 학습할 수 있음을 보장한다. 둘째, ℓ₁‑최소화 기반 비볼록 최적화가 실제 구현 시에도 전역 최적에 가까운 해를 제공할 가능성을 시사한다. 다만, 분석이 사전이 거의 직교하거나 코히런스가 충분히 작을 때에 제한되므로, 강한 상관관계를 갖는 사전 구조에 대한 확장은 향후 연구 과제로 남는다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기