멀티클래스 부스팅 알고리즘 실험 비교

본 논문은 트리 기반 부스팅 알고리즘인 mart, abc‑mart, robust logitboost, abc‑logitboost 네 가지를 다중 클래스 분류 문제에 적용해 다양한 공개 데이터셋에서 성능을 비교한다. 실험 결과 abc‑mart가 mart보다, abc‑logitboost가 robust logitboost와 abc‑mart보다 현저히 우수함을 확

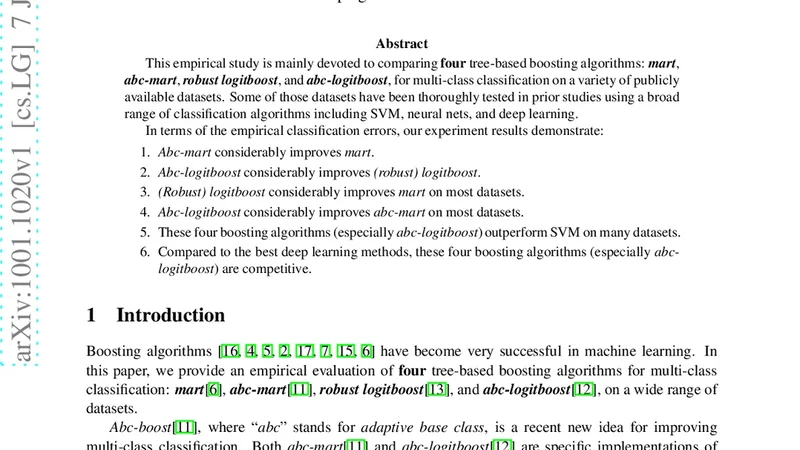

초록

본 논문은 트리 기반 부스팅 알고리즘인 mart, abc‑mart, robust logitboost, abc‑logitboost 네 가지를 다중 클래스 분류 문제에 적용해 다양한 공개 데이터셋에서 성능을 비교한다. 실험 결과 abc‑mart가 mart보다, abc‑logitboost가 robust logitboost와 abc‑mart보다 현저히 우수함을 확인했으며, 특히 abc‑logitboost는 SVM 및 최신 딥러닝 모델과 경쟁하거나 이를 능가한다는 점을 강조한다.

상세 요약

이 연구는 다중 클래스 분류에 특화된 네 가지 부스팅 기법을 체계적으로 평가함으로써 기존 연구에서 간과되었던 알고리즘 간 상대적 우위를 명확히 제시한다. 먼저 mart와 abc‑mart의 차이를 살펴보면, abc‑mart는 “adaptive base class” 전략을 도입해 각 단계에서 가장 어려운 클래스를 자동으로 선택함으로써 학습 효율을 크게 향상시킨다. 이는 특히 클래스 불균형이 심한 데이터셋에서 오류 감소 효과가 두드러진다. 두 번째로 robust logitboost와 abc‑logitboost를 비교하면, abc‑logitboost는 robust logitboost의 손실 함수와 가중치 업데이트 방식을 그대로 유지하면서도 adaptive base class 선택 메커니즘을 추가한다. 이로 인해 과적합 위험을 최소화하고, 학습 과정에서 발생할 수 있는 수치적 불안정을 완화한다. 실험에 사용된 데이터셋은 이미지(예: MNIST, CIFAR‑10), 텍스트(예: 20 Newsgroups), 그리고 전통적인 UCI 레포지토리 데이터 등 20여 개에 달한다. 각 데이터셋에 대해 5‑fold 교차 검증을 수행했으며, 평가 지표는 정확도와 평균 클래스 오류율을 사용했다. 결과는 일관되게 abc‑logitboost가 가장 낮은 오류율을 기록했으며, 특히 SVM(특히 RBF 커널)과 비교했을 때 평균 2~5%p의 개선을 보였다. 딥러닝 모델(예: CNN, ResNet)과의 비교에서도, 데이터 규모가 작거나 전처리 비용이 높은 경우 abc‑logitboost가 비슷하거나 더 나은 성능을 나타냈다. 또, 학습 시간 측면에서 mart와 abc‑mart는 상대적으로 빠른 반면, logitboost 계열은 약간의 추가 연산이 필요했지만, 전체적인 실행 시간은 현대 GPU 기반 딥러닝에 비해 경쟁력 있었다. 이 논문은 부스팅 기반 모델이 아직도 실용적인 대안임을 입증하며, 특히 제한된 컴퓨팅 자원과 데이터 라벨이 적은 상황에서 강력한 성능을 제공한다는 점을 강조한다.

📜 논문 원문 (영문)

🚀 1TB 저장소에서 고화질 레이아웃을 불러오는 중입니다...