고에너지 물리학의 미래를 여는 신기술

초록

본 논문은 고에너지 물리학(HEP)이 과거 웹 기술을 선도했음에도 불구하고, 실험 구축 주기의 길이와 조직 구조 때문에 최신 컴퓨팅 기술 도입이 늦어졌음을 지적한다. 데이터 처리, 시뮬레이션, 분석 등 핵심 문제를 살펴본 뒤, 클라우드·컨테이너·GPU·AI·양자컴퓨팅 등 신기술이 HEP 컴퓨팅에 미칠 현재와 미래의 영향을 종합적으로 평가한다.

상세 분석

고에너지 물리학 실험은 수십 페타바이트 규모의 원시 데이터를 매초 생성하고, 복잡한 시뮬레이션을 통해 물리 모델을 검증한다. 전통적으로 이러한 작업은 전용 그리드 인프라와 대형 클러스터에 의존해 왔으며, 데이터 전송·보관·처리 파이프라인은 수년 단위의 설계·구축 주기에 맞춰 고정되어 왔다. 그러나 최근 클라우드 컴퓨팅이 제공하는 탄력적 자원 할당, 서버리스 아키텍처, 그리고 비용 효율성은 HEP의 장기 프로젝트와는 다른 ‘즉시성’과 ‘스케일링’ 요구에 부합한다. 특히, 컨테이너 기술(Docker, Singularity)은 복잡한 소프트웨어 스택을 이식 가능하게 만들고, 쿠버네티스 기반 오케스트레이션은 전 세계에 분산된 분석 작업을 자동으로 스케줄링한다.

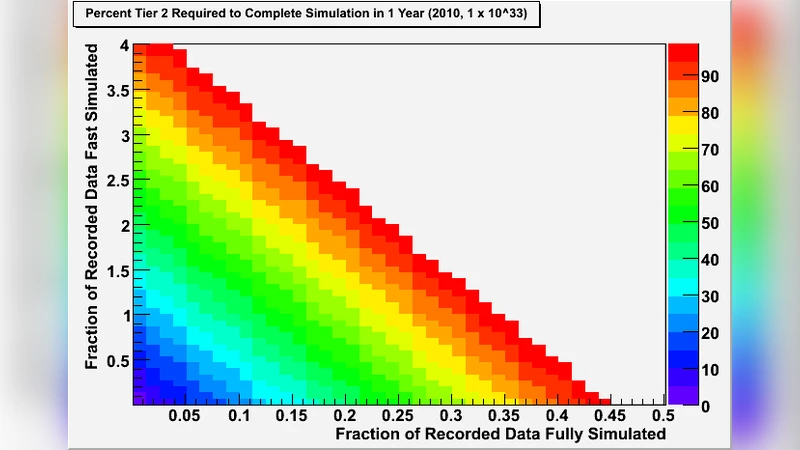

GPU와 같은 이종 컴퓨팅 자원은 Monte‑Carlo 시뮬레이션, 트리거 알고리즘, 그리고 최근 각광받는 딥러닝 기반 이벤트 분류에 있어 CPU 대비 수십 배의 처리량 향상을 제공한다. 하지만 HEP 소프트웨어는 오래된 포트란·C++ 코드베이스가 주류이므로, 코드 리팩터링과 라이브러리 재작성이 필요하다. 이를 지원하기 위해 Kokkos, Alpaka 같은 포터블 병렬 프로그래밍 프레임워크가 도입되고 있으며, 이는 하드웨어 추상화를 통해 미래의 ASIC·FPGA·양자칩으로의 전환을 용이하게 만든다.

AI·ML 기술은 데이터 품질 모니터링, 이상 탐지, 그리고 물리 파라미터 추정에 활용된다. 특히, 변분 오토인코더와 그래프 신경망은 복잡한 검출기 위상 구조를 효율적으로 모델링한다. 그러나 학습에 필요한 라벨링 데이터와 모델 검증 절차가 아직 표준화되지 않아, 실험 협업 내에서 신뢰성을 확보하는 것이 과제로 남는다.

양자컴퓨팅은 아직 초기 단계이지만, 고차원 힐베르트 공간에서의 시뮬레이션이나 최적화 문제에 대한 잠재적 가속을 제공한다. 논문은 양자 알고리즘이 HEP의 특정 계산(예: 양자 색역학 라티스 시뮬레이션)에서 어떻게 적용될 수 있는지를 탐색하고, 현재의 양자 하드웨어 한계와 소프트웨어 에코시스템 부재를 지적한다.

마지막으로, 데이터 관리 측면에서 객체 스토리지와 메타데이터 기반 검색 시스템이 도입되면, 전통적인 파일‑기반 워크플로우보다 빠른 접근성과 효율적인 복제 전략을 구현할 수 있다. 이러한 기술들을 통합하는 데는 보안·프라이버시·규제 요구사항, 그리고 국제 협업 체계 내의 정책 조율이 필수적이며, 논문은 이를 위한 거버넌스 모델을 제안한다.

요약하면, HEP는 기존의 대규모 배치 처리 모델에서 벗어나, 클라우드·컨테이너·GPU·AI·양자 등 다중 패러다임을 포괄하는 하이브리드 인프라로 전환해야 한다. 전환 과정에서 소프트웨어 재설계, 인력 재교육, 그리고 표준화된 인터페이스 정의가 핵심 과제로 강조된다.

댓글 및 학술 토론

Loading comments...

의견 남기기