라벨 정보를 활용한 차원 축소 알고리즘 CCDR

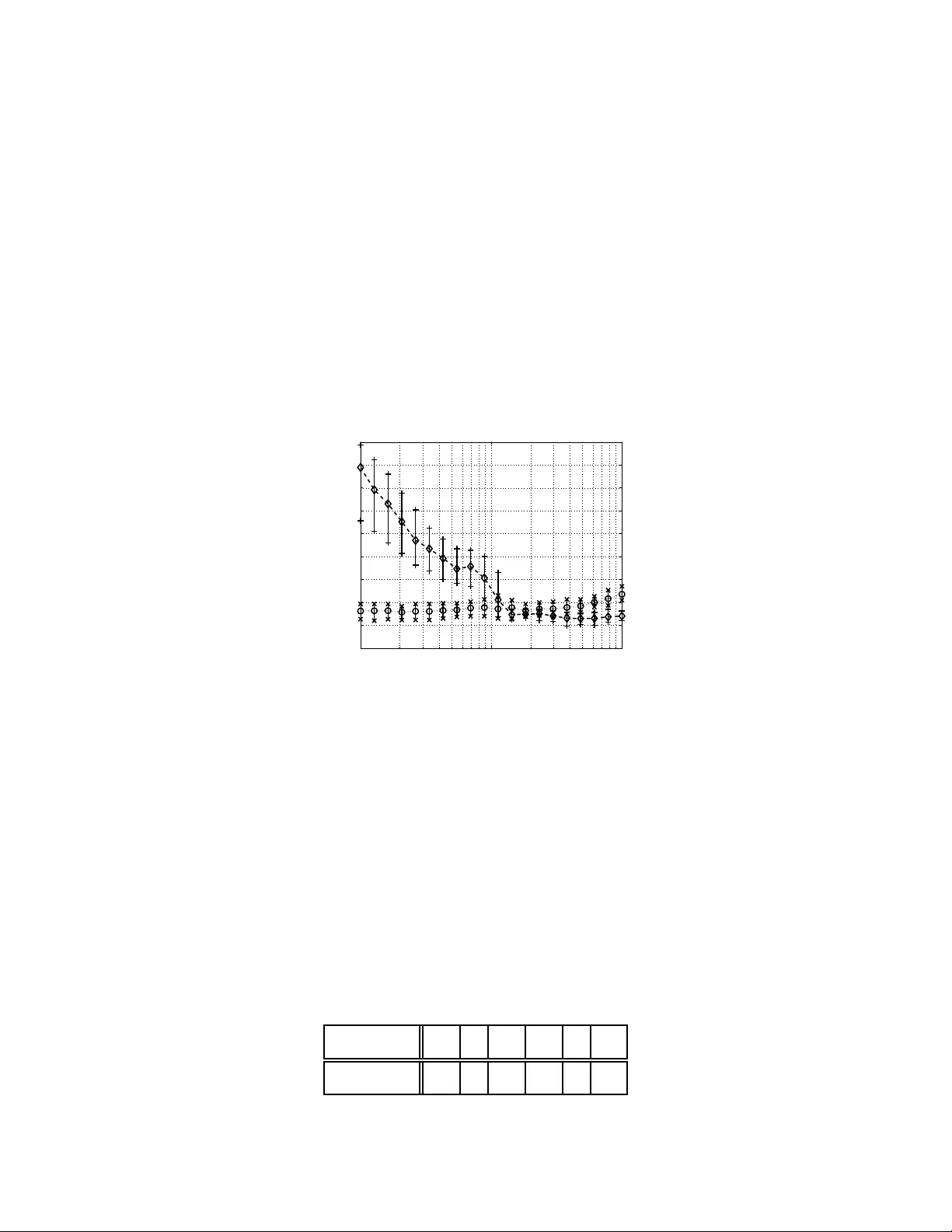

본 논문은 라벨 정보를 통합한 차원 축소 기법인 Classification Constrained Dimensionality Reduction (CCDR)를 제안한다. CCDR는 라플라시안 이벤맵을 기반으로 클래스 간 거리를 최소화하도록 비용 함수를 설계하고, 다중 클래스와 반지도 학습(semi‑supervised) 상황을 모두 지원한다. 또한 Nyström 방법을 이용한 out‑of‑sample 확장을 제공해 새로운 데이터에 대한 임베딩을 효율…

저자: Raviv Raich, Jose A. Costa, Steven B. Damelin

본 논문은 고차원 데이터의 차원 축소와 분류 성능을 동시에 향상시키기 위한 새로운 알고리즘인 Classification Constrained Dimensionality Reduction (CCDR)를 제안한다. 서론에서는 차원 축소가 머신러닝 파이프라인에서 전처리 단계로서 차지하는 중요성을 강조하고, 기존의 선형 방법인 주성분 분석(PCA)과 다차원 스케일링(MDS)이 비선형 매니폴드 구조를 제대로 보존하지 못하는 한계를 지적한다. 특히, PCA는 데이터 분산이 큰 방향만을 보존하므로, 분류에 중요한 작은 고유값에 해당하는 방향이 손실될 경우 성능 저하가 발생한다는 예시를 제시한다.

관련 연구 섹션에서는 비선형 차원 축소 기법으로 커널 PCA, ISOMAP, 라플라시안 이벤맵, LLE, HLLE, Diffusion Maps 등을 소개하고, 이들 방법이 라벨 정보를 전혀 활용하지 않음으로써 분류 목적에 최적화되지 못한다는 점을 비판한다. 기존에 라벨을 고려한 방법으로는 Marginal Fisher Analysis(MFA)와 두 클래스에 한정된 CCDR가 있었지만, 다중 클래스와 반지도 학습을 포괄하는 일반화된 접근법은 부재했다.

본 연구의 핵심 기여는 다음과 같다. 첫째, 라플라시안 이벤맵의 그래프 라플라시안 L에 클래스 라벨을 반영한 라벨 제약 항을 추가한 새로운 목적 함수를 도입한다. 구체적으로, 각 데이터 포인트 i에 대해 클래스 인디케이터 c_{k i}=I(c_i=k)를 정의하고, 동일 클래스에 속하는 점들 사이의 거리 가중치를 크게, 다른 클래스 사이의 가중치를 작게 설정한다. 최적화 문제는

\

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기