피셔 강연 차원 축소 회귀에 대한 논평

초록

본 논문은 R. D. Cook 교수의 Fisher Lecture “Dimension Reduction in Regression”을 대상으로 한 논평으로, 저자는 원 논문의 핵심 아이디어인 충분 차원 축소(sufficient dimension reduction, SDR)와 그 통계적 구현에 대해 재조명하고, 몇 가지 이론적·실용적 한계를 짚으며 향후 연구 방향을 제시한다. 특히, 선형성 가정, 추정 효율성, 그리고 비선형 확장 가능성에 대한 비판적 고찰이 돋보인다.

상세 분석

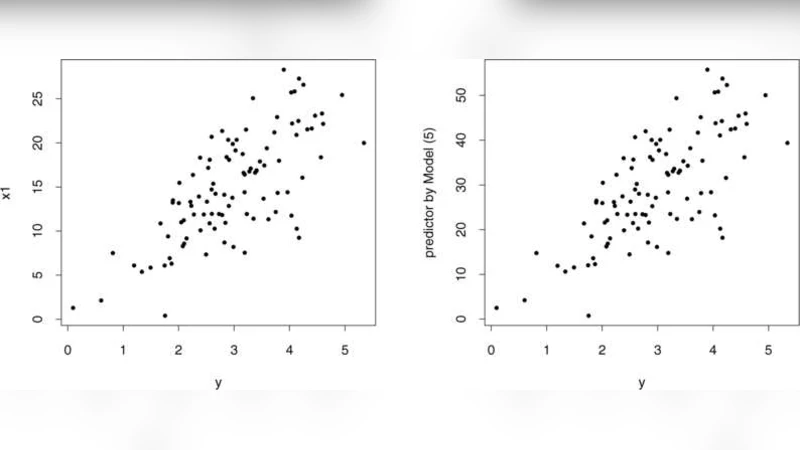

본 논평은 Cook 교수의 차원 축소 회귀 이론을 두 축으로 평가한다. 첫 번째 축은 충분 차원 축소(SDR)의 이론적 토대, 즉 조건부 평균이 입력 변수의 저차원 선형 조합에만 의존한다는 가정이다. 저자는 이 가정이 실제 데이터에서 자주 위배될 수 있음을 강조하며, 특히 비선형 관계가 지배적인 경우 선형 SDR 방법이 정보 손실을 초래한다는 점을 지적한다. 이를 보완하기 위한 비선형 확장, 예를 들어 커널 기반 SDR이나 깊이 신경망을 이용한 차원 축소가 필요하다고 주장한다. 두 번째 축은 추정 방법론의 효율성이다. Cook 교수는 Sliced Inverse Regression(SIR), Sliced Average Variance Estimation(SAVE) 등 전통적 추정기를 제시했지만, 논평자는 이러한 방법이 샘플 크기에 민감하고, 특히 고차원·소표본 상황에서 불안정함을 지적한다. 따라서 정규화 기법이나 부트스트랩 기반 불확실성 평가가 필수적이라고 제언한다. 또한, 저자는 모델 선택 과정에서 차원 수(d)의 결정이 주관적일 수 있음을 비판하고, 교차 검증이나 정보 기준량(AIC, BIC) 등을 활용한 객관적 기준을 도입할 것을 권고한다. 마지막으로, 논평은 실험적 검증 부분에서도 Cook 교수의 사례가 제한적이라고 판단한다. 다양한 분야(유전학, 이미지 분석, 금융 데이터)에서의 적용 사례를 추가함으로써 SDR 방법의 일반화 가능성을 검증해야 한다는 점을 강조한다. 전반적으로 이 논평은 기존 이론의 강점을 인정하면서도, 실용적 적용을 위한 개선점과 향후 연구 과제를 명확히 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기