신경 데이터에 대한 이징 모델: 모델 품질과 기능 연결 추출을 위한 근사 방법

초록

이 논문은 시뮬레이션된 피질 네트워크에서 얻은 다중 뉴런 스파이크 트레인을 설명하기 위해 쌍별 이징 모델을 적용한다. 200개 이하의 뉴런 집합에 대해 볼츠만 학습으로 최적 결합을 거의 정확히 추정하고, TAP 방정식 역전 및 Sessak‑Monasson 근사와 같은 기존 근사법의 정확성을 비교한다. 작은 집합에서는 근사법이 매우 정확하지만, 전체 네트워크보다 작은 부분집합을 사용할 경우 결합 강도가 과대평가되는 현상을 발견한다. 이는 무한 범위 스핀 글래스 이론의 정상상에서 설명된다. 전역적인 입력은 평균 결합을 약간 증가시키지만, 결합의 변동성은 네트워크 고유 특성에 의해 지배된다. 엔트로피 비교를 통해 작은 집합에서는 모델이 데이터를 잘 설명하지만, 규모가 커질수록 고차 상관을 포함해야 함을 시사한다.

상세 분석

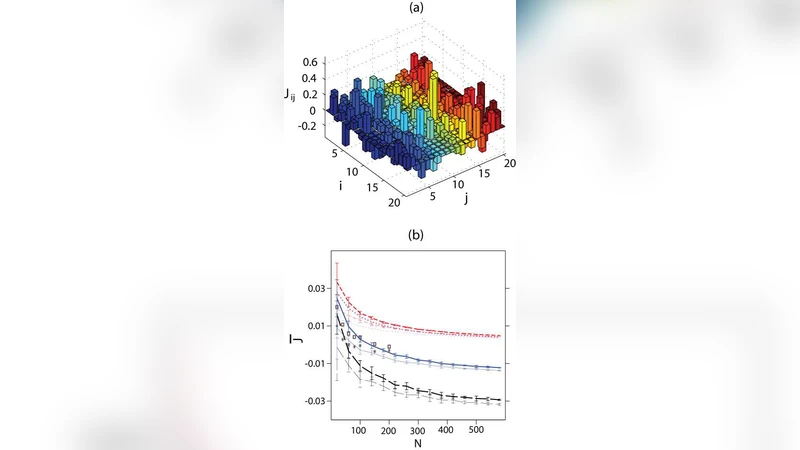

본 연구는 신경 과학에서 흔히 사용되는 이진 스파이크 모델을 물리학의 이징 모델과 연결시켜, 뉴런 집단의 통계적 특성을 정량화하려는 시도이다. 저자들은 시뮬레이션된 피질 네트워크에서 생성된 스파이크 트레인을 기반으로, 각 뉴런을 스핀(σ_i=±1)으로 매핑하고, 쌍별 상호작용 J_{ij}와 외부장 h_i를 포함하는 최대 엔트로피(쌍별 이징) 모델을 구축한다. 핵심 과제는 제한된 데이터로부터 최적의 J와 h를 효율적으로 추정하는 것이며, 이를 위해 ‘볼츠만 학습(Boltzmann learning)’이라는 확률적 경사 하강법을 사용해 거의 정확한 해를 얻는다. 그러나 볼츠만 학습은 계산 비용이 O(N^2)·T (N은 뉴런 수, T는 샘플 수)로 급격히 증가해 200개 정도까지는 가능하지만 그 이상에서는 비현실적이다.

이에 저자들은 두 가지 근사 방법을 검증한다. 첫 번째는 TAP(Thouless‑Anderson‑Palmer) 방정식의 역전으로, 평균장 이론에 2차 교정항을 포함해 J_{ij}를 직접 계산한다. 두 번째는 Sessak‑Monasson(SM) 근사로, 고차 상관을 2차까지 전개한 클러스터 변분법을 이용한다. 두 방법 모두 볼츠만 학습 결과와 비교했을 때, 평균 절대 오차가 10⁻³ 수준으로 매우 낮아 실용적이라고 판단된다. 특히 SM 근사는 작은 샘플 크기에서도 안정적인 추정치를 제공한다.

다음으로 저자들은 ‘부분집합 효과’를 조사한다. 전체 네트워크(≈1000 뉴런)에서 임의로 선택한 K(≤200)개의 뉴런만을 사용해 결합을 추정하면, 실제 전체 결합보다 평균적으로 과대평가되는 현상이 나타난다. 이는 무한 범위 스핀 글래스 모델의 정상상에서, 미관측된 스핀들이 유효 필드를 평균적으로 강화시키는 효과와 일치한다. 이론적으로는 J_eff ≈ J_true / (1‑χ) 형태로 설명되며, χ는 평균 감응도이다.

또한 전역적인 입력(모든 뉴런에 동일한 외부 자극)을 추가했을 때, 평균 결합이 약간 증가하지만, 개별 J_{ij}의 분산은 여전히 네트워크 구조에 의해 지배된다. 이는 기능적 연결이 단순히 외부 동기화에 의해 형성되는 것이 아니라, 내부 시냅스 가중치와 회로 토폴로지에 크게 의존함을 시사한다.

마지막으로 모델 품질을 엔트로피 차이로 평가한다. 작은 K(≤30)에서는 이징 모델의 엔트로피가 데이터 엔트로피와 거의 일치해, 쌍별 상관만으로도 충분히 설명 가능함을 보여준다. 그러나 K가 100을 넘어가면 엔트로피 차이가 급격히 커지며, 이는 고차 상관(삼중, 네트 등)이 무시되고 있음을 의미한다. 따라서 대규모 신경 집단을 정확히 모델링하려면 고차 상관을 포함한 확장된 최대 엔트로피 모델이 필요하다.

이와 같이 본 논문은 이징 모델을 신경 데이터에 적용하는 방법론적 기반을 확립하고, 실용적인 근사법과 그 한계를 명확히 제시함으로써, 기능적 연결 추정 및 네트워크 해석에 중요한 통찰을 제공한다.