베이즈와 신경망을 활용한 정보 톤성 자동 판별 모델

본 논문은 텍스트에 포함된 특정 어휘의 통계적 규칙을 이용해 긍정·부정·중립 톤을 판별하는 방법을 제안한다. 나이브 베이즈 이론을 기반으로 가중치를 계산하고, 두 층 퍼셉트론 신경망으로 최종 톤을 결정한다. 구현은 InfoStream 시스템에 적용돼 웹 뉴스 35,000개 소스를 실시간으로 분석하며, 스팸 필터링 기법과의 유사성을 강조한다.

저자: D.V. L, e

본 논문은 인터넷 상에서 생성되는 방대한 텍스트 흐름을 대상으로, 해당 텍스트가 긍정, 부정, 혹은 중립이라는 정서적 톤을 자동으로 판별하는 모델을 제안한다. 연구 배경으로는 기존의 스팸 필터링 기법이 베이즈 이론을 활용해 단어 빈도와 조건부 확률을 계산함으로써 높은 효율성을 보였다는 점을 들며, 이를 텍스트 톤성 분석에도 적용할 수 있음을 제시한다.

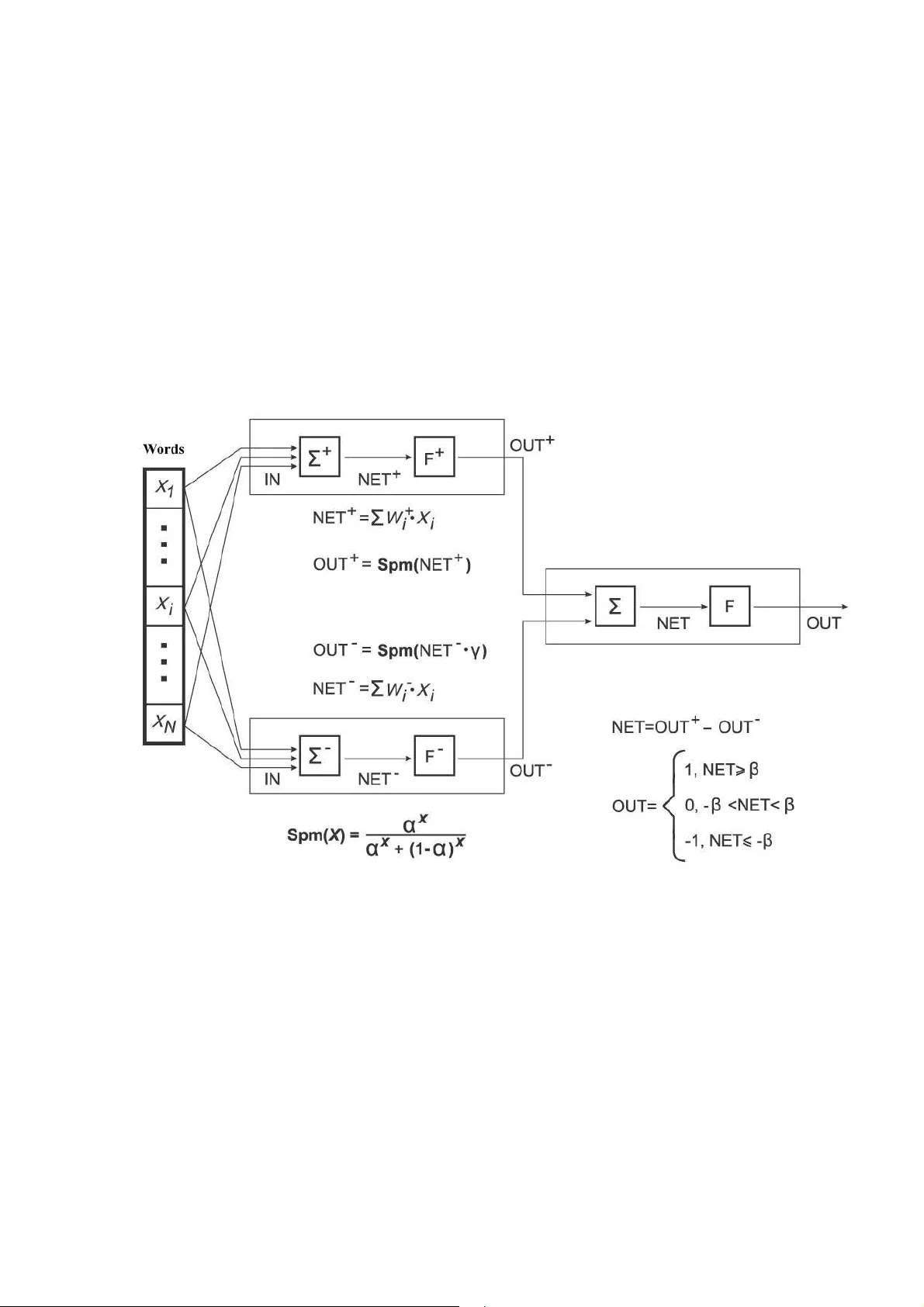

먼저 베이즈 접근법을 상세히 설명한다. 스팸 필터링에서 사용되는 식 (1) Spm = (∏w_i)/(∏w_i + ∏(1−w_i))와 같은 형태를 차용하고, 여기서 w_i는 특정 단어가 스팸(또는 특정 톤)일 확률을 의미한다. 논문은 톤성 판별을 위해 세 가지 가설 H₁(긍정), H₀(중립), H₋₁(부정)를 정의하고, 각 가설에 대해 동일한 가중치 α를 부여한다. 이를 통해 식 (5) Spm(x)=α·x/(α+λ−α·x)라는 비선형 함수를 도출한다. 여기서 x는 해당 문서에 포함된 ‘톤 컬러’ 단어의 개수이며, λ는 사전 확률을 조정하는 파라미터이다. 부정 어휘에 대해서는 γ라는 감쇠 계수를 도입해, 부정 톤이 과도하게 강조되는 현상을 보정한다.

다음으로 신경망 모델을 제시한다. 입력층은 단어 존재 여부를 0/1 벡터로 받아, 두 개의 뉴런(positive, negative)으로 전달한다. 각 뉴런은 해당 어휘에 대한 시냅스 가중치 w⁺ᵢ, w⁻ᵢ와 곱해 누적합 NET⁺, NET⁻를 만든다. 이 누적합에 앞서 정의한 베이즈 기반 비선형 함수(식 5)를 적용해 각각의 톤 가중치를 산출한다. 두 번째 층에서는 두 뉴런의 출력 차이(OUT⁺−γ·OUT⁻)를 계산하고, 최종적으로 임계값 β와 비교해 톤을 결정한다. 네트워크는 2‑layer perceptron 구조이며, 학습 과정에서 가중치와 파라미터(α, λ, γ, β)를 조정한다.

제안된 모델은 실제 시스템인 InfoStream에 적용되었다. InfoStream은 전 세계 웹사이트에서 실시간으로 뉴스를 수집·분류하는 플랫폼으로, 현재 35,000개 소스(6만 건 이상의 뉴스)를 24시간 내에 처리한다. 시스템은 각 뉴스 기사에 긍정·부정 라벨을 부착하고, 이를 색상(녹색/적색)으로 시각화한다. 사용자는 ‘정보 초상’ 기능을 통해 특정 주제에 대한 정서 흐름을 필터링하거나, 특정 톤만을 추출해 분석할 수 있다. 또한 개념 단위(인물, 조직, 브랜드 등)의 톤을 별도로 추정해, 전체 문서 톤과 차이가 있을 경우 세부적인 정서 분석을 제공한다.

논문은 제안 방법의 장점으로 (1) 베이즈 이론을 활용해 사전 지식 없이도 어휘 가중치를 자동 추정, (2) 얕은 퍼셉트론 구조로 학습·추론 비용이 낮음, (3) 기존 스팸 필터링 사전을 재활용 가능함을 들었다. 그러나 한계점도 명시한다. 나이브 베이즈의 독립성 가정이 실제 언어에서는 성립하기 어렵고, ‘톤 컬러’ 어휘 선정 기준이 주관적이며, 파라미터(γ, β 등)를 경험적으로 설정했기 때문에 다른 도메인·언어에 바로 적용하기 어렵다. 또한 실험 결과에 대한 정량적 평가(정확도, 정밀도, F1 등)가 제시되지 않아, 제안 모델의 실제 성능을 객관적으로 검증하기 어렵다.

결론적으로, 이 연구는 베이즈 확률 모델과 얕은 신경망을 결합해 대규모 텍스트 흐름에서 정서 톤을 빠르게 추정하는 실용적인 프레임워크를 제공한다. 특히 실시간 뉴스 모니터링 및 시각화에 적용된 사례는 정보 과부하 시대에 의미가 크다. 향후 연구에서는 보다 정교한 언어 모델(워드 임베딩, 트랜스포머 등)과의 비교, 다국어·다도메인 적용 가능성 검증, 그리고 정량적 성능 평가를 통해 모델의 일반화 능력을 강화할 필요가 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기