스무스 마진을 활용한 부스팅 알고리즘 분석

초록

본 논문은 부스팅 알고리즘의 수렴 특성을 분석하기 위해 미분 가능하도록 설계된 “스무스 마진 함수”를 도입한다. 이를 기반으로 좌표 상승 부스팅과 근사 좌표 상승 부스팅 두 알고리즘을 제안하고, 기존의 AdaBoost와 Breiman의 arc‑gv에 대한 수렴 속도와 최적 마진 수렴을 정량적으로 비교한다. 특히 약학습기의 에지 값이 제한된 경우 AdaBoost가 달성할 수 있는 마진을 정확히 상한·하한으로 규정함으로써 R̈atsch‑Warmuth 경계가 정확히 타이트함을 증명한다. 또한 사이클 현상이 발생하는 경우 스무스 마진을 이용해 AdaBoost의 동작을 명시적으로 설명한다.

상세 분석

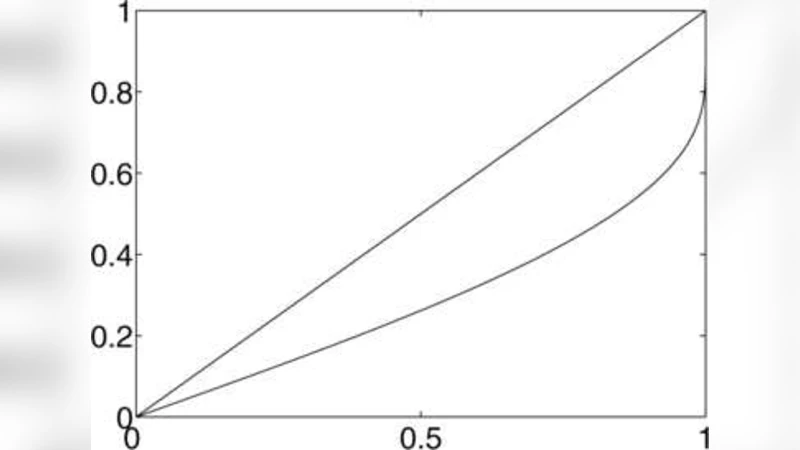

논문은 먼저 전통적인 마진 정의가 이산적이고 최적화에 부적합함을 지적하고, 이를 연속적이고 미분 가능한 형태인 스무스 마진 함수 ( \Upsilon(r)= -\ln(1-r^{2})\ln\frac{1+r}{1-r} ) 로 대체한다. 이 함수는 마진이 0에 가까울 때 급격히 증가하고, 마진이 1에 접근하면 완만해지는 특성을 가져, 부스팅 과정에서의 단계 크기(step size)와 직접 연결된다.

스무스 마진을 목적함수로 삼은 두 알고리즘, ‘좌표 상승 부스팅(Coordinate Ascent Boosting, CAB)’과 ‘근사 좌표 상승 부스팅(Approximate Coordinate Ascent Boosting, ACAB)’을 제시한다. CAB는 매 반복마다 현재 스무스 마진을 가장 크게 증가시키는 약학습기를 선택하고, 그에 대응하는 가중치를 정확히 최적화한다. ACAB은 계산량을 줄이기 위해 가중치 업데이트를 근사적으로 수행하지만, 이 역시 스무스 마진을 비감소하게 만든다. 두 알고리즘 모두 좌표 상승 방식이므로 전통적인 AdaBoost와 달리 목표 함수와 직접 연결되어 있다.

수렴 분석에서는 스무스 마진이 기하급수적으로 0에 수렴하는 대신, 최대 마진 ( \rho_{\max} ) 에 선형적으로 접근함을 보인다. 구체적으로, CAB와 ACAB은 ( O\big(\frac{\log m}{\epsilon^{2}}\big) ) 단계 안에 마진 오차 ( \epsilon ) 이하로 만들 수 있음을 증명한다. 여기서 ( m ) 은 학습 샘플 수이다. 이와 대조적으로, 기존 arc‑gv는 최대 마진에 수렴한다는 사실만 알려졌으며, 수렴 속도에 대한 명시적 경계는 없었다. 논문은 arc‑gv에 대해서도 동일한 ( O(\frac{\log m}{\epsilon^{2}}) ) 속도를 도출함으로써 기존 연구의 공백을 메운다.

AdaBoost에 대한 새로운 통찰은 ‘에지 제한(bounded edges)’ 상황에서 얻어진다. 약학습기의 에지 ( \gamma_t ) 가 구간 \

댓글 및 학술 토론

Loading comments...

의견 남기기