엔트로피와 인지·상대성: 새로운 일반 엔트로피 이론의 탐구

본 논문은 샤논 엔트로피를 확장한 ‘일반 엔트로피’를 제안하고, 확률을 지수분포 형태의 성능 함수로 정의한다. 인지는 양·음(陰陽)이라는 두 힘의 상호작용으로 설명되며, 황금비점에서 실제 불확실성과 인지된 불확실성이 일치한다는 수학적 관계를 제시한다. 시그모이드 함수가 실제 성능을 나타낸다고 주장하고, 특수 상대성 이론의 시간 지연을 인지 현상으로 재해석한다. 마지막으로 손글씨 일본어 문자 인식 실험을 통해 제안된 이론을 적용하고, 새로운 네트…

저자: Stefan Jaeger

이 논문은 샤논이 제시한 엔트로피 정의를 일반화하여, 서로 다른 확률 사건들의 정보를 하나의 통합된 형태로 다루는 새로운 ‘일반 엔트로피’를 제안한다. 기존 샤논 엔트로피 H = −∑p(i)ln p(i) 에서 확률 p(i) 대신 ‘정보 자체에 대한 확률’ p(K_i)를 사용하고, 이를 K_i = −p(K_i)ln p(K_i) 로 표현한다. 저자는 p(K_i) 가 확률의 합이 1이 될 필요가 없으며, 대신 지수분포 형태의 누적분포 함수 1−e^{−K_iE} 로 정의한다. 여기서 E는 기대값이며, λ = 1/E 로 파라미터화된 지수분포와 동일한 형태를 가진다.

이러한 정의를 바탕으로 ‘성능 정리’를 제시한다. 즉, 분류기 C가 출력하는 신뢰도 K와 그 성능 p(K) 사이에 K = −E ln(1−p(K)) 라는 고정점 관계가 성립한다면, p(K) 는 지수분포를 따른다. 이 식을 변형하면 p(K) = 1−e^{−K/E} 가 되며, 이는 신뢰도가 클수록 성능이 1에 가까워지는 형태를 보여준다.

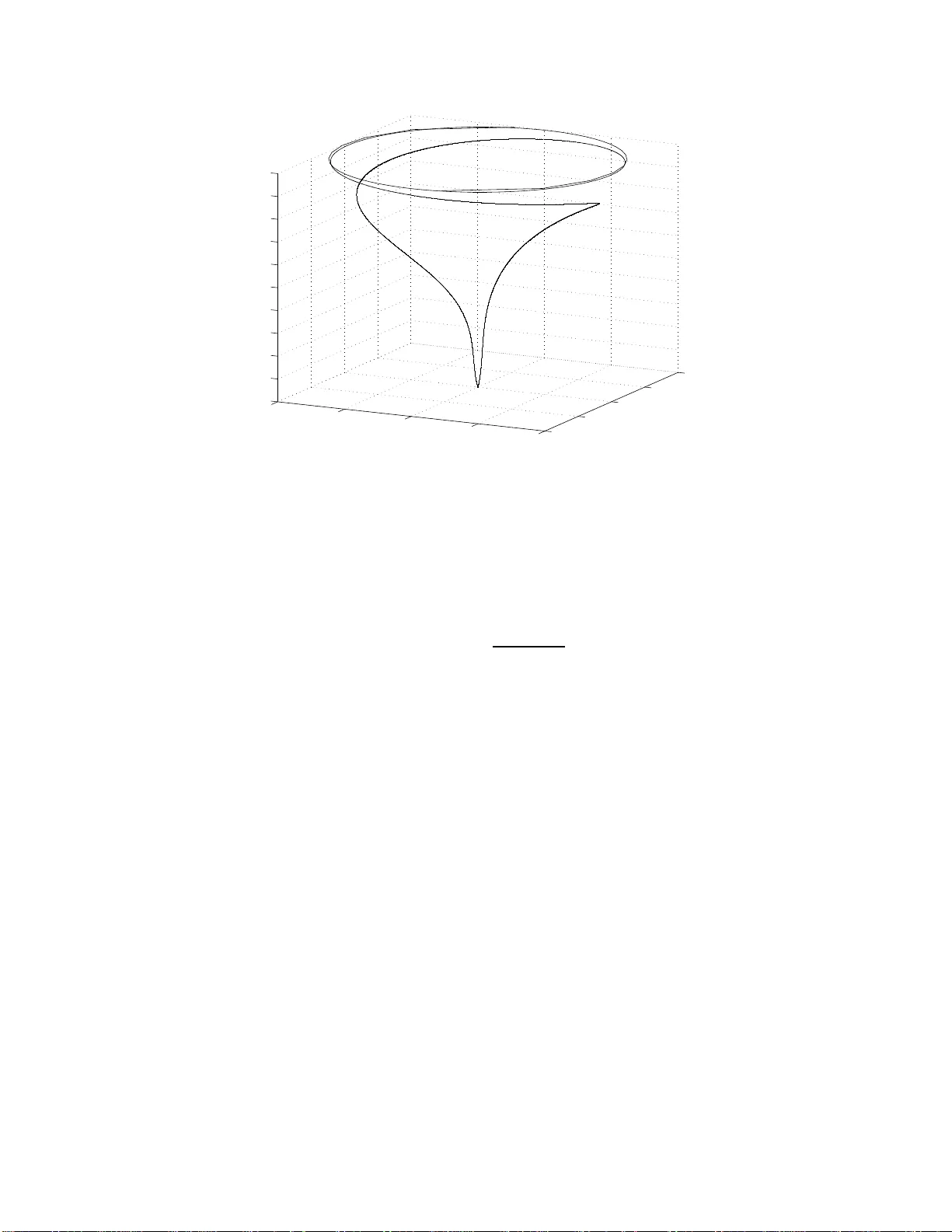

다음으로 저자는 인간의 의사결정을 두 상반되는 힘, Force A와 Force B 로 모델링한다. Force A는 위의 성능 정리를 그대로 사용해 K = −E ln(1−p(K)) 로 정의하고, Force B는 K = −E ln p(K) 로 정의한다. 두 힘의 차이를 이용해 순 힘을 K = −E ln

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기