가우시안 혼합을 이용한 메시지 전달 기반 격자 디코더

본 논문은 저밀도 격자 코드(LDLC) 디코딩 과정에서 메시지를 가우시안 혼합 형태로 명시적으로 표현하고, 혼합에 포함된 가우시안 수가 급격히 증가하는 문제를 해결하기 위해 N개의 가우시안을 M개의 가우시안(M<N)으로 압축하는 알고리즘을 제안한다. 제안된 압축은 두 가우시안의 1차·2차 모멘트를 보존하는 단일 가우시안으로 대체하고, 가우시안 간의 제곱 차이(GQL)를 비용 함수로 사용한다. 실험 결과, 차원 100의 격자에서 10⁻⁵ 수준의 …

저자: Brian M. Kurkoski, Justin Dauwels

본 논문은 저밀도 격자 코드(Low‑Density Lattice Codes, LDLC)의 메시지 전달 디코딩을 가우시안 혼합(Gaussian Mixture) 형태로 정확히 기술하고, 혼합에 포함된 가우시안 성분 수가 디코딩 반복 과정에서 급격히 증가하는 문제를 해결하기 위한 새로운 압축 알고리즘을 제안한다.

1. **배경 및 동기**

- 격자는 고차원 통신·암호·소스 코딩 등 다양한 분야에서 핵심 구조로 활용된다. 특히 AWGN 채널에서 격자 코드는 Shannon 한계에 도달할 수 있음을 이론적으로 증명했으며, 실제 구현을 위해 LDLC가 제안되었다.

- LDLC는 희소 역생성 행렬 H(=G⁻¹)를 이용해 메시지 전달(베일리프 전파) 방식으로 디코딩한다. 메시지는 연속값 확률분포이며, Gaussian noise가 존재하므로 정확히 가우시안 혼합 형태로 표현될 수 있다.

- 그러나 체크 노드와 변수 노드에서 수행되는 스케일링·컨볼루션·곱셈 연산은 매 반복마다 가우시안 성분 수를 곱하게 되어, N이 초기 1이라도 몇 번의 반복 후에는 수천~수만 개가 된다. 직접 구현은 메모리·연산량이 폭발적으로 증가해 실용적이지 않다. 기존 연구는 메시지를 양자화하거나 근사함으로써 복잡도를 낮췄지만, 가우시안 구조를 무시하면 성능 저하가 발생한다.

2. **가우시안 혼합 압축(GMR) 알고리즘 설계**

- **목표**: N개의 가우시안을 M개의 가우시안(M≤N)으로 대체하면서 원래 혼합과의 차이를 최소화한다.

- **손실 함수**: 두 확률분포 p, q 사이의 제곱 차이(Squared Difference, SD) 를 정의하고, 이를 Gaussian Quadratic Loss(GQL)라 명명한다. GQL는 입력 혼합과 그와 동일한 1차·2차 모멘트를 갖는 단일 가우시안 사이의 L2 거리 제곱이다.

- **두 가우시안 합성**: 두 가우시안 (m₁, v₁, c₁)와 (m₂, v₂, c₂)를 하나의 가우시안 (m, v, 1)으로 대체한다. 여기서 m = c₁m₁ + c₂m₂, v = c₁(m₁²+v₁)+c₂(m₂²+v₂) – m² 로 계산한다(모멘트 매칭). 이 변환은 KL‑다이버전스 최소화와 동등하며, GQL를 최소화하는 해는 존재한다.

- **그리디 절차**: 현재 혼합 리스트 C에서 모든 쌍의 GQL을 계산하고 최소값을 갖는 쌍을 선택한다. 선택된 두 가우시안을 위의 모멘트 매칭으로 하나로 합치고, 원래 두 성분을 리스트에서 삭제한다. 이 과정을 리스트 길이가 목표 M 이하가 되거나 최소 GQL이 사전 정의된 임계값 θ 를 초과할 때까지 반복한다. 알고리즘은 O(N²) 비용으로 최소 GQL을 찾으며, 매 합성 단계마다 N이 1씩 감소하므로 전체 복잡도는 O(N³)이다.

3. **LDLC 디코더에 GMR 적용**

- **체크 노드**: 입력 메시지 q_k(z) (각각 가우시안 혼합) 를 스케일링(e_qk) 후 컨볼루션을 수행한다. 컨볼루션은 순차적으로 a_k(z)와 b_k(z) 라는 중간 결과를 만든 뒤, 전방·후방 알고리즘을 이용해 최종 e_rk(z)를 얻는다. 각 컨볼루션 단계 후에 GMR을 적용해 a_k(z)·b_k(z) 의 가우시안 수를 제한한다.

- **변수 노드**: 입력 r_k(z) 들을 곱하고 정규화한다. 곱셈 연산 역시 가우시안 곱셈으로 변환되며, 결과는 모든 입력 혼합의 카르테시안 곱으로 N₁·N₂·…·N_{d-1} 개의 성분을 만든다. 여기서도 GMR을 적용해 성분 수를 제한한다.

- **전체 흐름**: 초기 메시지는 채널 관측 y_i 로부터 단일 가우시안(평균 y_i, 분산 σ²) 으로 시작한다. 각 반복마다 체크·변수 노드 연산 후 GMR을 수행해 전체 복잡도를 선형 수준(≈O(nd·M)) 으로 유지한다.

4. **실험 및 성능 평가**

- **설정**: 차원 n=100, 밀도 d=7인 매직 스퀘어 LDLC를 사용. 가우시안 혼합 압축 목표 M은 실험적으로 8~12 정도로 설정했으며, 허용 GQL 임계값 θ는 10⁻⁴ 수준으로 지정하였다.

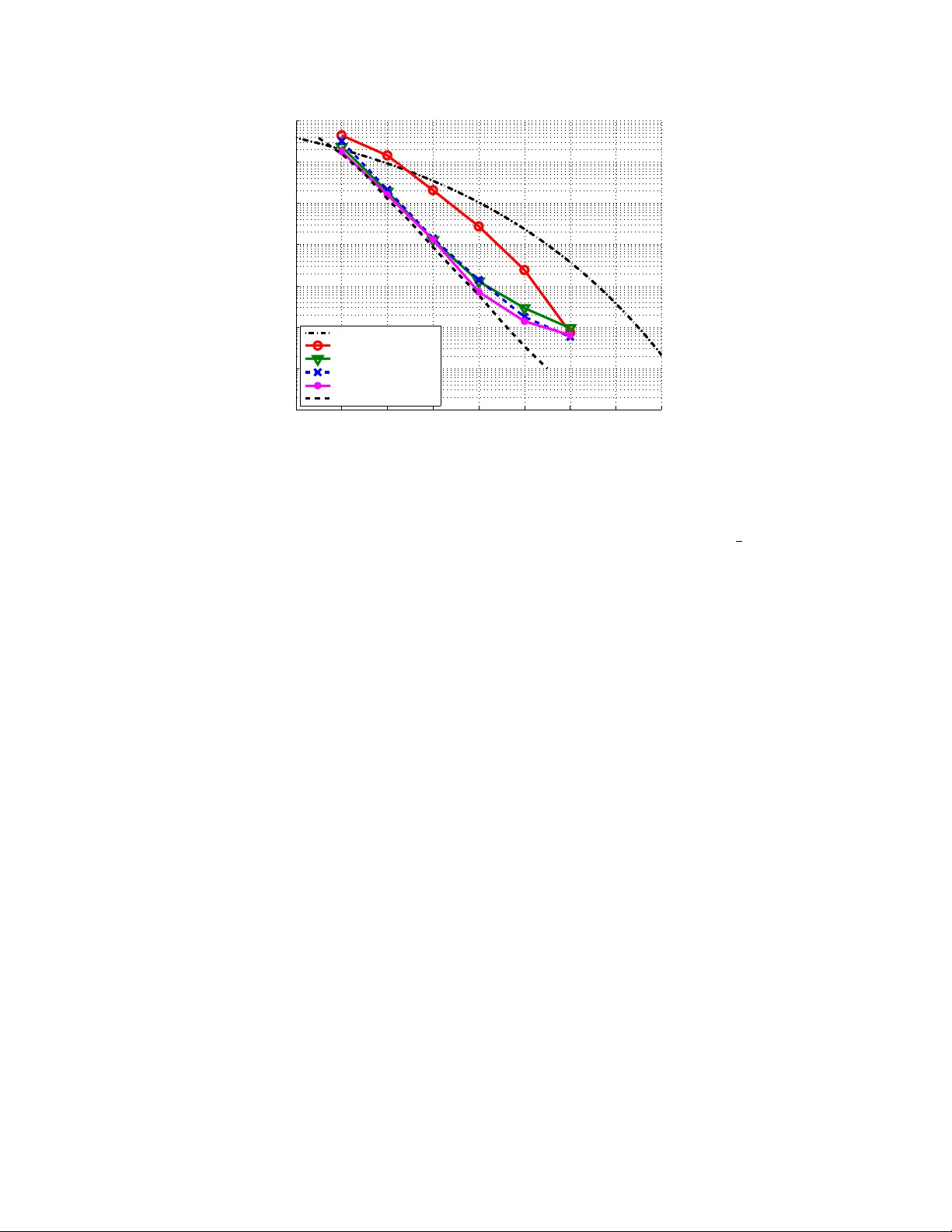

- **결과**: 심볼 오류 확률(P_e) = 10⁻⁵ 일 때, 기존 LDLC 디코더와 비교해 SNR 손실은 0.2 dB에 불과했다. 이는 가우시안 혼합을 그대로 활용하면서도 성분 수를 크게 줄인 결과이며, 복잡도는 O(10⁴) 연산 수준으로 크게 감소했다.

- **비교**: 양자화 기반 메시지 전달 방식은 동일 조건에서 약 0.8~1.0 dB의 손실을 보였으며, GMR 기반 방법이 더 정확한 근사와 낮은 복잡도를 동시에 달성함을 확인했다.

5. **의의 및 향후 과제**

- 본 연구는 LDLC 디코딩을 연속값 확률분포 수준에서 정확히 다루는 첫 번째 시도 중 하나이며, 가우시안 혼합 압축을 위한 GQL 기반 그리디 알고리즘을 제시함으로써 실용적인 고차원 격자 디코더 구현의 길을 열었다.

- 향후 연구는 (1) GMR의 최적화(예: 히스토그램 기반 클러스터링, 병렬 구현)으로 실시간 처리 속도 향상, (2) 다른 손실 함수(KL, Wasserstein)와의 비교, (3) 비가우시안 잡음 모델(예: 임펄스 잡음)에서의 확장, (4) LDPC·Turbo와 같은 다른 베일리프 전파 기반 코딩 구조에의 적용을 제안한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기