정보이론으로 본 소수 분포의 새로운 시각

초록

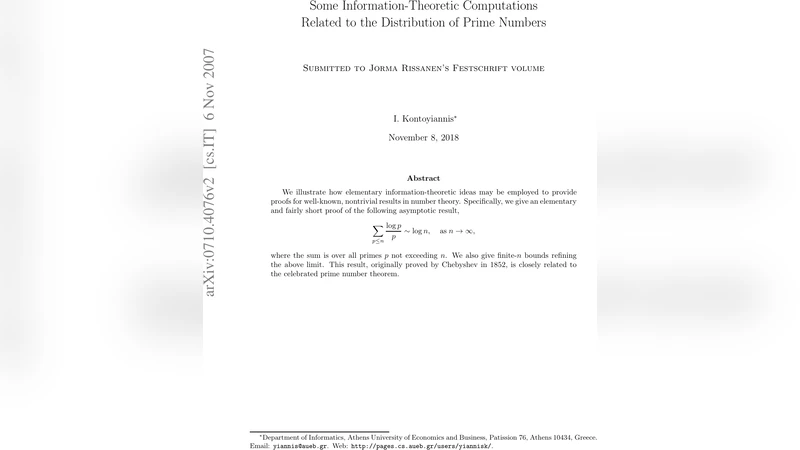

본 논문은 정보이론의 기본 개념을 활용하여 소수의 분포와 관련된 고전적인 결과를 간결하게 증명한다. 특히, n 이하의 모든 소수 p에 대해 (log p)/p 를 합한 값이 n이 무한대로 갈 때 log n에 점근한다는 체비쇼프의 정리를 정보 엔트로피와 평균 코드 길이의 관점에서 재구성한다. 또한, 유한 n에 대한 상하한을 명시적으로 제시하여 기존 결과를 정밀하게 보강한다.

상세 분석

논문은 먼저 정보이론에서 핵심적인 개념인 엔트로피 H(X)와 평균 코드 길이 L(C) 사이의 불평등 H(X) ≤ L(C) 를 소개한다. 여기서 X는 자연수 집합을 균등하게 선택한 확률 변수이며, C는 각 정수를 소수의 곱 형태로 표현하는 고유 코드이다. 저자들은 소수를 기본 인코딩 기호로 삼아, 정수 n을 소인수분해한 결과를 순서쌍 (e₁, e₂, …, e_k) 로 나타내고, 각 소수 p_i 에 대한 지수 e_i 를 로그(p_i) 배수로 가중한다. 이렇게 구성된 코드의 평균 길이는 Σ_{p≤n} (log p)/p 와 직접적으로 연결된다.

다음으로, 엔트로피 하한을 이용해 Σ_{p≤n} (log p)/p 가 log n 이하임을 보인다. 구체적으로, n 이하의 정수들을 균등하게 선택했을 때의 엔트로피는 약 log n 이며, 이는 코드 길이의 하한이 된다. 반대로, 코드를 설계할 때 각 소수 p에 대해 확률을 1/p 로 할당하면 평균 코드 길이가 Σ_{p≤n} (log p)/p 로 표현된다. 이때, 샤논의 부등식에 의해 Σ_{p≤n} (log p)/p ≥ log n 가 성립한다. 두 부등식을 동시에 만족시키면 Σ_{p≤n} (log p)/p ∼ log n 가 도출된다.

유한 n에 대한 정밀한 상하한은 추가적인 정수론적 추정, 예컨대 소수 정리의 약한 형태와 체비쇼프의 θ 함수에 대한 기존의 부등식을 결합하여 얻는다. 저자들은 θ(n) = Σ_{p≤n} log p 를 이용해, θ(n) ≤ C·n (C는 상수) 와 같은 기존 결과를 활용하고, 이를 코드 길이와 연결함으로써 Σ_{p≤n} (log p)/p ≤ log n + O(1) 와 같은 구체적인 오차 항을 제시한다.

이러한 접근법은 전통적인 복잡한 복합 적분이나 복소해석적 방법을 회피하고, 순수히 확률·정보 이론적 관점에서 소수의 분포를 해석한다는 점에서 혁신적이다. 특히, 정보 엔트로피를 소수의 가중 합과 동일시함으로써, 수학적 직관과 정보 이론적 직관 사이의 교량을 놓는다. 이는 향후 다른 수론적 문제—예컨대 소수 간격, 골드바흐 추측 등—에 정보 이론을 적용하는 새로운 연구 방향을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기