자동인코더·PCA·SVR 기반 데이터 결측값 복원 비교 연구

본 논문은 남아프리카 HIV 인구통계 데이터를 대상으로 자동인코더 신경망, 주성분 분석(PCA) 적용 자동인코더, 그리고 서포트 벡터 회귀(SVR)를 결합한 유전 알고리즘 최적화 방식을 비교한다. 각 모델의 학습·검증 절차와 결측값 예측 정확도를 제시하며, PCA가 자동인코더의 학습 효율을 높이고, SVR이 향후 연구에 유망함을 보여준다. 최고 97.4%의 정확도를 기록하였다.

저자: Vukosi N. Marivate, Fulufhelo V. Nelwamodo, Tshilidzi Marwala

본 논문은 남아프리카공화국의 산전 클리닉에서 수집된 HIV 인구통계 데이터를 활용해 결측값을 복원하는 세 가지 회귀 기반 모델을 비교한다. 연구 배경으로는 결측 데이터가 조사·연구에 미치는 부정적 영향을 강조하고, 결측 메커니즘을 Little와 Rubin이 정의한 MCAR, MAR, Non‑ignorable 세 유형으로 구분한다. 이러한 메커니즘에 따라 회귀 모델을 이용한 추정이 필요함을 제시한다.

첫 번째 모델은 다층 퍼셉트론(MLP) 구조의 자동인코더이다. 입력과 출력 차원을 동일하게 두고, 은닉층에 입력보다 적은 노드를 배치해 ‘병목’ 효과를 만든다. 활성화 함수는 외부에 선형, 내부에 하이퍼볼릭 탄젠트(tanh)를 사용했으며, Netlab MATLAB 툴박스로 구현하였다. 은닉 노드 수는 10개, 학습 사이클은 1,000번으로 설정하고, 검증 오차가 상승하기 시작하면 조기 종료를 적용해 과적합을 방지했다.

두 번째 접근은 주성분 분석(PCA)을 전처리 단계에 도입한 PCA‑ANN이다. 원본 11차원 데이터를 평균 중심화 후 공분산 행렬을 계산하고, 고유값·고유벡터를 추출한다. 고유값이 큰 순서대로 10개의 주성분을 선택해 차원을 10으로 축소하거나, 축소 없이 변환만 수행하는 두 버전을 만든다. 축소된 데이터는 자동인코더에 입력되어 학습 효율이 향상된다. PCA‑ANN‑10은 은닉 노드 9개, 학습 사이클 동일하게 1,000번으로 설정했으며, 압축 전후의 정확도 차이를 비교했다. 결과는 차원 축소가 학습 시간과 메모리 사용량을 크게 감소시키면서도 전체 정확도에 미치는 영향이 미미함을 보여준다.

세 번째 모델은 서포트 벡터 회귀(SVR)이다. RBF 커널을 사용했으며, 정규화 파라미터 C와 ε‑insensitive 손실, RBF 폭을 최적화한다. 학습 데이터는 시간 제약으로 3,000건만 사용했지만, 검증 세트에서 낮은 오차를 기록했다. 파라미터 최적화에는 유전 알고리즘을 적용했으며, 초기 인구를 무작위로 생성하고 적합도 함수를 최소화하는 방향으로 진화시켰다.

결측값 복원 과정은 모든 모델에 공통적으로 유전 알고리즘을 활용한다. 알려진 입력값을 고정하고, 결측값을 유전 알고리즘이 생성한 후보값으로 채워 회귀 모델에 입력한다. 모델은 전체 레코드를 재구성하고, 재구성된 레코드와 실제 레코드 간의 오차를 적합도 함수로 사용한다. 선택·교차·돌연변이 연산을 반복해 오차가 최소화된 후보값을 최종 결측값으로 채운다.

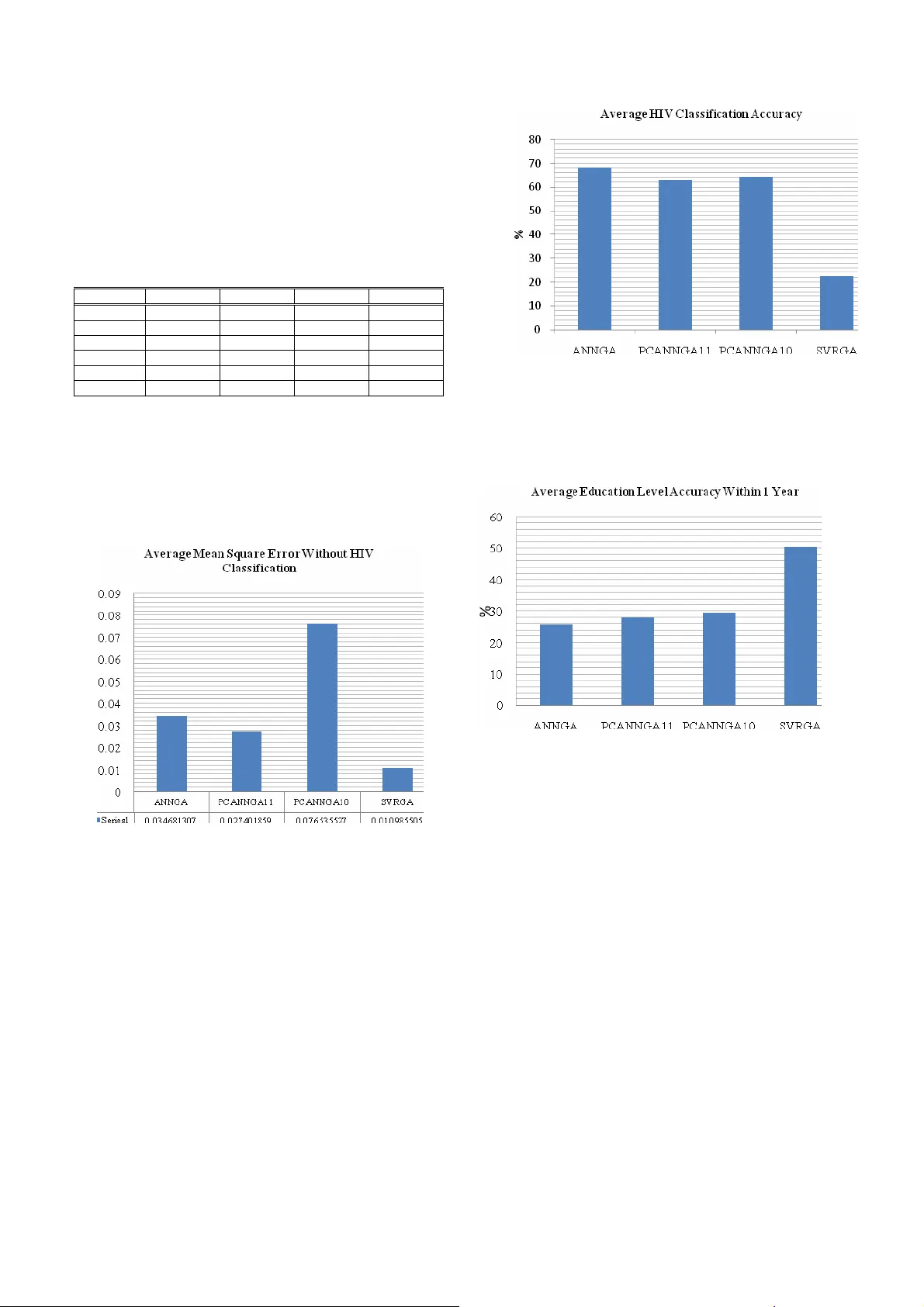

실험 결과, 변수별 복원 정확도는 80%에서 97.4%까지 다양했으며, 특히 HIV 상태와 교육 수준 같은 변수에서 높은 정확도를 보였다. 자동인코더는 가장 높은 정확도를 제공했지만, 학습 시간과 메모리 요구가 크다는 단점이 있다. PCA‑ANN은 차원 축소를 통해 연산 효율을 크게 개선하면서도 정확도 손실이 거의 없었다. SVR은 파라미터 튜닝이 핵심이며, 제한된 데이터에서도 경쟁력 있는 성능을 나타냈다.

논문의 한계점으로는 데이터 전처리 과정에서 문자열을 정수로 매핑하는 단순 변환, 이상치 제거 후 데이터 손실, 그리고 SVR 학습에 사용된 데이터 양이 제한적이었다는 점을 들었다. 또한, 결측 메커니즘이 실제 모델 선택에 미치는 영향을 정량적으로 분석하지 못했다. 향후 연구에서는 더 큰 규모의 데이터셋, 다중 결측 패턴, 딥러닝 기반 변형(예: 변분 자동인코더, GAN 기반 데이터 보강) 등을 적용해 모델의 일반화 능력을 검증할 필요가 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기