멀티피직스 확장을 위한 OpenFMO 프레임워크

초록

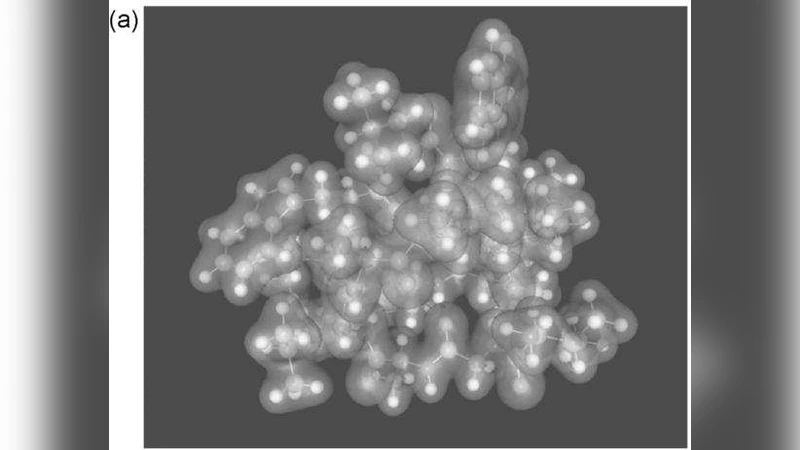

OpenFMO는 조각 분자 궤도(FMO) 계산을 위한 오픈소스 플랫폼이다. 본 논문은 OpenFMO를 다중물리 시뮬레이션(MPS) 환경에 적용하기 위한 구조적 확장을 제안한다. 분산 컴퓨팅에서의 기존 FMO 구현 사례를 검토하고, 경량·재구성 가능한 모듈형 설계와 대규모·통합형 설계 사이의 선택 기준을 논의한다. 최종적으로는 멀티피직스 연계 시 요구되는 데이터 흐름, 인터페이스 표준화, 성능 최적화를 위한 로드맵을 제시한다.

상세 분석

OpenFMO는 기존에 고성능 클러스터와 그리드 환경에서 FMO 계산을 수행하도록 설계된 모듈형 OSS이다. 이 프레임워크는 조각별 전자밀도 계산, 상호작용 에너지 집계, 그리고 결과 통합을 각각 독립적인 프로세스로 분리함으로써 병렬 효율성을 극대화한다. 논문은 먼저 이러한 구조가 대규모 분산 시스템에서 어떻게 구현됐는지를 상세히 정리한다. 예를 들어, MPI 기반의 작업 스케줄링, 파일 기반 데이터 교환, 그리고 파라미터화된 스크립트 엔진을 활용한 자동 워크플로우가 소개된다.

멀티피직스 시뮬레이션을 지원하기 위해서는 전자구조 계산 외에 분자역학, 양자역학/분자역학(QM/MM), 전자기·열 전달 등 다양한 물리 모델과의 연계가 필요하다. 이를 위해 저자는 두 가지 설계 방향을 제시한다. 첫 번째는 “경량·재구성 가능” 형태로, 핵심 FMO 엔진을 최소화하고 외부 물리 모듈과의 인터페이스를 표준 API(예: JSON-RPC, Protocol Buffers)로 정의한다. 이렇게 하면 새로운 물리 모델을 플러그인 형태로 손쉽게 추가할 수 있으며, 개발·배포 주기가 짧아진다. 두 번째는 “대규모·통합형” 형태로, 모든 물리 모듈을 하나의 실행 파일에 포함시켜 내부 데이터 공유와 메모리 최적화를 도모한다. 이는 높은 성능을 요구하는 대규모 시뮬레이션에 유리하지만, 코드 복잡도와 유지보수 비용이 크게 증가한다.

논문은 두 접근법의 트레이드오프를 정량적으로 평가한다. 경량형은 초기 개발 비용이 낮고, 다양한 HPC 환경(클라우드, 엣지)에서 유연하게 배포될 수 있다. 그러나 인터페이스 호출 오버헤드와 데이터 직렬화 비용이 누적될 경우 전체 실행 시간이 증가한다. 반면 통합형은 메모리 내 직접 데이터 전달과 캐시 친화적 연산이 가능해 스케일업 시 효율이 크게 향상된다. 하지만 코드베이스가 비대해져 버그 추적이 어려워지고, 새로운 물리 모델을 추가하려면 전체 재컴파일이 필요하다.

또한 저자는 멀티피직스 연계 시 발생하는 데이터 의존성 문제를 해결하기 위한 “데이터 흐름 그래프” 설계를 제안한다. 각 물리 모듈을 노드로, 데이터 교환을 엣지로 표현한 그래프는 런타임 스케줄러가 동적 최적화를 수행하도록 지원한다. 이를 통해 불필요한 동기화 지연을 최소화하고, 비동기식 파이프라인을 구현할 수 있다.

마지막으로 향후 로드맵을 제시한다. 초기 단계에서는 경량형 API를 공개하고, 커뮤니티 기반 플러그인 생태계를 조성한다. 중기 목표는 데이터 흐름 그래프 기반 자동 스케줄링 엔진을 구현해 복합 물리 시뮬레이션의 효율성을 검증하는 것이다. 장기적으로는 통합형 고성능 버전을 제공해 초대형 시스템(Exascale)에서도 OpenFMO 기반 멀티피직스 시뮬레이션이 원활히 수행될 수 있도록 한다.

댓글 및 학술 토론

Loading comments...

의견 남기기