주관적 정보 측정과 레이트‑피델리티 이론

본 논문은 물고기 덮개 모델을 이용해 Hartley의 정보공식에서 시작해 조건 확률과 논리적 조건 확률을 구분함으로써 주관적 정보를 측정하는 일반화된 정보공식을 단계적으로 도출한다. 메트릭, 감각, 의미 정보를 모두 포괄하며, Popper의 지식 진화 이론과의 연계성을 논한다. 또한 오류 제한률(rate‑of‑limiting‑errors)을 도입해 Kolmogorov 복잡도 기반의 복잡도‑왜곡 이론과 연결하고, Shannon의 왜곡 대신 주관적…

저자: Chenguang Lu

본 논문은 “물고기 덮개”라는 직관적 모델을 통해 Hartley의 고전적 정보공식 I = log N을 시작점으로 삼아, 조건 확률과 논리적 조건 확률을 구분함으로써 주관적 정보를 측정하는 일반화된 정보공식을 단계적으로 도출한다.

Ⅰ. 서론에서는 저자가 13년 전 제안한 일반화 정보이론을 소개하고, 최근 Kolmogorov 기반 복잡도‑왜곡 이론과의 연관성을 발견했음을 밝힌다.

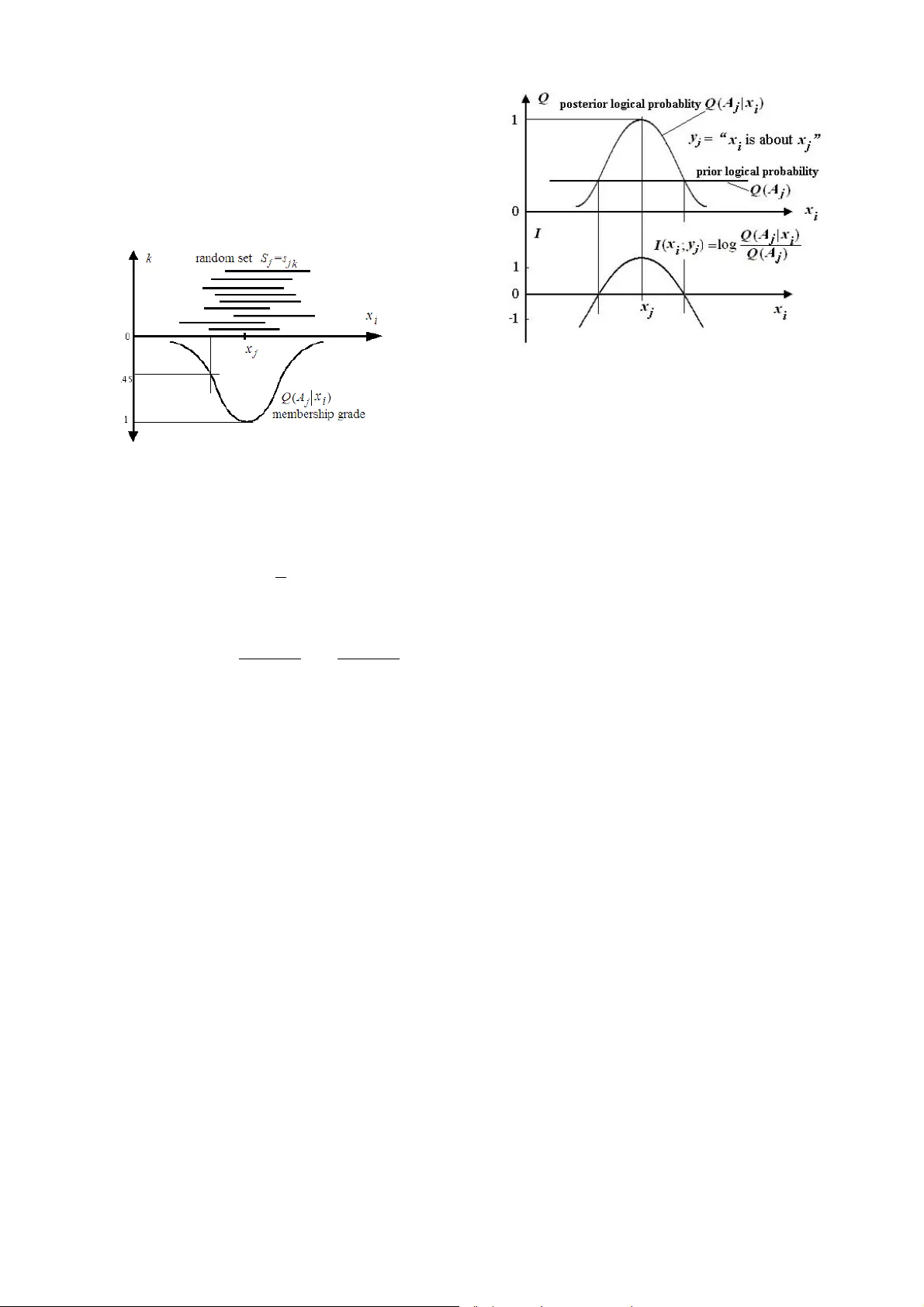

Ⅱ. Hartley 공식과 물고기 덮개 이야기를 통해 “상대 정보” I_r = log(N₁/N₂) 를 정의한다. 여기서 N₁은 전체 영역, N₂는 덮개가 차지하는 영역이며, 덮개가 작을수록 정보량이 커진다.

Ⅲ. 사건의 확률이 균등하지 않을 경우 1/N 대신 확률 P 로 일반화하여 I = log(1/P), I_r = log(P₂/P₁) 로 확장한다.

Ⅳ. 사건 집합 A와 메시지 집합 B 를 도입하고, 각 메시지 y_j 가 “x_i ∈ A_j” 형태임을 설정한다. 여기서 P(x_i | A_j)와 P(x_i | y_j) 를 구분한다. 전자는 실제 사건이 A_j 에 포함되는 확률, 후자는 메시지가 보고될 확률이다. 두 확률이 다르면 기존 Shannon 상호정보와 차이가 발생한다.

Ⅴ. 베이즈 정리를 이용해 P(x_i | A_j)=Q(A_j|x_i)·P(x_i)/Q(A_j) 로 나타내고, Q 를 0·1 값의 특징 함수(덮개가 물고기를 잡는지 여부)로 두어 “명확한 집합” 형태의 정보공식을 얻는다.

Ⅵ. Q 를

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기