어두운 세계를 밝히는 이벤트 카메라 기반 저조도 영상 초해상도

📝 원문 정보

- Title: Seeing the Unseen: Zooming in the Dark with Event Cameras

- ArXiv ID: 2601.02206

- 발행일: 2026-01-05

- 저자: Dachun Kai, Zeyu Xiao, Huyue Zhu, Jiaxiao Wang, Yueyi Zhang, Xiaoyan Sun

📝 초록 (Abstract)

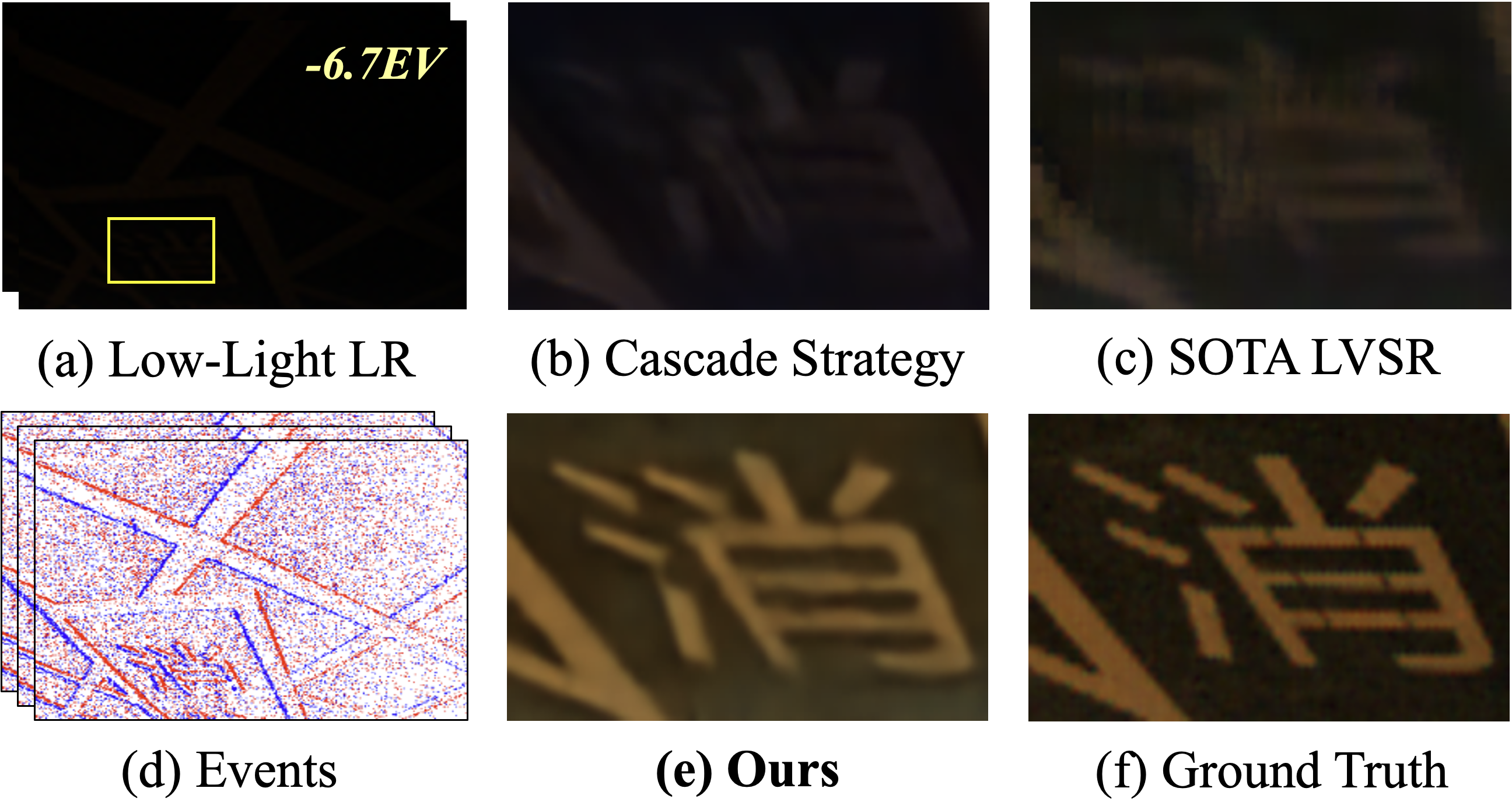

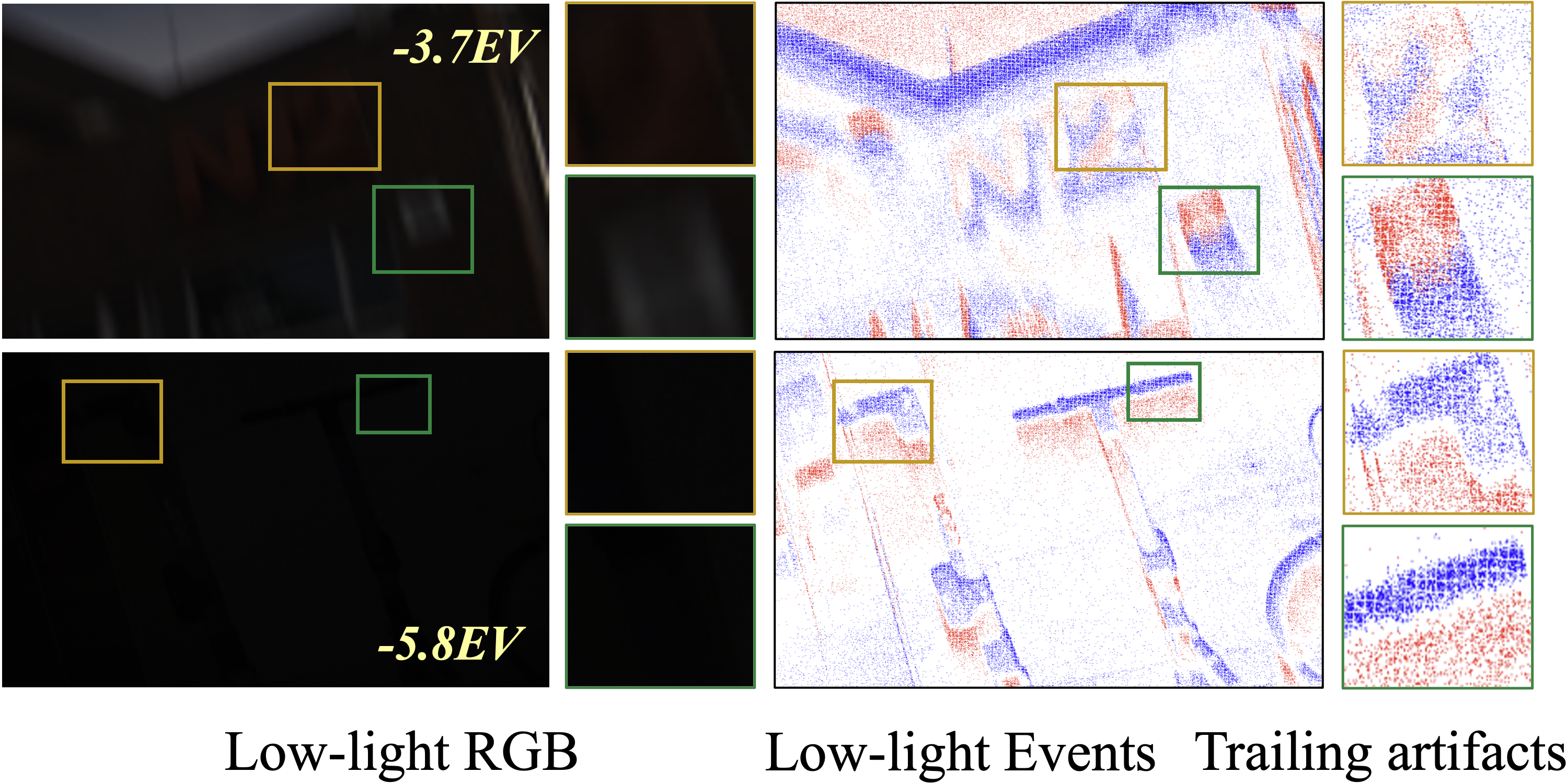

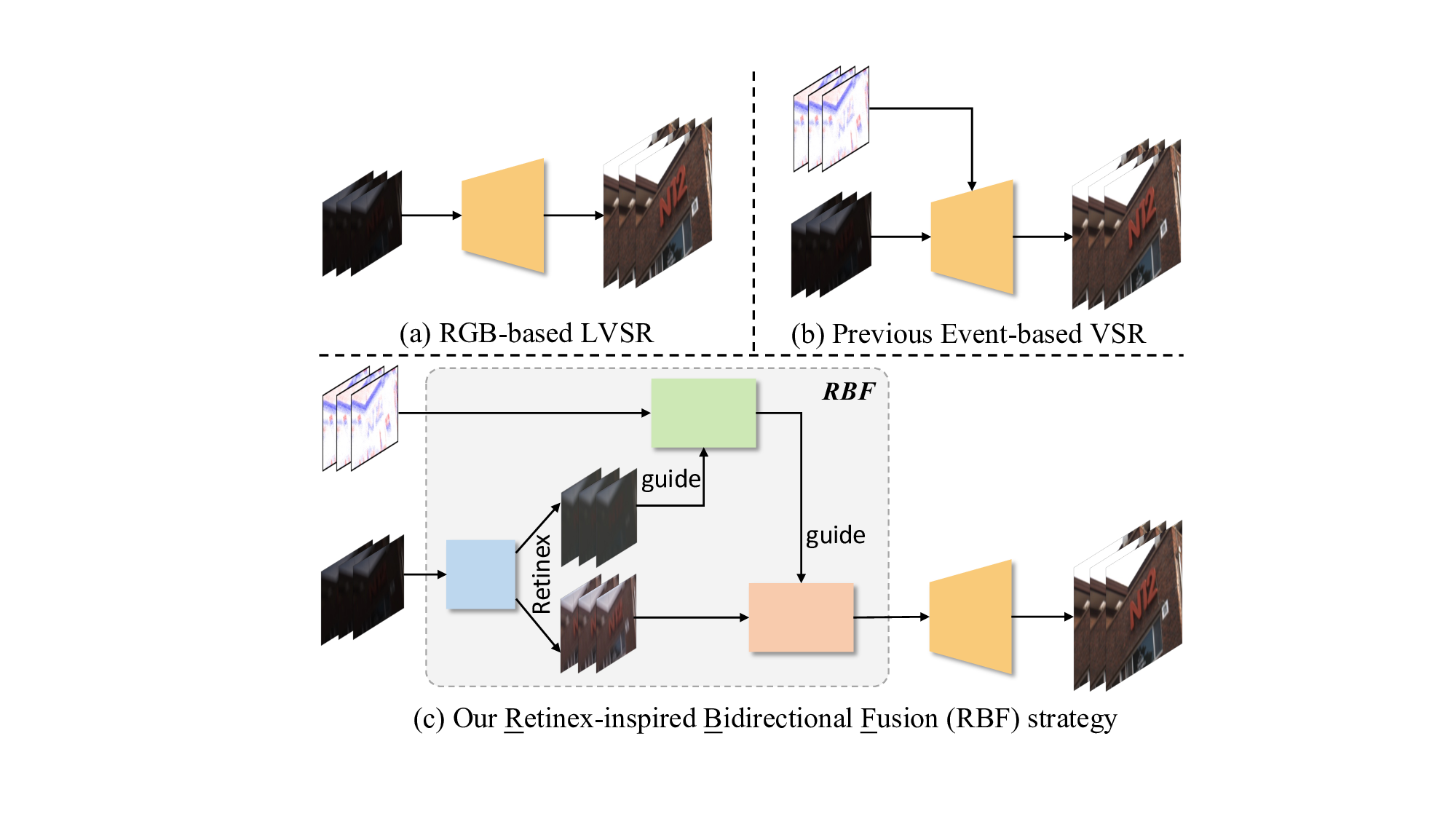

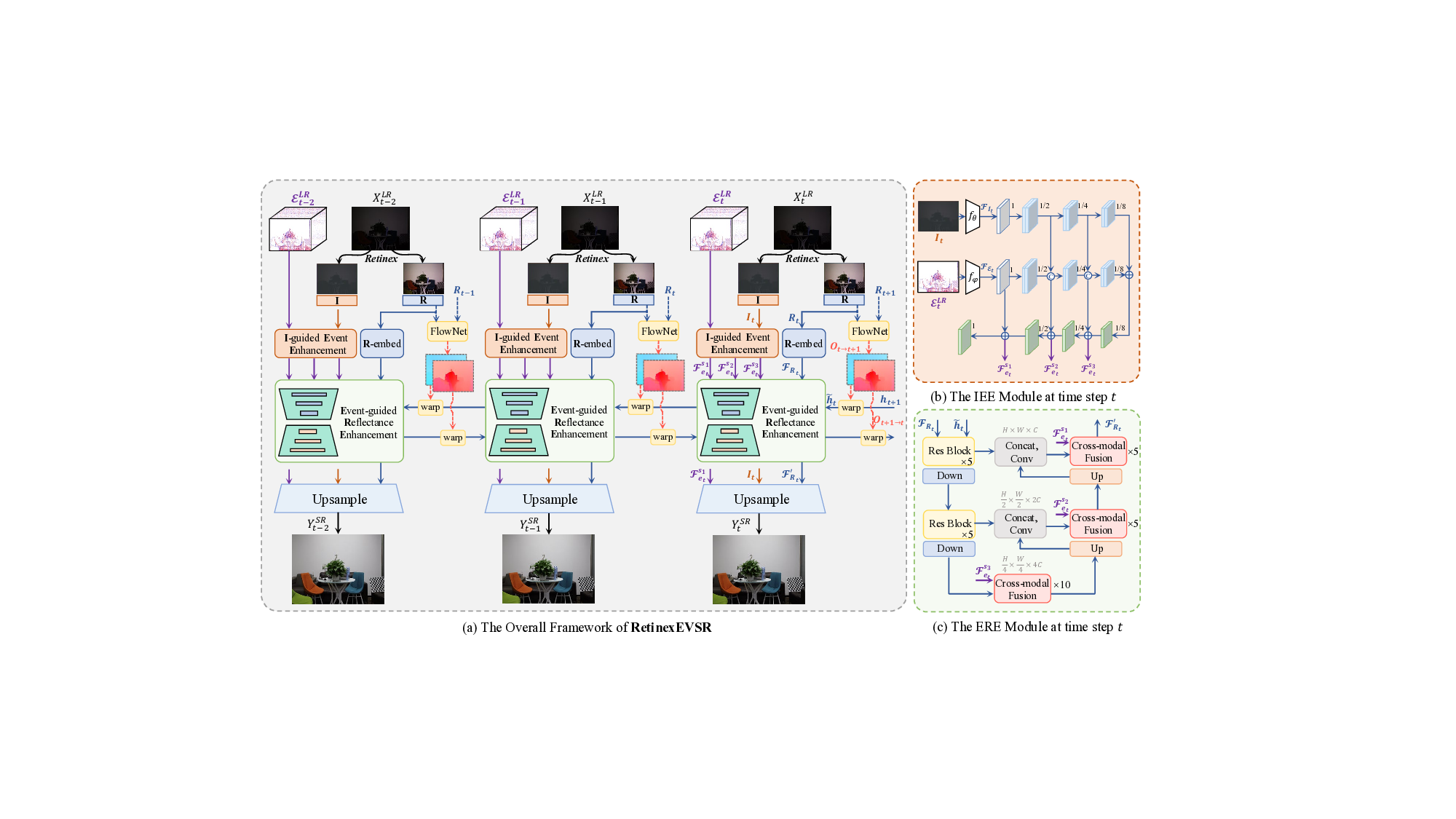

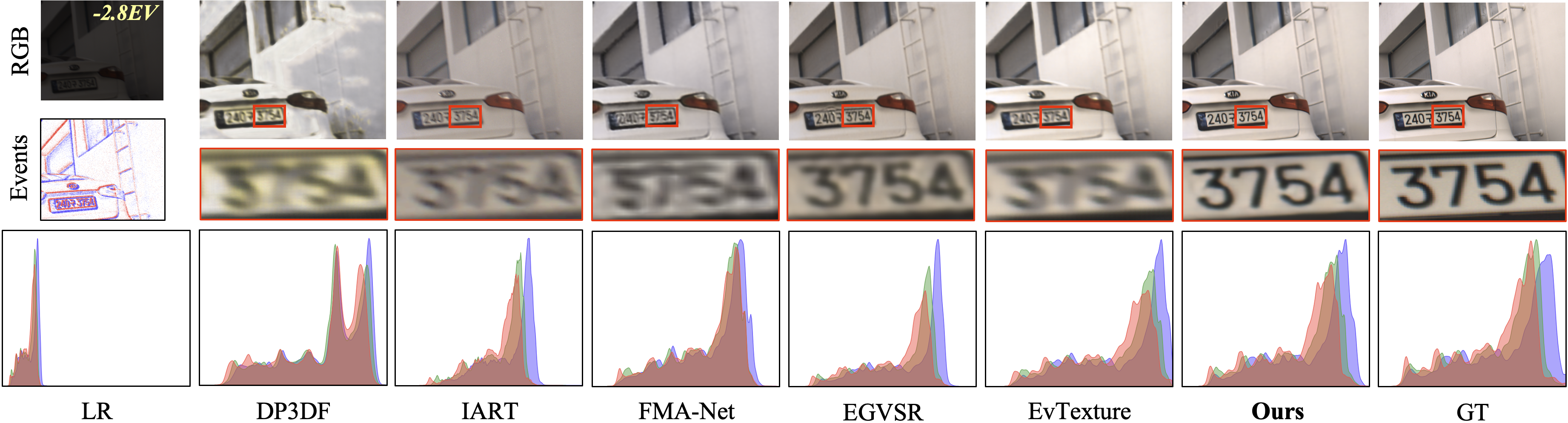

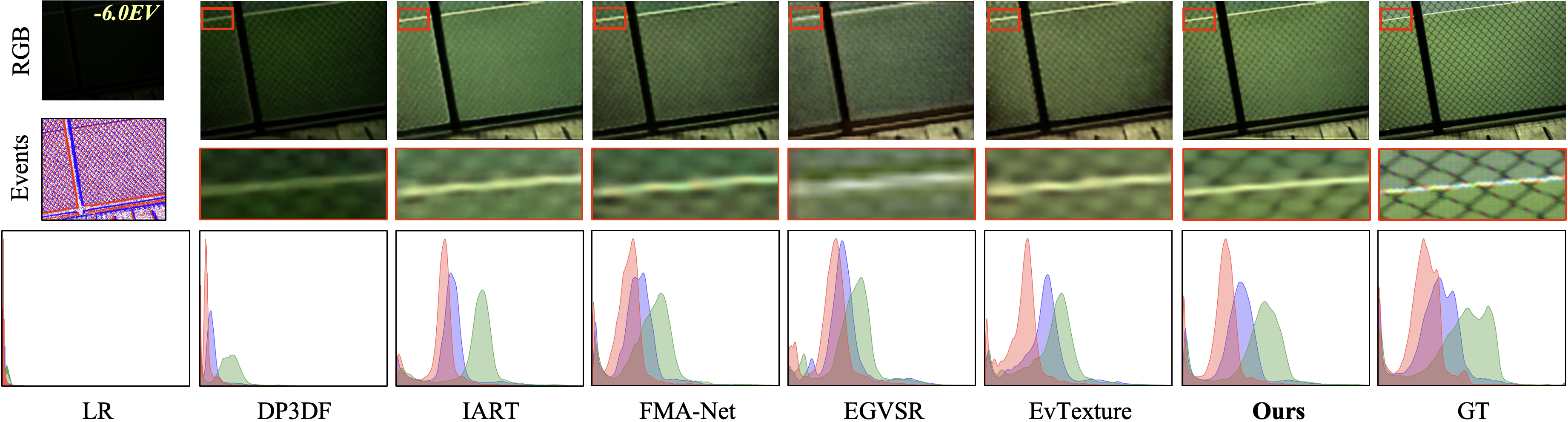

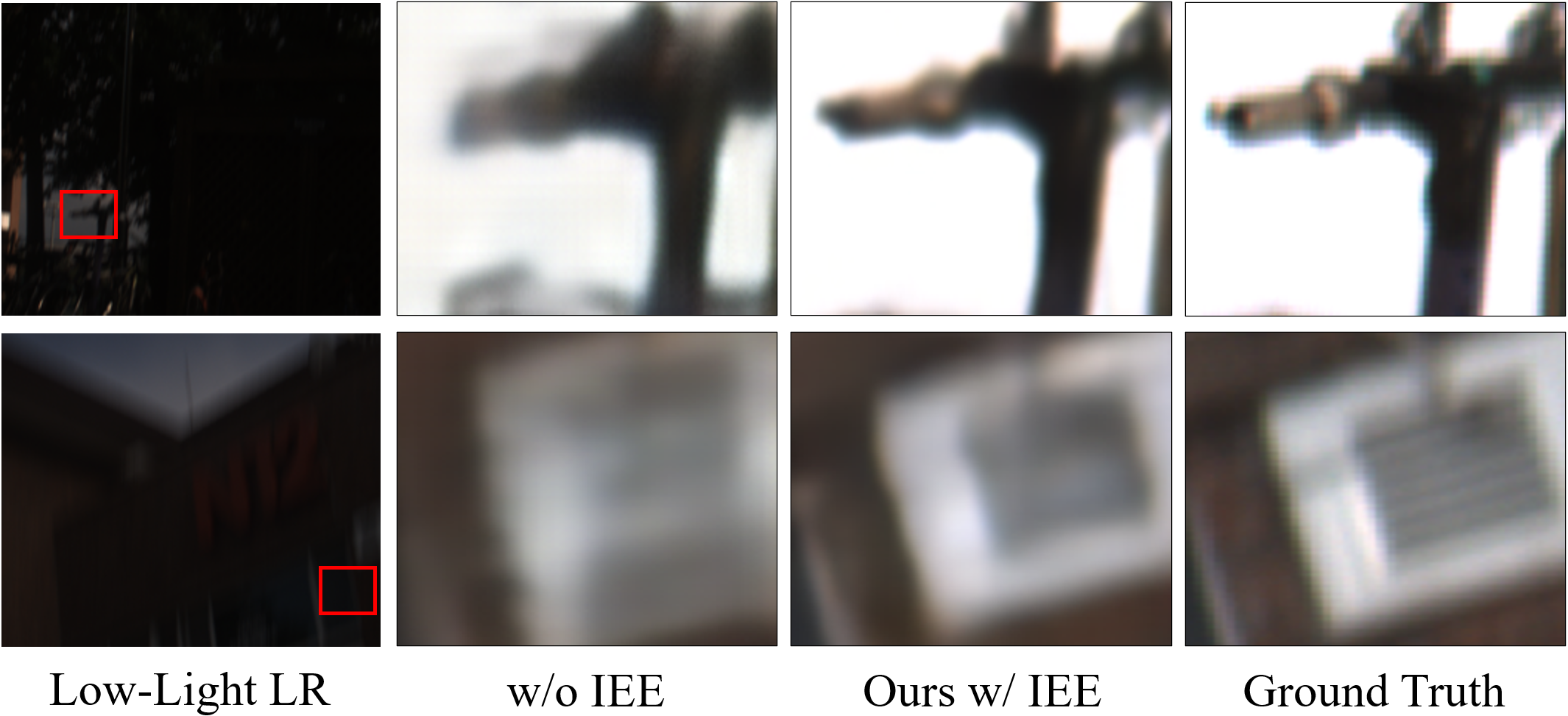

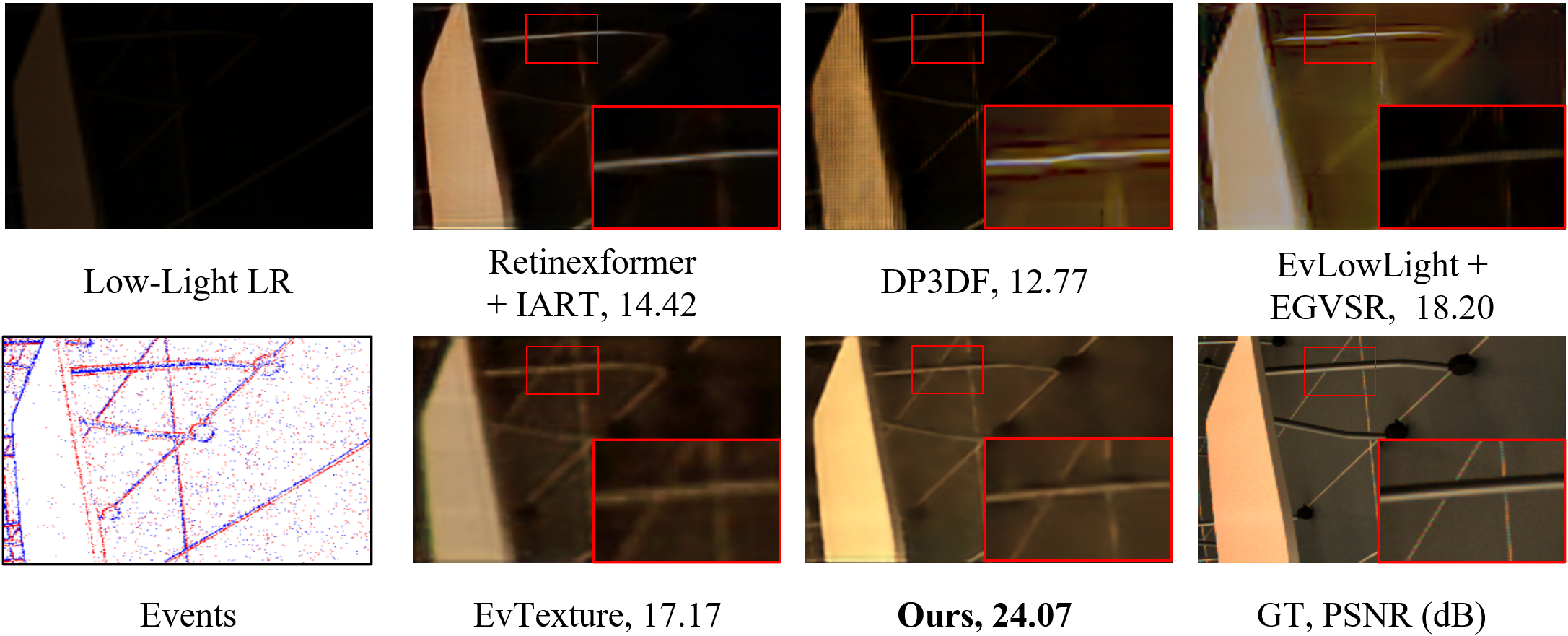

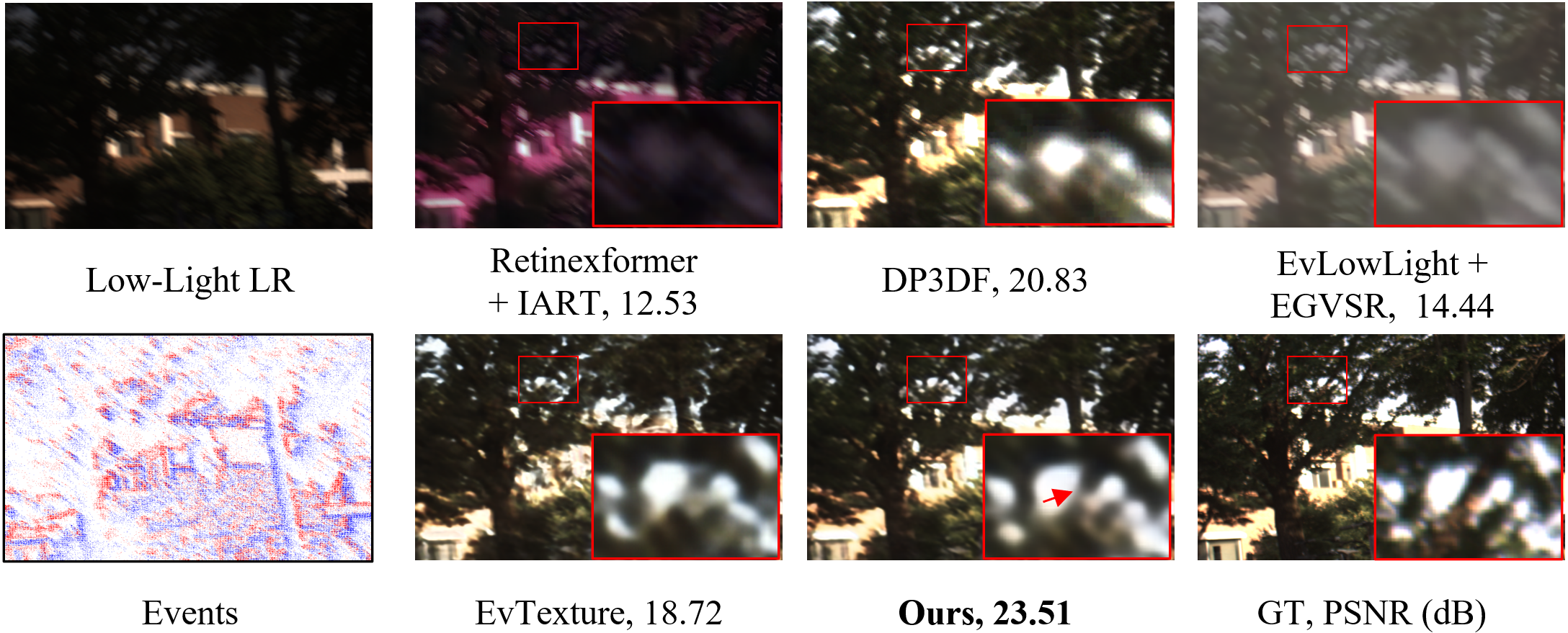

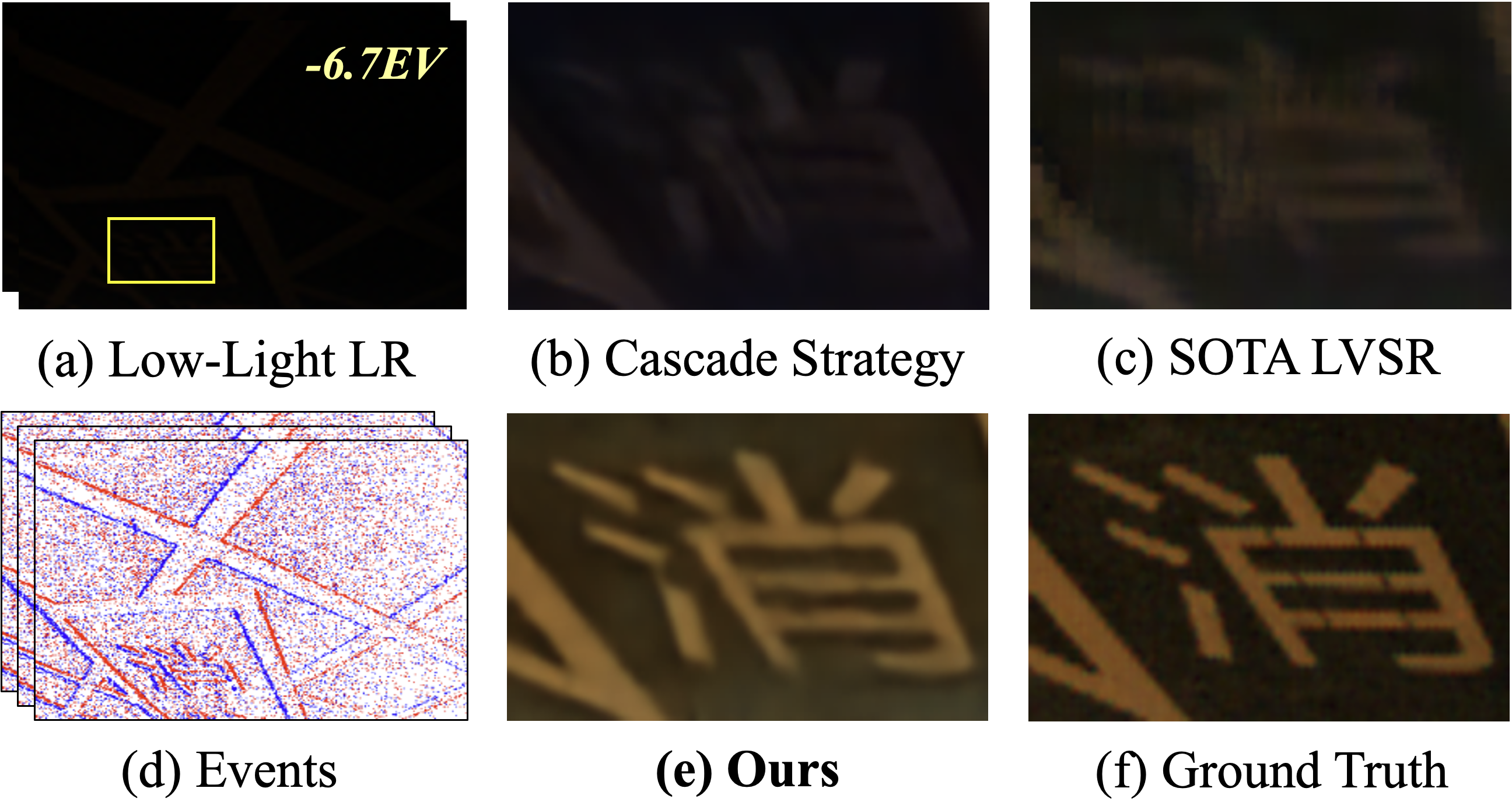

본 논문은 저조도 환경에서 저해상도 영상을 고해상도 영상으로 복원하는 저조도 영상 초해상도(LVSR) 문제를 다룬다. 기존 방법은 대비가 낮고 고주파 정보가 부족해 세부 디테일 복원에 한계가 있었는데, 저자는 이벤트 카메라의 고대비 이벤트 신호와 Retinex 이론을 결합한 RetinexEVSR 프레임워크를 제안한다. 양방향 교차 모달 융합 전략과 조명 가이드 이벤트 강화 모듈, 이벤트 기반 반사율 강화 모듈을 통해 저조도 잡음을 억제하고 세밀한 디테일을 회복한다. 실험 결과, 세 개 데이터셋에서 최첨단 성능을 달성했으며, 특히 SDSD 벤치마크에서 기존 이벤트 기반 방법 대비 최대 2.95 dB 향상과 65 % 감소된 실행 시간을 기록했다.💡 논문 핵심 해설 (Deep Analysis)

양방향 교차 모달 융합 전략은 RGB와 이벤트 두 모달리티 간의 상호 보완성을 극대화한다. 기존 연구들은 주로 RGB 프레임에 이벤트를 단순히 연결하거나, 이벤트만을 별도로 처리한 뒤 결과를 합치는 방식을 사용했지만, RetinexEVSR는 각각의 모달리티가 서로의 특징을 가이드하도록 설계했다. 이는 특히 조명 변화가 급격한 장면이나 움직임이 빠른 상황에서 두 신호가 서로의 약점을 보완해 전반적인 복원 품질을 끌어올린다.

실험에서는 세 개의 공개 데이터셋(SDSD, … 등)을 사용해 정량적 및 정성적 평가를 수행했으며, PSNR·SSIM 지표에서 기존 최첨단 방법들을 모두 앞섰다. 특히 SDSD 벤치마크에서 2.95 dB의 PSNR 향상은 저조도 환경에서 이벤트 기반 접근법의 잠재력을 입증한다. 또한, 제안된 네트워크는 경량화된 설계 덕분에 실행 시간도 65 % 단축돼 실시간 혹은 임베디드 시스템 적용 가능성을 높인다.

하지만 몇 가지 한계도 존재한다. 이벤트 카메라 자체의 하드웨어 비용과 데이터 포맷 변환 비용이 아직 상용화 단계에서는 부담이 될 수 있다. 또한, 매우 어두운 환경에서 이벤트 발생 자체가 적어 입력 신호가 희박해지는 경우, 현재 모듈이 충분히 강건한지 추가 검증이 필요하다. 향후 연구에서는 이벤트 센서의 감도 향상과 더 정교한 노이즈 모델링을 결합해 극한 저조도 상황에서도 안정적인 초해상도를 구현하는 방향이 기대된다.

📄 논문 본문 발췌 (Translation)

📸 추가 이미지 갤러리