넥스트플로우 통합 순차 모델링으로 다중모달 이해와 생성 활성화

📝 원문 정보

- Title: NextFlow: Unified Sequential Modeling Activates Multimodal Understanding and Generation

- ArXiv ID: 2601.02204

- 발행일: 2026-01-05

- 저자: Huichao Zhang, Liao Qu, Yiheng Liu, Hang Chen, Yangyang Song, Yongsheng Dong, Shikun Sun, Xian Li, Xu Wang, Yi Jiang, Hu Ye, Bo Chen, Yiming Gao, Peng Liu, Akide Liu, Zhipeng Yang, Qili Deng, Linjie Xing, Jiyang Liu, Zhao Wang, Yang Zhou, Mingcong Liu, Yi Zhang, Qian He, Xiwei Hu, Zhongqi Qi, Jie Shao, Zhiye Fu, Shuai Wang, Fangmin Chen, Xuezhi Chai, Zhihua Wu, Yitong Wang, Zehuan Yuan, Daniel K. Du, Xinglong Wu

📝 초록 (Abstract)

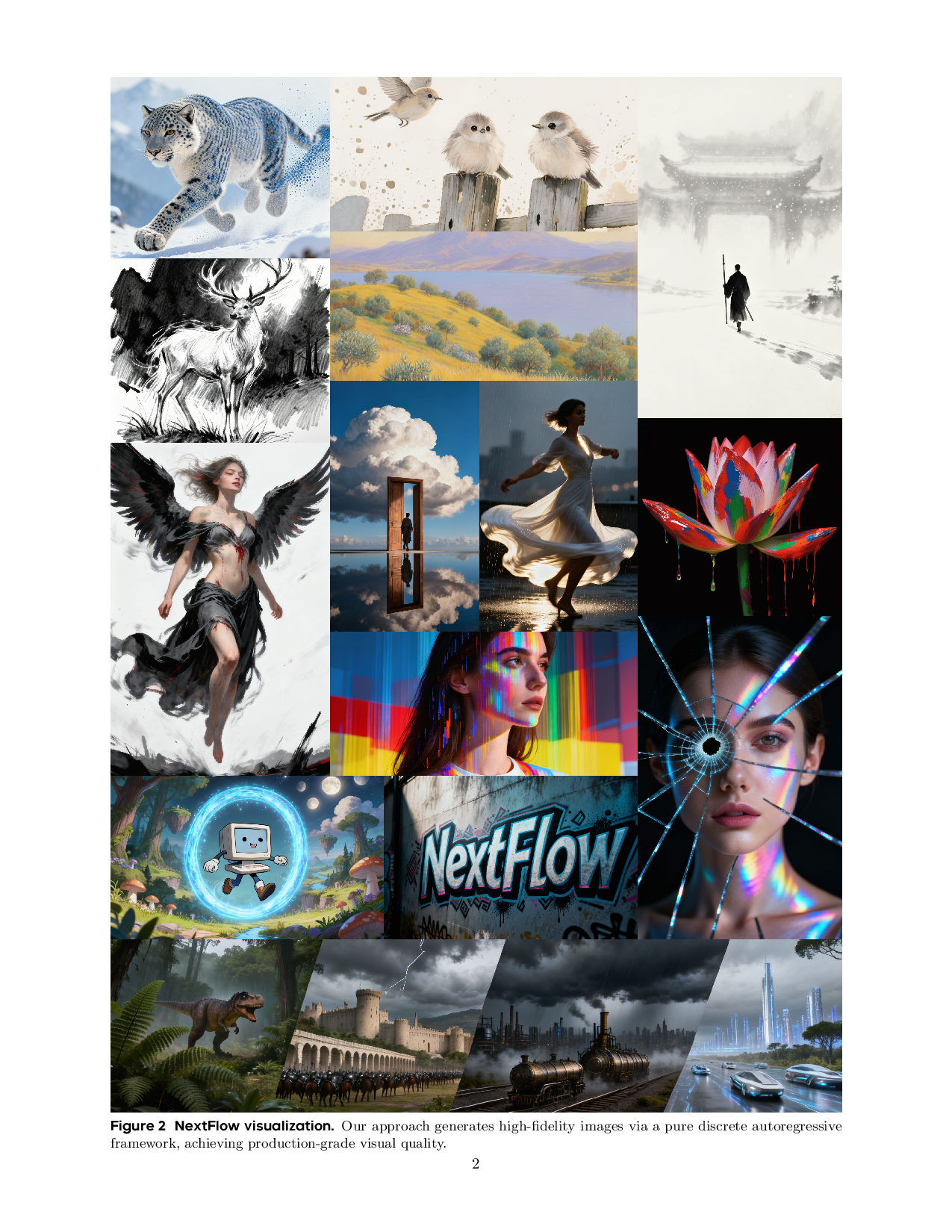

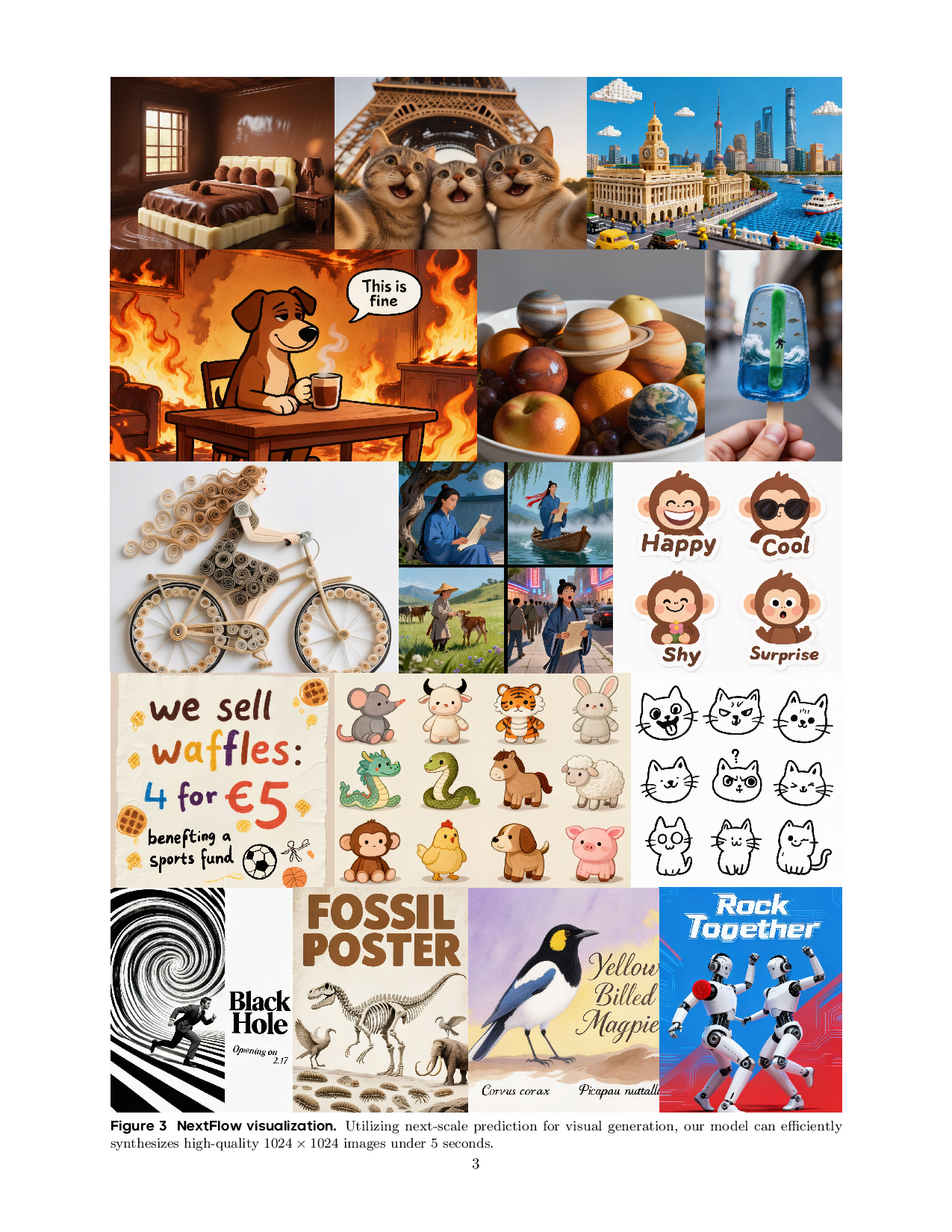

우리는 6조 개의 텍스트‑이미지 이산 토큰을 교차 배치한 데이터로 학습된 디코더‑전용 자동회귀 트랜스포머, NextFlow를 제시한다. 통합 비전 표현을 동일한 자동회귀 아키텍처에 도입함으로써 NextFlow는 다중모달 이해와 생성 능력을 자연스럽게 활성화하고, 이미지 편집, 교차 콘텐츠 및 비디오 생성과 같은 기능을 구현한다. 텍스트는 순차적 특성을 유지해 다음 토큰 예측을 사용하지만, 이미지의 계층적 특성을 반영해 시각 생성에서는 다음‑스케일 예측을 채택한다. 이는 기존의 래스터‑스캔 방식과 달리 1024 × 1024 해상도 이미지를 5초 내에 생성하도록 하여, 기존 자동회귀 모델 대비 수십 배 빠른 속도를 제공한다. 다중 스케일 생성의 불안정을 완화하기 위한 견고한 학습 레시피와 강화학습을 위한 프리픽스‑튜닝 전략도 제시한다. 실험 결과 NextFlow는 통합 모델 중 최첨단 성능을 달성했으며, 시각 품질 면에서 특화된 디퓨전 기반 베이스라인과 경쟁한다.💡 논문 핵심 해설 (Deep Analysis)

두 번째 한계는 시각 토큰의 의미적 밀도 부족이다. 기존 VQ‑VAE 기반 토크나이저는 픽셀 재구성에 최적화돼 고해상도 디테일을 보존하지만, 추상적 개념이나 객체 수준의 의미를 충분히 포착하지 못한다. 이는 텍스트와의 정렬을 어렵게 만들어 멀티모달 이해 성능을 저하시킨다. NextFlow는 ‘dual‑codebook tokenizer’를 사용해 의미 토큰과 픽셀 토큰을 별도로 인코딩한다. 의미 토큰은 높은 수준의 개념을, 픽셀 토큰은 세밀한 색·텍스처 정보를 담아 두 코드북을 동시 학습시킴으로써, 텍스트와 시각 정보 사이의 의미적 정합성을 크게 향상시킨다.

기술적 구현 측면에서 NextFlow는 순수 디코더‑전용 트랜스포머를 유지하면서도, 텍스트와 이미지 토큰을 동일한 시퀀스에 교차 배치한다. 이는 ‘통합 비전 표현’이라는 설계 철학과 맞물려, 별도의 인코더‑디코더 구조 없이도 이해와 생성을 동시에 수행할 수 있게 한다. 또한, 프리픽스‑튜닝을 통한 강화학습(RL) 적용은 특정 편집 작업(예: 색상 변경, 객체 추가)이나 전역 스타일 조정과 같은 고차원 제어를 가능하게 한다.

강점으로는 (1) 고해상도 이미지 생성 속도 혁신, (2) 의미‑픽셀 이중 토큰화로 멀티모달 정합성 강화, (3) 단일 모델로 이해·생성·편집·비디오까지 포괄하는 범용성, (4) 강화학습 기반 세밀 제어 메커니즘을 제공한다는 점이다. 반면 약점은 아직 공개된 실험이 제한적이며, 대규모 6조 토큰 학습 비용이 상당히 높다는 점이다. 또한, ‘next‑scale’ 방식이 매우 높은 해상도(예: 4K)나 복잡한 장면에서 품질 저하 없이 확장될 수 있는지에 대한 추가 검증이 필요하다.

학계와 산업계에 미치는 파급 효과는 크다. 기존 AR‑Diffusion 하이브리드 모델(Transfusion, Bagel)과 달리 토큰 레벨에서 완전한 통합을 이루어 재인코딩 오버헤드를 제거한다. 이는 실시간 멀티모달 인터페이스, 인터랙티브 이미지·비디오 편집, 그리고 텍스트‑이미지 동시 생성이 요구되는 생성형 AI 서비스에 직접 적용 가능하게 만든다. 향후 연구는 (i) 더 가벼운 토크나이저 설계, (ii) 스케일‑프리 전이 학습, (iii) 다양한 도메인(의료·과학·예술)으로의 확장 등을 통해 NextFlow의 실용성을 더욱 확대할 수 있을 것이다.

📄 논문 본문 발췌 (Translation)

📸 추가 이미지 갤러리