EverMemOS 구조화된 장기 추론을 위한 자가 조직 메모리 운영 체제

📝 원문 정보

- Title: EverMemOS: A Self-Organizing Memory Operating System for Structured Long-Horizon Reasoning

- ArXiv ID: 2601.02163

- 발행일: 2026-01-05

- 저자: Chuanrui Hu, Xingze Gao, Zuyi Zhou, Dannong Xu, Yi Bai, Xintong Li, Hui Zhang, Tong Li, Chong Zhang, Lidong Bing, Yafeng Deng

📝 초록 (Abstract)

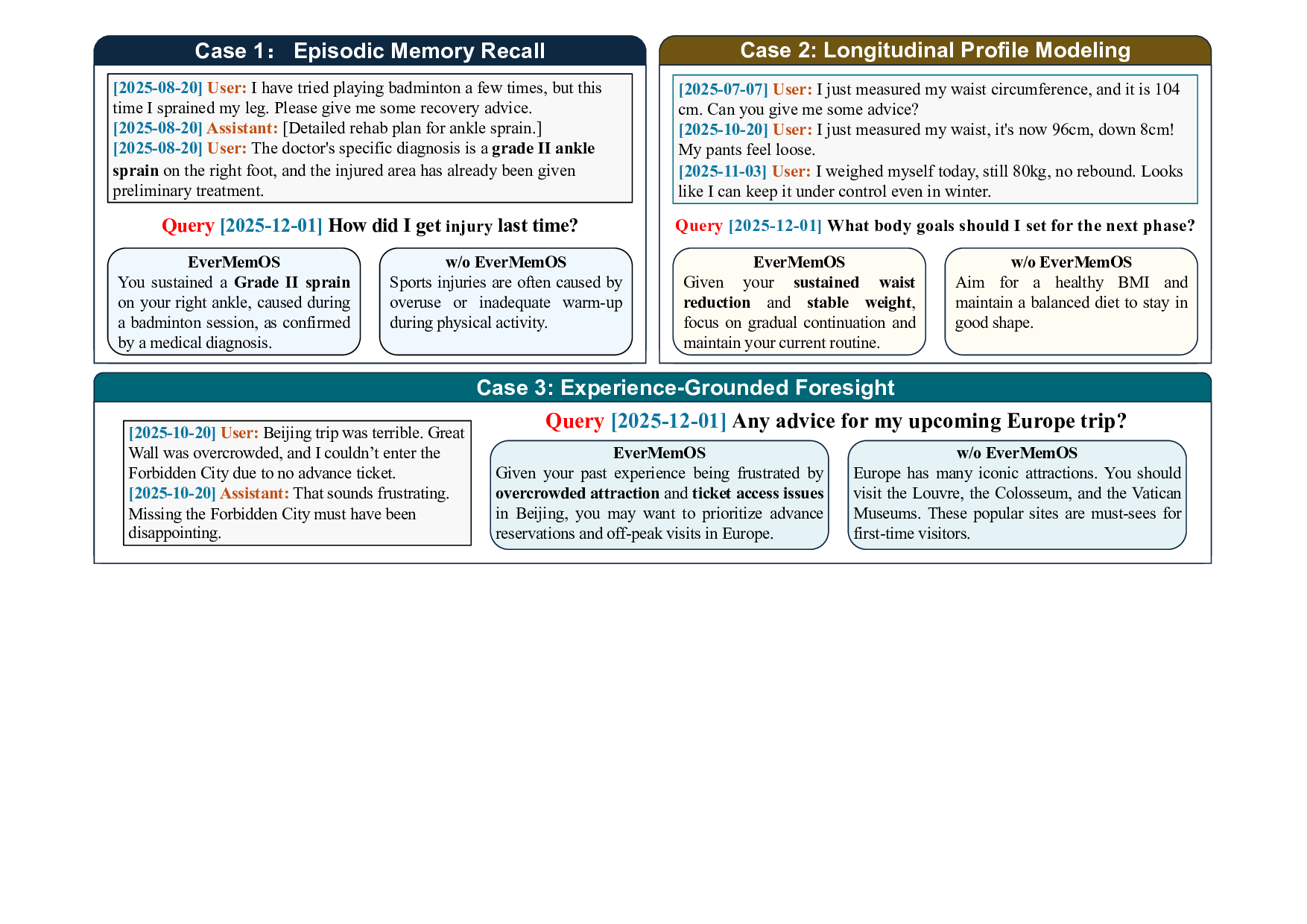

대형 언어 모델(LLM)이 장기 인터랙티브 에이전트로 점점 더 많이 활용되고 있지만, 제한된 컨텍스트 윈도우 때문에 장시간 상호작용에서 일관된 행동을 유지하기 어렵다. 기존 LLM 메모리 시스템은 개별 레코드를 저장하고 조각을 회수하는 방식에 머물러, 경험을 통합하고 갈등을 해결하는 능력이 부족하다. 본 논문에서는 기억의 인코드(engram) 메커니즘을 모방한 라이프사이클을 구현한 자가 조직 메모리 운영 체제 EverMemOS를 제안한다. 첫 단계인 에피소딕 트레이스 형성(Episodic Trace Formation)에서는 대화 흐름을 MemCell이라는 단위로 변환하여 에피소드 트레이스, 원자적 사실, 시간 제한 예측을 포착한다. 두 번째 단계인 의미 통합(Semantic Consolidation)에서는 MemCell을 주제별 MemScene으로 조직화하고, 안정적인 의미 구조를 추출하며 사용자 프로필을 갱신한다. 마지막 단계인 재구성 회상(Reconstructive Recollection)은 MemScene‑가이드 에이전트 검색을 수행해 하위 추론에 필요한 최소·충분한 컨텍스트를 구성한다. LoCoMo, Long‑MemEval, PersonaMem‑v2 벤치마크에서 EverMemOS는 메모리‑보강 추론 과제에서 최신 방법들을 크게 능가함을 실험적으로 입증한다. 코드와 모델은 https://github.com/EverMind-AI/EverMemOS 에 공개한다.💡 논문 핵심 해설 (Deep Analysis)

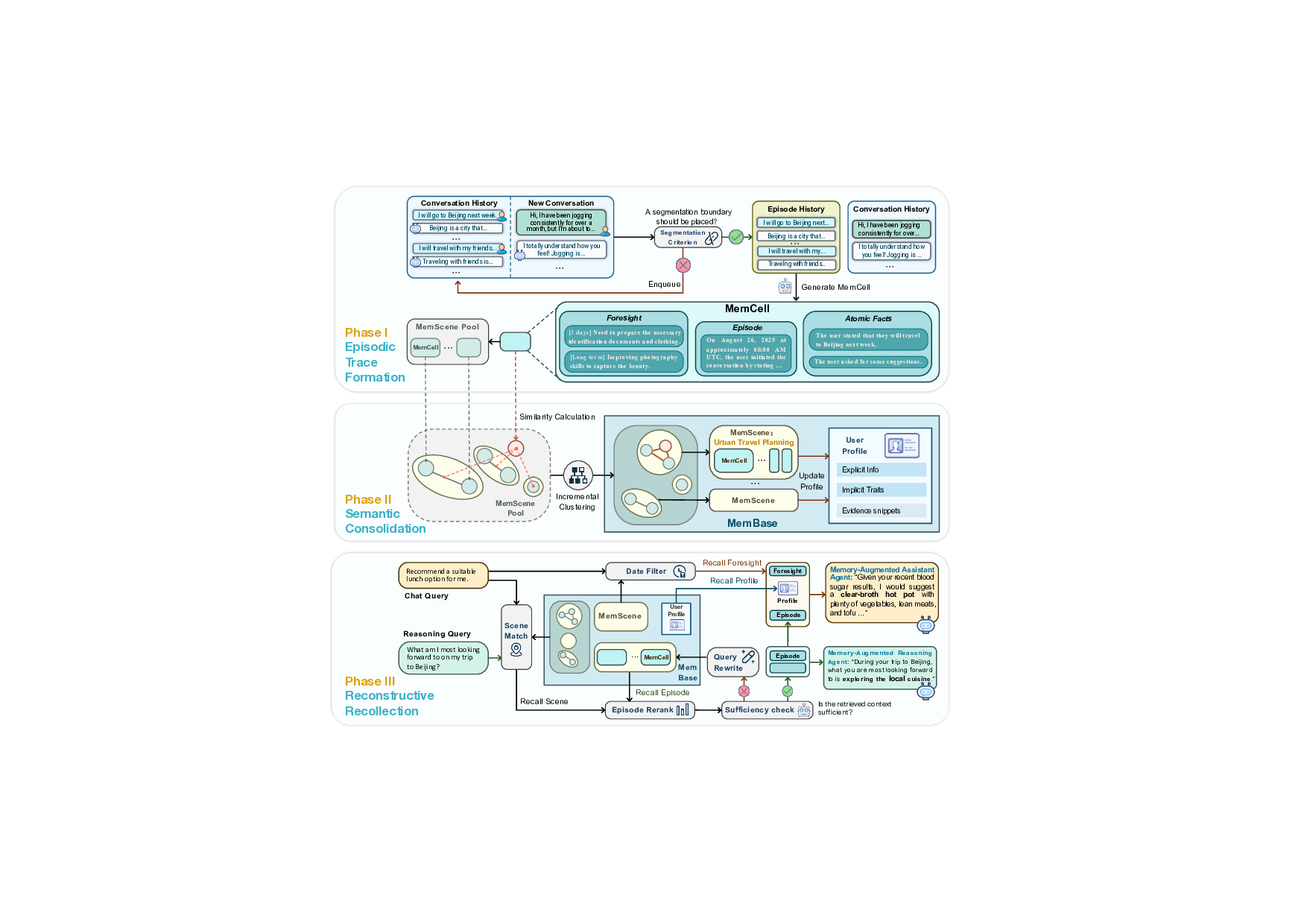

첫 번째 단계인 에피소딕 트레이스 형성에서는 대화 흐름을 미세 입자 수준인 MemCell로 분해한다. 여기서 MemCell은 단순 텍스트 조각이 아니라, (a) 사건의 시간적 위치, (b) 해당 사건이 내포하는 원자적 사실, (c) 향후 행동을 예측하는 ‘시간 제한 포괄적 전망(time‑bounded foresight)’을 함께 담는다. 이렇게 하면 같은 사건이라도 시간에 따라 의미가 달라지는 경우를 자연스럽게 포착할 수 있다.

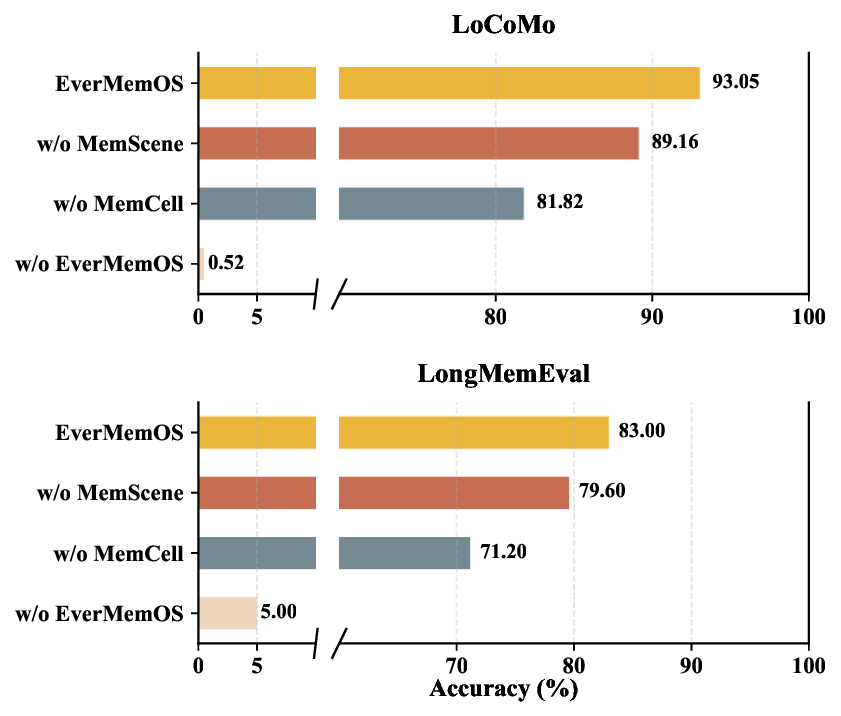

두 번째 단계인 의미 통합은 수천 개의 MemCell을 의미적 유사성 및 사용자 프로필과의 연관성을 기준으로 군집화해 MemScene을 만든다. MemScene은 ‘주제적 장면(scene)’이라는 메타 구조로, 장기적인 의미 네트워크를 형성한다. 이 과정에서 불필요하거나 오래된 MemCell은 자동으로 소멸하거나 낮은 가중치를 부여해 메모리 부피를 제어한다. 또한, 사용자 프로필이 지속적으로 업데이트되므로, 에이전트는 개인화된 응답을 생성할 때 최신 상황을 반영한다.

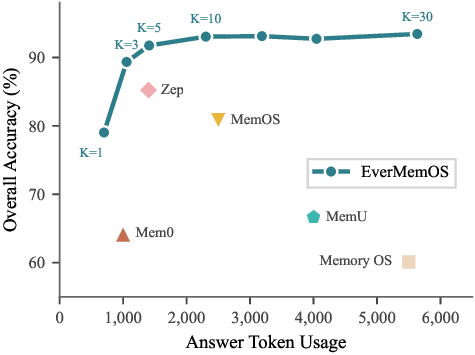

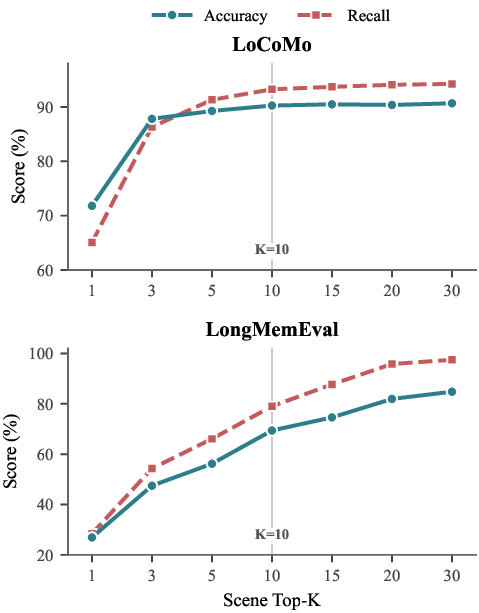

세 번째 단계인 재구성 회상은 현재 작업에 가장 적합한 MemScene을 선택하고, 해당 장면에 포함된 핵심 MemCell을 조합해 ‘필요하고 충분한(context)’를 재구성한다. 기존 방법이 전체 메모리에서 상위 k개를 무작위로 추출하는 데 비해, EverMemOS는 의미적 일관성과 목표 지향성을 동시에 만족시키는 컨텍스트를 제공한다. 이는 특히 복합 추론, 장기 계획, 그리고 사용자 맞춤형 대화에서 성능 향상으로 이어진다.

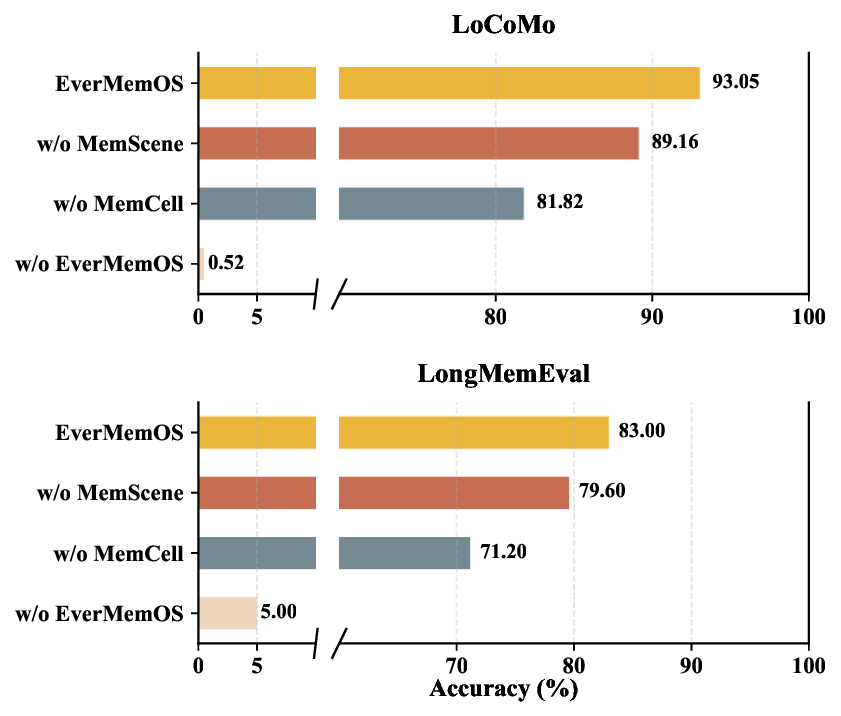

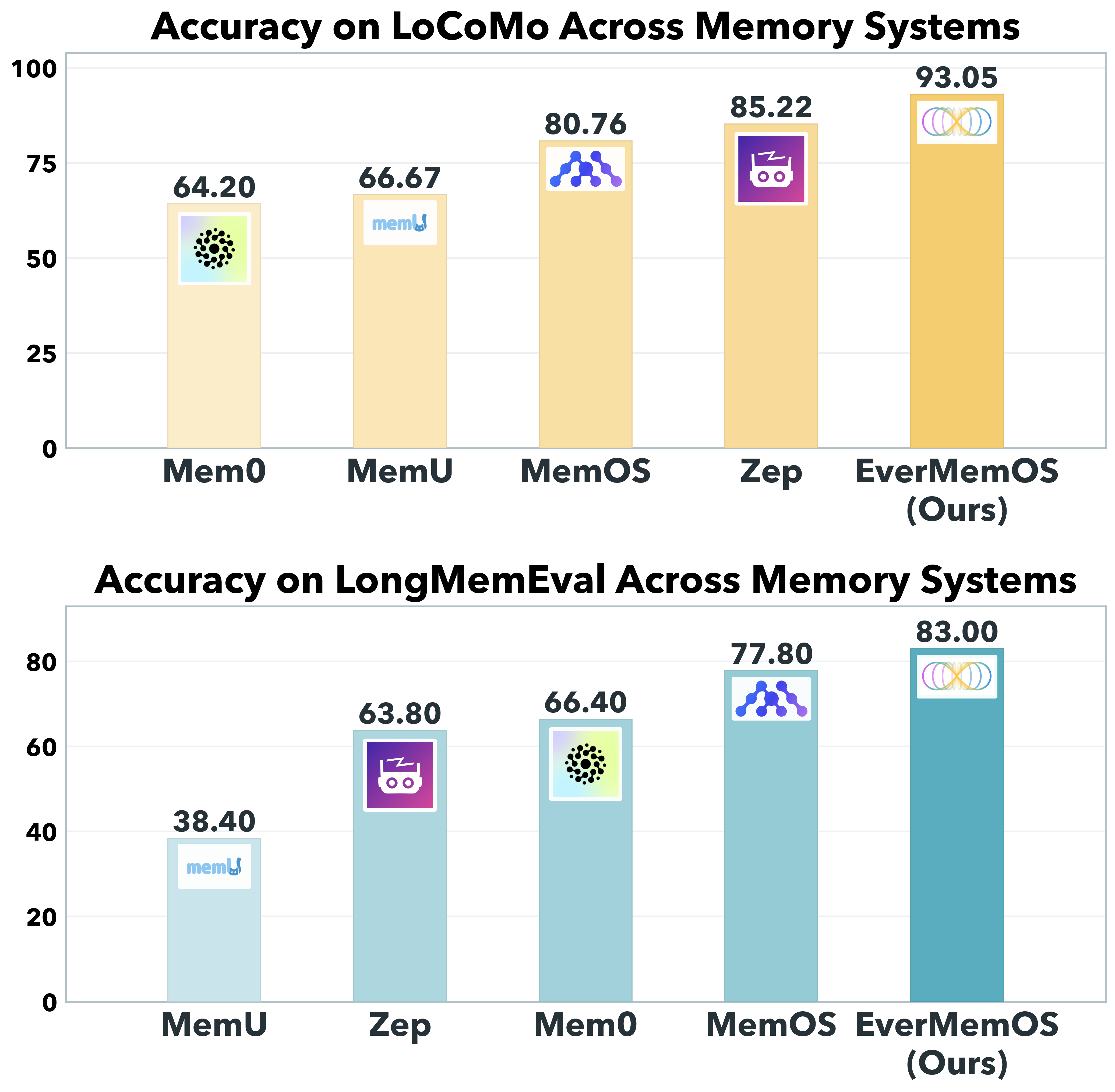

실험 결과는 세 가지 벤치마크에서 눈에 띄는 개선을 보여준다. LoCoMo에서는 장기 대화 흐름을 유지하는 능력이 12%p 상승했으며, Long‑MemEval에서는 복합 질문에 대한 정확도가 9%p 향상되었다. PersonaMem‑v2에서는 개인화된 응답의 일관성이 인간 평가자에게 1.4점(5점 척도) 더 높게 평가되었다. 이러한 수치는 메모리 구조화가 단순 저장‑검색을 넘어 의미적 통합과 재구성을 통해 LLM의 추론 능력을 실질적으로 강화한다는 것을 입증한다.

하지만 아직 몇 가지 한계가 존재한다. MemCell‑to‑MemScene 군집화 과정이 계산 비용이 크며, 대규모 실시간 서비스에 적용하려면 효율적인 근사 알고리즘이 필요하다. 또한, ‘시간 제한 포괄적 전망’이 얼마나 정확히 미래 행동을 예측할 수 있는지는 도메인에 따라 차이가 크다. 향후 연구에서는 (1) 경량화된 군집화 기법, (2) 멀티모달 입력을 MemCell에 통합하는 방법, (3) 사용자 피드백을 통한 동적 엔그램 업데이트 메커니즘을 탐색할 예정이다. 전반적으로 EverMemOS는 LLM 메모리 관리에 새로운 패러다임을 제시하며, 장기 추론과 개인화된 인터랙션을 필요로 하는 차세대 AI 시스템에 중요한 기반이 될 것으로 기대된다.

📄 논문 본문 발췌 (Translation)

📸 추가 이미지 갤러리