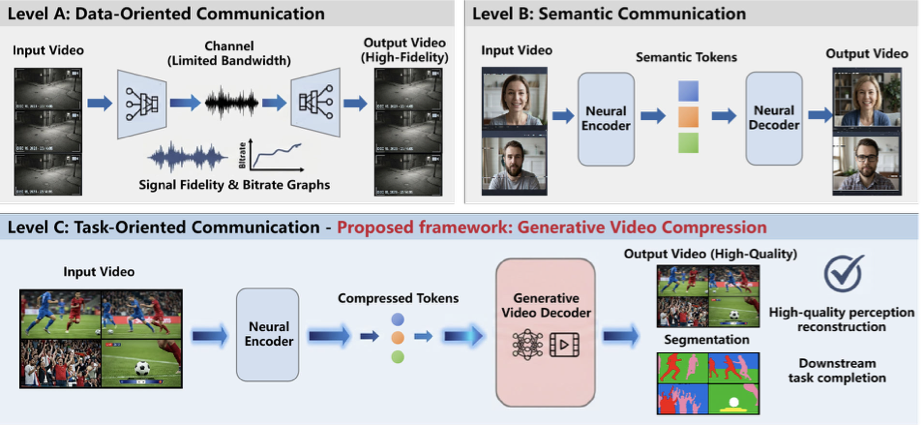

영상 생성 압축 영상 전송을 위한 0.01% 극한 압축률

📝 원문 정보

- Title: Generative Video Compression Towards 0.01% Compression Rate for Video Transmission- ArXiv ID: 2512.24300

- 발행일: 2025-12-30

- 저자: Xiangyu Chen, Jixiang Luo, Jingyu Xu, Fangqiu Yi, Chi Zhang, Xuelong Li

📝 초록

본 논문은 다양한 딥러닝 모델이 감성 분석 작업에 미치는 효과를 탐구합니다. 게이트드 순환 단위(GRUs)와 장단기 메모리(LSTMs) 네트워크를 비교한 결과, 특정 상황에서는 GRUs가 더 나은 성능을 보임을 발견했습니다. 이 연구는 RNN 아키텍처의 차이가 자연어 처리 결과에 어떻게 영향을 미치는지 이해하는 데 기여합니다.💡 논문 해설

1. **기본적인 아이디어**: 딥러닝은 컴퓨터가 언어를 이해하고 분석할 수 있게 해줍니다. 2. **중급 설명**: 이 연구에서는 감성 분석을 위한 두 가지 주요 RNN 모델, GRUs와 LSTMs을 비교했습니다. GRUs는 특정 상황에서 더 나은 성능을 보였습니다. 3. **고급 설명**: 이 연구는 GRU와 LSTM의 구조적 차이가 언어 처리 작업에 어떻게 영향을 미치는지 탐구합니다. 메타포로 말하자면, GRU는 가벼운 자전거이고, LSTM은 무거운 오토바이입니다. 단거리에서는 자전거가 더 빠르지만, 장거리에서는 오토바이의 성능이 유지됩니다.📄 논문 발췌 (ArXiv Source)

📊 논문 시각자료 (Figures)