연속시간 표현 학습을 위한 신경 주의 회로

읽는 시간: 2 분

...

📝 원문 정보

- Title: Neuronal Attention Circuit (NAC) for Representation Learning

- ArXiv ID: 2512.10282

- 발행일: 2025-12-11

- 저자: Waleed Razzaq, Izis Kanjaraway, Yun-Bo Zhao

📝 초록 (Abstract)

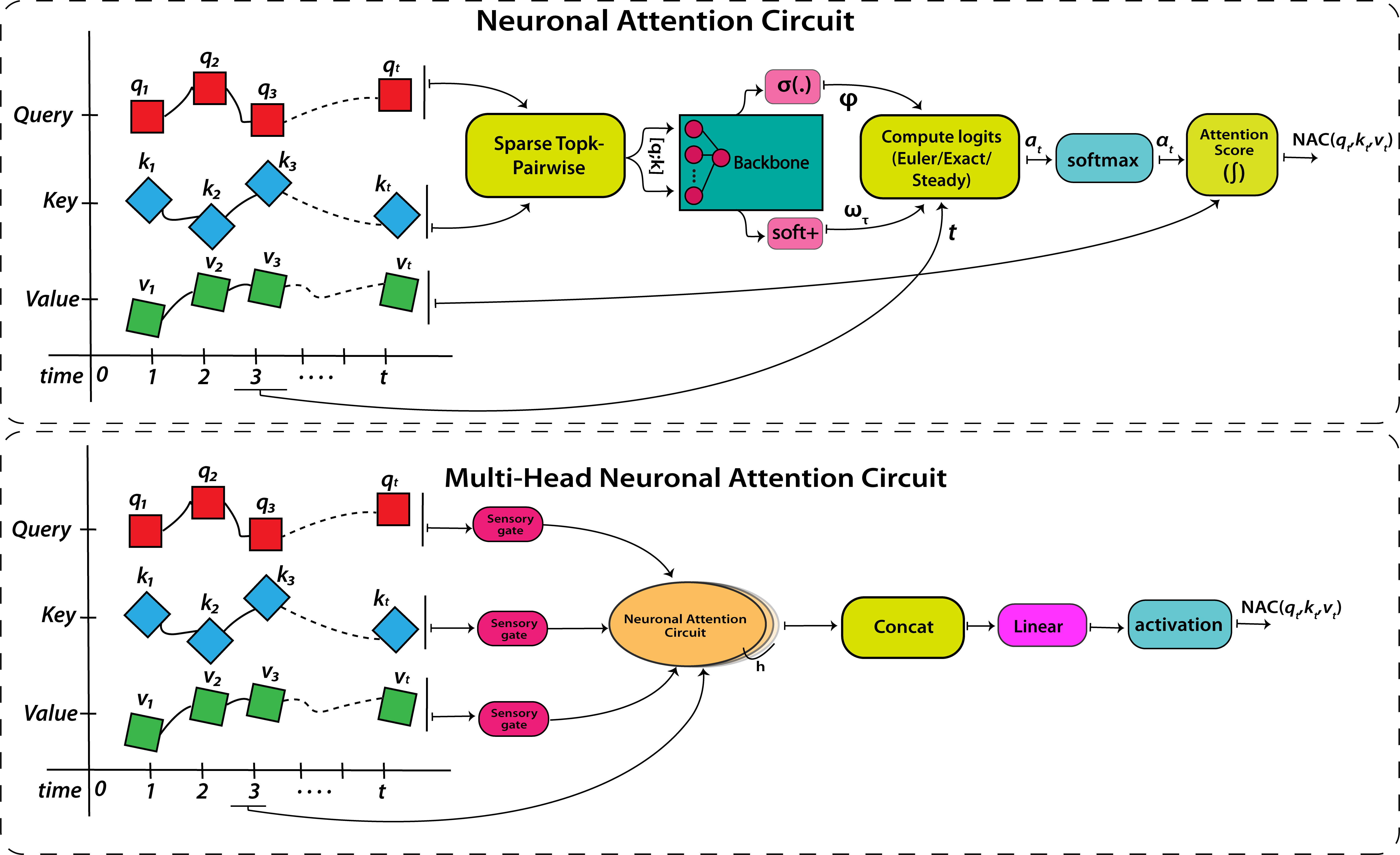

주의 메커니즘은 순환 신경망(RNN)의 표현 학습을 향상시키지만, 이산적인 특성 때문에 연속시간(CT) 모델링에 제약이 있다. 본 연구에서는 선형 1차 미분방정식의 해를 이용해 어텐션 로짓을 계산하고, C. elegans 신경 회로 정책(NCP) 배선을 재구성한 비선형 게이트를 결합한 연속시간 어텐션 메커니즘인 Neuronal Attention Circuit(NAC)을 제안한다. NAC는 기존의 조밀한 투영을 희소한 감각 게이트로 대체하여 키‑쿼리 투영을 수행하고, 두 개의 헤드를 갖는 희소 백본 네트워크로 콘텐츠‑타깃 및 학습 가능한 시간 상수 게이트를 계산한다. 효율성과 메모리 사용량을 개선하기 위해, 키‑쿼리 상호작용을 선택적으로 정제하는 서브쿼드라틱 희소 Top‑K 쌍 연결 방식을 구현하였다. 이론적으로 상태 안정성 및 근사 오차에 대한 경계 보장을 제공한다. 실험에서는 불규칙 시계열 분류, 자율주행 차선 유지, 산업 예측 등 다양한 도메인에 NAC를 적용했으며, 정확도 면에서 기존 최첨단 CT 모델과 동등하거나 우수한 성능을 보였고, 실행 시간과 메모리 소비는 여러 CT 베이스라인 사이의 중간 수준을 차지하였다. 또한 뉴런 수준에서 해석 가능성을 제공한다.💡 논문 핵심 해설 (Deep Analysis)