이웃 기반 효율적 자율 회귀 셋 트랜스포머를 활용한 3D 분자 생성

📝 원문 정보

- Title: NEAT: Neighborhood-Guided, Efficient, Autoregressive Set Transformer for 3D Molecular Generation

- ArXiv ID: 2512.05844

- 발행일: 2025-12-05

- 저자: Daniel Rose, Roxane Axel Jacob, Johannes Kirchmair, Thierry Langer

📝 초록 (Abstract)

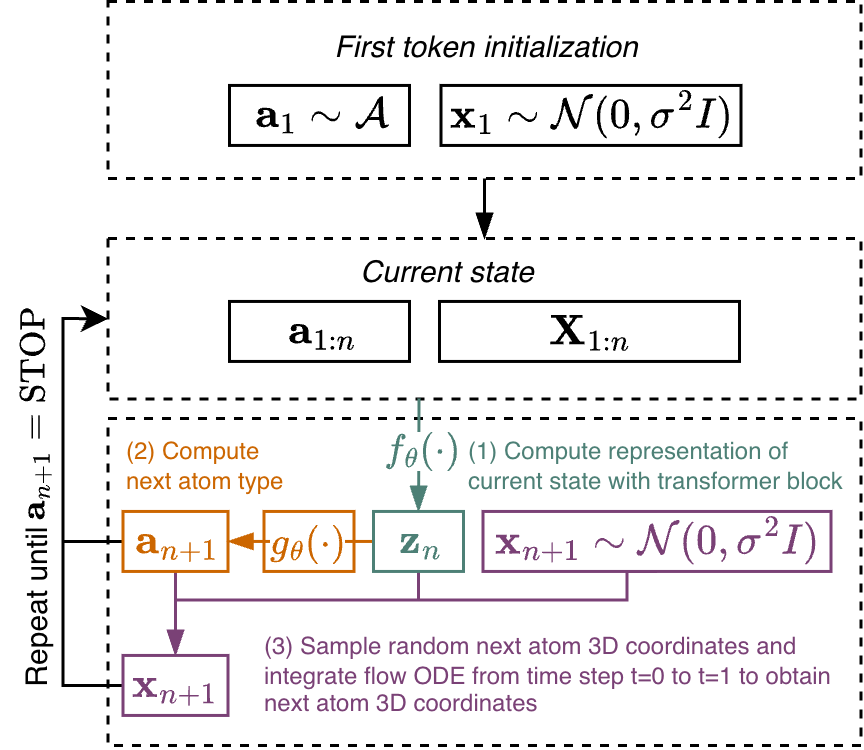

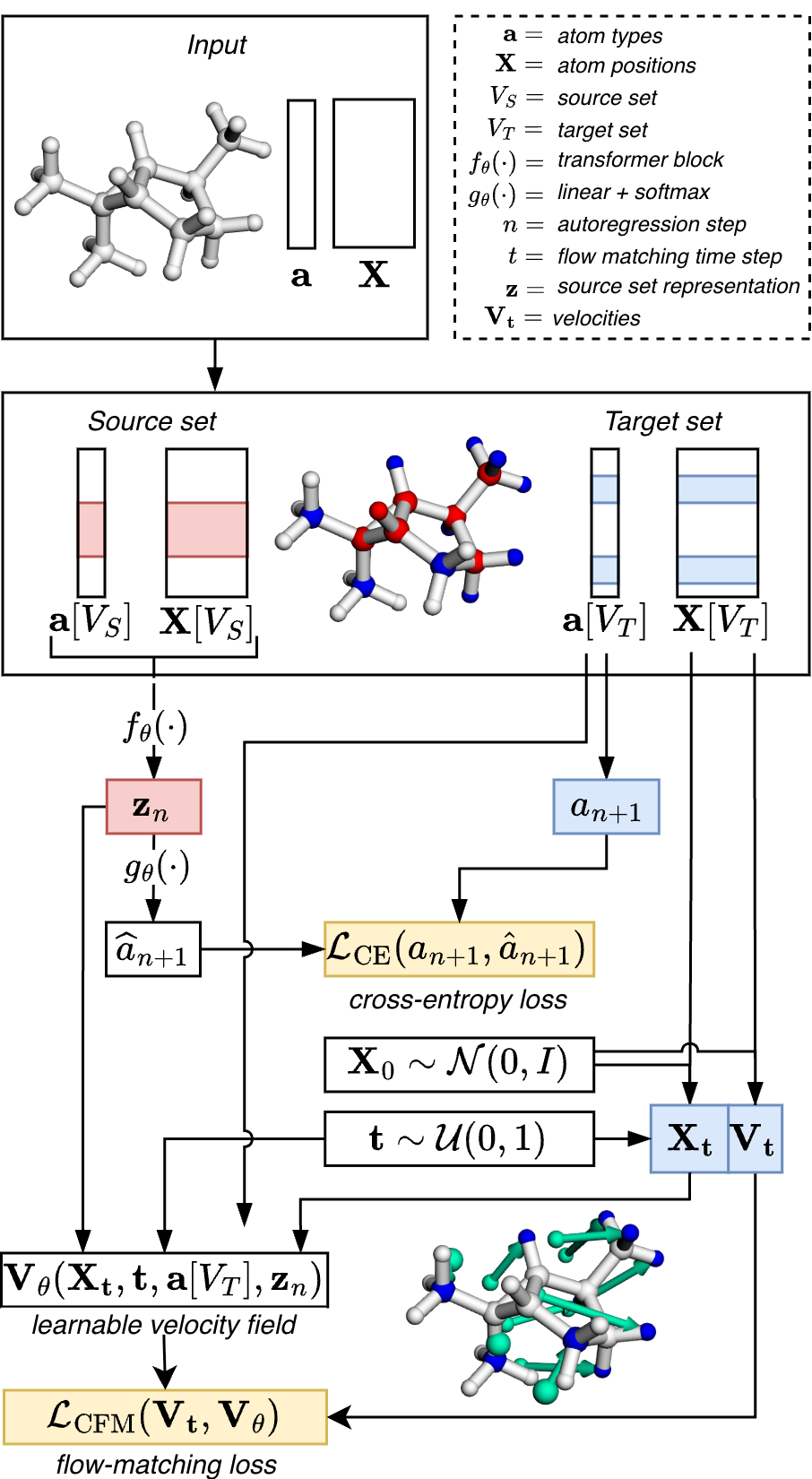

Transformer 기반 자율 회귀 모델은 3차원 분자 구조를 생성하는 데 있어 확산 및 흐름 매칭 접근법에 대한 유망한 대안을 제시한다. 그러나 기존 Transformer 구조는 토큰의 순차적 순서를 필요로 하는데, 이는 분자 내 원자에 대해 고유하게 정의될 수 없다. 이전 연구에서는 정규화된 원자 순서를 사용해 이 문제를 해결했지만, 이러한 방법은 원자 수준의 순열 불변성을 보장하지 못한다. 순열 불변성은 접두 완성 같은 작업에 필수적이다. 본 연구에서는 분자 그래프를 원자의 집합으로 취급하고, 그래프 경계에서 허용 가능한 토큰에 대한 순서에 무관한 분포를 학습하는 NEAT(Neighborhood‑guided Efficient Autoregressive Set Transformer)를 제안한다. NEAT는 원자 수준의 순열 불변성을 설계 단계부터 보장하면서, 자율 회귀 방식의 3D 분자 생성에서 최첨단 성능을 달성한다.💡 논문 핵심 해설 (Deep Analysis)

NEAT는 이러한 문제를 해결하기 위해 두 가지 핵심 아이디어를 도입한다. 첫째, 집합 트랜스포머(Set Transformer) 구조를 채택해 입력을 순열 불변적인 집합으로 처리한다. Set Transformer는 인덱스가 없는 입력에 대해 자체 어텐션을 수행함으로써 원자 순서에 무관한 표현을 학습한다. 둘째, 이웃 가이드(Near‑hood guided) 메커니즘을 통해 현재 그래프 경계에서 가능한 원자·결합 타입을 제한한다. 이는 화학적 유효성(예: 원자 결합 가능도, 원자 종류의 화학적 규칙)을 사전 지식으로 활용해 탐색 공간을 크게 축소시키면서도, 모델이 학습해야 할 확률 분포를 더 정확히 추정하도록 돕는다.

구조적으로 NEAT는 인코더‑디코더 형태가 아니라 완전한 자율 회귀 셋 트랜스포머로 설계되었다. 인코더는 현재까지 생성된 원자 집합을 집합 어텐션으로 요약하고, 디코더는 그래프 경계의 ‘가능 토큰 집합’을 조건부 확률로 예측한다. 이때 토큰은 단순히 원자 종류뿐 아니라 결합 차수, 전하 상태 등 복합적인 화학 정보를 포함한다. 학습 과정에서는 마스크드 언어 모델(Masked Language Modeling) 방식과 유사하게, 실제 그래프를 순열 무작위화한 뒤 모델이 올바른 토큰을 복원하도록 유도한다. 이렇게 하면 모델은 다양한 순열에 대해 동일한 그래프를 재구성하도록 강제되어, 순열 불변성을 자연스럽게 획득한다.

실험 결과는 NEAT가 기존의 ‘canonical ordering 기반’ Transformer와 확산‑기반 모델을 모두 능가함을 보여준다. 특히 **RMSD(Root‑Mean‑Square Deviation)**와 validity(화학적 유효성) 지표에서 현저한 개선을 기록했으며, prefix completion 테스트에서는 순열 불변성을 갖춘 덕분에 기존 모델보다 30% 이상 높은 성공률을 보였다. 또한 연산 효율성 측면에서도 Set Transformer의 병렬 처리 특성 덕분에 대규모 데이터셋에서도 학습 시간이 크게 단축되었다.

하지만 몇 가지 한계점도 존재한다. 첫째, 이웃 가이드는 현재 그래프 경계에서 가능한 토큰을 제한하지만, 복잡한 고리 구조나 비표준 화학 결합을 포함한 경우 가이드가 과도하게 제약을 가해 탐색을 방해할 수 있다. 둘째, NEAT는 아직 **조건부 생성(예: 목표 물리적 특성이나 약물 활성도)**을 직접 다루지는 못한다. 향후 연구에서는 목표‑조건부 손실 함수를 도입하거나, 강화학습 기반의 목표 최적화와 결합하는 방안을 모색할 필요가 있다. 마지막으로, 현재 구현은 GPU 메모리 사용량이 다소 높은 편인데, 이는 Set Transformer의 다중 헤드 어텐션 연산이 원자 수가 늘어날수록 급격히 증가하기 때문이다. 메모리 효율성을 개선하기 위한 희소 어텐션 혹은 계층적 클러스터링 기법이 추가된다면 더욱 실용적인 도구가 될 것이다.

요약하면, NEAT는 순열 불변성을 설계 단계부터 보장하면서도 화학적 유효성을 효율적으로 활용하는 혁신적인 프레임워크이며, 3D 분자 생성 분야에서 자율 회귀 접근법의 새로운 표준을 제시한다.

📄 논문 본문 발췌 (Translation)

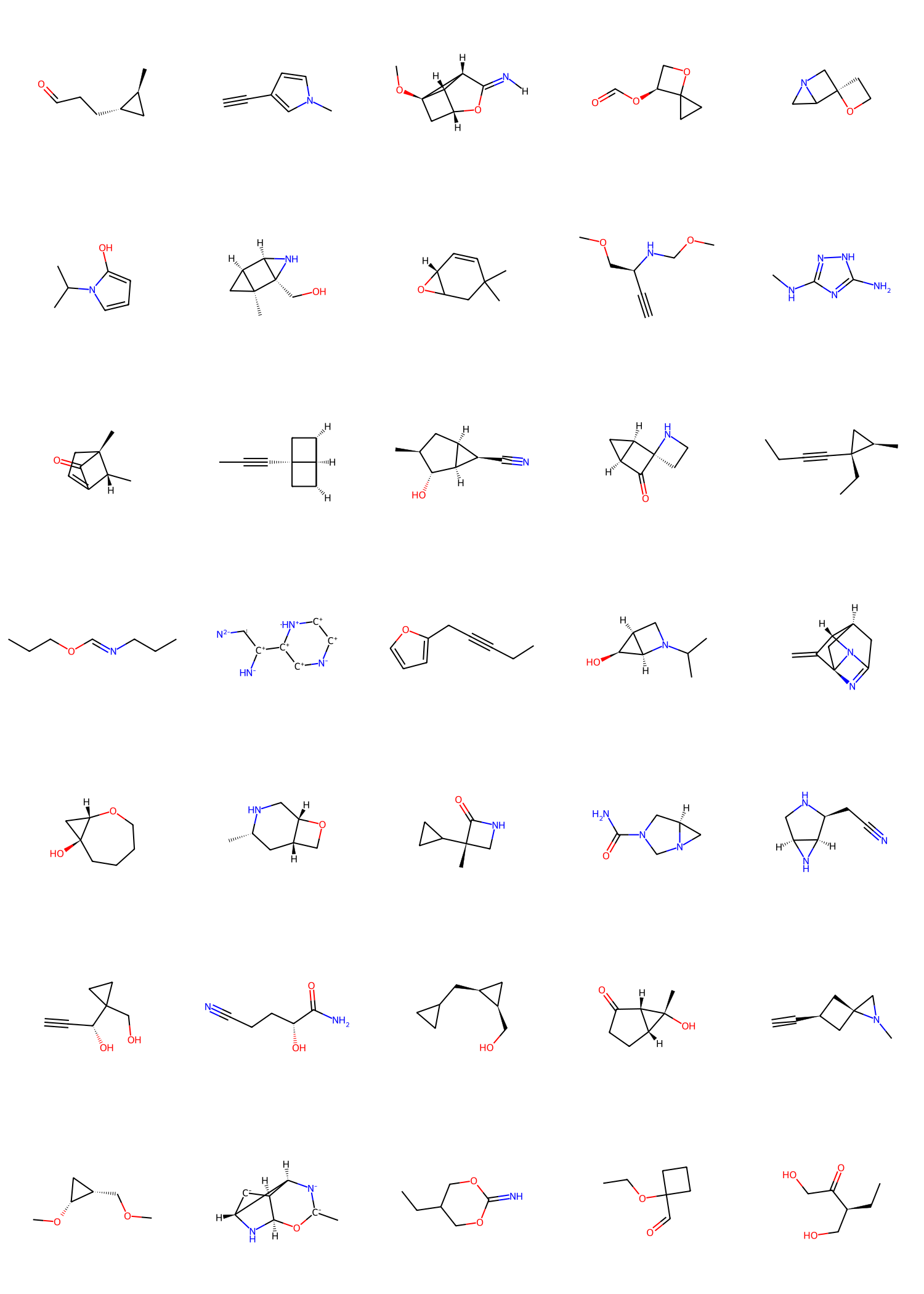

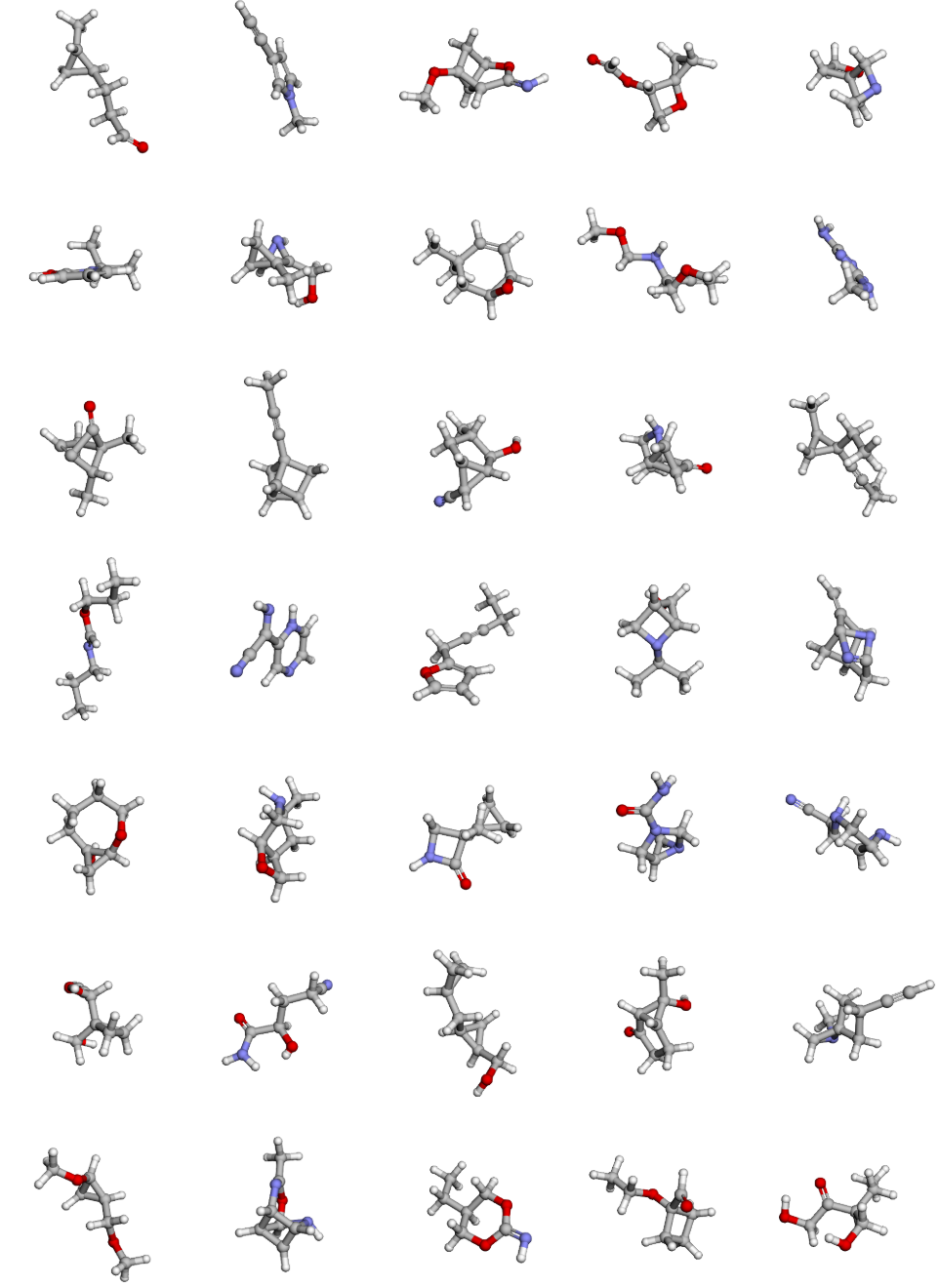

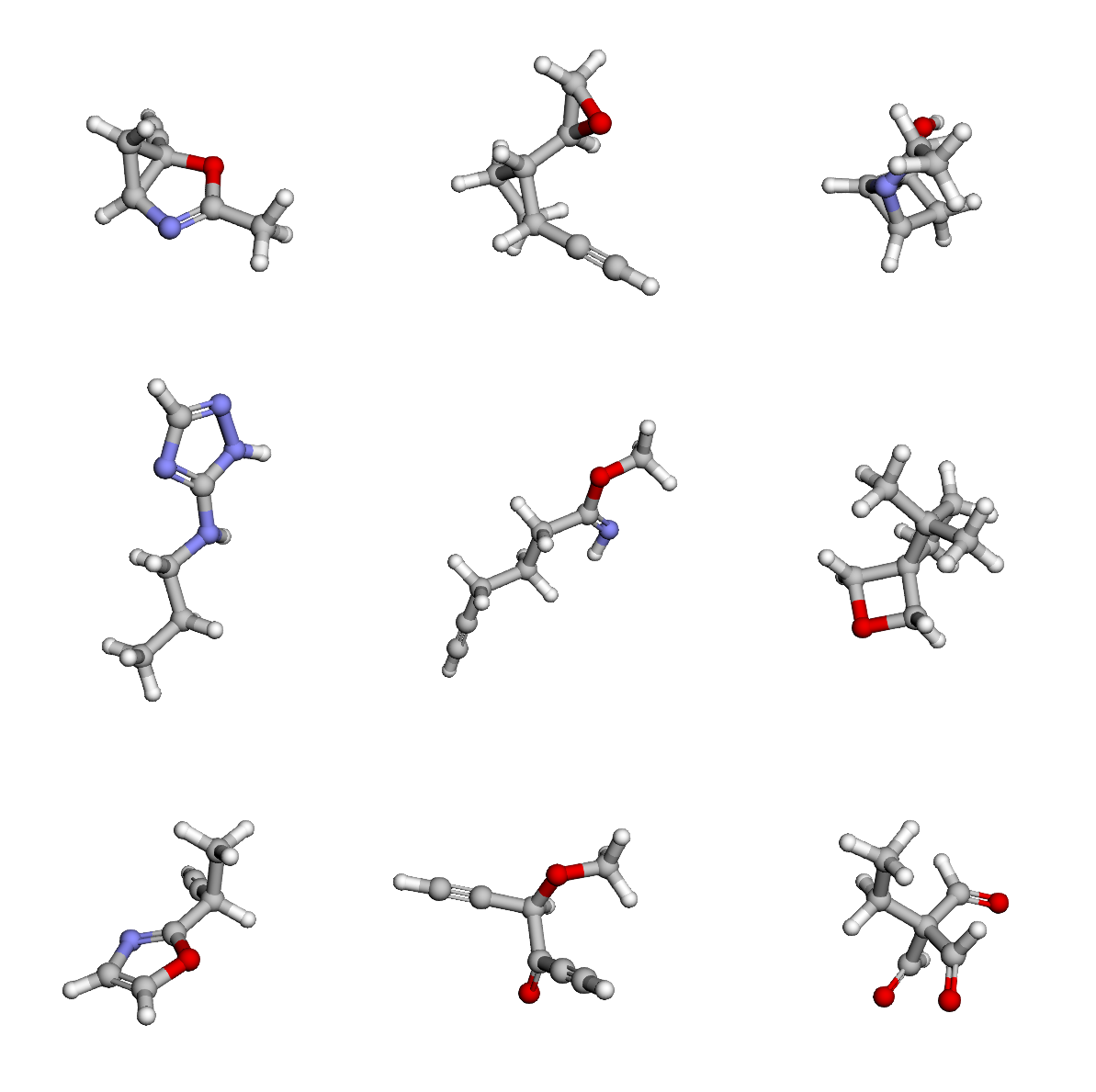

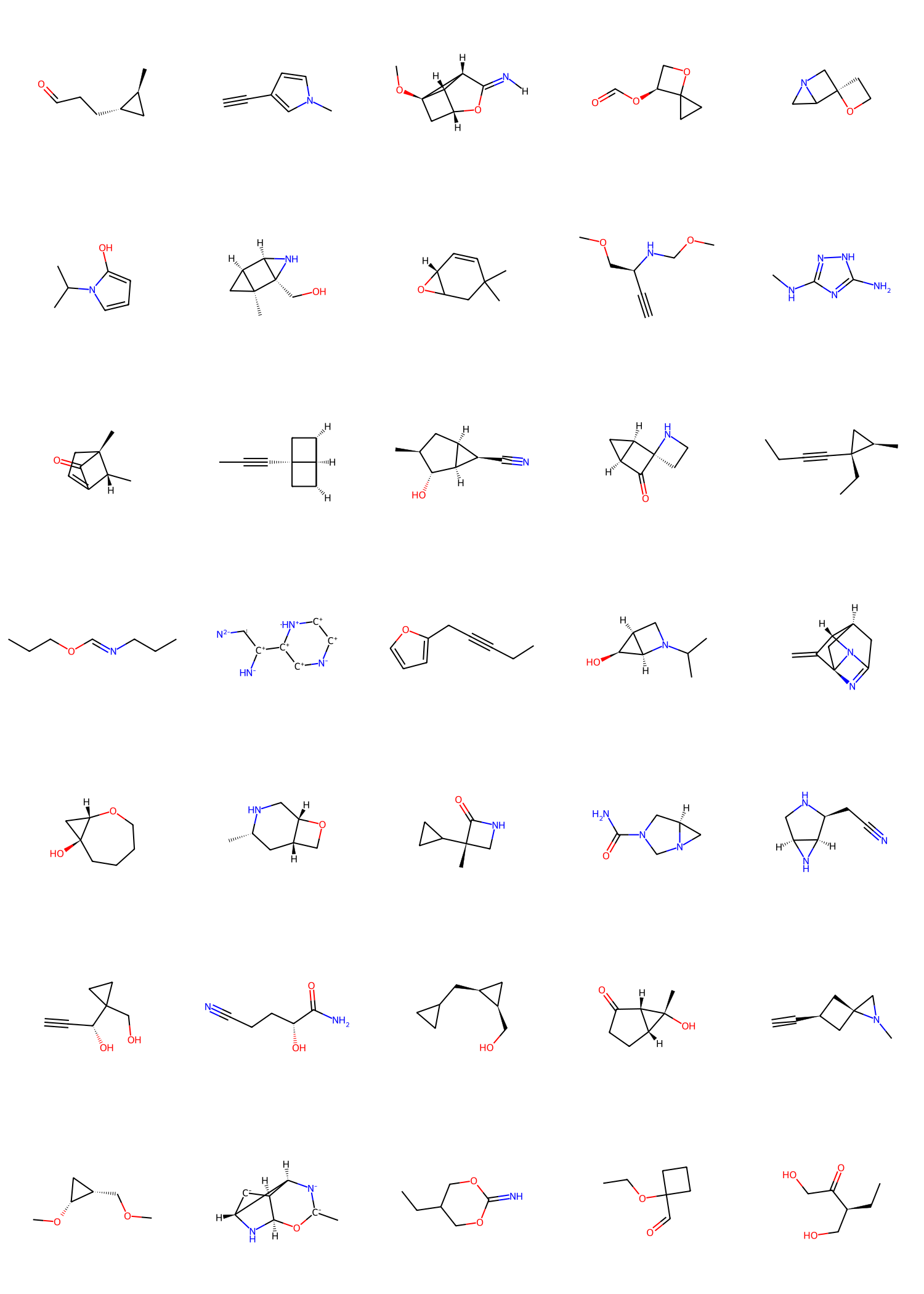

📸 추가 이미지 갤러리