생물학적 영감을 받은 CNN 아키텍처 LGN-CNN

📝 원문 정보

- Title: LGN-CNN a biologically inspired CNN architecture- ArXiv ID: 1911.06276

- 발행일: 2021-10-29

- 저자: Federico Bertoni, Giovanna Citti, Alessandro Sarti

📝 초록

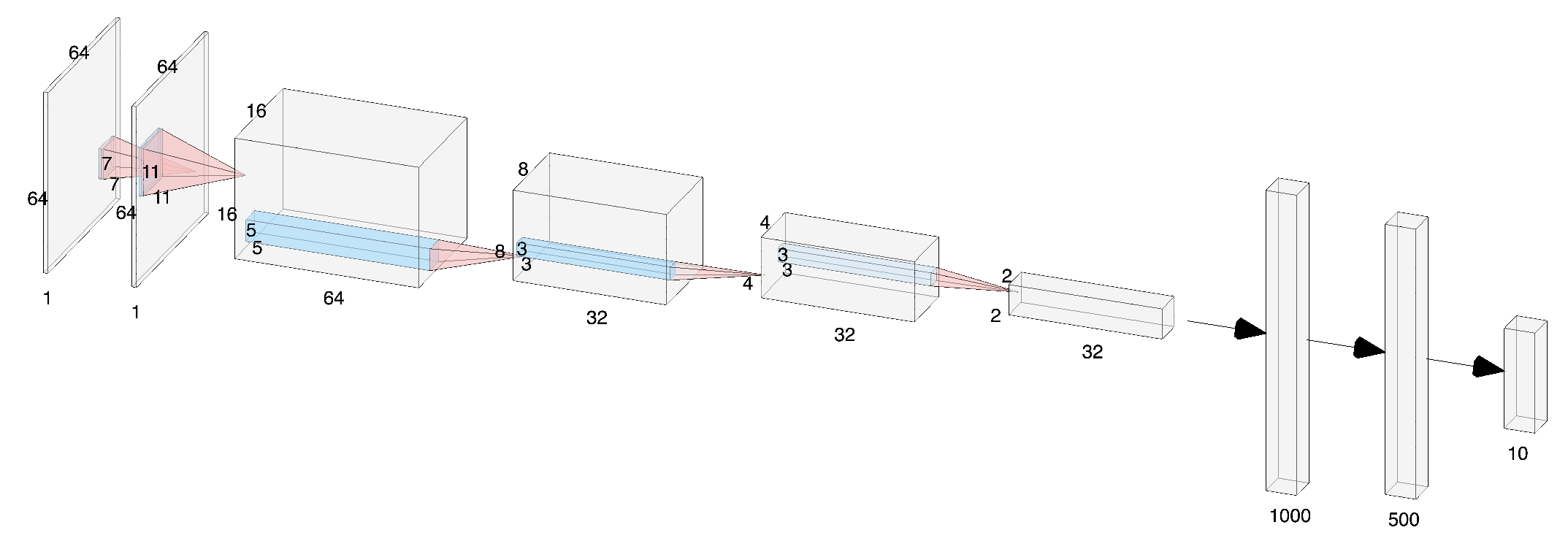

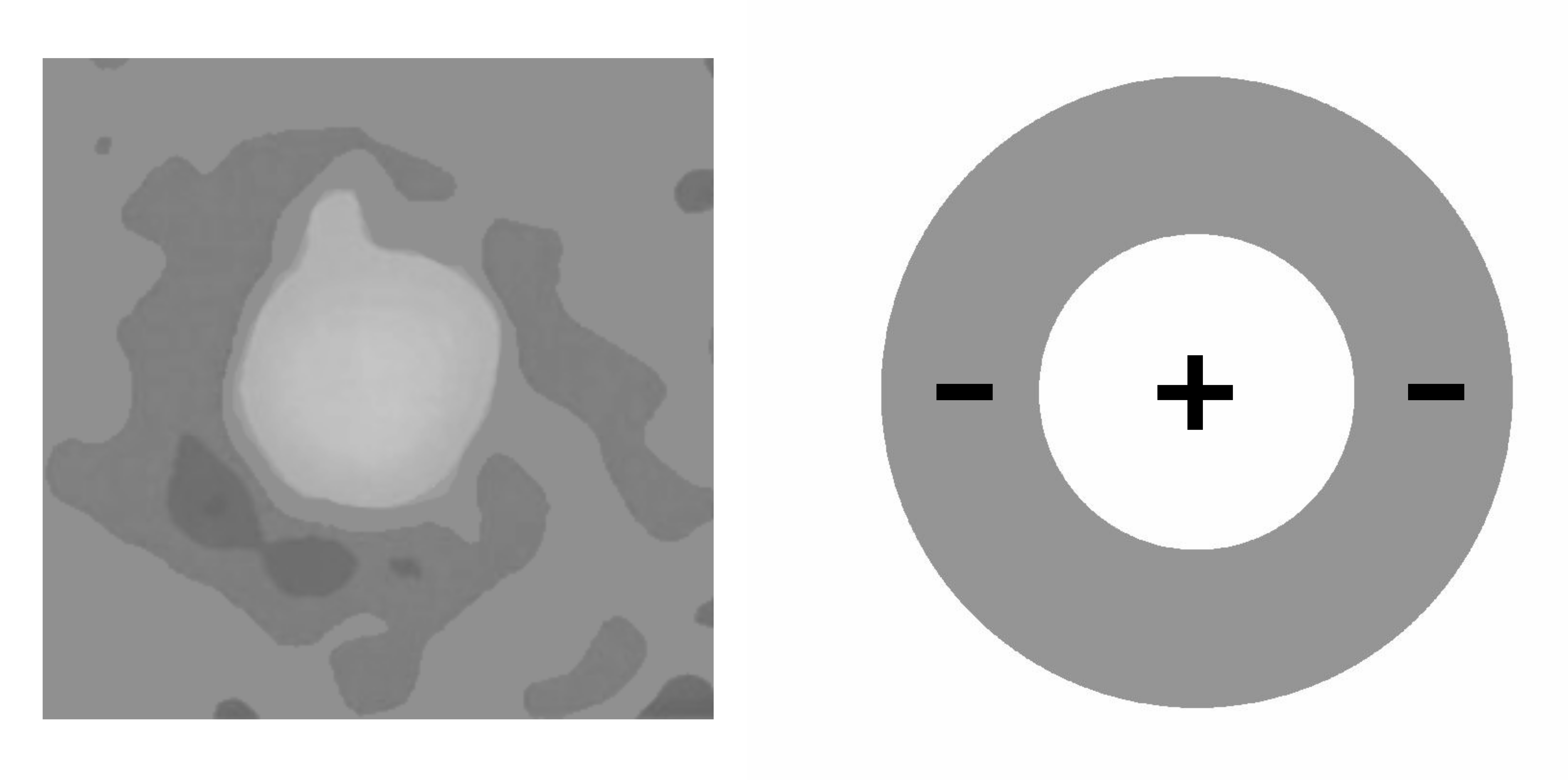

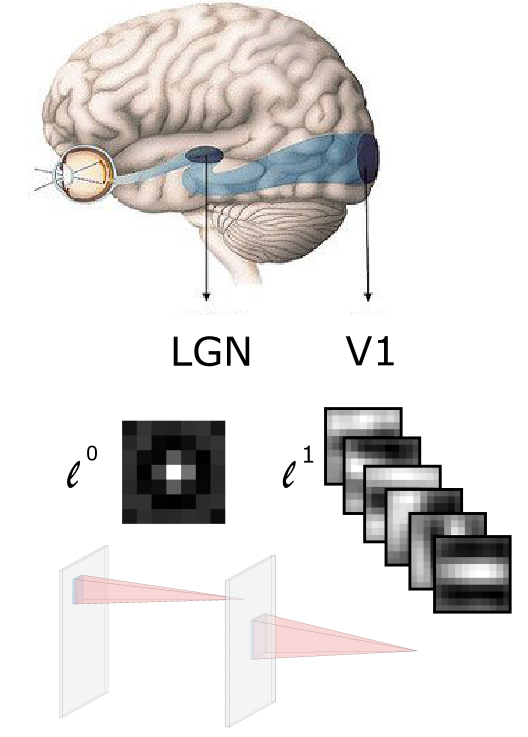

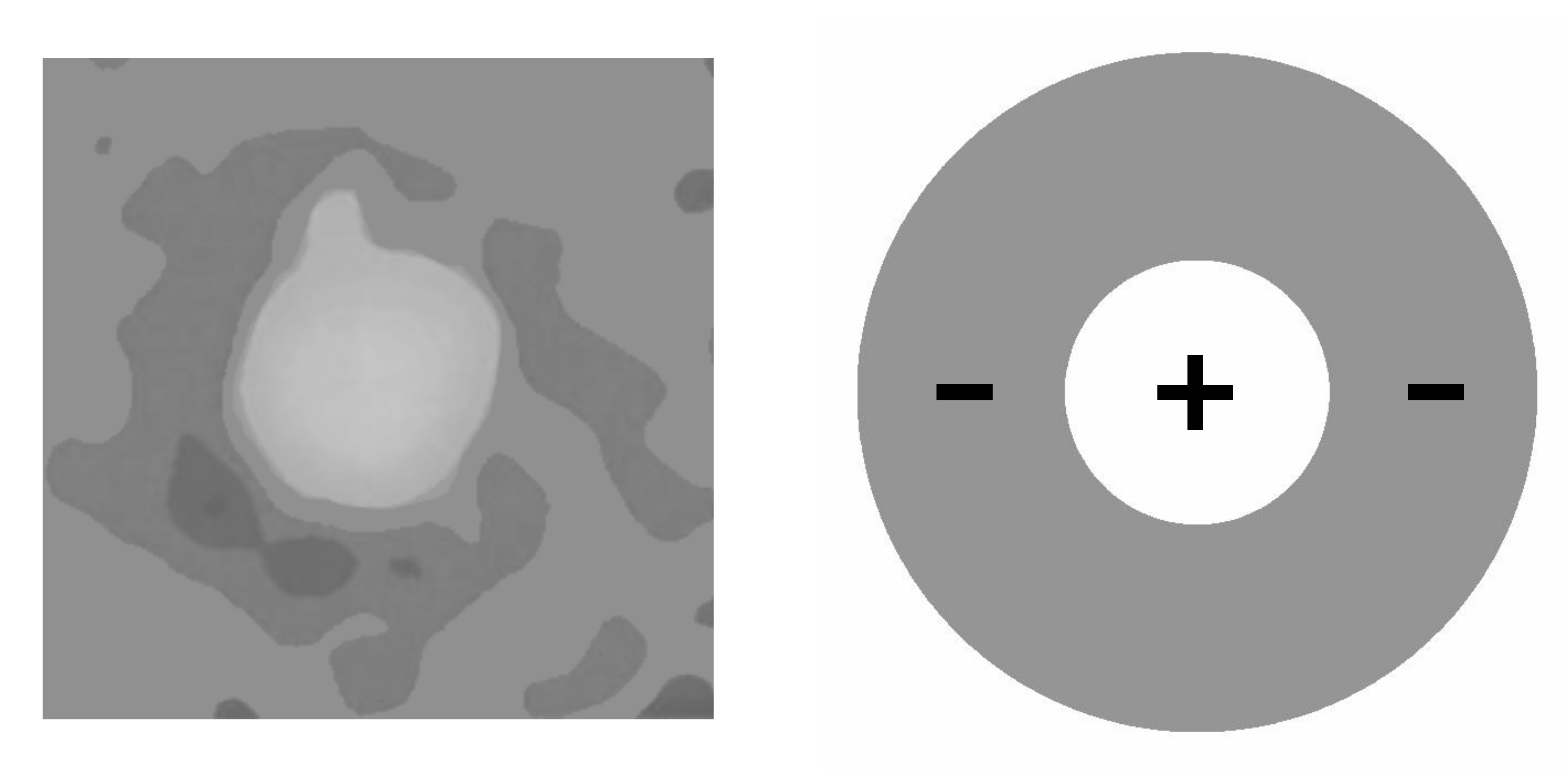

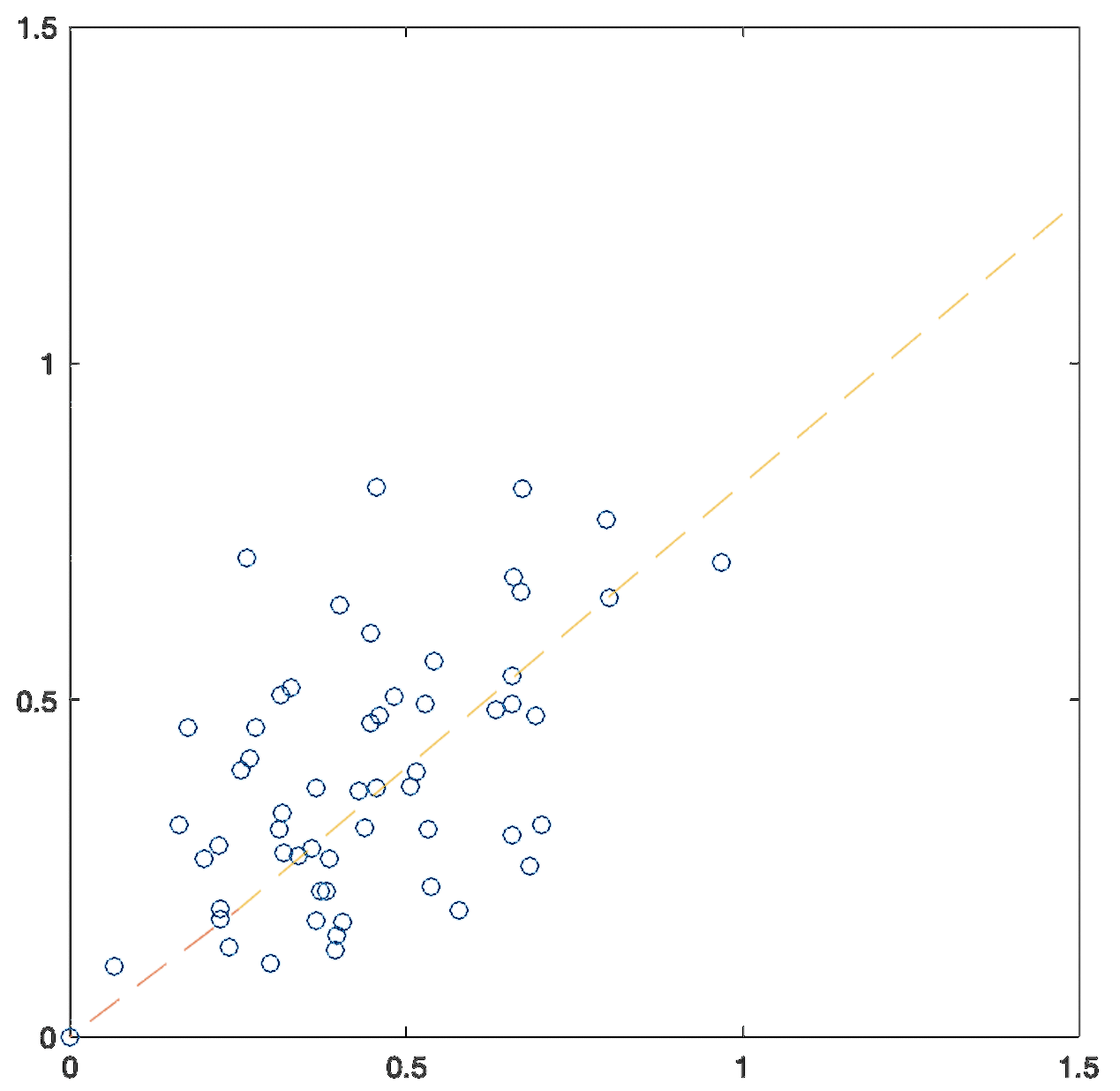

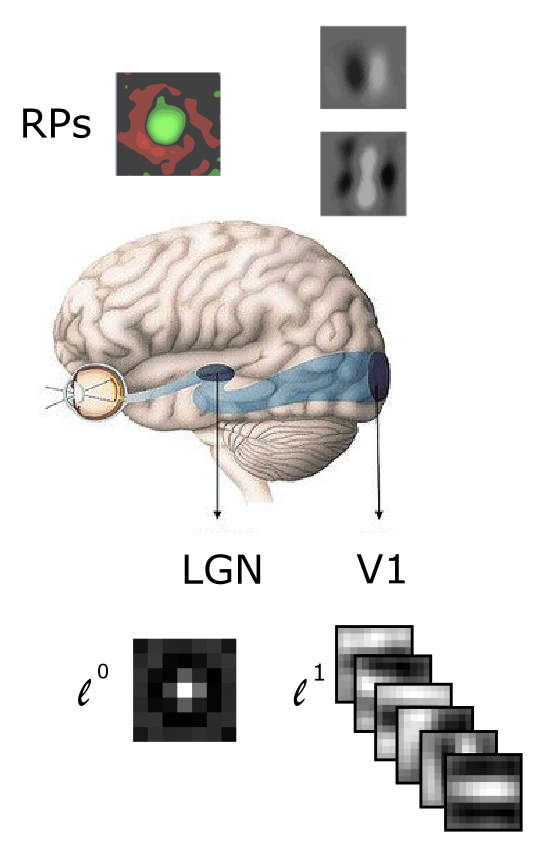

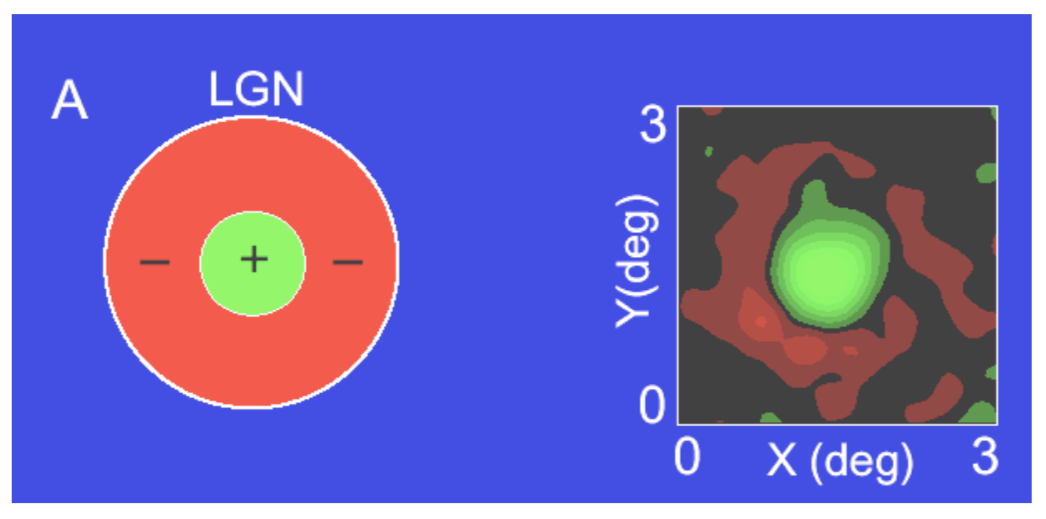

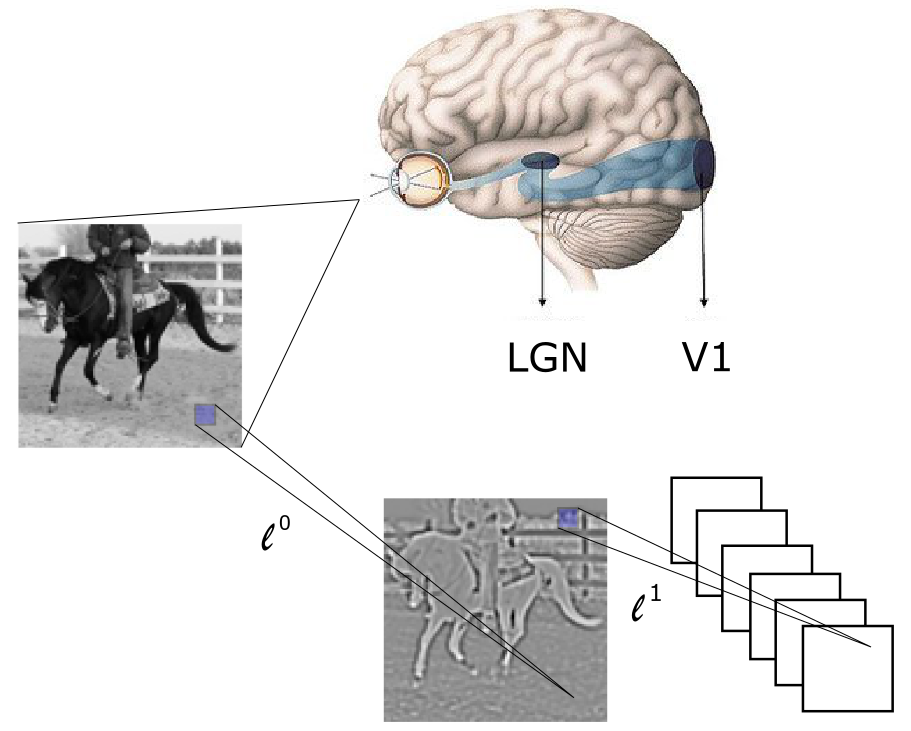

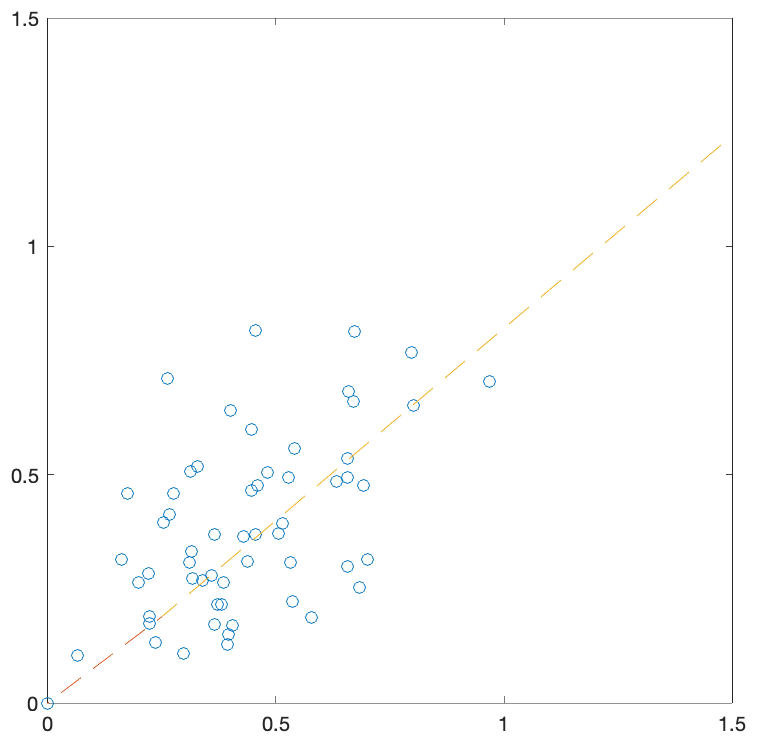

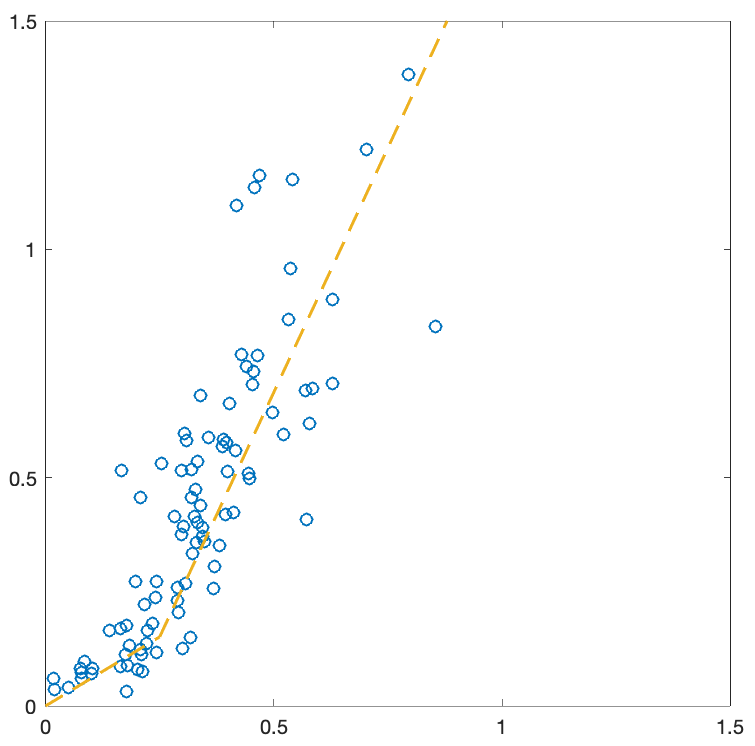

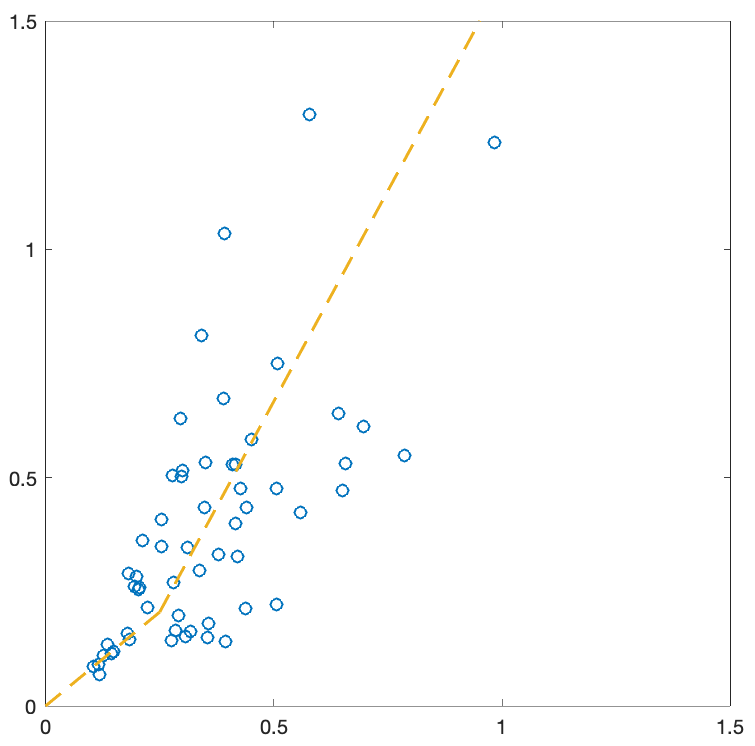

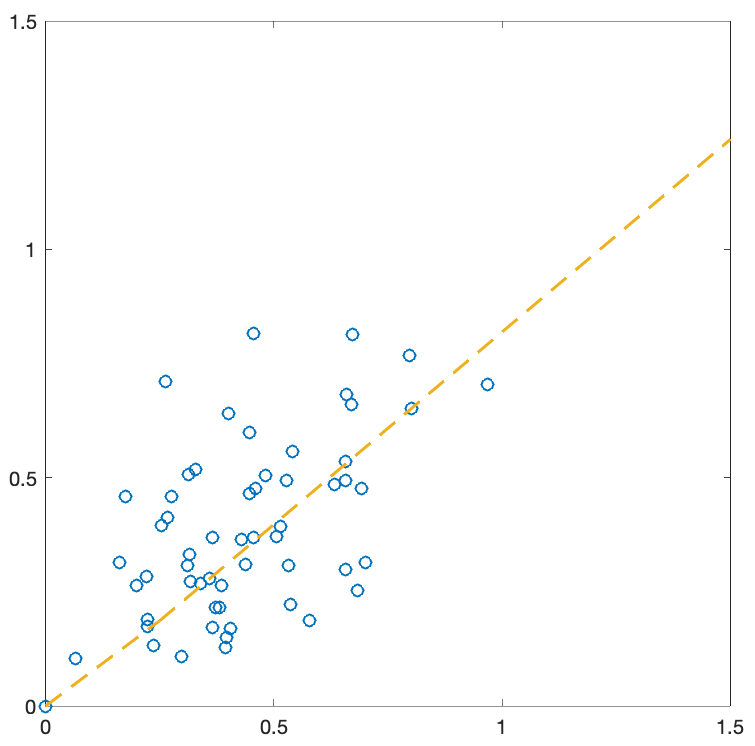

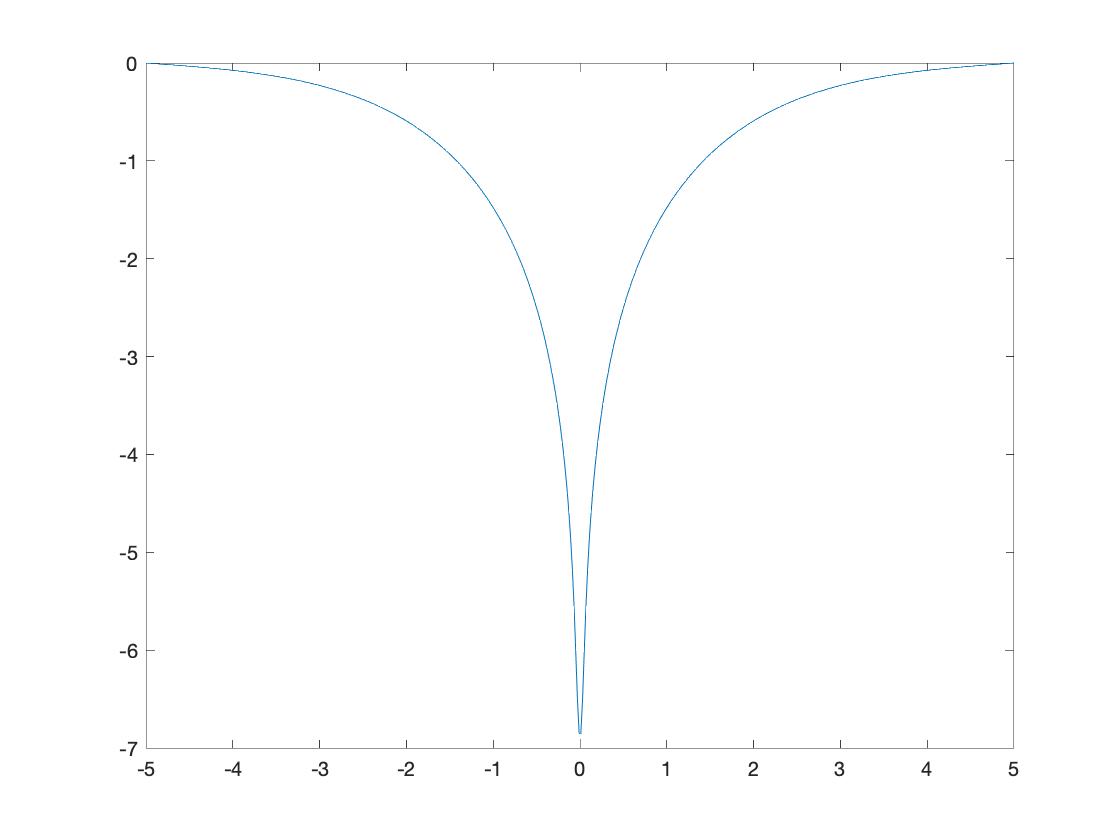

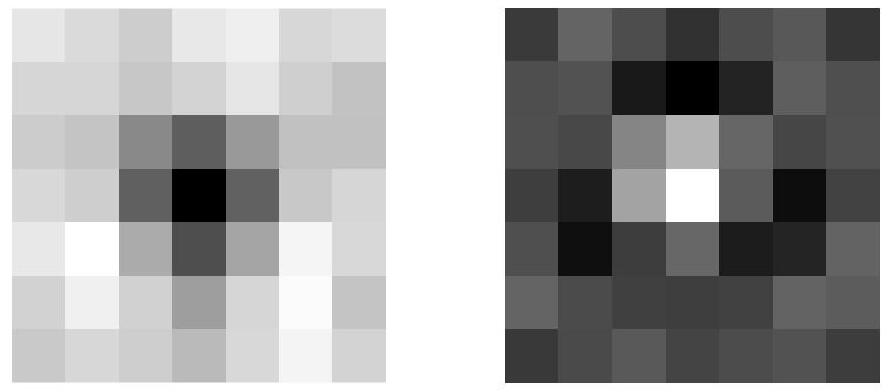

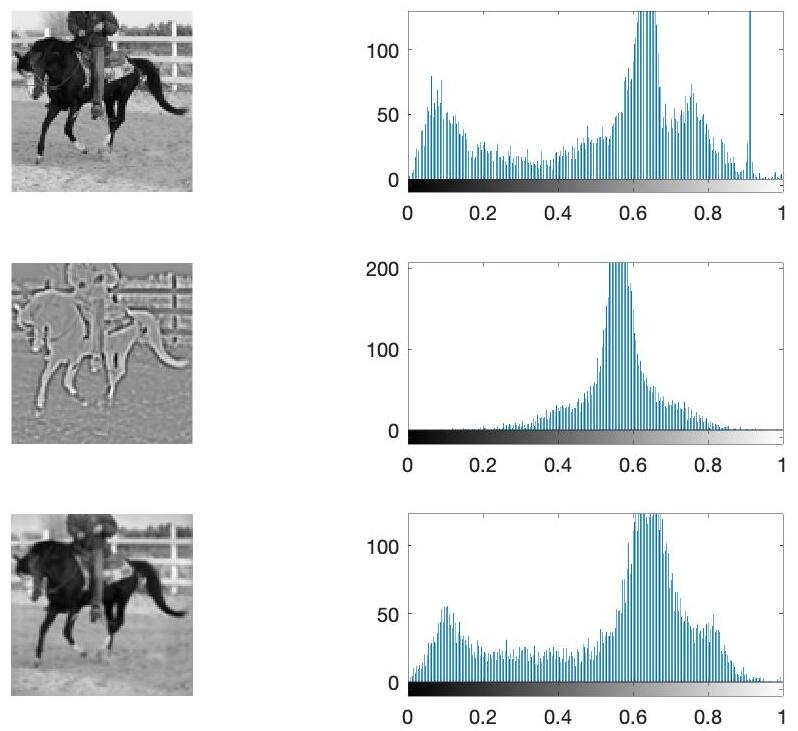

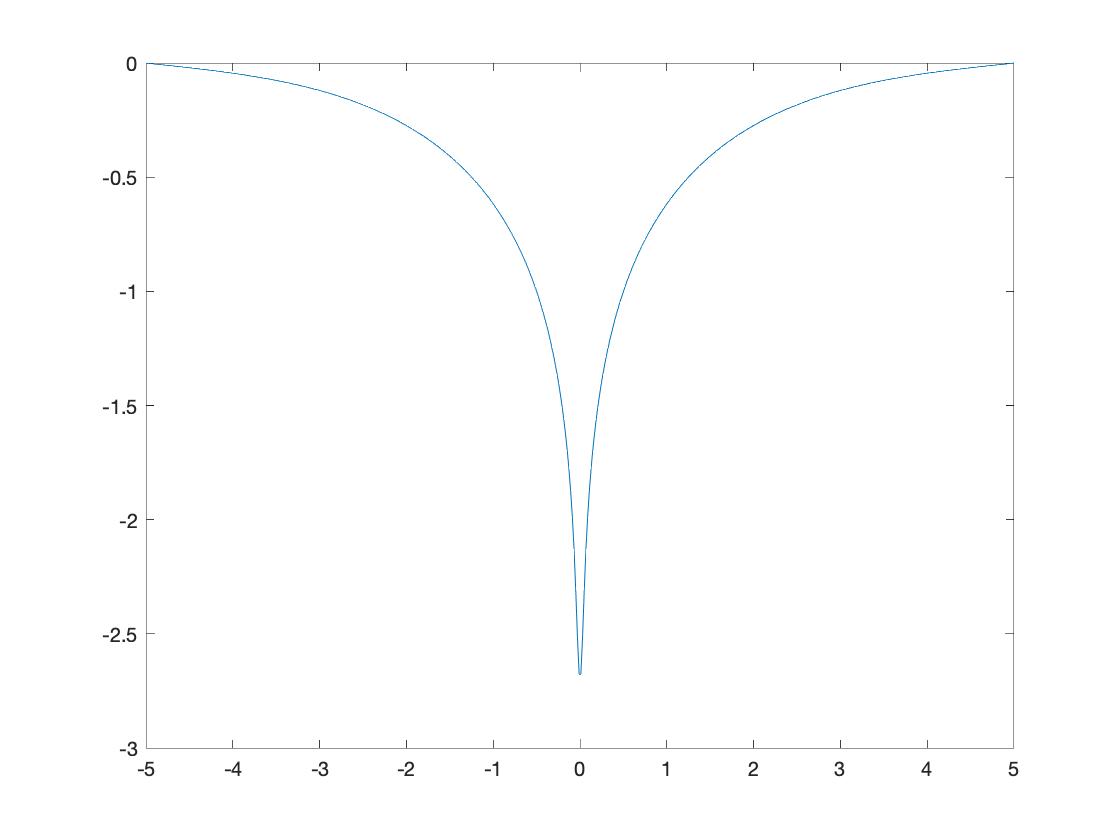

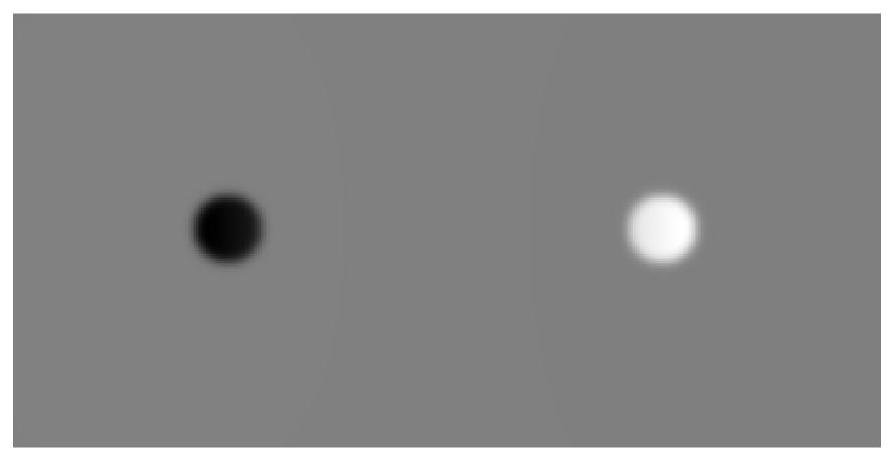

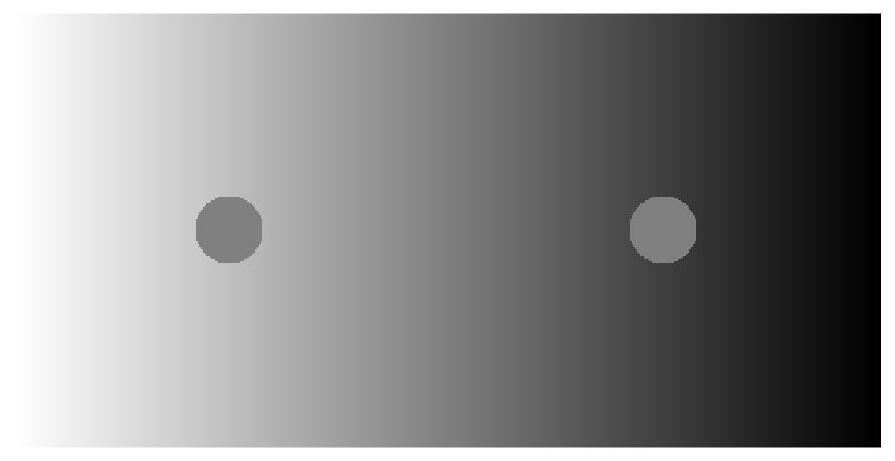

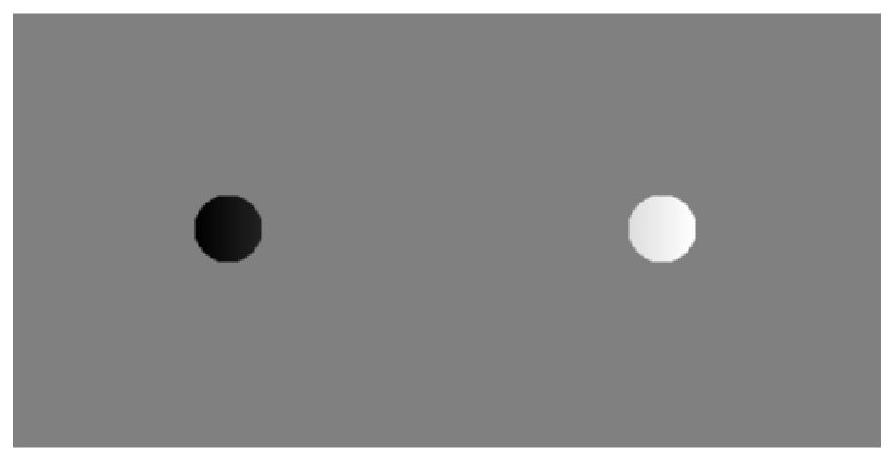

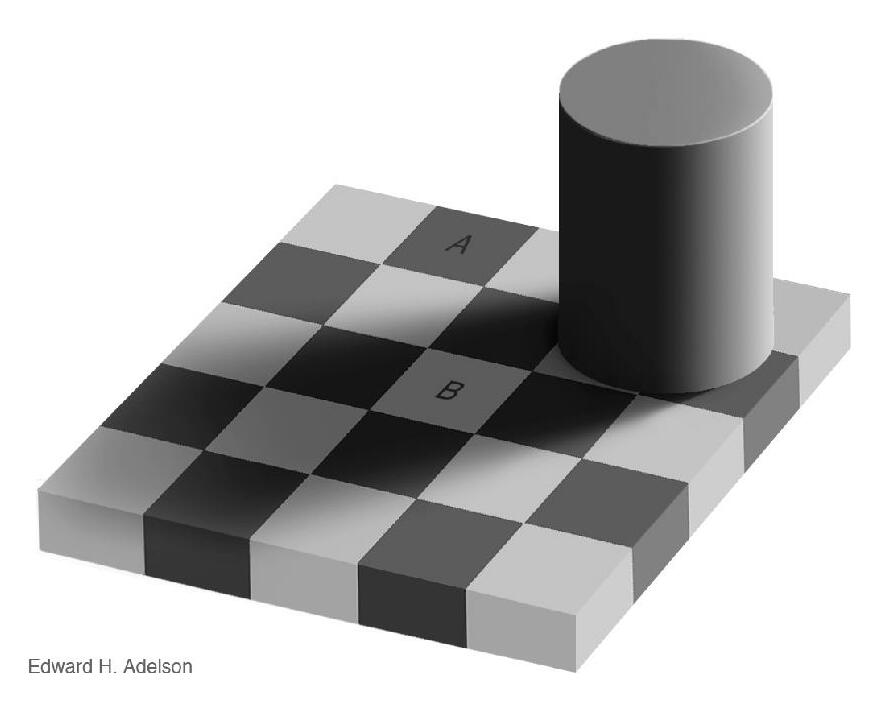

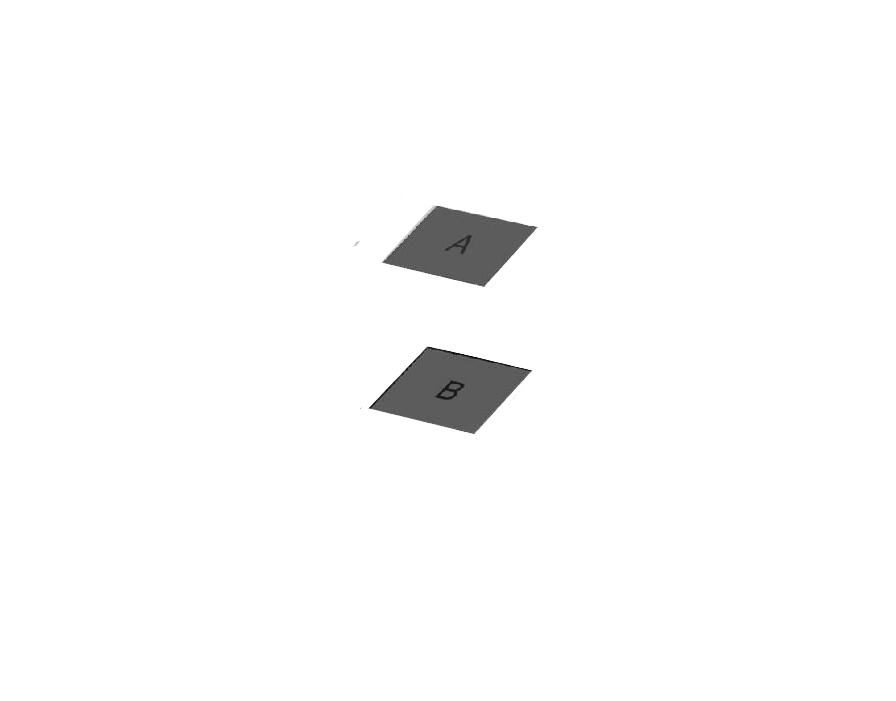

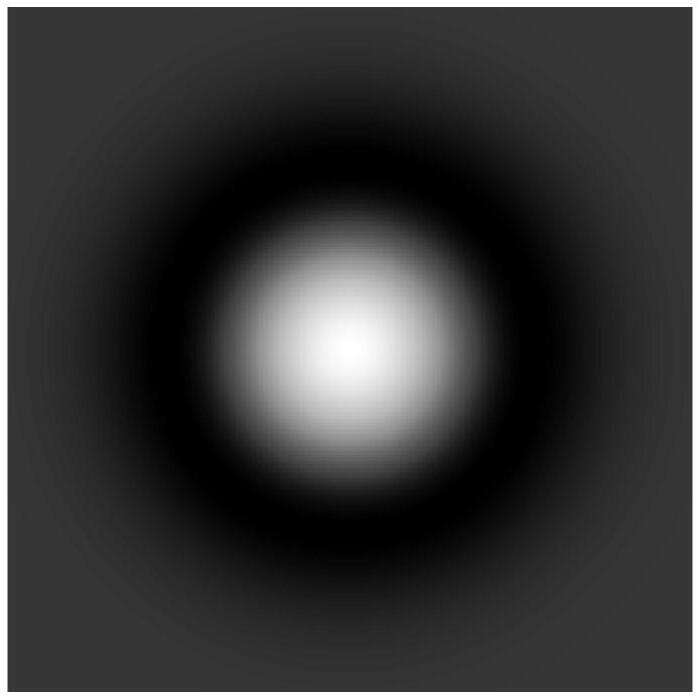

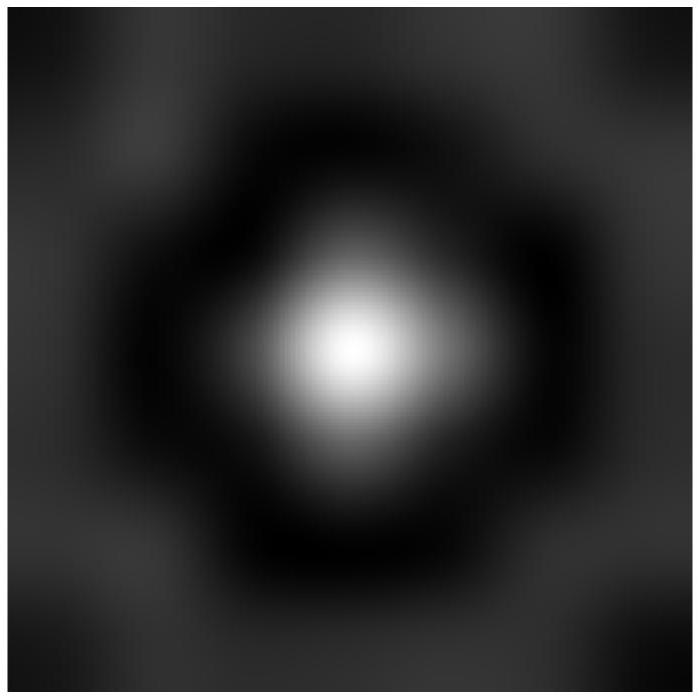

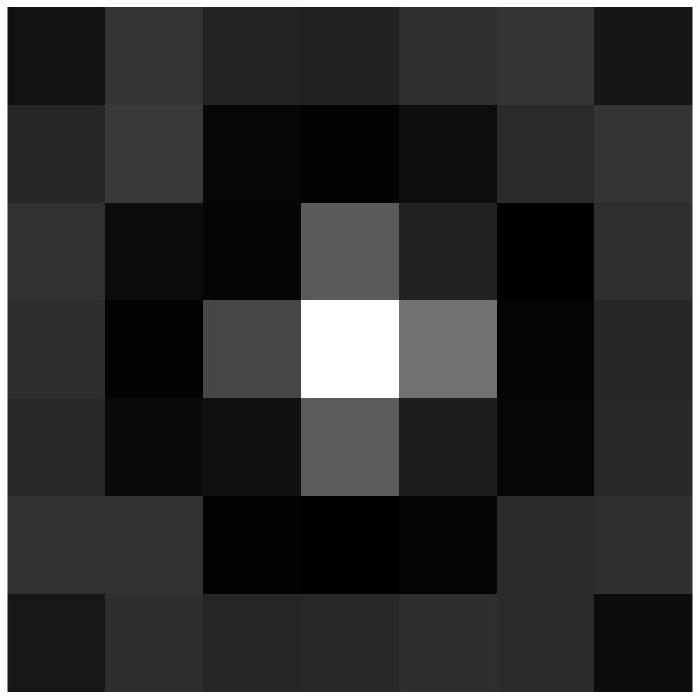

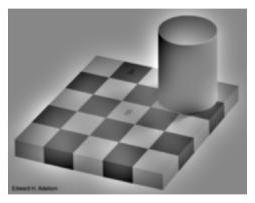

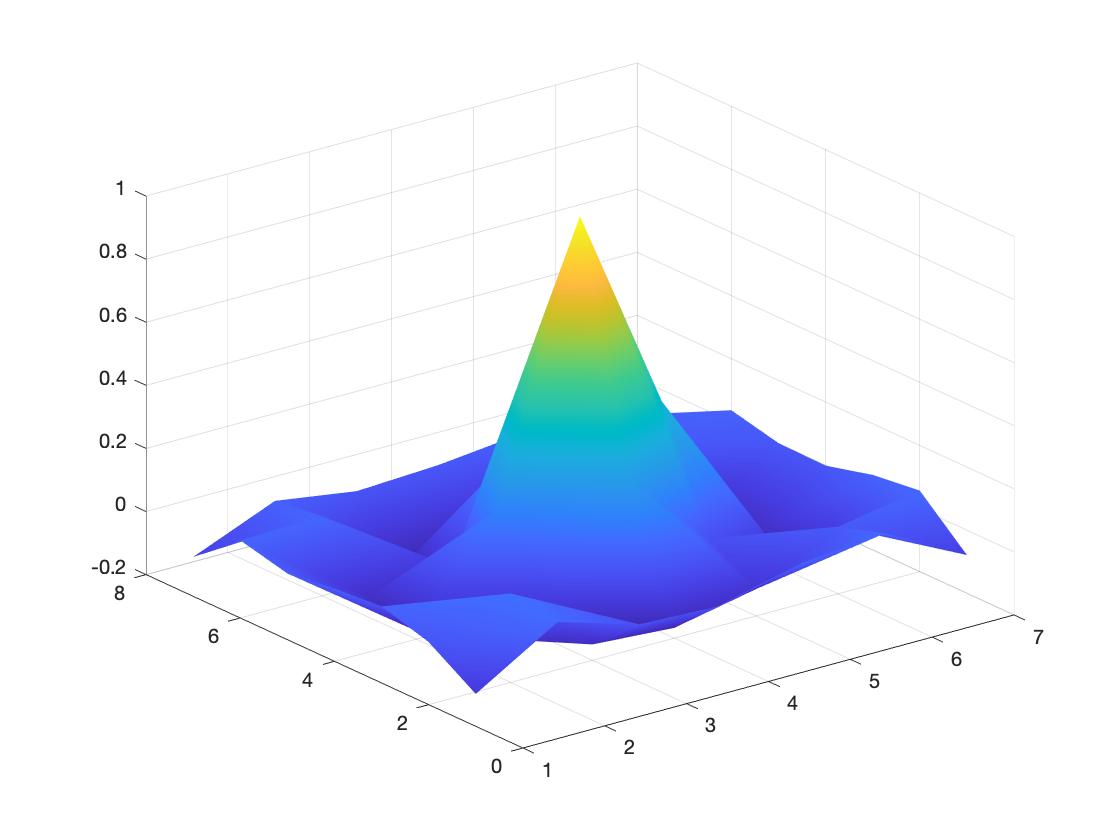

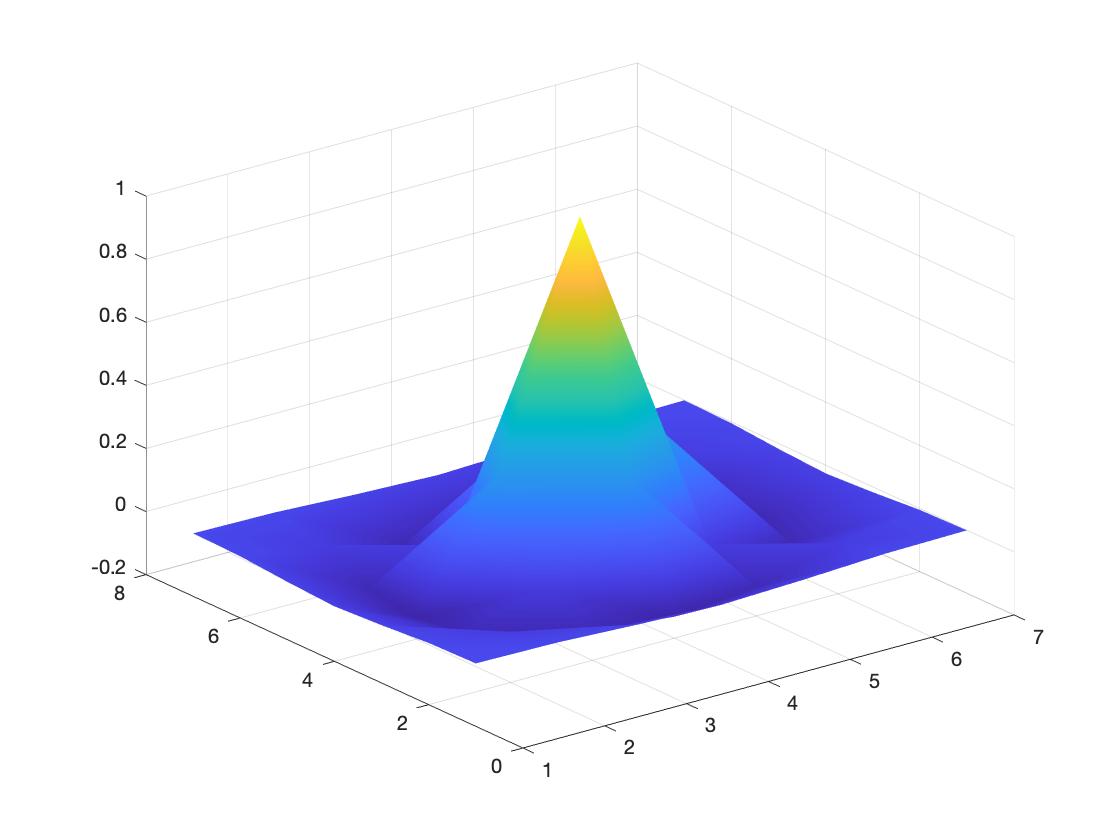

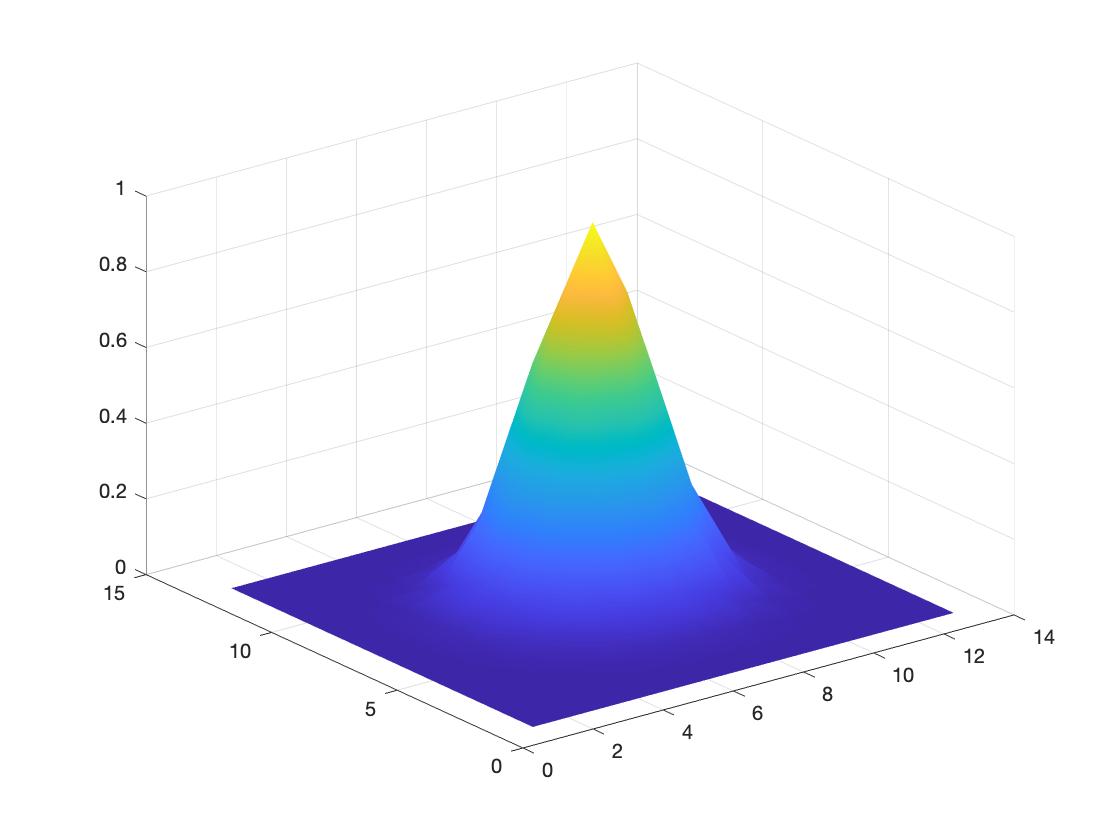

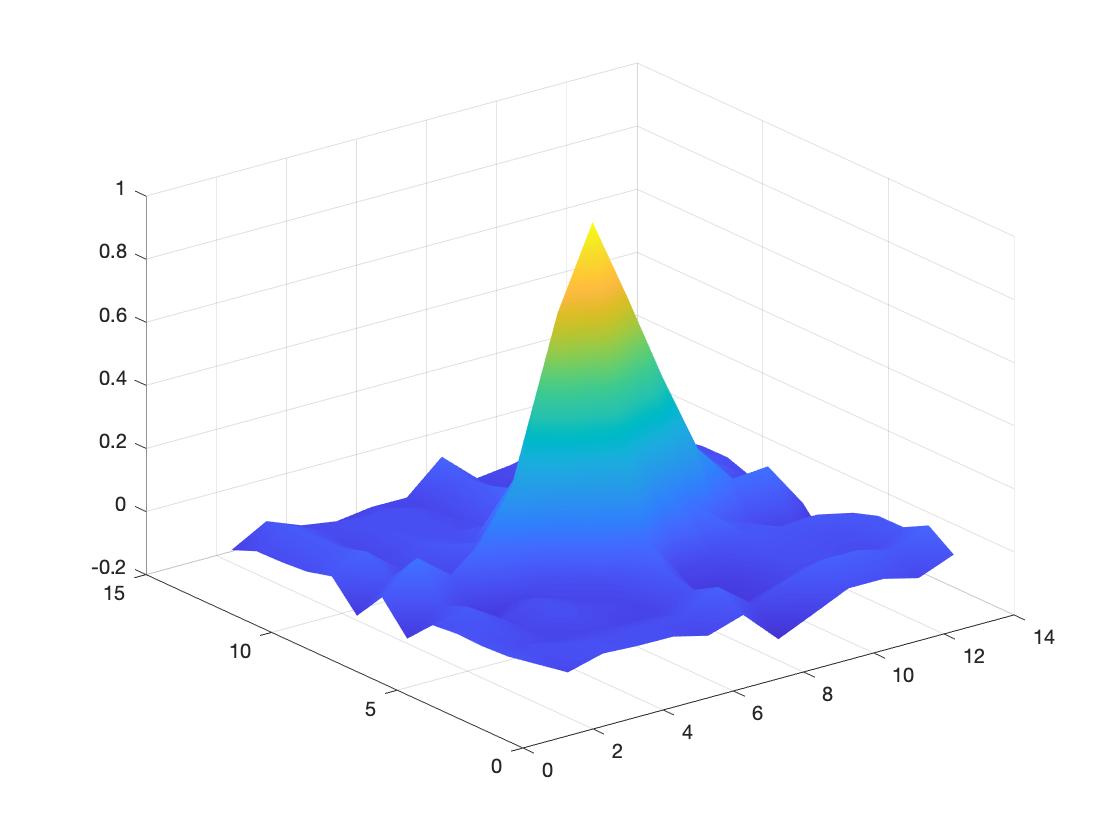

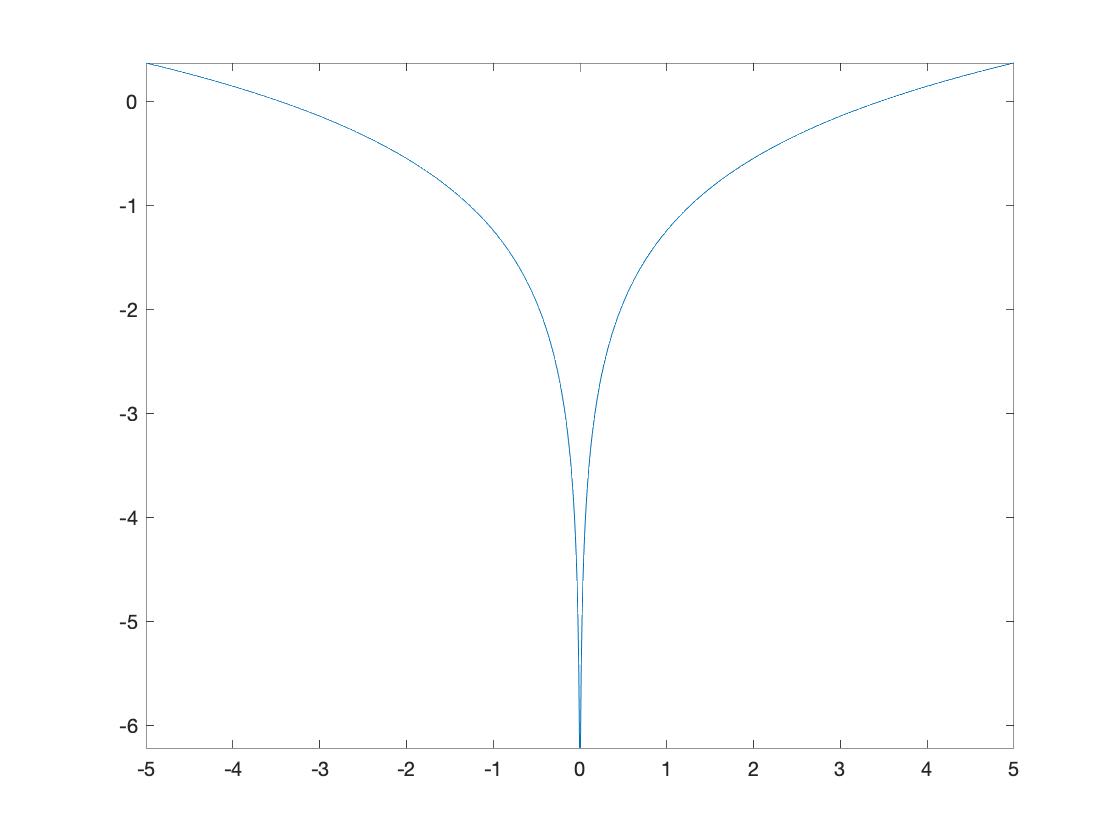

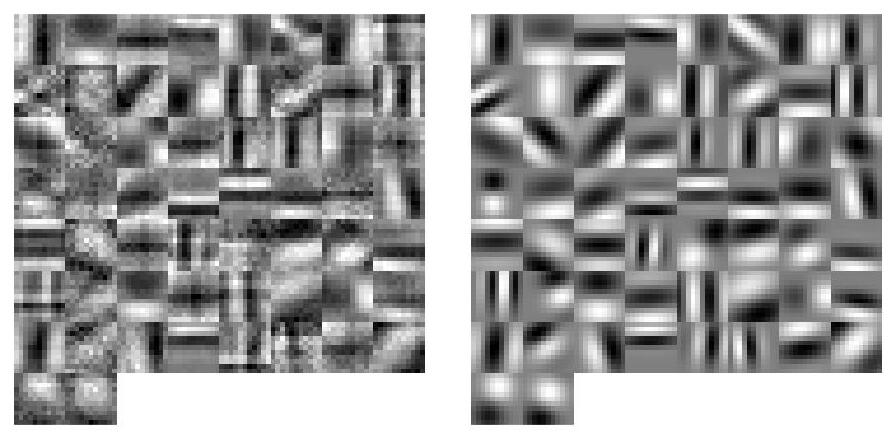

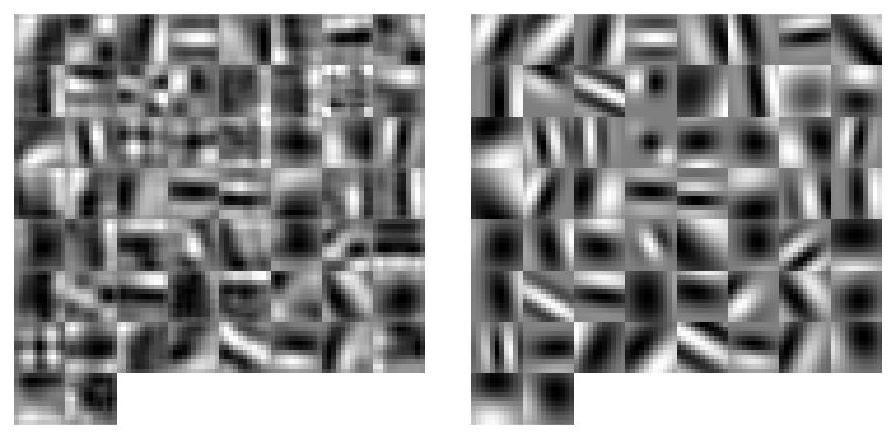

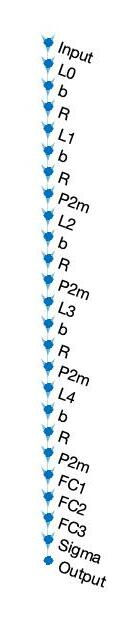

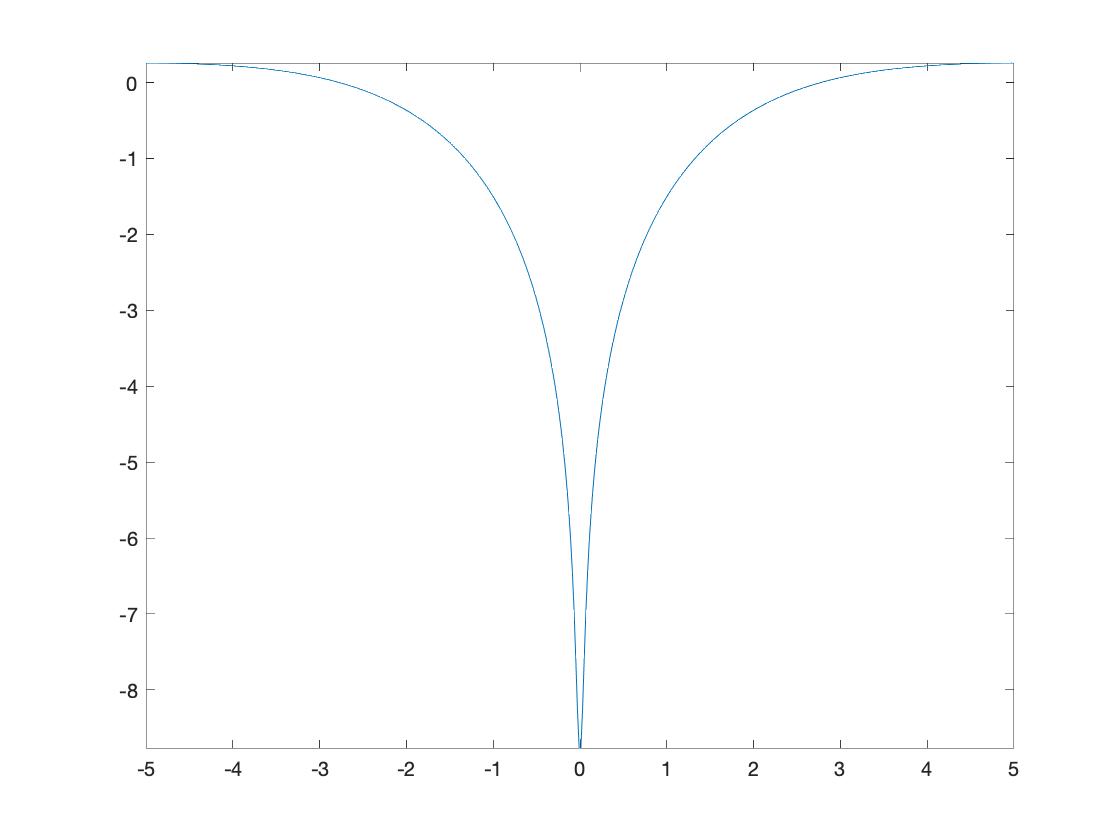

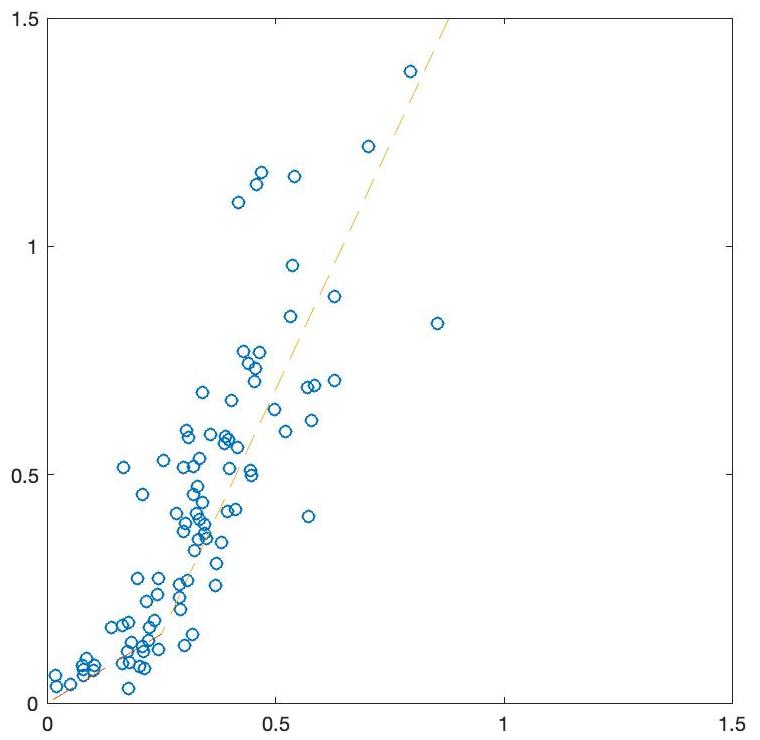

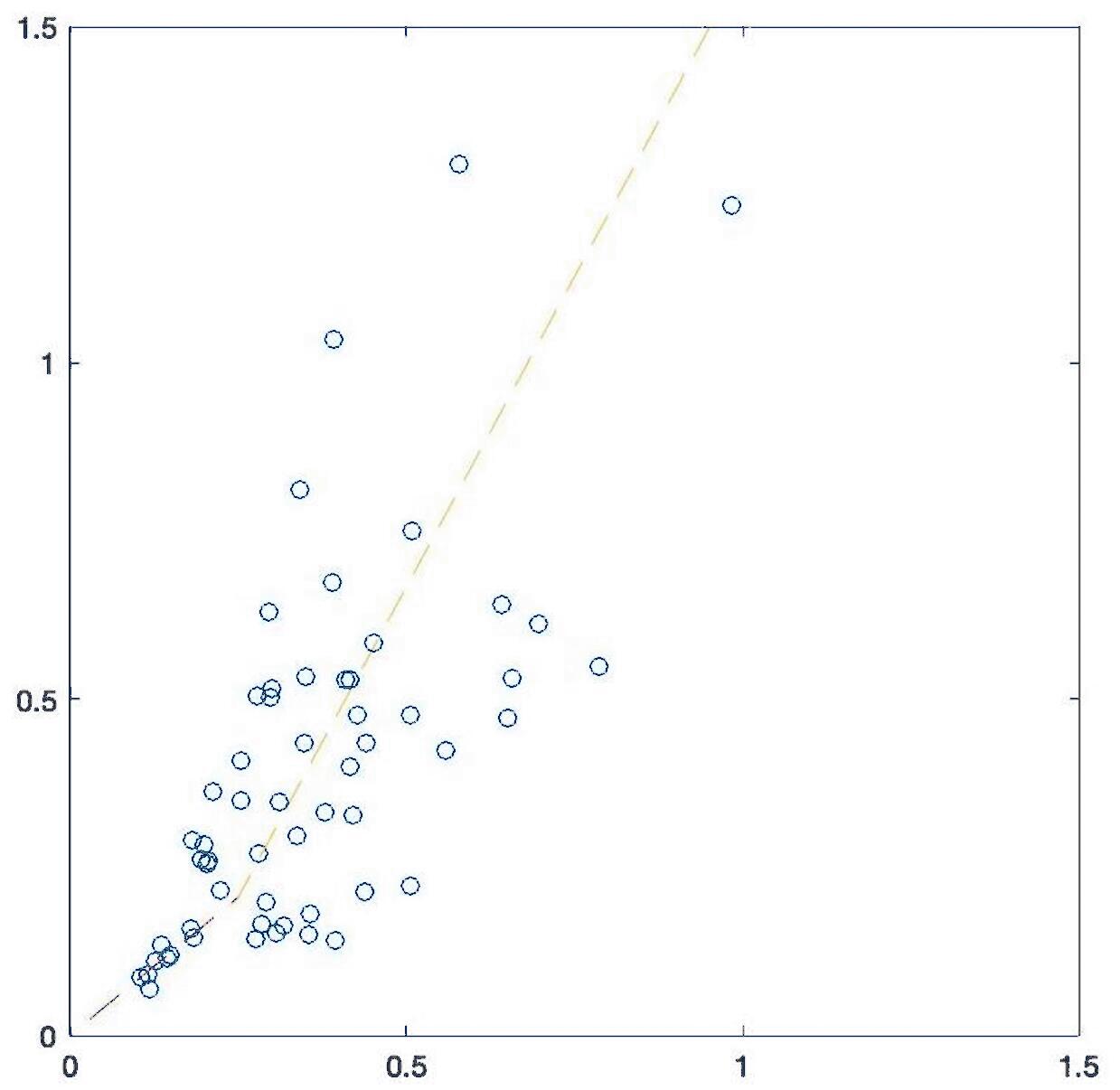

이 논문에서는 시각 체계 구조를 모방한 컨볼루셔널 신경망(CNN) 아키텍처인 LGN-CNN을 소개합니다. 이 아키텍처의 첫 번째 컨벌루션 레이어는 Lateral Geniculate Nucleus(LGN)의 역할을 모방하기 위해 단일 필터로 구성되어 있습니다. 신경망의 첫 번째 레이어는 회전 대칭 패턴을 보여주며, 이는 네트워크 자체의 구조에서 유래된 Laplacian of Gaussian(LoG) 함수에 대한 근사치입니다. 후자의 함수는 다시 LGN 세포들의 수용장 프로파일(RFPs)에 대한 좋은 근사치를 제공합니다. 신경망 아키텍처 자체로부터 직접 도출되는 시각 체계와의 유사성이 확립됩니다. 고정된 LGN-CNN 아키텍처에서 첫 번째 레이어의 회전 불변성을 증명하고 계산 결과를 제시합니다. 또한, LGN-CNN의 대조 불변성 능력을 조사하며 다양한 이미지에 대한 LoG의 Retinex 효과와 첫 번째 레이어의 Retinex 효과 사이의 비교를 제공합니다. 두 번째 컨볼루션 레이어의 필터들에 대해 생물학적 데이터와 관련된 통계적인 연구가 수행되었습니다. 결론적으로, 제시한 모델은 LGN과 V1 세포들의 RFPs를 잘 근사화하고, Retinex 효과를 나타내는 LGN 세포들의 장거리 연결의 유사한 행동을 달성합니다.💡 논문 해설

**핵심 요약**: 이 논문에서는 시각 체계 구조를 모방한 신경망 아키텍처인 LGN-CNN을 제시하고, 이를 통해 시각 정보 처리 과정에 대한 이해와 성능 향상을 추구합니다.문제 제기: 기존의 딥러닝 모델들은 인간의 시각 체계를 완벽하게 재현하지 못합니다. 이 논문은 더 자연스럽고 효율적인 정보 처리 방식을 통해 시각 인식 성능을 향상시키는 방법을 찾고자 합니다.

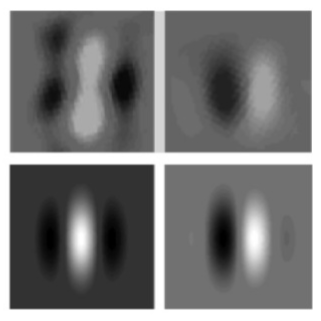

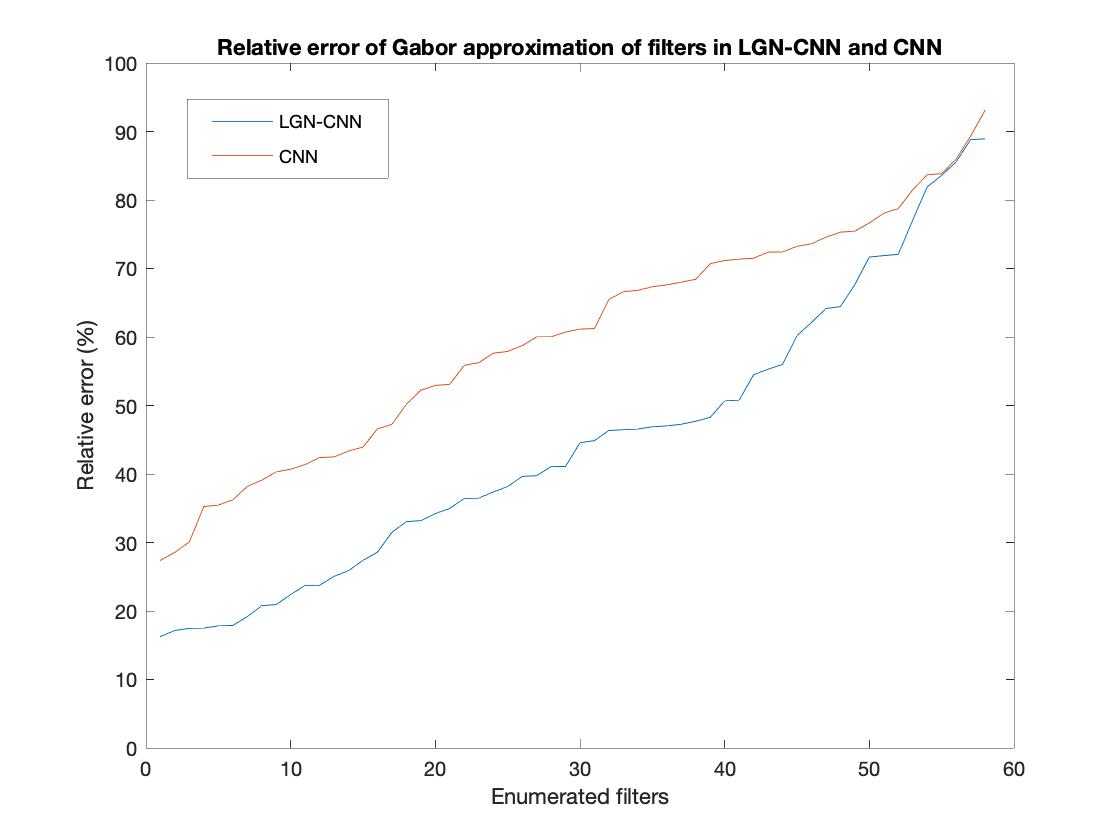

해결 방안 (핵심 기술): LGN-CNN 아키텍처는 Lateral Geniculate Nucleus(LGN)의 역할을 모방하도록 설계되었습니다. 첫 번째 컨볼루션 레이어는 단일 필터를 사용하여 LoG(Laplacian of Gaussian) 함수에 근사화되며, 이는 LGN 세포들의 수용장 프로파일(RFPs)을 재현합니다. 이러한 설계는 시각 체계의 구조와 유사하게 회전 불변성을 보여주며, 두 번째 레이어에서는 Gabor 필터를 사용하여 V1 영역의 세포들의 특징을 모방합니다.

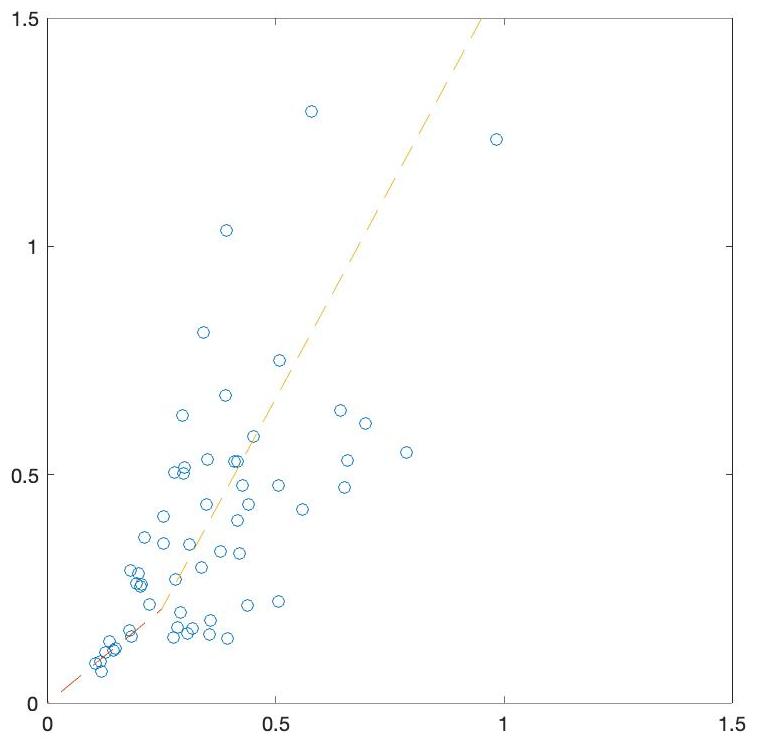

주요 성과: LGN-CNN 아키텍처는 시각 체계와 유사한 회전 불변성과 대조 불변성을 보여주며, 다양한 이미지에 대한 Retinex 효과를 잘 재현합니다. 통계적인 분석을 통해 두 번째 레이어의 필터들이 생물학적 데이터와 일치하는 것을 확인할 수 있습니다.

의의 및 활용: 이 연구는 더 자연스럽고 효율적인 시각 정보 처리 방식을 제시함으로써, 딥러닝 모델의 성능 향상뿐만 아니라 인간의 시각 체계에 대한 이해도를 높이는 데 기여할 것입니다. 특히, 이러한 접근법은 다양한 영상 처리와 인식 분야에서 유용하게 활용될 수 있습니다.

📄 논문 발췌 (ArXiv Source)

📊 논문 시각자료 (Figures)