볼칸 LLM 기반 검색을 통한 인스턴스 최적 시스템 휴리스틱

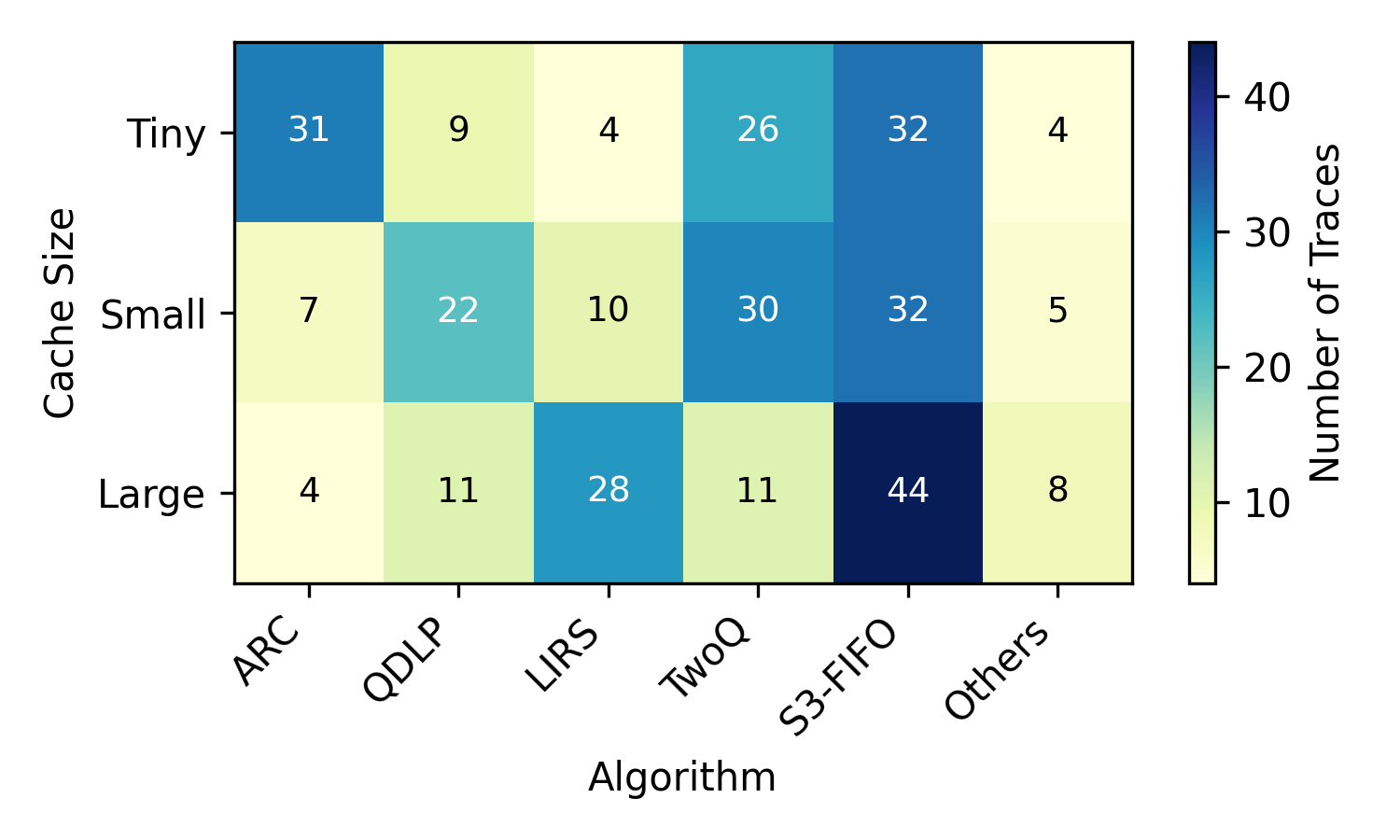

현대의 운영 시스템과 분산 시스템에서 리소스 관리 작업은 스케ジューリング, 캐싱, 또는 활성 큐 관리를 위한 주로 손으로 설계된 휴리스틱에 의존하고 있습니다. 성능이 좋은 휴리스틱을 설계하는 것은 하드웨어, 워크로드 및 환경의 지속적인 변화로 인해 비용이 많이 들고 시간이 오래 걸리는 과정입니다. 저희는 새로운 대안을 제안합니다 코드 생성형 대형 언어 모델(LLM)을 사용하여 특정 작업과 하드웨어에 특화된 인스턴스 최적 휴리스틱을 합성하는 것입니다. 이 합성을 가능하게 하기 위해 Vulcan은 LLM 친화적인 작업 무관 인터페이스를 통해 정책과 메커니즘을 분리합니다. 이러한 인터페이스를 통해 사용자는 원하는 정책의 입력과 목표를 지정하고, Vulcan은 LLM 생성 코드를 통해 진화 알고리즘을 이용해 성능이 좋은 정책을 탐색합니다. 이 인터페이스는 다양한 시스템 정책을 포괄할 만큼 표현력이 있지만, 작은 규모의 저렴한 LLM들도 올바르고 실행 가능한 코드를 생성할 수 있을 정도로 제약적입니다. 저희는 Vulcan을 이용해 캐시 추방 및 메모리 라이어링에 대한 성능이 좋은 휴리스틱을 합성하고, 이러한 휴리스틱들이 각각의 작업에서 최대 69%와 7.9%의 성능 개선으로 인간 설계의 최신 알고리즘보다 우수함을 발견하였습니다.