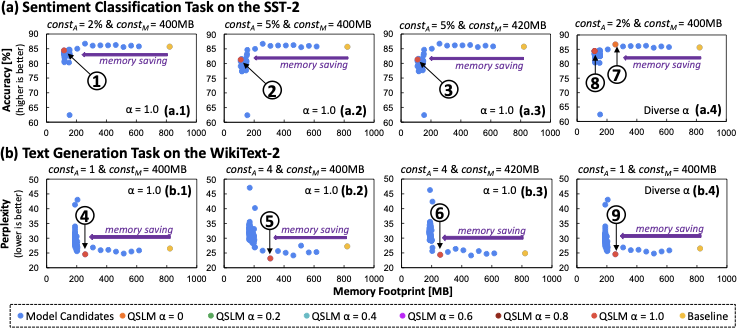

QSLM 성능과 메모리를 고려한 계층적 탐색 전략을 갖춘 양자화 프레임워크

대형 언어 모델(LLMs)과 스파이크 구동 언어 모델(SLMs)의 성능을 개선하고, 이를 임베디드 시스템에 효과적으로 구현하기 위한 양자화 기법에 대해 논한다. 본 연구에서는 SLMs의 메모리 및 에너지 효율성을 높이기 위해 자동화된 양자화 프레임워크인 QSLM을 제안하며, 이를 통해 SLMs의 성능과 메모리 요구사항을 충족시키는 효과적인 양자화 설정을 제공한다.

'Neural and Evolutionary Computing' 카테고리의 모든 글

대형 언어 모델(LLMs)과 스파이크 구동 언어 모델(SLMs)의 성능을 개선하고, 이를 임베디드 시스템에 효과적으로 구현하기 위한 양자화 기법에 대해 논한다. 본 연구에서는 SLMs의 메모리 및 에너지 효율성을 높이기 위해 자동화된 양자화 프레임워크인 QSLM을 제안하며, 이를 통해 SLMs의 성능과 메모리 요구사항을 충족시키는 효과적인 양자화 설정을 제공한다.

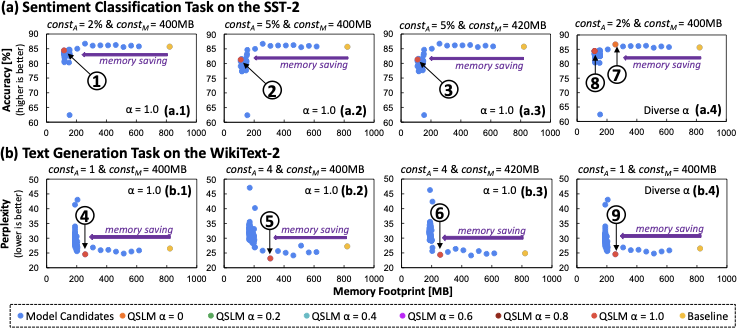

Transformer 아키텍처는 자연어 처리에서 중요한 역할을 하지만, 자기 주의 메커니즘이 긴 시퀀스를 처리하는 데 복잡도 문제를 일으킵니다. 이 논문에서는 이러한 문제를 해결하기 위해 신경-글리아 원리를 활용한 재귀적 기억 증강 아스트로모픽 트랜스포머(RMAAT) 모델을 제안합니다. RMAAT는 아스트로사이트의 기능에서 영감을 받아 긴 시퀀스 처리와 계산 효율성을 향상시킵니다.

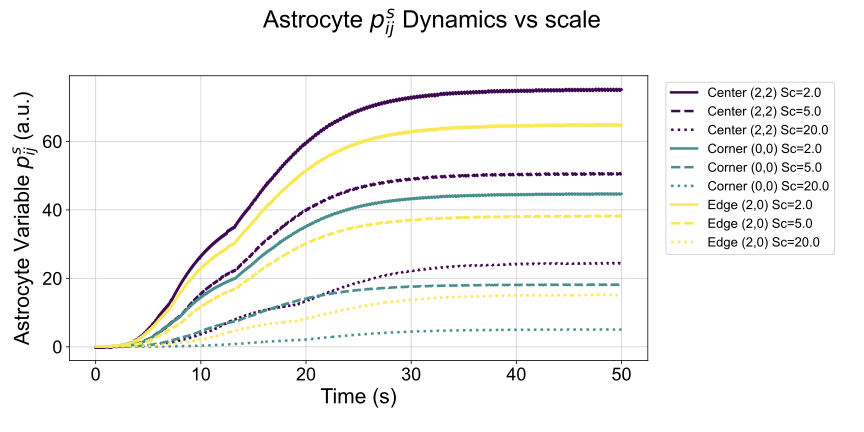

본 논문은 NP-난해 특성을 가진 조합적 및 연속 최적화 문제를 해결하기 위한 새로운 하이브리드 메타휴리스틱 옵티마이저인 Yukthi Opus (YO)를 제안한다. YO는 Markov Chain Monte Carlo(MCMC), 탐욕적 지역 검색, 재열 Simulated Annealing(SA), blacklist 메커니즘 및 다중 체인 구조를 통합하여 전역 탐색과 지역 최적화 사이의 균형을 이루며, 다양한 문제 클래스에서 계산 효율성을 유지한다. 본 논문은 Rastrigin 5D 함수와 Rosenbrock 5D 함수에 대한 실험 결과를 통해 YO의 성능을 평가하며, TSP(Traveling Salesman Problem)와 같은 실제 문제에서도 뛰어난 성과를 보여준다. ###

검색어를 입력하세요