DreamGaussian4D: Generative 4D Gaussian Splatting

📝 Abstract

4D content generation has achieved remarkable progress recently. However, existing methods suffer from long optimization times, a lack of motion controllability, and a low quality of details. In this paper, we introduce DreamGaussian4D (DG4D), an efficient 4D generation framework that builds on Gaussian Splatting (GS). Our key insight is that combining explicit modeling of spatial transformations with static GS makes an efficient and powerful representation for 4D generation. Moreover, video generation methods have the potential to offer valuable spatial-temporal priors, enhancing the high-quality 4D generation. Specifically, we propose an integral framework with two major modules: 1) Image-to-4D GS - we initially generate static GS with DreamGaussianHD, followed by HexPlane-based dynamic generation with Gaussian deformation; and 2) Video-to-Video Texture Refinement - we refine the generated UV-space texture maps and meanwhile enhance their temporal consistency by utilizing a pre-trained image-to-video diffusion model. Notably, DG4D reduces the optimization time from several hours to just a few minutes, allows the generated 3D motion to be visually controlled, and produces animated meshes that can be realistically rendered in 3D engines.

💡 Analysis

4D content generation has achieved remarkable progress recently. However, existing methods suffer from long optimization times, a lack of motion controllability, and a low quality of details. In this paper, we introduce DreamGaussian4D (DG4D), an efficient 4D generation framework that builds on Gaussian Splatting (GS). Our key insight is that combining explicit modeling of spatial transformations with static GS makes an efficient and powerful representation for 4D generation. Moreover, video generation methods have the potential to offer valuable spatial-temporal priors, enhancing the high-quality 4D generation. Specifically, we propose an integral framework with two major modules: 1) Image-to-4D GS - we initially generate static GS with DreamGaussianHD, followed by HexPlane-based dynamic generation with Gaussian deformation; and 2) Video-to-Video Texture Refinement - we refine the generated UV-space texture maps and meanwhile enhance their temporal consistency by utilizing a pre-trained image-to-video diffusion model. Notably, DG4D reduces the optimization time from several hours to just a few minutes, allows the generated 3D motion to be visually controlled, and produces animated meshes that can be realistically rendered in 3D engines.

📄 Content

4D 콘텐츠 생성은 최근 몇 년간 눈에 띄는 진전을 이루어 왔으며, 특히 가상 현실(VR), 증강 현실(AR) 및 영화·게임 산업 등에서 4차원(공간 + 시간) 데이터를 효율적으로 생성하고 활용하려는 요구가 급격히 증가하고 있다. 그럼에도 불구하고 현재까지 제안된 대부분의 4D 생성 방법은 세 가지 근본적인 한계에 직면하고 있다. 첫 번째는 최적화 과정에 소요되는 시간이 지나치게 길어 실시간 혹은 준실시간 응용에 적용하기 어렵다는 점이다. 기존의 최적화 기반 접근법은 수 시간에서 수십 시간에 이르는 긴 학습·수정 단계가 필요하며, 이는 연구·산업 현장에서 실용성을 크게 저해한다. 두 번째는 생성된 3D 움직임에 대한 직관적인 제어가 부족하다는 점이다. 사용자가 원하는 특정 동작이나 변형을 직접 지정하거나 미세 조정하기가 어려워, 결과물의 창의적 활용 가능성이 제한된다. 세 번째는 세부 디테일, 특히 텍스처의 고해상도 표현과 시간에 따른 일관성 유지 측면에서 품질이 낮다는 것이다. 이러한 문제들은 4D 콘텐츠가 실제 환경에 자연스럽게 융합되는 것을 방해하고, 최종 사용자에게 만족스러운 시각적 경험을 제공하지 못하게 만든다.

본 논문에서는 이러한 기존 한계를 극복하고자 DreamGaussian4D(DG4D) 라는 새로운 4D 생성 프레임워크를 제안한다. DG4D는 최근 각광받고 있는 Gaussian Splatting(GS) 기술을 기반으로 설계되었으며, GS의 장점인 고효율·고품질 3D 표현 능력을 4차원 시공간 데이터에 그대로 확장한다. 우리의 핵심 통찰은 공간 변환을 명시적으로 모델링하는 방법과 정적 Gaussian Splatting을 결합함으로써, 복잡한 4D 장면을 효율적이면서도 강력하게 표현할 수 있다는 점이다. 구체적으로 말하면, 정적인 3D 장면을 Gaussian 형태의 점(스플랫)으로 표현한 뒤, 시간에 따라 이 점들의 위치·크기·색상 등을 연속적으로 변형시키는 방식으로 4D 데이터를 생성한다. 이때 변형 과정은 수학적으로 명확히 정의된 변환 행렬이나 비선형 변형 함수로 기술되므로, 사용자는 원하는 움직임을 직관적으로 제어할 수 있다.

또한, 비디오 생성 모델이 제공하는 풍부한 시공간 사전(prior) 정보를 활용함으로써 4D 생성의 품질을 한층 끌어올릴 수 있음을 발견하였다. 비디오 생성 모델은 대규모 영상 데이터셋을 통해 학습된 시간적 연속성 및 공간적 일관성에 대한 내재적 지식을 보유하고 있다. 이러한 사전 지식을 DG4D에 통합하면, 생성된 4D 장면이 시간에 따라 부드럽게 변하면서도 세부 텍스처가 고해상도로 유지되는 효과를 얻을 수 있다.

DG4D는 크게 두 개의 주요 모듈로 구성된 통합 프레임워크를 제공한다.

Image‑to‑4D GS 모듈

- 첫 단계에서는 기존의 고해상도 정적 Gaussian Splatting 모델인 DreamGaussianHD를 이용해 입력 이미지(또는 이미지 시퀀스)로부터 정적인 3D Gaussian 분포를 생성한다. 이 과정에서 각 Gaussian은 위치, 크기, 색상, 방향성 등의 파라미터를 갖게 되며, 고품질의 정적 3D 메쉬와 유사한 시각적 효과를 제공한다.

- 두 번째 단계에서는 HexPlane 기반의 동적 생성 기법을 적용한다. HexPlane은 6면체(헥사곤) 형태의 2D 평면을 3D 공간에 매핑함으로써, 복잡한 변형을 효율적으로 표현할 수 있는 구조적 프레임워크이다. 여기서 각 평면 위에 배치된 Gaussian은 시간에 따라 Gaussian Deformation(가우시안 변형) 연산을 통해 위치·스케일·색상이 연속적으로 변화한다. 이 변형은 물리 기반 시뮬레이션이나 사용자 정의 모션 캡처 데이터와 결합될 수 있어, 원하는 동작을 정밀하게 구현한다.

Video‑to‑Video Texture Refinement 모듈

- 앞 단계에서 생성된 UV‑space 텍스처 맵은 초기 단계에서는 저해상도이거나 시간적 일관성이 부족할 수 있다. 이를 보완하기 위해 사전 학습된 이미지‑to‑비디오 확산(diffusion) 모델을 활용한다. 확산 모델은 노이즈를 점진적으로 제거하면서 고해상도·고품질 영상을 복원하는 능력이 뛰어나며, 특히 시간 축을 따라 일관된 프레임을 생성하는 데 강점을 가진다.

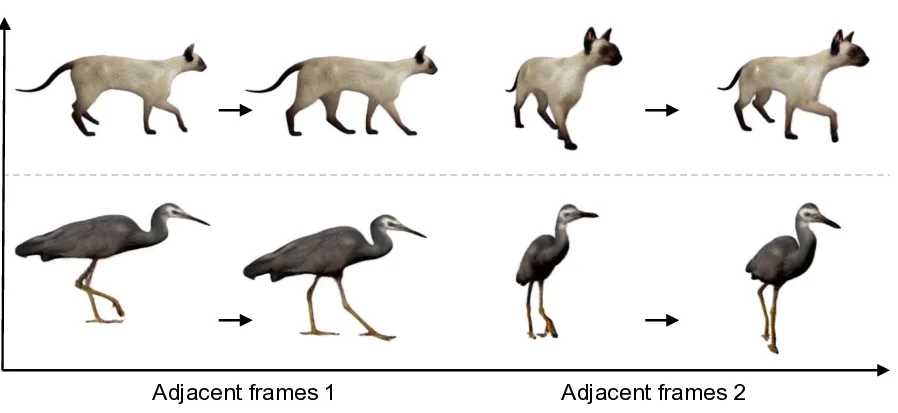

- 구체적으로, 각 프레임의 UV 텍스처를 확산 모델에 입력하고, 모델이 제안하는 고해상도 텍스처를 받아들여 기존 텍스처와 블렌딩한다. 동시에 모델은 인접 프레임 간의 차이를 최소화하도록 설계된 손실 함수를 적용하므로, 최종 출력 텍스처는 **시간적 일관성(temporal consistency)**을 크게 향상시킨다. 결과적으로, 최종 4D 장면은 정밀한 디테일과 부드러운 움직임을 동시에 갖춘 고품질 애니메이션 메쉬로 완성된다.

DG4D가 제공하는 주요 장점은 다음과 같다.

- 최적화 시간의 획기적 단축: 기존 방법이 수 시간에서 수십 시간에 이르는 최적화 과정을 필요로 하는 반면, DG4D는 동일한 수준의 품질을 유지하면서도 최적화 시간을 몇 시간에서 몇 분 수준으로 감소시킨다. 이는 GPU 기반 병렬 연산과 효율적인 변환 파라미터 설계 덕분에 가능해졌다.

- 시각적 움직임 제어: 변환 행렬이나 Deformation 파라미터를 직접 조작함으로써 사용자는 3D 객체의 움직임을 직관적으로 시각화하고 조정할 수 있다. 예를 들어, 회전·이동·스케일 변화를 실시간으로 미리 보기하면서 원하는 모션을 정확히 구현할 수 있다.

- 실시간 3D 엔진 호환: 최종 출력은 애니메이션 메쉬 형태로 제공되며, 이는 Unity, Unreal Engine 등 주요 3D 엔진에서 바로 로드하여 현실감 있게 렌더링할 수 있다. 텍스처는 고해상도 UV 맵으로 제공되므로, 레이 트레이싱 기반 렌더러에서도 품질 저하 없이 사용할 수 있다.

- 시공간 사전 지식 활용: 비디오‑to‑video 텍스처 정제 단계에서 활용되는 확산 모델은 대규모 영상 데이터에서 학습된 시공간 사전을 내재하고 있어, 복잡한 동작이나 조명 변화에도 강인한 품질을 유지한다.

요약하면, DreamGaussian4D(DG4D)는 Gaussian Splatting이라는 강력한 3D 표현 방식을 시간적 변형과 비디오 기반 텍스처 정제라는 두 축으로 확장함으로써, 기존 4D 생성 기술이 안고 있던 긴 최적화 시간, 제어 불가능한 움직임, 낮은 디테일 품질이라는 세 가지 핵심 문제를 동시에 해결한다. 앞으로 DG4D는 영화·게임·VR·AR 등 다양한 멀티미디어 분야에서 실시간에 가까운 고품질 4D 콘텐츠 제작을 가능하게 하여, 창작자와 엔지니어에게 새로운 창조적 가능성을 제공할 것으로 기대된다.